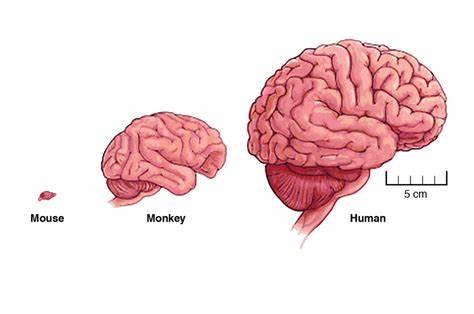

Künstliche Intelligenz (KI) hat in den letzten Jahren einen beeindruckenden Wandel durchlaufen und beeinflusst mittlerweile zahlreiche Lebensbereiche – von medizinischer Diagnostik über Sprachassistenten bis hin zu autonomen Fahrzeugen. Trotz der zahllosen beeindruckenden Anwendungen und Erfolge bleibt jedoch ein bemerkenswertes Phänomen bestehen: Niemand weiß wirklich, warum die KI-Systeme so gut funktionieren. Dieses Geheimnis umgibt die Technologie und beschäftigt Forscher sowie Experten aus der ganzen Welt gleichermaßen. Grundsätzlich basiert moderne KI vor allem auf sogenannten neuronalen Netzen, inspiriert von der Funktionsweise des menschlichen Gehirns. Diese Netze bestehen aus einer Vielzahl von künstlichen Neuronen, die miteinander in Schichten verbunden sind.

Über komplexe mathematische Algorithmen und große Datenmengen werden diese Systeme trainiert, um Muster zu erkennen und darauf zu reagieren. Doch trotz dieser theoretischen Grundlagen fällt es Forschern schwer, genau zu erklären, warum gerade diese Modelle oftmals hervorragende Ergebnisse liefern. Ein entscheidender Punkt ist die sogenannte Blackbox-Natur vieler KI-Modelle. Wenn ein System auf Basis der Trainingsdaten Entscheidungen trifft, ist es für Menschen oft nahezu unmöglich nachzuvollziehen, auf welcher Grundlage es diese Entscheidungen trifft. Dies steht im Gegensatz zu klassischen Algorithmen, deren Arbeitsweisen und Regeln klar definiert und nachvollziehbar sind.

Im Fall der KI sind die inneren Abläufe vielfach abstrakt und vernetzt, sodass selbst die Entwickler der Modelle Schwierigkeiten haben, konkrete Erklärungen zu liefern. Die Frage, warum KI funktioniert, ist nicht nur wissenschaftlich relevant, sondern auch ethisch und gesellschaftlich bedeutsam. Wenn wir nicht verstehen, wie und warum bestimmte Resultate entstehen, wird es schwierig, Fehlverhalten zu erkennen und zu korrigieren. Dies ist besonders wichtig in sicherheitskritischen Bereichen wie der Medizin oder dem autonomen Fahren. Die Transparenz und Nachvollziehbarkeit von KI-Systemen stehen daher im Fokus aktueller Forschungen und Diskussionen.

Ein weiterer Aspekt ist, dass KI-Systeme in der Regel auf großen Datenmengen trainiert werden, die aus der wirklichen Welt stammen. Dort spiegeln sich viele Zusammenhänge wider, die Menschen intuitiv erfassen, aber schwer formal beschreibbar sind. KI kann diese komplexen, oft subtilen Muster in den Daten erkennen und nutzen, ohne die dahinterliegenden Ursachen genau zu verstehen. Diese Fähigkeit macht die KI zwar mächtig, lässt aber größere Verständnislücken zurück. Darüber hinaus überrascht die Robustheit von KI manchmal selbst ihre Entwickler.

Modelle zeigen Leistungsstärke in Situationen, die so nicht explizit trainiert wurden, finden überraschende Lösungen für Probleme oder zeigen eine gewisse Kreativität. Diese Erfolge sind faszinierend, aber die Gründe dafür oft unklar. Das führt zu der Befürchtung, dass wir Technologien entwickeln, deren Verhalten wir langfristig nicht kontrollieren oder vorhersagen können. Wissenschaftler forschen intensiv an Methoden, um die interne Funktionsweise von KI besser zu verstehen. Ansätze wie erklärbare KI (Explainable AI) versuchen, Modelle transparenter zu machen und zu visualisieren, welche Faktoren bei Entscheidungen eine Rolle spielen.

Darüber hinaus wird untersucht, wie neuronale Netze bestimmte Muster erlernen und welche Repräsentationen dabei entstehen. Trotz dieser Fortschritte ist das Verständnis noch nicht lückenlos. Interessanterweise stellt der Umstand, dass niemand so genau weiß, warum KI funktioniert, auch eine Parallele zur menschlichen Intelligenz dar. Menschen selbst verstehen oft nicht vollständig, warum sie bestimmte Entscheidungen treffen oder wie das Gehirn Bewusstsein und Urteilskraft generiert. Durch diese Perspektive bekommt die KI nicht nur eine technologische, sondern auch eine philosophische Dimension.

Die öffentliche Diskussion über KI wird deshalb auch von Hoffnungen und Ängsten begleitet. Während die Technologie enormes Potenzial besitzt, stellen sich viele die Frage nach Kontrolle, Verantwortung und ethischer Gestaltung. Die Tatsache, dass die inneren Abläufe so schwer durchschaubar sind, verschärft diese Debatten. Es entsteht ein Spannungsfeld zwischen Innovation und Risiko, das kontinuierliche Aufmerksamkeit erfordert. Letztlich wird der Fortschritt der KI-Forschung vermutlich weiterhin von Trial-and-Error geprägt sein.

Systeme werden ständig weiterentwickelt, optimiert und auf neue Anwendungsgebiete ausgeweitet. Dabei bleibt spannend zu beobachten, ob die Wissenschaftler eines Tages ein tieferes Verständnis der Mechanismen erlangen oder ob die KI weiterhin als eine Art Blackbox bestehen wird – ein mächtiges Werkzeug mit noch weitgehend unerklärter Funktionalität. Insgesamt zeigt sich, dass die Gründe für den Erfolg der KI komplex und vielschichtig sind. Die Kombination aus großen Datenmengen, leistungsfähigen Algorithmen und tiefen neuronalen Netzen erzeugt eine Synergie, deren Wirkung wir noch nicht vollständig begreifen. Dieses Geheimnis macht die Faszination der KI ebenso aus wie die Herausforderungen, die sie mit sich bringt.

Die Zukunft der KI bleibt daher nicht nur technologisch, sondern auch intellektuell eine spannende Reise.

![No one knows why AI works [video]](/images/07640BBC-0ED4-4C5C-9DCD-D606AB341BD5)