Die rasante Entwicklung künstlicher Intelligenz hat viele Fortschritte in verschiedenen Bereichen ermöglicht, doch mit dem zunehmenden Einsatz von KI-Chatbots im Finanzsektor entstehen auch neue Risiken. Eine besonders beunruhigende Bedrohung ist der neu entdeckte Angriff, bei dem Cyberkriminelle falsche Erinnerungen in KI-gestützte Chatbots pflanzen, um betrügerisch die Kontrolle über Kryptowährungen der Nutzer zu erlangen. Diese Technik eröffnet eine vollkommen neue Dimension der Manipulation, die weit über herkömmliche Hackerangriffe hinausgeht und stellt sowohl Unternehmen als auch Privatpersonen vor eine große Sicherheitsherausforderung.Im Zentrum dieses Angriffs steht die Technologie sogenannter KI-Chatbots, die zunehmend zur Kundenbetreuung, Beratung und als Schnittstelle für Finanztransaktionen verwendet werden. Die Chatbots basieren meist auf komplexen neuronalen Netzwerken, die durch maschinelles Lernen trainiert werden, um natürliche Sprache zu verstehen und zu verarbeiten.

Dabei sammeln und speichern sie kontextbezogene Informationen, um bessere Antworten geben und individuelle Nutzerbedürfnisse erkennen zu können. Genau diese Fähigkeit, sich bestimmte Nutzerdaten und vorherige Interaktionen zu merken, wird jedoch von Angreifern ausgenutzt, indem sie gezielt falsche Informationen in den Speicher der KI einschleusen.Die Methode funktioniert so, dass Hacker über manipulierte Chat-Interaktionen sequenziell gezielt Wissen und Falschinformaionen beim KI-Modell hinterlegen. Da der Chatbot die eingebrachten Daten als real und vertrauenswürdig abspeichert, kann er später bösartige Handlungsanweisungen aus dieser durch die „falschen Erinnerungen“ gefälschten Realität generieren. Im Kontext von Kryptowährungen ist das besonders gefährlich, denn die KI könnte beispielsweise dazu verleitet werden, private Schlüssel, Wallet-Adressen oder Überweisungsbefehle zu verändern oder weiterzugeben.

Somit entsteht eine Angriffsfläche, bei der nicht der Nutzer sondern die künstliche Intelligenz das Sicherheitsproblem darstellt.Aus technischer Sicht basiert diese Angriffsform auf einer Schwachstelle im sogenannten „Prompt Injection“- oder „Memory Manipulation“-Angriff, bei denen Eingaben in natürliche Sprache das Verhalten des Modells nachhaltig verfälschen. Während klassische Cyberattacken meistens Exploits in Softwarecode oder Serverinfrastrukturen ausnutzen, wird hier direkt das lernbasierte Verarbeitungsmodell der KI missbraucht. Das macht es besonders schwer, die Gefahr mit herkömmlichen Sicherheitsmaßnahmen wie Firewalls oder Antivirenprogrammen abzuwehren. Die Angreifer benötigen lediglich eine Schnittstelle zum Chatbot, die bei vielen Finanzanwendungen mittlerweile üblich ist, um mit Nutzern zu kommunizieren.

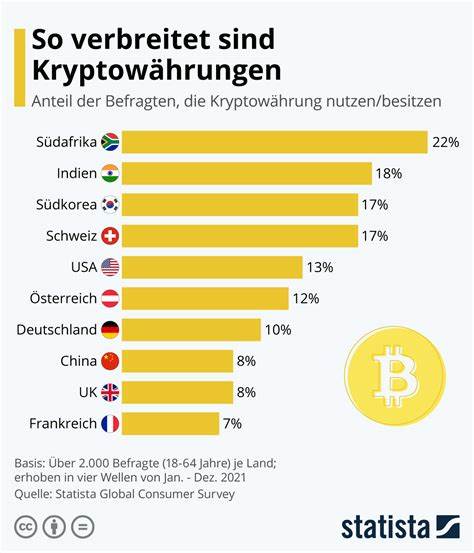

Die Konsequenzen eines erfolgreichen Angriffs sind verheerend. Nutzer verlieren die Kontrolle über ihre Kryptowährungen, und durch manipulierte Transaktionen können enorme Werte innerhalb kürzester Zeit gestohlen werden. Zusätzlich leidet das Vertrauen in KI-Systeme als sichere Hilfsmittel für den Finanzsektor, was den Fortschritt und die Akzeptanz künstlicher Intelligenz hemmt. Besonders in der stark regulierten Welt der Kryptowährungen, die ohnehin bereits mit zahlreichen Risiken und Unsicherheiten behaftet ist, könnten derartige Sicherheitslücken zu regulatorischen Verschärfungen und strengeren Auflagen führen.Um sich vor solchen Angriffen zu schützen, sind umfassende Sicherheitskonzepte erforderlich, die nicht nur einzelne IT-Komponenten absichern, sondern speziell auf KI-Systeme zugeschnittene Maßnahmen umfassen.

Dazu gehört eine strikte Kontrolle und Filterung von Input-Daten, um schädliche Sequenzen frühzeitig zu identifizieren und auszuschließen. Ebenso wichtig ist die Entwicklung von KI-Modellen, die manipulierte Inhalte erkennen und entsprechend reagieren können, ohne automatisch auf gefälschte Informationen zuzugreifen. Eine Kombination aus technischer Innovation und Awareness-Programmen für Nutzer und Entwickler kann dazu beitragen, das Risiko von Memory Manipulation-Angriffen zu minimieren.Neben technischen Maßnahmen spielt auch die rechtliche und regulatorische Dimension eine zentrale Rolle. Der Schutz von Kryptowährungen erfordert klare Richtlinien für den Einsatz von KI im Finanzbereich, die sowohl die Transparenz als auch die Rechenschaftspflicht der Anbieter sicherstellen.

Darüber hinaus müssen Anbieter von KI-gestützten Chatbots verpflichtet werden, Sicherheitslücken frühzeitig zu melden und Sicherheitsupdates regelmäßig bereitzustellen. Nur so kann ein vertrauenswürdiges Umfeld entstehen, das die Vorteile der Künstlichen Intelligenz genutzt und gleichzeitig den Schutz der Nutzer gewährleistet.Die Integration von Künstlicher Intelligenz in die Finanzwelt wird weiter zunehmen, und damit wächst auch die Bedeutung einer robusten Sicherheit. Die neue Angriffsmethode durch das Pflanzen falscher Erinnerungen in KI-Chatbots ist ein warnendes Beispiel dafür, wie innovativ Cyberkriminelle vorgehen und welche Herausforderungen dadurch entstehen. Finanzinstitute, Entwickler und Nutzer müssen gemeinsam Verantwortung übernehmen, um die Sicherheit und Integrität von Kryptowährungen langfristig zu sichern.