Die rasante Entwicklung der Künstlichen Intelligenz hat in den letzten Jahren vor allem im Bereich der großen Sprachmodelle (Large Language Models - LLMs) für Aufsehen gesorgt. Anwendungen, die auf diesen Modellen basieren, eröffnen vielfältige Möglichkeiten in Bereichen wie Textgenerierung, Analyse, Automatisierung und Kundenservice. Dennoch stellt die Integration und die effektive Nutzung dieser Modelle für viele Entwickler und Unternehmen eine Herausforderung dar. Hier kommt Very Simple LLM ins Spiel und markiert einen bedeutenden Schritt hin zu einer einfacheren, effizienteren und benutzerfreundlichen Schnittstelle für moderne Sprachmodelle. Very Simple LLM ist eine minimalistische API, die es ermöglicht, mainstream LLMs mit minimalem Aufwand anzusteuern und komplexe Aufgaben mit einfachen Schnittstellen zu lösen.

Das Hauptaugenmerk liegt auf der schnellen und präzisen Verarbeitung von Eingaben und der Ausgabe strukturierter Daten. Die Idee dahinter ist, dass Entwickler nicht mehr viel Zeit mit der Anpassung von Prompt-Design oder der Handhabung unstrukturierter Antworten vergeuden müssen. Stattdessen liefert Very Simple LLM eine übersichtliche JSON-Antwort, die sofort weiterverarbeitet werden kann. Ein besonders interessanter Anwendungsfall ist die Analyse von Nutzerbewertungen, wie etwa Produktrezensionen. Beispielhaft kann ein Unternehmen mithilfe von Very Simple LLM automatisch Titel, Sentiment-Score und Produktkategorie aus unstrukturierten Texten extrahieren.

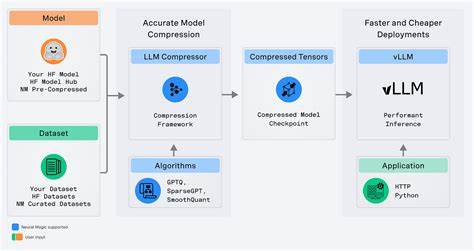

So wird aus einem schwammigen Text eine klar definierte Bewertung, die beispielsweise zur besseren Organisation von Kundenfeedback oder zur Verbesserung von Marketingstrategien genutzt werden kann. Die API von Very Simple LLM ist so aufgebaut, dass sie mit verschiedenen Modellanbietern kompatibel ist, darunter bekannte Namen wie OpenAI, Anthropic und Google. Dies gibt Nutzern maximale Flexibilität, da sie beliebte Modelle ohne aufwändige Anpassung direkt anbinden können. Die Verwendung der API ist denkbar einfach: Ein POST-Request mit JSON-Daten an die Endpoint-Adressen reicht aus, um eine strukturierte Antwort zurückzuerhalten. Die Implementierung unterstützt gängige Programmiersprachen wie JavaScript und Python und lässt sich ebenso gut im CLI-Bereich über cURL bedienen.

Neben der einfachen Handhabung bietet Very Simple LLM eine hohe Sicherheit bezüglich des Umgangs mit sensiblen API-Schlüsseln. Diese werden ausschließlich in der Authorization-Header-Variable übermittelt und niemals gespeichert oder weiterverarbeitet, was besonders in datensensiblen Bereichen wie Finanzen oder Healthcare von großer Bedeutung ist. Technisch gesehen nutzt Very Simple LLM eine klare Definition von JSON-Schemas, die die Form und den Inhalt der erwarteten Ausgabe exakt vorschreiben. Durch diese Validierung wird gewährleistet, dass nur die gewünschten Felder zurückgegeben werden, was die Weiterverarbeitung der Daten in automatisierten Workflows erheblich vereinfacht. Unternehmen profitieren von einer erheblichen Zeitersparnis, da vielerlei manuelle Nachbearbeitung entfällt und Fehlerrisiken minimiert werden.

Die Anwendungsbereiche sind vielfältig und beschränken sich keineswegs nur auf die Produktanalyse. Wenig Aufwand nötig macht Very Simple LLM beispielsweise auch bei der Erstellung individueller Chatbots, der Klassifikation von Texten, automatischer Übersetzung oder der Generierung von Inhalten für Marketingzwecke. Insbesondere die Möglichkeit, systemseitige Vorgaben über sogenannte system_prompt-Parameter zu machen, erlaubt eine hohe Anpassungsfähigkeit an spezifische Anforderungen. Der offene Zugang über GitHub sorgt zusätzlich für Transparenz und lädt Entwickler dazu ein, aktiv an der Weiterentwicklung teilzuhaben oder die API auf eigene Bedürfnisse hin anzupassen. Gerade für kleine und mittlere Unternehmen, die nicht über große Entwicklerressourcen verfügen, kann Very Simple LLM so zum unverzichtbaren Werkzeug werden, um den Zugang zu modernster KI-Technologie zu erleichtern und dennoch professionelle Ergebnisse zu erzielen.

Im Vergleich zu anderen Lösungen fällt besonders das schlanke und fokussierte Design auf. Die Fülle an Optionen und Parametern, die ansonsten oft einschüchternd wirkt, wurde bewusst reduziert auf das Wesentliche. Dies macht es auch weniger erfahrenen Nutzern möglich, schnell produktiv mit LLMs zu arbeiten. Der Trend zur Automatisierung im Bereich der KI-gestützten Sprachverarbeitung wird durch die Entwicklung von Schnittstellen wie Very Simple LLM deutlich beschleunigt. Anwendungen können mittlerweile nahezu in Echtzeit komplexe Daten aus unstrukturiertem Text gewinnen und diese für unternehmerische Zwecke nutzen.

Die Entwicklung von KI-Tools schreitet zusehends dahin, die Lernkurve flach zu halten und Interaktionen intuitiv zu gestalten. Very Simple LLM ist ein Paradebeispiel für diesen Paradigmenwechsel. Zusammenfassend lässt sich sagen, dass Very Simple LLM nicht nur eine API ist, sondern ein praktischer Helfer im Alltag von Entwicklern und Unternehmen, die mit großen Sprachmodellen arbeiten wollen. Durch die Vereinfachung der Schnittstelle, die Unterstützung zahlreicher Anbieter und die Fokussierung auf strukturierte, exakt definierte Ergebnisse eröffnet dieses Tool neue Chancen für die schnelle Integration von KI-Lösungen in verschiedenste Anwendungsfelder. In Zukunft ist zu erwarten, dass die Nachfrage nach solchen minimalistischen, dennoch leistungsfähigen Systemen weiter steigen wird.

Die zunehmende Verbreitung von LLMs in Industrie, Forschung und Handel erfordert effiziente und sichere Zugriffsmöglichkeiten – genau an diesem Punkt setzt Very Simple LLM an. Wer auf der Suche nach einer API ist, die den Einstieg in die Welt der Sprach-KI erleichtert, sollte diese Lösung unbedingt näher in Betracht ziehen. Die Kombination aus Komfort, Sicherheit und Flexibilität macht Very Simple LLM zu einem unverzichtbaren Tool im Zeitalter der digitalen Transformation.