Die Welt der Audiokompression hat sich in den letzten Jahrzehnten rasant entwickelt. Klassische Audiocodecs wie MP3 und Ogg Vorbis sind heute fester Bestandteil unseres digitalen Alltags, sei es beim Streaming von Musik, bei Telefonanrufen oder bei der Speicherung zahlreicher Audioinhalte. Doch trotz ihrer weiten Verbreitung verfolgen viele dieser Technologien ein ähnliches Prinzip: sie zerlegen Audio in vorgegeben große Abschnitte, sogenannte Frames, die anschließend komprimiert werden. Diese Methode, bekannt als Block-Coding, hat zwar den Vorteil, qualitativ hochwertige und effiziente Reproduktionen zu liefern, bringt aber auch eine Einschränkung mit sich. Die daraus resultierende kodierte Darstellung ist meist wenig intuitiv und schwer direkt interpretierbar.

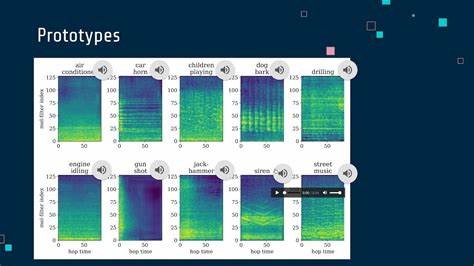

Hier setzt die aktuelle Forschungsarbeit „Toward a Sparse and Interpretable Audio Codec“ an und bietet spannende neue Perspektiven auf den Bereich der Audiokompression. Anders als herkömmliche Codecs versucht der vorgestellte Prototyp-Audiocodec, Audio durch eine sparse Menge von Ereignissen und deren zeitliche Winkelpunkte darzustellen. Diese Ereignisse sind physikalisch motiviert und basieren auf Annahmen über die Angriffssignale von Instrumenten und die Resonanzeigenschaften sowohl des Instruments selbst als auch des Aufführungsraumes. Die Idee dahinter ist, eine möglichst sparsame, nachvollziehbare und effiziente Repräsentation des Klanges zu erzeugen, die darüber hinaus transparente Einblicke in die Klangstruktur erlaubt. Die traditionelle Audiokompression fokussiert sich meist darauf, Daten auf bitgenaue Weise zu reduzieren, ohne dass der zugrundeliegende Klangprozess in der kodierten Form erkennbar ist.

Das bedeutet, dass der Nutzer oder Entwickler kaum erkennen kann, wie konkret der Klang strukturiert oder aufgebaut ist. Diese „Blackbox” Natur moderner Codecs erschwert nicht nur das Verständnis, sondern auch mögliche Anwendungsszenarien, in denen ein bewusstes Eingreifen in die Klangparameter gewünscht ist. Dies ist besonders in Bereichen relevant, in denen Audio nicht nur einfach abgespielt, sondern auch manipuliert, analysiert oder durch künstliche Intelligenz weiterverarbeitet werden soll. Beispiele reichen von automatischer Musikerkennung über Klangsynthetisierung bis hin zu fortschrittlichen Audioeffekten oder der Erstellung von realistischeren virtuellen Akustiken. Der Ansatz des sparsamen und interpretierbaren Audiocodecs leitet sich aus einer Hypothese ab, die in der Physik der Klangentstehung verwurzelt ist.

Ein Musikinstrument erzeugt Klangereignisse, die als Angriffe (Attack) beginnen, mit charakteristischen Schwingungen, die von den akustischen Eigenschaften des Instruments und seiner Umgebung geprägt sind. Indem diese physikalischen Faktoren bei der Kodierung berücksichtigt werden, entsteht eine abstrakte, aber dennoch aussagekräftige Klangbeschreibung, die aus einzelnen Klangereignissen mit ihren exakten Zeitpunkten besteht. Diese Methode trägt dazu bei, die Anzahl der zu speichernden oder zu übertragenden Daten drastisch zu verringern, da im Gegensatz zum klassischen Frame-basierten Codec nur relevante Ereignisse kodiert werden. Neben der Datenreduktion bringt diese Event-basierte Darstellung auch eine deutliche Verbesserung der Interpretierbarkeit mit sich. Entwickler, Audiotechniker oder Forscher können anhand der kodierten Audioereignisse nachvollziehen, welche Töne wann erklingen, wie sich die Resonanzzeiten ändern und wie Raumeigenschaften den Klang beeinflussen.

Dies eröffnet interessante Perspektiven für die Forschung, beispielsweise im Bereich der akustischen Raumvisualisierung oder der automatisierten Klangbearbeitung. Ein weiterer Vorteil eines sparsamen Audiocodecs liegt in der möglichen Energieeffizienz. Gerade mobile Geräte oder eingebettete Systeme profitieren enorm, wenn Audiokompression intelligenter und zugleich ressourcenschonender gestaltet wird. Die Rechenleistung kann reduziert und die Batterielaufzeit verlängert werden, ohne dass der Nutzer Qualitätseinbußen merkt. Dies ist insbesondere für Anwendungen wie drahtlose Kopfhörer, Smart Speaker oder tragbare Aufnahmegeräte relevant.

Die Idee, physikbasierte Modelle in die Audiokompression einzubringen, ist Teil eines größeren Trends in der Audio- und Signalverarbeitung. Künstliche Intelligenz und Machine Learning ermöglichen es heute, komplexe Zusammenhänge im Klang zu erfassen und zu verarbeiten. Doch während viele neuronale Codecs darauf abzielen, die bestmögliche Klangqualität zu erreichen, bleibt oft unklar, wie die einzelnen Klangbestandteile kodiert und interpretiert werden. Durch die Verbindung von physikalischem Verständnis und sparsamer Event-Kodierung könnte ein neuer Weg aufgezeigt werden, der beides liefert: High-Fidelity-Klang und transparente, kontrollierbare Repräsentationen. Das Konzept eines sparsamen und interpretierbaren Audiocodecs steht allerdings noch am Anfang seiner Entwicklung.

Aktuelle Implementierungen dienen eher als Proof-of-Concept und müssen in vielen Bereichen verbessert werden, um mit etablierten Codecs in puncto Qualität, Robustheit und Kompatibilität mithalten zu können. Forschung ist nötig, um die Modellierung der Instrumente und Raumakustik weiter zu verfeinern, ebenso wie die Algorithmen, die aus dem kontinuierlichen Audioeingang die relevanten Ereignisse extrahieren. Auch in puncto Echtzeitfähigkeit und Skalierbarkeit gibt es Herausforderungen, die adressiert werden müssen. Die Kombination von sparsamer Repräsentation und Interpretierbarkeit könnte in Zukunft nicht nur in der Audiokompression, sondern auch in verwandten Bereichen wie der Musikproduktion, Audiotranskription oder sogar in neuen Formen der Interaktion mit Sound Anwendung finden. Denkbar sind beispielsweise Werkzeuge, die es Musizierenden erlauben, Klangparameter direkt aus der komprimierten Form zu manipulieren, oder Systeme, die Umgebungsgeräusche in Smart Homes intelligenter analysieren und darauf reagieren.

Die Entwicklung intelligenter Audiocodecs, die den Klang nicht nur effizient speichern, sondern auch verständlich „erzählen“ können, markiert somit einen spannenden Schritt in Richtung einer neuen Generation von Audio-Technologien. Eine Technologie, die sowohl Optimierung in der Kompression als auch eine neue Tiefe im Umgang mit Klang verbindet. Für Endanwender bedeutet dies zukünftig bessere Klangqualität bei geringerer Datenmenge und neue kreative Möglichkeiten in der Klanggestaltung. Für Unternehmen und Entwicklern eröffnen sich Chancen durch effizientere Systeme und innovativere Anwendungen. Die Forschung rund um sparsamen und interpretierbaren Audiocodecs lädt dazu ein, traditionelles Audioverständnis neu zu denken und die Brücke zwischen Technik, Physik und Kunstbau neu zu schlagen.

Die Vision ist ein Audioformat, das wie nie zuvor den Prozess des Klangmachens und Hörens abbildet und somit die Tür zu einer neuen Ära der Audiotechnologie öffnet.