In der dynamischen Welt des Internets sind Informationen jederzeit und schnell verfügbar. Suchmaschinen wie Google genießen dabei hohes Vertrauen, wenn es um die Authentizität und Genauigkeit der angezeigten Inhalte geht. Doch eine aktuelle Entwicklung wirft zunehmend Schatten auf dieses Vertrauen: Künstlich generierte YouTube-Kanäle, die mittels AI-Technologien Videos über Motorräder erstellen, die es in Wirklichkeit nicht gibt, werden zur Quelle von Fehlinformationen – und Google scheint darauf hereinzufallen. Das führt dazu, dass Nutzern Suchergebnisse präsentiert werden, die nicht nur falsch, sondern schlichtweg erfunden sind. Diese Entwicklung hat weitreichende Konsequenzen für die gesamte Motorradbranche, Interessenten und die digitalen Ökosysteme im Internet.

Wie genau diese Fehlinformationen entstehen, warum sie sich ausbreiten und welche Folgen daraus resultieren, soll im Folgenden detailliert beleuchtet werden. Die Rolle von AI-Generierten YouTube-Kanälen Für viele Menschen sind YouTube-Videos eine wichtige Quelle, um sich über Neuerscheinungen im Motorradmarkt zu informieren. Dabei erfreuen sich Kanäle großer Beliebtheit, die ausführliche Reviews, technische Details und Neuigkeiten präsentieren. In den letzten Jahren setzt sich jedoch eine neue Art von YouTube-Kanälen durch, die ausschließlich mit Hilfe von künstlicher Intelligenz Inhalt generieren. Diese Kanäle produzieren automatisch Videos, in denen mit einer synthetischen Stimme vermeintliche Fakten zu Motorrädern präsentiert werden, die auf KI-generierten Bildern basieren.

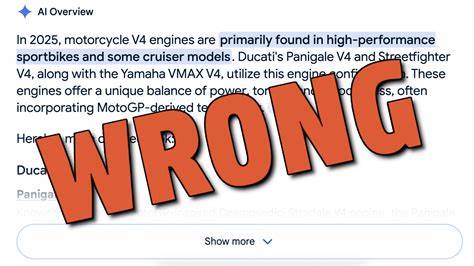

Die Videos wirken teilweise täuschend echt, zeichnen sich aber durch die häufige Verwendung von falschen Bezeichnungen, unlogischen technischen Daten und komplett erfundenen Modellen aus. Ein besonders eklatantes Beispiel ist die Behauptung, dass Yamaha den VMAX-Motorradtyp wiederbelebt habe und das Modell im Jahr 2025 erhältlich sei. Tatsächlich wurde die Produktion des VMAX bereits im Jahr 2020 eingestellt und es gibt keine Hinweise auf eine Wiederaufnahme. Doch diese Falschmeldung zirkuliert durch KI-Kanäle mit einer erstaunlichen Geschwindigkeit und beeinflusst sogar die Suchergebnisse auf Google. Die Illusion von Realität – Warum Google die Falschaussagen übernimmt Das Herzstück des Problems ist die Art und Weise, wie Suchmaschinen heute Inhalte bewerten und indexieren.

Google und andere Suchplattformen arbeiten mit komplexen Algorithmen, die unter anderem die Auffindbarkeit neuer Inhalte, deren Popularität und verknüpfte Quellen berücksichtigen. Wenn ein Video oder ein Beitrag über einen bestimmten Begriff häufig erscheint und in unterschiedlichen Kontexten verlinkt oder zitiert wird, steigt seine Sichtbarkeit. Die KI-gegenerierten Inhalte auf YouTube nutzen genau diesen Mechanismus aus. Indem sie ständig neue Videos zu vermeintlichen Motorrädern veröffentlichen, steigern sie die Relevanz dieser Begriffe, ohne dass eine echte Grundlage im realen Markt liegt. Die KI-Systeme hinter Googles Suchalgorithmus sind darauf ausgelegt, Zusammenhänge sprachlicher Muster und Begriffshäufigkeiten zu erkennen.

Sie besitzen jedoch keine echte „Verständnisfähigkeit“ oder die Fähigkeit, Fakten von Fiktion zu unterscheiden. Da die KI-YouTube-Videos scheinbar konsistente Informationen liefern und von Algorithmen als relevante Inhalte erkannt werden, tauchen die erfundenen Motorräder plötzlich in den Suchergebnissen auf. Diese Entwicklung ist eine neue Dimension des sogenannten „AI Slop“, bei dem maschinell generierte Inhalte die Wahrnehmung verzerren. Auswirkungen auf die Motorrad-Community und den Markt Für Motorradfans und potenzielle Käufer sind diese irreführenden Informationen problematisch. Wer sich etwa zum Kauf eines neuen Motorrads oder zur technischen Ausstattung informieren möchte, findet mitunter ausschließlich diese irrealen Läuterungen, die existierende Modelle mit nicht vorhandenen Features vermischen oder komplett fiktive Maschinen vorstellen.

Solche Fehlinformationen können die Kaufentscheidung verzerren, zu Frustration führen und das Vertrauen in etablierte Informationsquellen untergraben. Auch Händler und Hersteller sind betroffen. Wenn Kunden aufgrund falscher Informationen Produkte verlangen, die es nicht gibt, wirkt sich das direkt auf den Verkaufsprozess aus und kann Ressourcen binden, die eigentlich sinnvoller genutzt wären. Darüber hinaus leidet das Image der Branche, wenn verlässliche Informationen zunehmend von „AI Slop“ überlagert werden, der keine klare Verantwortlichkeit hat. Künftige Herausforderungen für Suchmaschinen und Content Plattformen Die Problematik spiegelt den generellen Wandel im Internet wider, der mit der Automatisierung von Inhaltserstellungen einhergeht.

Während Künstliche Intelligenz viele positive Anwendungen bietet, steht sie auch vor der Herausforderung, zwischen glaubwürdigen Fakten und falschen Informationen zu differenzieren. Für Suchmaschinen bedeutet das, ihre Systeme weiter zu optimieren und geeignete Filtermechanismen zu entwickeln, die nicht nur die Frequenz und Verbreitung von Inhalten bewerten, sondern auch deren Verlässlichkeit und Herkunft kritisch prüfen. Plattformen wie YouTube stehen in der Verantwortung, die Verbreitung von KI-generiertem Unsinn zu begrenzen. Dazu gehört eine bessere Kennzeichnung solcher Inhalte, strengere Qualitätskontrollen und gegebenenfalls das Entfernen von besonders irreführenden Videos. Nur so kann das Vertrauen der Nutzer in die Inhalte zurückgewonnen werden.

Wie Nutzer mit der Situation umgehen sollten Trotz der Komplexität der technischen Herausforderungen sind auch Nutzer gefragt, kritisch mit den gefundenen Informationen umzugehen. Gerade bei Themen mit starker technischer oder spekulativer Komponente ist es ratsam, Daten aus mehreren Quellen zu überprüfen und auf offizielle Herstellerseiten oder renommierte Fachpublikationen zurückzugreifen. Für jede Information, die aus neuen oder unbekannten YouTube-Kanälen stammt, sollte auch der Wahrheitsgehalt hinterfragt werden. Die kritische Medienkompetenz wird in einer Welt, in der KI-gesteuerte Inhalte zunehmend Alltagsrealität werden, zu einer immer wichtigeren Fähigkeit. Fazit Die Verbreitung von KI-generierten Inhalten auf YouTube-Kanälen, die über nicht existierende Motorräder berichten, ist ein deutlicher Hinweis auf die Herausforderungen im Umgang mit maschinell erstellten Medieninhalten.

Dass solche Videos sogar die Suchergebnisse von Google beeinflussen, verdeutlicht die Notwendigkeit, sowohl technologische als auch gesellschaftliche Antworten auf neues „AI Slop“ zu finden. Für die Motorrad-Community bedeutet das eine erhöhte Wachsamkeit bei der Informationsbeschaffung und ein kritisches Hinterfragen von Quellen. Gleichzeitig müssen Suchmaschinen und Plattformbetreiber das Problem stärker in den Blick nehmen und innovative Lösungen entwickeln, um die Qualität und Wahrhaftigkeit der Online-Informationen langfristig sicherzustellen. Nur so kann die Integrität des digitalen Ökosystems gewahrt bleiben und Nutzer nachhaltig vor irreführenden Inhalten geschützt werden.