Die rasante Entwicklung von Künstlicher Intelligenz (KI) und speziell von KI-Chatbots hat den digitalen Alltag erheblich verändert. Diese intelligenten Systeme unterstützen Nutzer bei einer Vielzahl von Aufgaben, angefangen bei der simplen Informationssuche bis hin zur Steuerung komplexer Prozesse. Mit der Integration solcher Chatbots in Finanzanwendungen und Krypto-Plattformen hat jedoch eine neue und hochgefährliche Angriffsmethode an Bedeutung gewonnen, bei der Angreifer falsche Erinnerungen in den KI-Systemen verankern, um Kryptowährungen zu stehlen. Diese neuartige Gefahr hat das Potenzial, die Cybersecurity im Bereich digitaler Währungen nachhaltig zu verändern, da sie auf eine bislang wenig beachtete Schwachstelle in KI-Systemen abzielt. Die Grundlage dieser Attacke liegt in der Manipulation des sogenannten Gedächtnisses von KI-Chatbots.

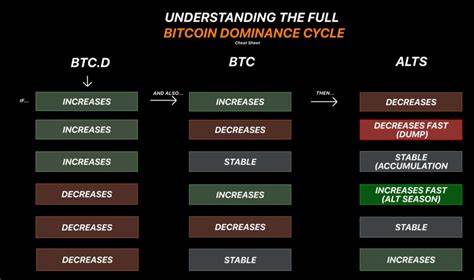

Viele moderne KI-Systeme verfügen über eine Fähigkeit zum „Merken“ bestimmter Informationen – sei es, um im Benutzerkontext sinnvoller zu reagieren oder wiederkehrende Aufgaben zu erleichtern. Indem Angreifer falsche und manipulierte Informationen in diesen Speicher einschleusen, können sie das Verhalten des Chatbots so beeinflussen, dass dieser fehlerhafte oder gezielt manipulierte Antworten liefert. Im Fall von Kryptowährungen hat das erhebliche Folgen: Der Bot könnte beispielsweise falsche Transaktionsanweisungen geben, Sicherheitswarnungen ignorieren oder die Nutzer zu betrügerischen Wallets oder Phishing-Seiten leiten. Das Besondere an diesem Angriff ist die Subtilität und den langen Atem, den er erfordert. Diese manipulierten Erinnerungen sind oftmals schwer zu entdecken, da der Nutzer dem Chatbot vertraut und in der Regel von dessen Kompetenz ausgeht.

Die falschen Informationen sind zudem oft so formuliert, dass sie plausibel wirken und lediglich kleine, scheinbar unbedeutende Änderungen im Verhalten des Systems bewirken, die im Einzelnen oft nicht auffallen. Durch diese Verschleierung können Cyberkriminelle langfristig Zugriffe auf Wallets erhalten oder Transferaufträge hinter den Kulissen ändern. Die Attacke beginnt meist mit dem gezielten Ansprechen des Chatbots bei häufig genutzten Finanzdiensten oder Krypto-Plattformen. Angreifer nutzen Schwachstellen bei der Datenverarbeitung oder im Validierungsprozess, um falsche Datensätze einzuschleusen, die dann vom Bot abspeichert werden. Durch dieses nachhaltige „Einprägen“ falscher Erinnerungen setzt sich die Manipulation fest, was zu einem gefährlichen Vertrauensbruch in die kommunikativen Fähigkeiten des Systems führt.

Diese Entwicklung stellt auch eine Herausforderung für die Hersteller und Anbieter von KI-Systemen dar. Sie müssen nun verstärkt Mechanismen zur Erkennung und Verhinderung solcher Speicher-Manipulationen implementieren. Dazu zählen verbesserte Sicherheitsprotokolle, die Validierung aller eingehenden Informationen sowie regelmäßige Überprüfungen des gespeicherten Kontextes. Darüber hinaus ist es nötig, bei der Entwicklung von Chatbots das Prinzip der minimalen Speicherung zu verfolgen, um das Risiko zu verringern, dass veraltete oder manipulierte Daten das Verhalten negativ verändern. Für die Nutzer bedeutet die Bedrohung, dass sie wachsam bleiben müssen.

Vertrauenswürdige Plattformen ohne Schwachstellen sind ebenso wichtig wie ein Bewusstsein für die Gefahr manipulierter Chatbot-Antworten. Im Umgang mit Krypto-Transaktionen sollte stets eine doppelte Verifikation externer Links und Wallet-Adressen erfolgen. Misstrauen gegenüber unerwarteten Aufforderungen des Chatbots, insbesondere im Finanzbereich, kann helfen, Angriffe frühzeitig zu erkennen. Zusätzlich sind regelmäßige Updates der genutzten Software essenziell, da viele Hersteller kontinuierlich an der Verbesserung ihrer Sicherheitsarchitektur arbeiten und neue Schutzfunktionen implementieren. Experten betonen, dass diese neue Angriffsmethode ein Weckruf für die gesamte Branche sein muss.

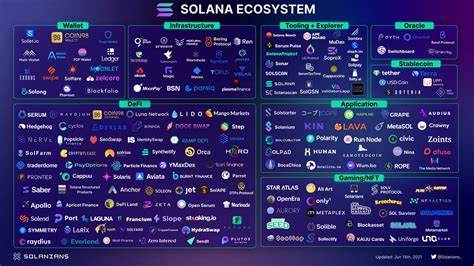

Die Verbindung von KI-Technologie und Kryptowährungen wird weiter an Bedeutung gewinnen, und ohne angemessene Sicherheit kann das Vertrauen in diese Systeme erschüttert werden. Die Integration von Künstlicher Intelligenz in Finanzanwendungen bietet zwar enorme Chancen, doch sie erfordert auch ein Umdenken im Hinblick auf Sicherheitskonzepte. Letztlich zeigt sich, dass die Sicherheit nicht allein auf technischer Ebene gelöst werden kann, sondern auch den Anwendern höhere Aufmerksamkeit abverlangt. Das Bewusstsein für mögliche Manipulationen und konsequentes Handeln bei Verdachtsmomenten sind Schlüssel zur Abwehr solcher ausgefeilter Cyberangriffe. Abschließend lässt sich festhalten, dass die Kombination aus KI-Chatbots und Kryptowährungen eine spannende, aber auch komplexe Zukunft darstellt.

Die Gefahr, dass falsche Erinnerungen in Chatbots eingebracht werden, stellt eine neue Dimension bei Cyberbedrohungen dar und sollte keinesfalls unterschätzt werden. Durch gut durchdachte Sicherheitsstrategien, Wachsamkeit und regelmäßige Schulung der Nutzer kann der Schaden minimiert und das Vertrauen in diese zukunftsweisenden Technologien erhalten bleiben. Die fortschreitende Technologie muss stets mit entsprechenden Schutzmechanismen einhergehen, um ein sicheres und zuverlässiges digitales Finanzumfeld zu gewährleisten.