In der digitalen Ära, in der künstliche Intelligenz (KI) rasant an Bedeutung gewinnt, verwandelt sich auch die Welt des Buchmarktes grundlegend. Insbesondere auf großen Plattformen wie Amazon tauchen vermehrt Bücher auf, die nicht von Menschen, sondern von KI-Systemen verfasst wurden. Während diese Technologie viele Chancen bringt, machen Experten zunehmend auf bedenkliche Entwicklungen aufmerksam, insbesondere wenn es um sensible Gesundheitsthemen wie Aufmerksamkeitsdefizit-Hyperaktivitätsstörung, kurz ADHS, geht. Ein alarmierender Trend sind Bücher über ADHS, die scheinbar von Chatbots oder anderen generativen KI-Modellen geschrieben wurden und trotz fehlender Fachkompetenz als vertrauenswürdige Ratgeber vermarktet werden. Diese Werke können nicht nur Fehlinformationen verbreiten, sondern im schlimmsten Fall gesundheitliche Schäden verursachen.

ADHS ist eine komplexe neurologische Entwicklungsstörung, die sich typischerweise in Kindheit oder Jugend manifestiert, aber auch im Erwachsenenalter bestehen bleibt und vielfältige Auswirkungen auf das tägliche Leben haben kann. Die Suche nach verlässlichen Hilfsmitteln und Ressourcen ist daher für Betroffene von großer Bedeutung. In diesem sensiblen Bereich ist es unverzichtbar, auf qualifizierte Fachliteratur und professionelle Beratung zurückzugreifen. Die Problematik zeigt sich besonders deutlich bei den Büchern, die auf Amazon angeboten werden – einer Plattform, die für ihre große Reichweite bekannt ist und von Menschen weltweit als zuverlässige Quelle für Wissen gilt. Untersuchungen von ausgewählten Büchern über ADHS, die auf Amazon verfügbar sind, haben ergeben, dass viele dieser Publikationen mit extrem hoher Wahrscheinlichkeit von KI-Systemen erstellt wurden.

Ein amerikanisches Unternehmen, Originality.ai, das auf der Erkennung von KI-generierten Texten spezialisiert ist, analysierte mehrere Titel und stellte bei allen eine 100-prozentige Übereinstimmung mit KI-Texten fest. Dies bedeutet, dass die Bücher nicht von Menschen geschrieben, sondern programmiert wurden. Die Autorenbilder wirken oft künstlich generiert, während Aussagen über ADHS teils ungenau, widersprüchlich oder sogar schädlich sein können. Derartige Veröffentlichungen besitzen zwar beeindruckende Titel wie „Navigating ADHD in Men: Thriving with a Late Diagnosis“ oder „Men with Adult ADHD: Highly Effective Techniques for Mastering Focus, Time Management and Overcoming Anxiety“, die gezielt eine bestimmte Zielgruppe ansprechen.

Doch bei genauer Lektüre offenbaren sich Mängel in der inhaltlichen Qualität. Von fehlendem wissenschaftlichen Fundament über falsche historische Angaben bis hin zu problematischen Aussagen, die Patienten eher verunsichern als helfen, reicht die Palette der Kritik. Zum Beispiel enthalten einige Passagen gefährliche Ratschläge, die emotionale Schwierigkeiten bagatellisieren oder Betroffene und ihr Umfeld unnötig belasten können. Oft fehlt jeglicher Nachweis über die Qualifikation des vermeintlichen Autors. Diese Situation ist nicht nur für Einzelpersonen ärgerlich, sondern stellt ein systemisches Problem dar.

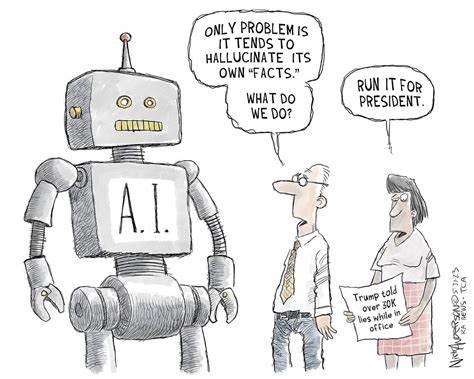

Der Online-Buchmarkt wirkt wie ein „wilder Westen“, in dem weniger Qualität oder Verlässlichkeit zählen als einfache Verfügbarkeit und niedrige Produktionskosten. Es gibt bislang keine verbindlichen Regulierungen, die sicherstellen, dass KI-generierte Inhalte, besonders in sensiblen Bereichen wie Gesundheit, korrekt gekennzeichnet und sorgsam überprüft werden. Der rechtliche Rahmen ist unzureichend, und bestehende Copyright-Gesetze greifen nur bedingt, weil sie hauptsächlich das Kopieren von existierendem Material regulieren. Experten warnen vor den Risiken, die von solchen KI-Büchern ausgehen. Michael Cook, ein renommierter Informatiker von King's College London, hebt hervor, dass generative KI nicht nur auf wissenschaftlicher, sondern auch auf pseudowissenschaftlicher oder fiktiver Literatur trainiert wurde.

Das führt dazu, dass sie Fehlinformationen verbreiten kann, die von gefährlichen Ratschlägen zu giftigen Substanzen bis zum Ignorieren medizinischer Leitlinien reichen. Fehlende Fähigkeit, kritisch zu denken oder komplexe Informationen richtig zu interpretieren, macht KI als Autor ungeeignet für medizinische Inhalte ohne menschliche Kontrolle. Auch die wirtschaftlichen Anreize hinter solchen Büchern sind kritisch zu betrachten. Amazon verdient an jedem verkauften Buch, ungeachtet dessen, ob der Inhalt korrekt ist oder nicht. Während die KI-Unternehmen für ihre technologischen Produkte nicht haften, profitiert der Marktplatz vom Verkauf.

Diese Dynamik fördert eine Art „Rennen nach unten“, bei dem Quantität über Qualität gestellt wird. Die traditionelle Verlagswelt, die früher durch strenge Vettings, Vertragsprüfungen und Qualitätskontrollen geschützt war, gerät durch die Demokratisierung der Veröffentlichungsmöglichkeiten unter Druck. Die ethische Verantwortung der Plattformen wird ebenfalls thematisiert. Professor Shannon Vallor von der Universität Edinburgh betont, dass Unternehmen wie Amazon verpflichtet sind, Schaden zu verhindern. Zwar sei es unrealistisch, dass ein Händler für alle Inhalte auf seiner Plattform haftet, doch sollte es klare Standards und eine aktive Überwachung geben, um gefährliche Falschinformationen einzudämmen.

Der aktuell fehlende Rechtsrahmen fördert indes die Verbreitung von problematischen Werken, da es kaum Konsequenzen für Anbieter gibt, die durch Profitgier Risiken eingehen. Parallel dazu fordert die Werbeaufsichtsbehörde, dass KI-verfasste Bücher nicht so beworben werden dürfen, als stammten sie von Experten oder Menschen. Hierdurch soll vermieden werden, dass Verbraucher durch irreführende Marketingmaßnahmen getäuscht werden. Die Möglichkeit, Beschwerden einzureichen, bietet einen gewissen Schutz, reicht aber bei Weitem nicht aus, um das Problem grundlegend zu lösen. Vom persönlichen Schicksal her betrachtet trifft die Situation laut Berichten von Käuferinnen und Käufern auf erschütternde Weise.

Ein Beispiel dafür ist Richard Wordsworth, der sich nach einer späten ADHS-Diagnose über ein Buch informieren wollte, das ihm sein Vater auf Amazon empfohlen hatte. Schon nach wenigen Seiten fiel ihm auf, dass der Inhalt merkwürdig wirkte: Es gab skurrile Zitate, anekdotische Geschichten und falsche historische Angaben. Einige Abschnitte entbehrten jeglicher fundierter Basis und beinhalteten sogar Warnungen, die psychischen Schaden unnötig schlimmer zu machen schienen. Die Entdeckung, dass das Autorenbild vermutlich KI-generiert war und keine Qualifikationen genannt wurden, verstärkte seine Verunsicherung. Er fand zudem weitere Werke mit alarmierenden und unverantwortlichen Behauptungen über ADHS, die bei Betroffenen Ängste schürten.

Die Erfahrung bereitet ihm und seiner Familie großen Kummer – denn wenn gut gebildete Menschen dadurch verunsichert werden, spricht das für das hohe Risiko, das uninformierte und verzweifelte Personen eingehen. Amazon selbst erklärte gegenüber Medien, dass man klare Inhaltsrichtlinien habe und sowohl proaktive als auch reaktive Maßnahmen einsetze, um nicht regelkonforme Inhalte zu erkennen und zu entfernen. Die Plattform verspricht, seine Schutzmechanismen weiter zu verbessern und das Vorgehen an neue Herausforderungen anzupassen. Dennoch scheint es momentan nicht ausreichend, um den Massenanstieg von KI-generierten, oft fragwürdigen Büchern zu verhindern. Das Thema gewinnt zunehmend an Bedeutung, weil die Nutzer immer mehr auf digitale Ressourcen zurückgreifen, um ihre Gesundheit besser zu verstehen und zu managen.

Gerade bei psychischen und neurologischen Erkrankungen wie ADHS ist die Qualität der Informationen essenziell. Falsche oder irreführende Inhalte können nicht nur das Vertrauen in die Behandlung erschüttern, sondern auch gesundheitliche Verschlechterungen und Fehldiagnosen verursachen. Die Verlockung, schnelle und scheinbar günstige Hilfe zu finden, macht Betroffene und ihre Angehörigen besonders anfällig für dubiose Angebote. Insgesamt stellt die Verbreitung von KI-generierten Büchern über ADHS auf Online-Marktplätzen wie Amazon ein Alarmsignal dar, das nicht nur Verbraucher, sondern auch Politik, Rechtsprechung und Technologiebranche betrifft. Es braucht dringend ein Zusammenspiel aus gesetzlichen Vorgaben, ethischen Leitlinien, technischer Kontrolle und informierter Öffentlichkeit, um die Verheerungen, die durch gefährliche Fehlinformationen entstehen können, zumindest einzudämmen.

Ein bewusster und kritischer Umgang mit KI-Inhalten sowie die Stärkung von glaubwürdigen Fachquellen sind entscheidend, um informierte Entscheidungen und eine verantwortungsvolle Nutzung von digitalen Medien für Gesundheitsinformationen zu gewährleisten.

![Bitcoin's Op_return War II: Code Change Could Break Bitcoin Forever? [video]](/images/0748A6F8-5E73-419C-AFC1-E5E1913BD97C)