In der heutigen digitalen Ära sind biometrische Technologien immer stärker auf dem Vormarsch. Insbesondere Gesichtsscanner erfreuen sich zunehmender Beliebtheit als Methode zur Identitätsverifikation und zur Unterscheidung von Menschen und Maschinen. Sam Altman, ein bekannter Unternehmer und Investor im Technologie-Sektor, hat ein Projekt namens Orb unterstützt, welches genau diese Vision verfolgt: Menschen durch eine innovative Gesichtserkennungstechnologie eindeutig zu identifizieren. Doch trotz der Fortschritte in diesem Bereich können solche Technologien immer noch scheitern. Ich habe den Orb-Gesichtsscanner selbst ausprobiert und war überrascht, dass das System meine Menschlichkeit nicht verifizieren konnte – ein Ergebnis, das Fragen aufwirft und zum Nachdenken anregt.

\n\nGesichtserkennungstechnologien haben in den letzten Jahren eine rasante Entwicklung durchlaufen. Ursprünglich aus der Sicherheits- und Überwachungstechnik stammend, werden sie heute in unzähligen Anwendungen verwendet – von Smartphones über Flughäfen bis hin zum Online-Banking. Orb positioniert sich als besonders fortschrittliches Tool in diesem Umfeld, welches nicht nur Gesichter erkennt, sondern auch automatisiert zwischen echten Menschen und potenziellen KI- oder Bot-Täuschungsversuchen unterscheidet. Der Kern dieses Systems basiert auf ausgefeilter Computer Vision und künstlicher Intelligenz, die subtile Merkmale im Gesicht und in der Mimik analysieren.\n\nMein erster Kontakt mit Orb begann mit hohen Erwartungen.

Als jemand, der technologische Neuerungen schätzt und häufig nutzt, war ich neugierig, wie gut ein Gesichtsscanner in der Praxis funktioniert – besonders angesichts der Tatsache, dass das Projekt von Sam Altman unterstützt wird, der als Vorreiter im KI-Bereich bekannt ist. Der Scan selbst gestaltete sich einfach. Das System forderte mich auf, das Gesicht in verschiedenen Positionen vor die Kamera zu halten, um eine umfassende Analyse durchzuführen. Dabei wurden nicht nur statische Attribute betrachtet, sondern auch dynamische Reaktionen und winzige Veränderungen im Ausdruck.\n\nDoch das Ergebnis war ernüchternd: Der Orb-Scanner konnte mich nicht als Menschen verifizieren.

Dies wirft mehrere Fragen auf. Liegt das Problem bei mir als Nutzer, bei der Technik oder bei den Grenzen der KI? Möglicherweise interpretiert das System die von mir gezeigten Bewegungen und Merkmale als ungewöhnlich oder untypisch für einen Menschen, was zu einer automatischen Ablehnung führt. Dieses Szenario zeigt auf, wie sensibel und komplex Gesichtserkennungssysteme sein können.\n\nEin wichtiger Aspekt bei biometrischen Systemen ist die Balance zwischen Sicherheit und Benutzerfreundlichkeit. Während strenge Regeln dafür sorgen sollen, dass keine Fälschungen oder Deepfake-Avatare das System täuschen, kann eine Übervorsichtigkeit zu falschen Negativ-Ergebnissen führen.

Menschen besitzen eine enorme Vielfalt an Gesichtszügen, Emotionen und Bewegungen, die nicht immer einfach von Algorithmen erfasst oder interpretiert werden können. Krankheiten, Belastungen oder sogar Tagesform können die Mimik verändern und somit das Erkennungsergebnis beeinflussen.\n\nMan darf außerdem nicht außer Acht lassen, dass die Technologie selbst noch in der Entwicklung steckt. Trotz des Engagements von führenden Köpfen und namhaften Investoren gibt es bei der automatischen Menschenerkennung eine Vielzahl von Herausforderungen. Die Algorithmen müssen einerseits tolerant gegenüber natürlichen Unterschieden sein, andererseits aber auch fähig sein, Täuschungsversuche mit großer Genauigkeit auszuschließen.

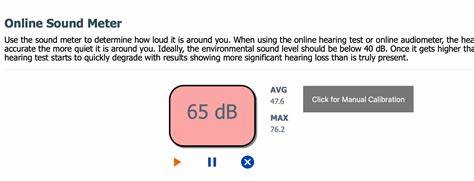

Ein Scheitern in diesem Balanceakt ist nicht ungewöhnlich und zeigt, wie komplex die Aufgabe ist.\n\nIm weiteren Verlauf meiner Recherche stellte sich heraus, dass Orb stark auf hochkomplexe neuronale Netze und echte menschliche Verhaltensmuster setzt, um Fake-Identitäten zu erkennen. Das System analysiert zudem zahlreiche Parameter wie reflektiertes Licht, Hautstruktur und Augenbewegungen. Dennoch können Faktoren wie schlechte Beleuchtung oder technische Ungenauigkeiten zu Fehlinterpretationen führen. In meinem Fall könnten der Standort des Scans oder die Kameratechnik einen Beitrag geleistet haben.

\n\nEin weiterer interessanter Punkt ist die Frage nach Datenschutz und ethischen Aspekten. Gesichtsscanner sammeln extrem persönliche biometrische Daten, deren Missbrauch schwerwiegende Konsequenzen für die Privatsphäre haben könnte. Daher ist es essenziell, dass solche Systeme transparent kommuniziert werden und Nutzer genau wissen, wie ihre Daten verarbeitet und gespeichert werden. Orb hat laut Angaben auf seiner offiziellen Webseite umfangreiche Sicherheitsprotokolle implementiert, doch die Skepsis in der Öffentlichkeit bleibt bestehen.\n\nDie Entwicklung und Verbesserung von Gesichtserkennungstechnologien ist ein kontinuierlicher Prozess mit vielen Versuchen, Irrtümern und Innovationen.

Mein Erlebnis mit dem Orb-Gesichtsscanner zeigt eindrucksvoll, dass selbst modernste Technologien nicht immer perfekt funktionieren. Die Grenzen der künstlichen Intelligenz werden deutlich, wenn es darum geht, menschliches Verhalten vollständig und fehlerfrei zu reproduzieren oder zu erkennen. Gleichzeitig verdeutlicht es, dass wir bei der Einführung solcher Systeme vorsichtig und kritisch sein sollten.\n\nEs bleibt spannend, wie sich Orb und vergleichbare Projekte weiterentwickeln werden. Die Vision, zuverlässige und sichere Gesichtserkennung zu schaffen, ist zweifellos lohnenswert und könnte viele Anwendungsbereiche revolutionieren.

Allerdings muss die Technik noch robuster werden, um nicht nur einzelne, sondern breite Nutzergruppen zuverlässiger zu erkennen. Zudem sollten ethische Richtlinien und Nutzerrechte konstant überwacht und angepasst werden, um Missbrauch zu vermeiden.\n\nAbschließend lässt sich sagen, dass mein Erfahrungsbericht mit dem von Sam Altman unterstützten Orb-Gesichtsscanner ein wertvoller Einblick in die Stärken und Schwächen moderner biometrischer Technologien liefert. Die automatisierte Verifikation der Menschlichkeit ist eine faszinierende, aber zugleich anspruchsvolle Aufgabe, die noch nicht ausgereift ist. Für Nutzer bedeutet das, dass solche Systeme zwar praktische Vorteile bieten können, aber gleichzeitig keine absolute Garantie darstellen und mit Vorsicht betrachtet werden sollten.

Die Zukunft der Gesichtserkennung wird spannend sein, doch sie erfordert Geduld, technische Finesse und verantwortungsvollen Umgang mit sensiblen Daten.