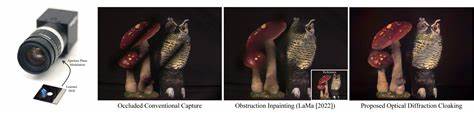

Die Bildaufnahme durch eine Kamera wird oft durch verschiedene Hindernisse direkt vor der Linse beeinträchtigt. Schmutz, Wassertröpfchen, Schrammen auf der Abdeckung oder andere Objekte, die sich nahe der Kamera befinden, können die Bildqualität erheblich reduzieren. Herkömmliche Lösungen setzen meist auf das nachträgliche Ausbessern der Bilder, wie Inpainting oder Softwarekorrekturen, doch diese Methoden können nie das exakt verborgene Detail wiederherstellen, sondern geben hochentwickelte Schätzungen basierend auf dem umgebenden Bildmotiv. Die bahnbrechende Forschung zur diffraktiven Tarnung bringt nun eine neue Ära in der optischen Bildverarbeitung. Das von Wissenschaftlern um Zheng Shi, Yuval Bahat und Felix Heide im Jahr 2022 vorgestellte Konzept ermöglicht es, durch bestimmte optische Elemente störende Nahhindernisse quasi zu umgehen und so einen unverfälschten, direkten Blick auf das dahinterliegende Motiv zu gewinnen.

Statt die fehlenden Bildteile mit Algorithmen erraten zu müssen, ermöglicht die Methode eine physische „Tarnung“ der störenden Objekte an der Kamera selbst. Dieser wissenschaftliche Durchbruch hat das Potenzial, besonders in sicherheitsrelevanten und autonomen Systemen wie im Automobilbereich große Auswirkungen zu entfalten. Fahrzeuge, deren Kameras von Schmutz, Regentropfen oder ähnlichen Verunreinigungen auf der Scheibe betroffen sind, gewinnen dadurch eine deutlich verlässlichere und genauere Wahrnehmung ihrer Umgebung. Zum Hintergrund: Klassische Bildverarbeitungsansätze haben mit solchen Beeinträchtigungen zu kämpfen, da wichtige Informationen verloren gehen können und Algorithmen schlussendlich nur mit Annahmen arbeiten können. In manchen Fällen werden deshalb Kamerasysteme mit mehreren Einzelsensoren verwendet, die aus verschiedenen Blickwinkeln mehrfache Ansichten des Motivs erfassen und so Verdeckungen umgehen – diese Mehrkameraansätze sind jedoch meist kostspielig und deutlich sperriger.

Die Alternative der diffraktiven Tarnung vereint die Vorteile einer einzigen Kamera mit einem neuartigen optischen Zusatz. Im Zentrum steht eine speziell entwickelte, maßgeschneiderte diffraktive optische Komponente, die am Blendenbereich der Kamera angebracht wird. Diese sogenannte Diffraktive Optische Platte (Diffraction Optical Element, DOE) wirkt als Tiefen-abhängiger Streuer und verteilt das Licht, das von nahen Hindernissen ausgeht, über eine ringförmige Punktspreizfunktion. Gleichzeitig bleibt der Fokus für weiter entfernt liegende Objekte, also den eigentlichen Motivbereich, unverändert scharf. Das bedeutet: Das Bild des störenden Objekts wird optisch „verwischt“ und „gestreut“, während das Zielobjekt scharf reflektiert wird.

Ein entscheidender Schritt ist die Kombination dieser optischen Modifikation mit einem tiefen neuronalen Netzwerk, das direkt auf die durch die DOE modifizierten Bilddaten trainiert wird. Diese KI-Rekonstruktionsmethode entschlüsselt die komplex überlagerten Daten effizient und rekonstruiert das Bild der verborgenen Szene mit hoher Qualität und Detailschärfe. Dank dieses Zusammenspiels von präziser optischer Modulation und leistungsfähiger Bildrekonstruktion kann der Anwender auf die störende Oberfläche blicken, als wäre sie verschwunden. Die Forschung wurde sowohl in Simulationen als auch in realen experimentellen Aufbauten validiert. Die Prototypkamera verwendet ein im Photolithographie-Verfahren gefertigtes Diffraktives Element mit 16 Strukturstufen auf einem Quarzglas-Wafer.

Um die Komponente präzise auf der Blendenebene zu positionieren, kommt ein optisches 4F-System zum Einsatz, das die optische Phase exakt auf die richtige Stelle abbildet. Die Messergebnisse zeigen, dass die modifizierte Kamera eine Punktspreizfunktion mit einem kleinen, scharfen Brennfleck bei fernen Objekten und einer großen ringförmigen Struktur bei Objekten in der Nähe realisiert. In der Praxis führt dies zu der Fähigkeit, nahliegende störende Objekte zu „tarnen“, während der Hintergrund vollständig erkennbar bleibt. Die Leistungsfähigkeit der Technologie zeigt sich besonders bei praktischen Betrachtern, wie etwa in Aufnahmen von Tierszenen, bei denen beispielsweise ein Adlerkopf oder feine Strukturdetails wie Blumen und Steine trotz teilweiser Verdeckung durch Wassertröpfchen oder Schmutz erkannt werden können. Im Vergleich zu traditionellen Bildinpaintingsystemen erzielt die diffraktive Tarnung einen Signal-Rausch-Verhältnisgewinn von bis zu 5 Dezibel, was eine signifikante Verbesserung darstellt.

Besonders bemerkenswert ist, dass diese Technologie nicht nur allgemeine „Vorschläge“ zur Bildvervollständigung anbietet, sondern tatsächlich verborgenes Bildmaterial physisch zugänglich macht. Die Anwendungsmöglichkeiten des Verfahrens sind vielfältig. Neben der Nutzung in Fahrzeugkameras kann die Technik auch für tragbare Kameras, Drohnen oder industrielle Inspektionssysteme relevant sein, wo Verdeckung durch Schmutz, Wasser oder andere gefährliche Störungen die Sicht beeinträchtigt. Im medizinischen Bereich wären ebenfalls Anwendungen denkbar, z.B.

für Endoskopie oder andere bildgebende Verfahren, bei denen hindernde Partikel im Sichtfeld problematisch sind. Die Technologie steht damit exemplarisch für den Trend zur nahtlosen Integration von adaptiven optischen Komponenten mit moderner künstlicher Intelligenz – ein Ansatz, der weit über das hinausgeht, was rein softwarebasierte Methoden aktuell leisten können. Es handelt sich keineswegs nur um eine simple „Bildausschnittsverzerrung“, sondern um eine tiefgreifende Veränderung der Bildentstehung, bei der der Optikprozess gezielt manipuliert wird, um eine physische Verdeckungen aufzuheben. Zugleich zeigt dies, wie differenzierbare optische Modelle und datengetriebene neuronale Netzwerke zusammenwachsen, um Bildgebungssysteme mit höheren Fähigkeiten zu entwerfen. Herausforderungen bestehen allerdings weiterhin in der präzisen Herstellung, insbesondere die Beseitigung von Produktionsfehlern, die zu unerwünschten Nullordnungsanteilen in der Streuung führen können und in der robusten Generalisierung des Trainingsnetzes auf unterschiedliche Umgebungsbedingungen.

Insgesamt hebt die Forschung zur diffraktiven Tarnung die Grenzen zwischen Optik und Nachbearbeitung auf und stellt einen Paradigmenwechsel im Design von Kamerasystemen dar. Die Hoffnung besteht, dass solche adaptiven optoelektronischen Systeme zukünftig in Serienprodukten Einzug halten und viele alltägliche Probleme der Bildaufnahme mit störenden Objekten zuverlässig lösen werden. Die Kombination aus innovativer Optik und moderner KI verspricht, die visuelle Wahrnehmung in zahlreichen Anwendungen grundlegend zu verbessern und dadurch neue Möglichkeiten im Umgang mit verdeckten Bildinformationen zu eröffnen. Die Zukunft der Bildaufnahme liegt damit in der Vernetzung von intelligenter Optik und lernfähigen Algorithmen, die gemeinsam das Verborgene sichtbar machen.