Die rasante Entwicklung der Künstlichen Intelligenz hat in den letzten Jahren zu einer weitreichenden Integration von KI-Chatbots in unterschiedlichste Anwendungsgebiete geführt. Besonders im Finanzsektor, wo schnelle und effiziente Kundeninteraktionen von großer Bedeutung sind, spielen solche Systeme eine zunehmend zentrale Rolle. Doch während KI-Chatbots zahlreiche Vorteile bieten, eröffnen sich durch die Komplexität ihrer Funktionsweise auch neue, bislang wenig beachtete Angriffsflächen für Cyberkriminelle. Eine besonders alarmierende Methode ist der sogenannte Angriff durch das Pflanzen falscher Erinnerungen in den KI-Systemen, die im schlimmsten Fall zum Diebstahl von Kryptowährungen führen können. KI-gestützte Chatbots basieren oft auf maschinellem Lernen und speichern Informationen aus Interaktionen, um künftig bessere Antworten zu liefern oder sich an frühere Gespräche zu erinnern.

Genau diese Fähigkeit, Erinnerungen zu speichern und abzurufen, wird von Cyberangreifern ausgenutzt. Dabei wird das System mit falschen, aber glaubwürdig erscheinenden Informationen gefüttert, die das KI-Modell so modifizieren, dass es sensible Daten preisgibt oder falsche Anweisungen ausführt. Beispielsweise kann ein Angreifer so manipulieren, dass der Chatbot einem Nutzer falsche Wallet-Adressen mitteilt, auf die statt der eigentlichen Kryptowährung gezahlt wird. Auf diese Weise entsteht ein perfekter Betrug, da der Nutzer den Anschein hat, korrekt mit der KI zu kommunizieren, während seine digitalen Vermögenswerte in Wirklichkeit gestohlen werden. Die Funktionsweise solcher Angriffe basiert auf der gezielten Manipulation der Trainingsdaten oder der Echtzeit-Interaktionen des Chatbots.

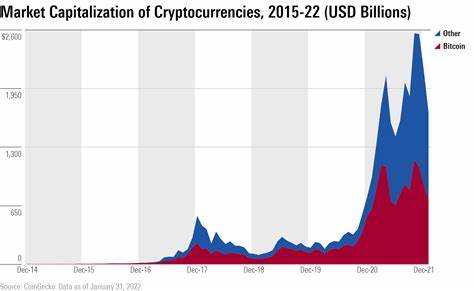

Besonders gefährlich wird es, wenn die KI über die Fähigkeit verfügt, Informationen aus vergangenen Gesprächen zu speichern, sogenannte "Kontextualisierung". So können Angreifer frühere Diskussionen ändern und den Chatbot veranlassen, künftig falsche Informationen zu verwenden. Dies zeigt eindrucksvoll, dass Künstliche Intelligenz nicht nur dann anfällig für Angriffe ist, wenn Sicherheitslücken in der Software bestehen, sondern auch durch gezielte Täuschung innerhalb ihrer eigenen Lernprozesse kompromittiert werden kann. Die Auswirkungen eines solchen Angriffs auf die Kryptowährungsbranche sind erheblich. Kryptowährungen sind nicht zentral reguliert und der Transaktionsprozess ist unwiderruflich.

Das bedeutet, dass bei einer Fehlleitung von Zahlungen an betrügerische Wallets ein Rückholen der Gelder nahezu unmöglich ist, was die Bedeutung sicherer Interaktionen mit KI-gestützten Systemen unterstreicht. Viele Nutzer vertrauen zunehmend auf KI-Chatbots, beispielsweise um Transaktionen zu überprüfen, Kontodaten auszutauschen oder Empfehlungen für Investments einzuholen. Sobald diese Systeme jedoch manipuliert werden können, steigt die Gefahr, dass Nutzer unbemerkt betrogen werden. Ein weiteres Risiko besteht in der Skalierbarkeit eines solchen Angriffs. Da Chatbots oft automatisiert hunderte oder tausende von Nutzern gleichzeitig bedienen, können Angreifer mit einer einzigen Manipulation eine Vielzahl von Opfern erreichen.

Gerade im anonymen und globalen Umfeld von Kryptowährungen stellt dies eine erhebliche Bedrohung dar. Die mangelnde Transparenz der KI-Interaktionen erschwert es zudem, betrügerische Eingriffe rechtzeitig zu erkennen und ihnen entgegenzuwirken. Die Frage, wie man kosistente Sicherheitsmechanismen für KI-basierte Systeme implementiert, ist daher eine der zentralen Herausforderungen für Entwickler und Betreiber in der Krypto- und Finanzbranche. Gegenmaßnahmen erfordern ein anspruchsvolles Zusammenspiel aus technischer Weiterentwicklung, Überwachung und Aufklärung. Entwickler müssen darauf achten, dass KI-Modelle nicht ohne weiteres „erinnerungsfähig“ im Sinne eines dauerhaften Speicherns von Gesprächsinhalten sind, wenn hierdurch Sicherheitsrisiken entstehen.

Ebenso wichtig ist die Implementierung von Mehrfaktor-Verifizierungen, bei denen der Chatbot etwa keine sensiblen Transaktionsdetails weitergeben kann, ohne dass eine eindeutige Authentifizierung vorliegt. Darüber hinaus können Anomalieerkennungssysteme dabei helfen, ungewöhnliche oder verdächtige Antwortmuster zu identifizieren, die auf Manipulationen hindeuten. Für Nutzer ist es essenziell, trotz scheinbarer Bequemlichkeit durch KI-Schnittstellen kritisch zu bleiben. Es sollte niemals ausschließlich auf die Empfehlungen oder Informationen von Chatbots vertraut werden, gerade wenn es um sensible Daten oder Transaktionen mit Kryptowährungen geht. Direkte Kontrollmechanismen, wie das manuelle Überprüfen von Wallet-Adressen oder die Nutzung offizieller Apps und Plattformen, müssen weiterhin beachtet und eingefordert werden.

Ein blindes Vertrauen in automatisierte Systeme birgt gerade im Bereich der digitalen Vermögenswerte ein erhebliches Risiko für finanziellen Verlust. Die Sicherheit der Technologie selbst ist ein weiterer Ansatzpunkt. Die KI-Forschung arbeitet intensiv daran, Algorithmen zu entwickeln, die resistenter gegenüber Täuschungen und Manipulationen sind. Dazu zählen unter anderem Techniken zum Verifizieren der Herkunft und Authentizität von Informationen, die in ein System eingespeist werden, sowie robuste Lernmechanismen, die unplausible oder gefährliche Daten erkennen und herausfiltern können. Solche Fortschritte sind unerlässlich, um langfristig den sicheren Umgang mit KI-gestützten Finanzapplikationen zu gewährleisten.

Weiterhin spielt die verantwortungsvolle Regulierung und Selbstverpflichtung von Unternehmen aus dem Finanz- und Krypto-Sektor eine zentrale Rolle. Regulierungsbehörden und Branchenverbände versetzen sich zunehmend in die Lage, sowohl technische Standards als auch ethische Richtlinien zu definieren, um Manipulationen und Betrug im Umfeld von KI und Kryptowährungen einzudämmen. Ebenso sorgt der offene Austausch über Bedrohungen und Sicherheitslücken für erhöhte Transparenz und schnellen Schutz vor neuen Angriffsmethoden. Abschließend lässt sich festhalten, dass das Pflanzen falscher Erinnerungen in KI-Chatbots eine hochgefährliche neue Angriffsform darstellt, welche die Sicherheit von Kryptowährungen bedroht. Sowohl Entwickler als auch Nutzer müssen sich der damit verbundenen Risiken bewusst sein und gemeinsam daran arbeiten, dass KI-Systeme in Zukunft sicherer, vertrauenswürdiger und widerstandsfähiger gegen Manipulationen werden.

Die Wechselwirkung zwischen innovativer Technologie und kriminellen Herausforderungen erfordert einen stetigen Dialog und kontinuierliche Anpassungen, um die digitale Finanzwelt nachhaltig zu schützen und das Vertrauen in moderne Anwendungen zu erhalten.