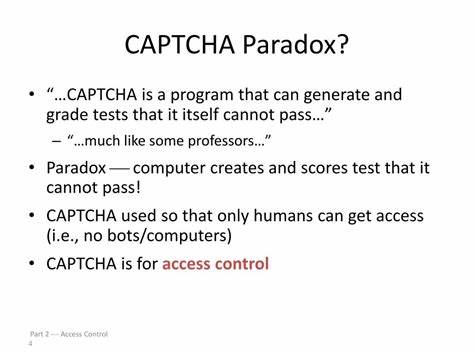

In der heutigen digitalen Welt ist die Interaktion mit Computern und künstlicher Intelligenz längst Alltag geworden. Gleichzeitig nimmt die Komplexität und Leistungsfähigkeit von KI-Systemen rasant zu, was zu einem paradoxen Effekt führt: Die Mechanismen, die ursprünglich entwickelt wurden, um Maschinen vom Zugriff auf digitale Räume auszuschließen, werden für uns Menschen immer schwieriger zu bewältigen. Dieses Phänomen wird als „Captcha-Paradoxon“ bezeichnet. Es stellt eine tiefgreifende Spannung zwischen menschlicher Identität und künstlicher Intelligenz dar und wirft grundlegende Fragen über unsere digitale Zukunft auf. Captchas, ursprünglich konzipiert als einfache Tests zur Abgrenzung von Menschen und Computerprogrammen, haben sich zu einer alltäglichen Hürde entwickelt.

Das Ziel ist klar: Maschinen sollen nicht die Fähigkeit erhalten, sich als Menschen auszugeben und damit beispielsweise Spam zu versenden, betrügerische Aktivitäten durchzuführen oder Identitäten zu fälschen. Doch mit den neuesten Fortschritten in der KI-Forschung lösen immer mehr Maschinen diese Herausforderungen schneller und effektiver als Menschen. Unsere Fähigkeit, verzerrten Text zu entziffern, den richtigen Verkehrsschildern oder Tieren auf unscharfen Bildern zu folgen, wird zunehmend überfordert. Gleichzeitig meistern fortschrittliche multimodale Modelle wie GPT-4 oder Gemini diese Aufgaben mühelos. Diese Entwicklung führt zu einer absurd erscheinenden Situation: Menschen müssen immer komplexere Herausforderungen meistern, um sich als solche zu authentifizieren, während KI-Systeme sie immer leichter überwinden.

Es ist ein moderner Wettlauf zwischen menschlicher Geduld und Maschinenintelligenz, bei dem die Menschen zunehmend ins Hintertreffen geraten. Dieses Paradoxon ist nicht nur eine Ironie des Fortschritts, sondern bildet auch eine strukturelle Widersprüchlichkeit ab. Jahrzehntelang haben wir intelligente Systeme entwickelt, die unsere Fähigkeiten nachahmen oder übertreffen sollen, um uns zu unterstützen oder zu ersetzen. Gleichwohl implementieren wir gleichzeitig Schutzmechanismen, um diese Systeme fernzuhalten. Die grundlegende Frage lautet, wie wir in einer Welt, in der Algorithmen und KI-Agenten immer präsenter und leistungsfähiger werden, eine klare Grenze zwischen Mensch und Maschine ziehen können.

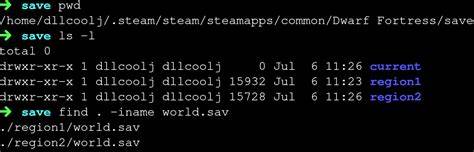

Schönfärberei oder simple Captchas genügen hierfür schon längst nicht mehr. Stattdessen steht die Gesellschaft vor einer tiefgreifenden Herausforderung, die mehr als eine reine Nutzererfahrung betrifft. Es geht um Identität, Vertrauen und den Nachweis von Personhood im digitalen Raum. Zahlreiche technologische Projekte versuchen, diesen Herausforderungen mit neuen Ansätzen zu begegnen. Ein Beispiel ist „World“ (früher Worldcoin), ein Projekt, das von Sam Altman, Mitbegründer von OpenAI, ins Leben gerufen wurde.

World nutzt biometrische Daten, genauer gesagt Iris-Scans, um eine einzigartige und private „Proof of Personhood“ zu erstellen. Dabei wird sichergestellt, dass eine Person nur einmal verifiziert wird und ihre Identität dabei vertraulich bleibt. Parallel dazu entstand das Humanity Protocol, das auf der Palmenerkennung basiert und ähnlich darauf abzielt, Nutzern eine authentifizierte und dennoch private digitale Identifikation zu ermöglichen. Beide Initiativen kombinieren biometrische Verfahren mit zukunftsweisenden Technologien wie Blockchains, Kryptowährungen und Zero-Knowledge-Proofs. Dies ermöglicht eine Verifikation, ohne persönliche Daten offenlegen zu müssen oder Kontrolle über sensible biometrische Informationen zu verlieren.

Trotz der Kontroversen, die biometrische Verfahren und Krypto-Technologien mit sich bringen, zeigen diese Ansätze, dass ein Umdenken erforderlich ist. Die Alltäglichkeit von KI-Agenten verlangt nach einem sicheren, dezentralisierten und ethisch verantwortlichen Mechanismus, um echte Menschen von künstlichen Entitäten zu unterscheiden. Der Bedarf an einem universellen digitalen Ausweis wird immer offensichtlicher. Ähnlich wie eine Bankkarte, eine E-Mail-Adresse oder ein Webbrowser eine Grundausstattung für die digitale Teilnahme darstellen, wird eine digitale Personhood-Authentifizierung zu einem unerlässlichen Werkzeug im Zeitalter der KI. Ohne eine solche vertrauenswürdige Schicht könnten digitale Interaktionen in einer Anonymität versinken, in der weder Herkunft noch Absicht der Teilnehmenden klar erkennbar sind.

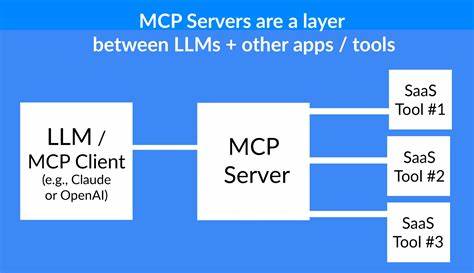

Dies würde nicht nur Betrug und Missbrauch Tür und Tor öffnen, sondern auch den sozialen Zusammenhalt und das Verantwortungsbewusstsein in Netzwerken gefährden. Noch viel tiefgreifender ist das Paradoxon, das sich aus der Rolle von KI-Agenten selbst ergibt. Einer der Hauptzwecke, die künstliche Intelligenz verfolgt, ist es, Aufgaben für uns zu erledigen – intelligent, autonom und effizient. Schon heute übernehmen KI-Systeme zahlreiche Tätigkeiten, die früher ausschließlich von Menschen ausgeführt wurden, wie die Terminvereinbarung, das Schreiben von E-Mails, das Organisieren des Kalenders oder das Abwickeln von Einkäufen. Zukünftig könnten solche Agenten imstande sein, komplexe administrative Aufgaben, Steuererklärungen oder Kundenanfragen zu managen und dies oft zuverlässiger als wir Menschen.

Diese Entwicklung führt dazu, dass Dienstleistungen und Unternehmen möglicherweise zunehmend lieber mit digitalen Stellvertretern kommunizieren als mit dem Menschen selbst. Einige Unternehmen, wie etwa der Einzelhandelsriese Walmart, bereiten sich bereits auf die Möglichkeit vor, dass die KI-Agenten die eigentlichen Hauptkunden darstellen können. In einer Zeit, wo Emotionen, Fehleranfälligkeit oder Unzuverlässigkeit menschlicher Akteure als nachteilig empfunden werden, könnten Maschinen die bevorzugten Partner im digitalen Wirtschaftskreislauf werden. Und damit entsteht eine verblüffende Wendung im Captcha-Paradoxon. War es bislang die Aufgabe von Menschen, zu beweisen, dass sie keine Maschine sind, so könnte sich das Blatt umkehren.

In naher Zukunft besteht die Möglichkeit, dass wir Menschen uns gegenüber digitalen Plattformen und Diensten als „Bots“ oder durch unsere Bots repräsentiert zu authentifizieren haben. Captchas und ähnliche Kontrollmechanismen könnten eines Tages Menschen blockieren, während verifizierte KI-Agenten Zugang erhalten. Dieses Szenario wirft grundlegende Fragen über unser Selbstverständnis, unsere Kontrolle über die eigene digitale Identität und die Rolle der künstlichen Intelligenz auf. Haben wir Maschinen geschaffen, die nun nicht nur unsere Werkzeuge sind, sondern zu offiziellen Stellvertretern und Repräsentanten unseres digitalen Selbst wurden? Und wenn ja, wie gestalten wir diese Beziehung so, dass sie unsere Werte respektiert und nicht die menschliche Vielfalt und Autonomie untergräbt? Abschließend zeigt das Captcha-Paradoxon exemplarisch die Ambivalenz des technologischen Fortschritts. Während wir von KI profitieren, indem wir komplexe Aufgaben delegieren und unsere Effizienz steigern, stehen wir auch vor der Herausforderung, unseren eigenen Platz in der digitalen Welt zu behaupten.