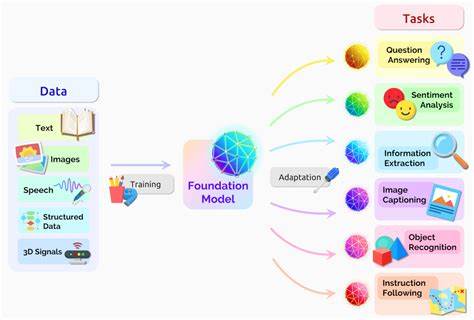

Die Künstliche Intelligenz hat in den letzten Jahren enorme Fortschritte gemacht, insbesondere durch die Entwicklung großer Sprachmodelle (LLMs) wie GPT und ähnliche Systeme. Diese Modelle ermöglichen es Maschinen, menschenähnlichen Text zu generieren und komplexe Aufgaben auszuführen, die zuvor unvorstellbar waren. Trotzdem zeigen sich bei LLMs grundlegende Schwächen, insbesondere wenn es um tiefgehendes Verständnis, kausale Zusammenhänge und verlässliche Entscheidungsfindung geht. Hier setzen die Großen Konzept-Modelle (Large Concept Models, LCMs) an, die einen grundlegenden Paradigmenwechsel in der KI-Repräsentation und -Analyse markieren. Sie gehen über die reine Wortvorhersage hinaus und bringen strukturierte, kausal basierte Denkprozesse in die Welt der KI.

LCMs basieren auf der Integration strukturierter Wissensquellen, wie Ontologien oder kausalen Graphen, die Konzepte und deren Beziehungen explizit darstellen. Das ist ein entscheidender Vorteil gegenüber den herkömmlichen Sprachmodellen, die meist nur Wahrscheinlichkeiten für Wortabfolgen berechnen. Durch die Fokussierung auf Konzepte anstelle von einzelnen Tokens können LCMs komplexe Zusammenhänge besser erfassen und nachvollziehbare Argumentationsketten generieren. Diese Eigenschaft macht sie für Anwendungen attraktiv, die sichere, transparente und nachvollziehbare Entscheidungen erfordern, etwa im medizinischen Bereich, bei der juristischen Analyse oder im automatisierten Kundenservice. Ein typisches Beispiel für die Herausforderungen von LLMs zeigt sich im Kundenservice.

Ein Kunde, der in einer schriftlichen Anfrage auf ein wiederholt auftretendes Problem hinweist, das bereits gemeldet wurde, könnte von einem LLM als bloße Reklamation behandelt werden, ohne tiefere Ursachenforschung. LCMs hingegen erkennen den Zusammenhang zwischen wiederkehrenden Tickets, systemischen Fehlern und Kundenproblemen. Sie fassen Konzepte wie "Wiederholung", "technischer Fehler" und "Abrechnung" zusammen und kategorisieren die Anfrage umfassender, was zu zielgerichteteren Lösungen führt. Somit kann ein LCM intelligente, mehrschichtige Support-Tickets erstellen und verschiedene Teams gleichzeitig gezielt informieren. Eine weitere Schwäche der klassischen Sprachmodelle ist deren sequenzielle, tokenweise Verarbeitung.

Sie erstellen Texte Wort für Wort, ohne eine strukturierte Gesamtplanung des Outputs. Das führt oft zu logischen Inkonsistenzen, Wiederholungen oder widersprüchlichen Aussagen in längeren Texten. Dagegen arbeiten LCMs in einem abstrakten Konzept-Embedding-Raum, in dem sie ganze Ideen und deren Zusammenhänge auf Satz- oder Konzept-Ebene erfassen, anstatt sich auf einzelne Wörter zu fokussieren. Mithilfe von Konzepten können sie kohärente, gut durchdachte Antworten formulieren, die auch komplexe logische Abhängigkeiten abbilden. Die Architektur von LCMs basiert auf hybriden Ansätzen, die neuronale Netze mit symbolischer AI und logischen Regeln verbinden.

So ist es möglich, maschinelles Lernen mit strukturiertem, explizitem Wissen zu kombinieren. Ein wichtiger Bestandteil ist das sogenannte SONAR-Embedding, das Konzept-ähnliche Vektoren erzeugt und so die Bedeutungsähnlichkeit und semantische Beziehungen abbildet. SONAR ermöglicht beispielweise das Übersetzen von mehr als 200 Sprachen, da die Modelle konzeptuell statt sprachlich denken. Sonar hilft dabei, Konzepte zu kodieren, zu analysieren und zu decodieren, wodurch die Modelle enorm flexibel und sprachunabhängig werden. In der Praxis existieren verschiedene Varianten von LCM-Architekturen.

Die Base-LCM-Modelle sind der erste Schritt und funktionieren ähnlich wie traditionelle Sprachmodelle, jedoch mit dem Unterschied, dass sie das nächste Konzept vorhersehen statt nur das nächste Wort. Diffusionsbasierte LCMs stellen eine weiterentwickelte Form dar und nutzen Inspiration aus der Bildgenerierung durch Rauschentfernung, um Unsicherheiten bei Vorhersagen zu minimieren. Diese Methode erlaubt es dem Modell, konzeptuelle Prognosen über mehrere Verfeinerungsschritte iterativ zu verbessern, was zu höherer Genauigkeit und Relevanz führt. Dennoch gibt es auch Herausforderungen bei LCMs. Sie benötigen komplexe Datenpipeline-Architekturen, die aufwendiger und kostenintensiver in Training und Einsatz sind als klassische Sprachmodelle.

Zudem erfordern sie umfangreiche Konzept-Labeling-Arbeiten für Trainingsdaten und ein nachhaltiges Konzept-Engineering, das oft domänenspezifisch angepasst werden muss. Die interne Nachvollziehbarkeit der Reasoning-Prozesse bleibt trotz Fortschritten technisch anspruchsvoll, was Audits erschwert. Außerdem sind LCMs bislang weniger kreativ in der reinen Textgenerierung, wodurch sie eher in analytischen und akademischen Kontexten eingesetzt werden. Die Möglichkeiten von LCMs zeigen sich deutlich in verschiedenen realen Anwendungsfällen. Im Bereich der automatischen Kundensupport-Ticketverarbeitung bieten LCMs eine präzise Klassifikation von über 450 Support-Kategorien in mehr als 50 Abteilungen – inklusive sprachübergreifender Verarbeitung in 15 Sprachen.

Dies ermöglicht eine hoch skalierbare, multilinguale, kontextsensitiv arbeitende Lösung, die nicht nur Anfragen versteht, sondern auch passende Antworten erzeugt. Ebenso bei der automatischen Generierung von SQL-Abfragen für Business Intelligence können LCMs den Nutzerwunsch auf konzeptueller Ebene erfassen, komplexe Einschränkungen und Joins korrekt abbilden und somit die Fehlerquote gegenüber LLM-basierten Systemen massiv reduzieren. Auch im rechtskonformen Bereich der regulatorischen und Compliance-Berichte zeigen LCMs Vorteile, wenn sie komplexe regulatorische Bestimmungen und deren Verknüpfungen verstehen, mehrstufige Validierungen durchführen und strukturierte, kontextangemessene Dokumentationen generieren. Hier minimieren sie Risiken teurer Compliance-Fehler und beschleunigen die Verarbeitung großer Datenmengen, indem sie verbindliche Standards einhalten und Interpretationsspielräume durch klare Konzepterfassung minimieren. Ausblickend zeichnen sich Hybridmodelle ab, die die konzeptionelle Stärke von LCMs mit der sprachlichen Finesse und Kreativität von LLMs kombinieren.

So könnten zukünftige KI-Systeme anspruchsvolle Analysen durchführen und diese gleichzeitig verständlich und narrativ überzeugend kommunizieren. Eine solche Symbiose könnte unter anderem in der Marktanalyse, wissenschaftlichen Forschung, oder strategischen Entscheidungsfindung eingesetzt werden und dabei sowohl präzise Gründe liefern als auch klar formulierte Empfehlungen abgeben. Innovative Entwicklungen wie ein AI-gestützter Strategieberater mit auditierbarer Entscheidungslogik könnten so Realität werden. Durch die Forderung von Regulierungsbehörden nach nachvollziehbaren, prüfbaren Entscheidungswegen gewinnt diese Transparenz für den praktischen Einsatz von KI enorm an Bedeutung. Die Zukunft von KI liegt in Systemen, die nicht nur oberflächlich Muster erkennen, sondern echte Zusammenhänge verstehen und nachvollziehbar erklären können.

Große Konzept-Modelle sind ein entscheidender Schritt in diese Richtung. Sie verändern die Art und Weise, wie Maschinen denken, lernen und interagieren. Dadurch wird nicht nur die Zuverlässigkeit von KI erhöht, sondern auch die Akzeptanz durch Nutzer und Entscheidungsträger gesteigert. Insgesamt bieten LCMs somit ein leistungsfähiges, neues Paradigma für KI-Entscheidungen und Problemlösung, für das eine synthetische Verbindung von struktureller Wissensrepräsentation und leistungsfähiger neuronaler Verarbeitung den Kern bildet. Unternehmen und Forschungseinrichtungen, die diese Technologie einsetzen, können komplexe, mehrstufige Aufgaben besser bewältigen, präzisere Antworten gewährleisten und gleichzeitig die Transparenz ihrer Systeme verbessern.

Trotz der noch bestehenden Herausforderungen ist der Trend klar: KI-Systeme der nächsten Generation werden durch konzeptorientiertes Denken intelligenter, sicherer und vertrauenswürdiger sein.

![The case for Mars terraforming research [pdf]](/images/A2C96712-9710-44F8-9284-10253D4F375C)