Spam ist seit Jahren eine der größten Plagen des digitalen Zeitalters. Trotz zahlreicher Fortschritte in der Technologie und zahlreichen Anti-Spam-Mechanismen bleibt die unerwünschte Massenkommunikation ein erhebliches Problem für Privatnutzer, Unternehmen und Anbieter von Kommunikationsdiensten. Im Kern stellt sich die Frage, ob die aktuelle Technologie, basierend auf spezialisierten maschinellen Lernverfahren und klassischen Filtermethoden, ausreicht oder ob wir eine Künstliche Allgemeine Intelligenz (AGI) benötigen, um Spam wirklich effizient zu bekämpfen. Spam ist vielschichtig. Traditionelle Spam-E-Mails sind oft massenhaft verschickte Nachrichten, die meist werbliche oder betrügerische Inhalte enthalten.

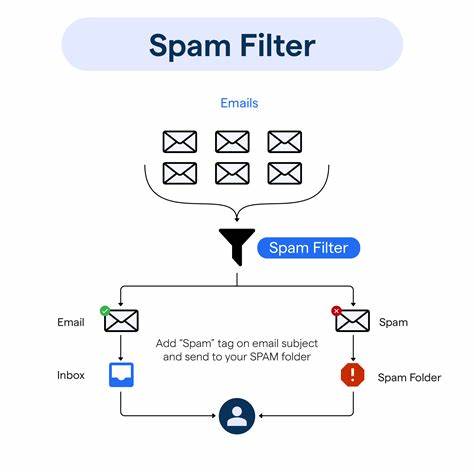

Die Herausforderung besteht darin, diese Flut zu erkennen und zuverlässig zu blockieren. Moderne Filtertechnologien nutzen fortschrittliche Algorithmen des maschinellen Lernens, um Muster in Spam-Inhalten zu identifizieren. Sie analysieren die Nachrichtenstruktur, den Absender, Worte und Formulierungen, die typischerweise in Spam auftauchen. Dabei spielen auch heuristische Methoden und Blacklists eine Rolle, die bereits bekannte Spam-Quellen und Schadsoftware blockieren können. Dennoch zeigen neu aufgekommene Phänomene, dass Spam keineswegs ein Problem ist, das alleine durch statische oder regelbasierte Filter zu lösen ist.

Die Weiterentwicklung künstlicher Intelligenz könnte künftig völlig neue Formen von Spam hervorbringen, die zielgerichteter und damit schwerer zu erkennen sind. Agentische KI-Modelle, welche über eine Art „PhD-Niveau“ an reasoning-Verständnis verfügen, könnten Spam personalisieren und menschlicher wirken lassen. Dies bedeutet, dass eine Botschaft nicht mehr bloß massenhaft versendet wird, sondern individuell angepasst, auf psychologische Schwachstellen ausgerichtet und gezielt auf Opfergruppen zugeschnitten sein könnte. Die Frage im Kern bleibt: Ist hierfür wirklich das Niveau einer allgemeinen künstlichen Intelligenz nötig? Einige Experten verneinen dies für klassische Spam-Taktiken. Spam setzt oft auf Masse und Frequenz, was es auch ohne überragende Intelligenz recht einfach macht, großflächig zu streuen.

Botnetze und automatisierte Systeme erlauben das Versenden von Milliarden an Nachrichten. Die Filtermechanismen, die anhand statistischer Merkmale und Verhaltensanalysen funktionieren, können diesen massenhaften Spam besser denn je erkennen und filtern. AGI hingegen eröffnet neue Gefahren. Sie könnte neue Betrugsmaschen entwickeln, die auf die Manipulation einzelner Menschen abzielen. Mit fortschrittlicher agentischer Intelligenz könnten Spammer nicht bloß technisch geschickt Spams verschicken, sondern vielmehr psychologisch raffinierte Angriffe gestalten.

Diese Angriffe könnten so ausgefeilt sein, dass sie von traditionellen Antispam-Technologien schwer zu erkennen sind. In der Diskussion wird auch hervorgehoben, dass statt eines Überflusses an Spam die Qualität und Personalisierung der unerwünschten Kommunikation zunimmt. Ein Argument, das häufig genannt wird, ist, dass wenn AGI zum Filtern von Spam eingesetzt wird, dieselbe oder eine ähnliche Intelligenz auch für die Spam-Erstellung genutzt werden kann. Das führt zu einem Wettrüsten zwischen Angreifern und Verteidigern im digitalen Raum. Sobald Filter intelligenter werden, entwickeln Spammer neue, schwierigere Taktiken.

Aus dieser Sicht ist es nicht klar, ob ein höheres Intelligenzniveau bei Filtern allein das Problem lösen wird. Gleichzeitig eröffnen sich durch fortschrittliche KI-Modelle auch Chancen, Spam noch besser zu identifizieren. Beispielsweise könnten KI-Systeme kontextuelle Informationen erkennen und analysieren, um nicht nur simple Schlüsselwörter oder Absenderadressen zu nutzen, sondern komplexe Zusammenhänge, wie etwa die Wahrscheinlichkeit, dass eine Nachricht Teil eines Betrugs ist oder nicht. Eine KI könnte Sicherheitswarnungen präziser formulieren und Nutzer so besser vor potenziellen Schäden schützen. Wichtig ist auch die Rolle von menschengestütztem Training und Feedback in der Spam-Filterung.

Maschinelles Lernen profitiert von riesigen Datensätzen, die von echten Nutzern bewertet werden. So verbessern sich Filter ständig und passen sich neuen Bedrohungen an. Obwohl die Technologie auf Lernalgorithmen beruht, ist sie bislang eher spezialisiert und eng fokussiert – weit entfernt von einer umfassenden, allgemeinen Intelligenz. Trotz der Komplexität ist ein weiteres Problem die Rechtmäßigkeit und die ethischen Herausforderungen bei der Einführung einer AGI zur Spam-Bekämpfung. Eine AGI, die tiefgreifend in Kommunikationsdaten eindringt, könnte auch Datenschutzfragen aufwerfen.

Wie viel Kontrolle und Einsicht darf eine solche Künstliche Intelligenz in E-Mail-Inhalte haben? Dieses Spannungsfeld zwischen Sicherheit und Privatsphäre ist eine der größten Herausforderungen für zukünftige Innovationen in der Spam-Filtertechnologie. Zudem ist zu bedenken, dass nicht jede Form von unerwünschter E-Mail automatisch Spam ist. Manchmal handelt es sich um legitime, aber unerwünschte Werbung oder verworrene Kommunikationsformen, die von verschiedenen Anbietern ausgehen. Eine zu aggressive Filterung könnte wertvolle Informationen blockieren und so die Nutzererfahrung beeinträchtigen. Die Balance zwischen Schutz vor Spam und das zulassen legitimer Kommunikation bleibt auch in einer Ära der KI ein kritisches Thema.

Die Zukunft der Spam-Filterung wird vermutlich eine Kombination aus verschiedenen Ansätzen sein. Auf der einen Seite spezialisierte maschinelle Lernmodelle, die ständig mit neuen Daten trainiert werden, und auf der anderen Seite möglicherweise elementare Funktionen einer allgemeinen künstlichen Intelligenz, die besser als heutige Systeme in der Lage ist, komplexe Zusammenhänge und Kontext zu verstehen. Aktuell ist die „allgemeine Intelligenz“ aber weder notwendig noch weit verbreitet. In Summe ist Spam weiterhin ein sich entwickelndes Problem, das immer neue Varianten hervorbringt. Ob die Technologie der Zukunft eine echte AGI beinhaltet, die Spam vollständig aus dem Internet verbannen kann, liegt in der weiteren Forschung und Entwicklung.