In der heutigen Zeit, in der technologische Innovationen in rasantem Tempo voranschreiten, nimmt die Rolle von Künstlicher Intelligenz (KI) in der Softwareentwicklung immer deutlichere Formen an. Insbesondere die Verbindung von KI mit low-level Programmierungssprachen wie Assembler bietet sowohl faszinierende Möglichkeiten als auch grundlegende Herausforderungen für Entwickler und Projektverantwortliche. Matt Godbolt, ein renommierter C++-Entwickler und Kurator eines beliebten Compiler Explorer Projekts, hat vor Kurzem seine Erfahrungen und Überlegungen zur Anwendung von KI, speziell von Large Language Models (LLMs) wie Claude, im Umfeld der Assembler-Erklärungen geteilt. Diese Reflexion eröffnet einen spannenden Einblick in die Schnittstellen von künstlicher Intelligenz, menschlicher Expertise und digitaler Verantwortung – der sogenannten Kunst der Projektverantwortung oder Projektstewardship. Der Kern seines Ansatzes liegt darin, KI nicht als isoliertes Werkzeug, sondern als Teil einer rekursiven Systementwicklung zu verstehen.

In seinem Projekt unterstützt Claude Code, eine spezialisierte KI-Version, die Entwicklung einer Funktion, die Assembler-Code versteht und in für Anfänger zugängliche Erklärungen transformiert. Dabei kommt ein Backend-Service zum Einsatz, der mit Hilfe von Claude Code verfeinerte Aufforderungen an ein leistungsfähigeres Modell aussendet, das dann wiederum die Antworten über ein ressourcensparendes KI-Modell zurücksendet. Diese geschachtelte Nutzung von KI verdeutlicht, wie immer komplexere Systeme entstehen, die auf den Fähigkeiten von LLMs basieren und zugleich deren Grenzen anerkennen. Die Idee, Programmierern den Zugang zu Assembler durch KI-gestützte Erklärungen zu erleichtern, erscheint simpel, besitzt jedoch eine tiefere Bedeutung. Viele Entwickler können ihren Code kompilieren und die Assembler-Ausgabe betrachten, doch den tatsächlichen Ablauf und die Bedeutung vollständig zu verstehen, ist oft eine Hürde.

Die von Matt Godbolt erprobte Funktion hebt diese Hürde, indem sie die komplexen Instruktionen in verständliche Sprache übersetzt und somit eine Bildungsbrücke zwischen hohen Programmiersprachen und der hardwarenahen Maschinensprache schlägt. Diese pädagogische Komponente zeigt deutlich, wie KI als Werkzeug für Wissenserweiterung eingesetzt werden kann. Die Reaktionen auf die Vorstellung dieser Funktion auf sozialen Medien und in der Entwickler-Community waren geteilt. Während viele Nutzer die innovative Idee begrüßten und den Mehrwert für Lernende erkannten, stießen einige kritische Stimmen insbesondere auf die ethischen und philosophischen Implikationen der KI-Integration. Solche Bedenken beziehen sich nicht nur auf die Zuverlässigkeit der von KI erzeugten Erklärungen, sondern auch auf grundsätzliche Ängste, dass durch KI etwas Einzigartiges, Menschliches im Umgang mit Code verloren geht.

Diese emotionalen und intellektuellen Reaktionen spiegeln tief verwurzelte Fragen wider, die weit über technische Aspekte hinausgehen. Die Kritik an der „Fehlerhaftigkeit“ von KI-Systemen ist eine häufige Debatte. Godbolts Sichtweise zeigt einen pragmatischen Umgang mit diesem Punkt: Menschen machen auch Fehler, insbesondere in komplexen Fachgebieten wie Assembler-Programmierung. KI-Systeme, die auf Wahrscheinlichkeiten und Mustererkennung basieren, sind nicht unfehlbar, doch die Annahme, dass KI bewusst täuscht oder lügt, ist aus seiner Perspektive falsch, da Intentionen bei KI fehlen. Diese Unterscheidung unterstreicht die Notwendigkeit, von einem rationalen, weniger emotionalen Rahmen aus über KI zu sprechen und sie nicht als „böse“ Instanz zu betrachten.

Ethische Fragen bleiben jedoch zentral. Die Quellen der Trainingsdaten von KI-Systemen und der enorme Energieverbrauch für deren Betrieb werfen ernste Herausforderungen für nachhaltige Nutzung auf. Das Bewusstsein und die Bereitschaft, etwa durch CO2-Ausgleichsprogramme wie im Compiler Explorer Projekt, diese Auswirkungen abzumildern, zeigen, dass verantwortungsbewusste Projektleiter auch ökologische und gesellschaftliche Dimensionen aktiv in ihre Entscheidungen einbeziehen müssen. Ein besonders erhellender Teil der Reflexion betrifft die Interaktionen mit skeptischen Nutzern. Die Möglichkeit, durch geduldigen Dialog und praktische Erfahrung Vorurteile abzubauen und eine ausgewogenere Sichtweise zu entwickeln, offenbart den Wert von Gemeinschaft und transparentem Prozessmanagement.

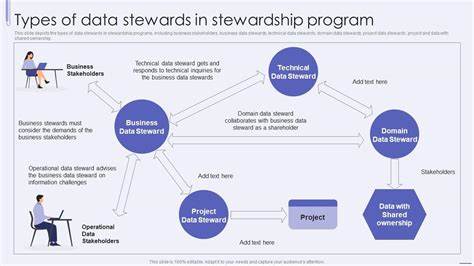

Gerade in Open-Source-Umgebungen, wo die Nutzerbasis vielfältig und die Akzeptanz von Neuerungen entscheidend ist, erweist sich solche kommunikative Offenheit als einer der wichtigsten Erfolgsfaktoren. Die Herausforderung für Projektverantwortliche, sogenannte Benevolent Dictators, liegt darin, den oft widerstreitenden Erwartungen von Community-Mitgliedern gerecht zu werden. In der Welt von Open Source sind Kompromisse und Offenheit essenziell, doch es bleibt unvermeidlich, Entscheidungen zu treffen, die nicht allen gefallen. Die Kunst der Projektverantwortung bedeutet in diesem Zusammenhang, die Entwicklung voranzutreiben, ohne Vertrauen und Zusammenhalt zu gefährden, indem man transparent über Risiken, Absichten und mögliche Fehler kommuniziert. Der gedankliche Brückenschlag zwischen der Rolle des Menschen und der KI ist entscheidend für die Zukunft digitaler Werkzeuge.

KI ergänzt menschliche Fähigkeiten, sie ersetzt sie aber nicht. Indem sie komplexe Informationen zugänglicher macht, fördert sie das Lernen und das technische Verständnis, was letztlich den einzelnen Entwickler stärkt. Gleichzeitig sollten die Grenzen der KI klar kommuniziert werden, um unrealistische Erwartungen oder Ablehnung zu vermeiden. Im Kontext der Assemblerprogrammierung hebt der Einsatz von KI somit nicht nur die Schwelle für Lernende, sondern kann auch erfahrenen Entwicklern neue Werkzeuge an die Hand geben, um Fehler schneller zu erkennen und Effizienz zu steigern. Die Schnittmenge von KI und low-level Computing wird dadurch zu einem Feld, das Innovation und Diskussion gleichermaßen benötigt.