Apple hat im Mai 2025 eine wegweisende Reihe neuer Barrierefreiheitsfunktionen angekündigt, die im Laufe des Jahres weltweit auf seinen Geräten eingeführt werden. Das Unternehmen, das traditionell für seine Innovationskraft im Bereich der Zugänglichkeit bekannt ist, baut seine langjährige Tradition aus, die Technologie für Menschen mit unterschiedlichen Bedürfnissen zugänglicher zu machen. Mit dem Fokus auf ein integriertes Nutzererlebnis innerhalb des Apple-Ökosystems umfassen die kommenden Features eine Vielfalt von Anpassungen und Hilfsmitteln, die vor allem Menschen mit Sehbehinderungen, Hörbehinderungen, motorischen Einschränkungen und kognitiven Herausforderungen zugutekommen sollen. Dabei setzt Apple zunehmend auf die Leistungsfähigkeit seiner eigenen Silicon-Chips sowie auf Fortschritte in den Bereichen maschinelles Lernen und künstliche Intelligenz, um Funktionen direkt auf dem Gerät auszuführen und somit Datenschutz, Geschwindigkeit und Zuverlässigkeit zu optimieren. Ein zentrales Highlight der Neuerungen ist die Einführung der Accessibility Nutrition Labels im App Store.

Diese Labels bieten detaillierte Informationen über die Barrierefreiheits-Features einzelner Apps und Spiele noch vor dem Download. Nutzerinnen und Nutzer können so besser einschätzen, welche Apps ihren speziellen Bedürfnissen entsprechen, etwa durch Zusagen zu VoiceOver-Kompatibilität, Unterstützung von Sprachsteuerung, größerem Text, ausreichendem Kontrast oder Untertitelungen. Entwickler erhalten zugleich die Möglichkeit, ihre Barrierefreiheitsoptionen transparent zu kommunizieren und so einer breiteren Nutzergruppe zugänglich zu machen. Apples neuer Schritt wird daher von Expertinnen und Experten als großer Fortschritt in Sachen Inklusion gewertet, da er für mehr Transparenz sorgt und den Kaufprozess für Menschen mit Behinderungen erleichtert. Eine weitere bedeutende Erweiterung betrifft die Verfügbarkeit der Magnifier-App auf dem Mac.

Bislang war diese beliebte Funktion, mit der Nutzer ihre Umgebung näher heranzoomen und textuelle Inhalte besser erkennen können, vor allem auf iPhone und iPad zu finden. Mit der Mac-Version wird es möglich, externe Kameras oder die Continuity-Kamera des iPhones einzubinden, um jederzeit und flexibel die eigene Umgebung zu vergrößern. Funktionen zur Anpassung von Helligkeit, Kontrast, Farbfiltern und Perspektiven erleichtern das Lesen und Erkennen. Zudem können mehrere getrennte Ansichten parallel genutzt werden, was etwa Studierenden oder Berufstätigen zugutekommt, die gleichzeitig Dokumente und Präsentationen verfolgen wollen. Die Integration mit Accessibility Reader sorgt außerdem dafür, dass Texte aus der physischen Welt in ein besser lesbares Format umgewandelt werden.

Für Menschen, die auf Braille angewiesen sind, stellt Apple mit Braille Access eine revolutionäre Neuerung vor. Dieses Feature verwandelt iPhone, iPad, Mac und sogar die Apple Vision Pro in vollwertige Braille-Notizgeräte. Nutzerinnen und Nutzer können mit angeschlossenen Braille-Displays nicht nur Apps starten, sondern auch Notizen verfassen und mittels Nemeth Braille komplexe mathematische und naturwissenschaftliche Formeln berechnen. Die Unterstützung von Braille Ready Format (BRF) Dateien macht eine Vielzahl bereits existierender Braille-Inhalte zugänglich. Gleichzeitig erleichtert eine Echtzeit-Transkription von Gesprächen auf Braille-Displays inklusive Live Captions die Kommunikation in Alltag und Beruf.

Die tiefgreifende Integration in Apples Ökosystem sorgt für nahtlose Benutzererlebnisse. Mit Accessibility Reader führt Apple einen neuen systemweiten Lesemodus ein, der explizit für Nutzer mit unterschiedlichen Leseschwierigkeiten wie Legasthenie oder Sehbeeinträchtigungen entwickelt wurde. Auf iPhone, iPad, Mac und Apple Vision Pro bietet dieser Modus umfassende Anpassungsmöglichkeiten für Schriftart, Farbe, Zeilenabstand und mehr, um Textinhalte leichter zugänglich zu machen. Die Integration mit der Magnifier-App erlaubt zudem das Vorlesen und Optimieren von Text, der sich in der physischen Umgebung befindet, etwa Speisekarten oder Bücher. Damit ebnet Apple den Weg für ein inklusiveres Leseerlebnis, das sich flexibel an individuelle Bedürfnisse anpasst.

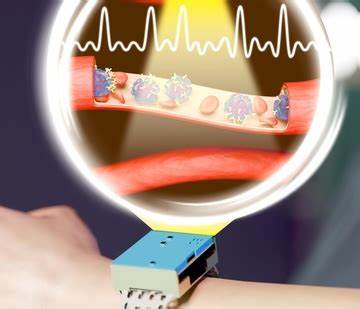

Für Menschen mit Hörbeeinträchtigungen erweitert Apple die Möglichkeiten von Live Listen auf der Apple Watch. Nutzer können ihr iPhone als Fernmikrofon verwenden, um Umgebungsgeräusche und Gespräche über AirPods oder kompatible Hörgeräte klar zu empfangen. Die Apple Watch zeigt dabei Live-Untertitel in Echtzeit an und ermöglicht eine komfortable Steuerung der Sessions aus Entfernung, ohne den Gesprächsfluss zu unterbrechen. Live Listen harmoniert zudem mit erweiterten Hörgesundheitsfeatures der AirPods Pro 2 und schafft so eine klinisch hochwertige Hörunterstützung. Die Vision Pro und das neue visionOS erhalten starke Updates speziell für Nutzer mit Sehbehinderungen.

Die verbesserte Zoom-Funktion ermöglicht es, die gesamte Sicht inklusive der Umgebung zu vergrößern. Die Live Recognition nutzt maschinelles Lernen auf dem Gerät, um Objekte zu erkennen, Dokumente vorzulesen und Personen oder Situationen kompetent zu beschreiben. Für Entwickler wird es zudem eine neue API geben, mit der Apps auf die Hauptkamera zugreifen können, sodass etwa lebendige, persönliche Assistenzdienste wie Be My Eyes eine noch größere Rolle in der Verständigung und Navigation übernehmen können. Darüber hinaus bringt Apple zahlreiche weitere Verbesserungen mit Fokus auf Komfort und Lebensqualität. Background Sounds lässt sich einfacher anpassen und automatisieren, um etwa bei Tinnitus störende Umgebungsgeräusche zu minimieren.

Personal Voice ermöglicht die schnelle und natürliche Erstellung individueller Stimmen, sogar in spanischer Sprache (Mexiko), und bietet so eine personalisierte Kommunikationsalternative für Menschen, die ihre Stimme zu verlieren drohen. Mit Vehicle Motion Cues wird eine neue Funktion in den Mac-Systemen eingeführt, um Reisekrankheit durch Bewegungsanpassungen zu verringern. Apple investiert auch in Barrierefreiheit für Menschen mit motorischen Einschränkungen. Anwender von Eye Tracking erhalten zusätzliche Steuerungsoptionen wie die Nutzung von Switches oder automatischen Auslösern durch Verweilen (Dwell). Das Tippen auf der Bildschirmtastatur wird mit optimierten Timern und QuickPath-Unterstützung vereinfacht.

Head Tracking unterstützt Steuerungen per Kopfbewegung ähnlich dem Eye Tracking. Ein besonderes Augenmerk liegt auf der neuen Unterstützung von Switch Control für Brain-Computer-Interfaces, eine aufstrebende Technologie, mit der Nutzer ihre Geräte allein über Gedanken steuern können, ganz ohne körperliche Bewegung. Für Personen mit intellektuellen oder entwicklungsbedingten Herausforderungen stellt Apple das Assistive Access API bereit. Entwicklern wird dadurch die Möglichkeit gegeben, maßgeschneiderte Anwendungen zu schaffen. Zudem bietet der neue Apple TV App die Option eines stark vereinfachten Media Players speziell für diese Nutzergruppe.

Ebenso wird die Musik-Haptik auf dem iPhone personalisierbarer, indem man auswählen kann, ob Vibrationen für den gesamten Song oder nur für Vocals spürbar sind und wie intensiv diese ausfallen. Sound Recognition erfährt eine Erweiterung durch Name Recognition, wodurch Hörgeschädigte benachrichtigt werden können, wenn ihr Name in der Umgebung gerufen wird. Voice Control wird unter anderem durch einen neuen Programmiermodus für Entwickler mit eingeschränkter Mobilität verbessert und erweitert seinen Sprachvorrat um neue Sprachen wie Koreanisch, Arabisch, Türkisch, Italienisch sowie verschiedene chinesische Dialekte. Live Captions erhalten eine breitere Sprachunterstützung und werden so international noch zugänglicher. Auf der Fahrzeug-Interface-Ebene beinhaltet das Update unter anderem eine Unterstützung von Großschrift und die Möglichkeit, für taube oder hörgeschädigte Fahrer oder Beifahrer auch Babygeschrei zu erkennen und zu melden.

Zudem erlaubt die neue Share Accessibility Settings-Funktion, dass Nutzer ihre individuellen Barrierefreiheits-Einstellungen temporär mit anderen iPhones oder iPads teilen können – eine praktische Funktion bei der Nutzung fremder Geräte, wie etwa in Cafés oder Bibliotheken. Apple begleitet die Einführung der neuen Accessibility-Funktionen mit verschiedenen Initiativen zur Sensibilisierung. Im Mai 2025 finden in ausgewählten Apple Stores spezielle Tische statt, an denen sich Besucher über die Barrierefreiheitsoptionen informieren und Workshops belegen können. Diese Today at Apple-Sessions sind dauerhaft verfügbar und ermöglichen individuelles Lernen und die Anpassung persönlicher Einstellungen. Außerdem rücken zahlreiche Medienprojekte von Apple die Themen Inklusion und Barrierefreiheit in den Fokus, vom Apple Fitness+ Workout mit einer Rollstuhltänzerin über Dokumentationen zu historischen Gehörlosen-Rechtsbewegungen bis hin zu speziell kuratierten Playlists mit Gebärdensprachinterpretationen.

Apple unterstreicht mit diesen Innovationen seinen Anspruch, Barrierefreiheit als unverzichtbaren Bestandteil der eigenen Unternehmenskultur zu verankern. Die nahtlose Integration in das bestehende Produktportfolio und Ökosystem wirkt dabei wie ein kraftvoller Hebel, um Technologie für Menschen mit Behinderungen einfacher nutzbar zu machen und ihnen mehr Selbstbestimmung im Alltag zu ermöglichen. Gleichzeitig sendet Apple ein deutliches Signal an die Branche, wie digitale Inklusion systematisch und ambitioniert gelingen kann. Mit diesen Updates für das Jahr 2025 wird ein weiterer Meilenstein gesetzt, der das Nutzungserlebnis für Menschen mit besonderen Bedürfnissen deutlich verbessert und neue technische Standards etabliert.