Künstliche Intelligenz (KI) steht im Mittelpunkt technologischer Innovationen, die unsere Gesellschaft und Wirtschaft grundlegend verändern. Gleichzeitig wächst die Debatte um das Konzept der Artificial General Intelligence, kurz AGI, die eine KI beschreibt, die menschliche Intelligenz in beliebigen Aufgabenbereichen übertrifft oder nachahmt. Obwohl dieses Ziel faszinierend und visionär erscheint, hat sich in der jüngsten Forschung gezeigt, dass das anhaltende Fixieren auf AGI als ultimatives Leitbild der KI-Forschung viele Probleme verzerrt und die Entwicklung von praktikablen, ethisch verantwortbaren sowie gesellschaftlich nützlichen Anwendungen behindert. Die kritische Analyse der AGI-Fokussierung offenbart mehrere Fallstricke, die sowohl wissenschaftlichen Fortschritt als auch soziale Inklusion bei der Gestaltung KI-getriebener Technologien hemmen können. Ein wesentlicher Kritikpunkt an der einseitigen Ausrichtung auf AGI ist die sogenannte Illusion der Einigkeit.

In Fachkreisen sowie in der breiten Öffentlichkeit wird oft angenommen, dass es einen klaren Konsens über die Definition, das Ziel und die Bedeutung von AGI gibt. Diese Annahme verkennt jedoch die Vielschichtigkeit der Diskussion und die divergierenden Perspektiven technisch-wissenschaftlicher, ethischer und gesellschaftlicher Natur. Die Vorstellung, AGI sei das einzig wahre Ziel, verengt den Blick und führt dazu, dass oft andere wichtige Forschungsrichtungen und -methoden vernachlässigt werden. Derartige Verzerrungen können zu einem so genannten „Goal Lottery“ führen, bei dem zufällige oder modisch populäre Ziele überproportional Aufmerksamkeit und Ressourcen erhalten, während nützliche Arbeit mit anderen Schwerpunkten zu kurz kommt. Stattdessen wäre es wünschenswert, mehr Vielfalt und spezifizierte Zielsetzungen anzuerkennen, die verschiedene Facetten von KI abdecken – angefangen bei spezialisierten Anwendungen bis hin zu gesellschaftlichen Effekten und ethischen Fragestellungen.

Die Vision einer allumfassenden, autonomen KI hat zudem das Potenzial, wissenschaftliche Methodik negativ zu beeinflussen. Wenn Forschung primär darauf ausgerichtet ist, AGI zu erreichen, kann das Resultat eine Überbetonung von spekulativen, weit entfernten Innovationen sein, während robuste, überprüfbare und anwendungsorientierte wissenschaftliche Arbeit ins Hintertreffen gerät. Dies wird als „Supercharging Bad Science“ bezeichnet, eine Situation, in der ambitionierte KI-Ziele die Strenge der Forschung schwächen und zu überhöhten, wenig realistischen Erwartungen führen. Solche Verzerrungen können auch finanzielle Mittel absorbieren, die ansonsten für vielfältigere Projekte verwendet werden könnten, von denen viele unmittelbarer Nutzen versprechen und für die Gesellschaft besser greifbar sind. Ein weiterer schwerwiegender Fehler ist die Annahme, dass das Verfolgen von AGI-Zielen wertneutral erfolgt.

Tatsächlich spielt die Frage, welche Werte, Normen und gesellschaftlichen Prioritäten in den Entwicklungsprozess einfließen, eine zentrale Rolle für die Ausgestaltung von KI-Systemen. Diese sogenannte „Presuming Value-Neutrality“ ist gefährlich, da sie die impliziten Rahmenbedingungen und Machtstrukturen ignoriert, die sich hinter der Forschung verbergen. AGI-Forschung wird oft von einer technikzentrierten Perspektive dominiert, die gesellschaftliche Implikationen und ethische Herausforderungen nicht ausreichend berücksichtigt. Dies führt zu einer Normalisierung der Ausschlüsse bestimmter gesellschaftlicher Gruppen und Disziplinen im Forschungsprozess – ein Phänomen, das als „Normalized Exclusion“ bezeichnet wird. Die Fokussierung auf AGI erzeugt zudem eine langfristige „Generality Debt“.

Das bedeutet, dass die ständig angestrebte Allgemeingültigkeit von Intelligenzsystemen auf Kosten der Entwicklung spezialisierter, aber präziser Lösungen geht. Dieser „Schuldenberg“ erschwert es anschließend, praxistaugliche KI-Apps zu implementieren, die auf echte Herausforderungen zugeschnitten sind. Die Priorisierung eines einzigen, weit entfernten Ziels verhindert, dass Zwischenschritte oder kleinere Innovationen ausreichend wertgeschätzt und weiterentwickelt werden. Während AGI als Konzept oft theoretisch diskutiert wird, brauchen wir dringend mehr Arbeit an greifbaren Projekten mit klar definierten Nutzen und kontrollierbaren Risiken. Die Autoren der 2025 veröffentlichten Position beziehen sich auf diese verschiedenen Problematiken und plädieren für ein Umdenken in der KI-Community.

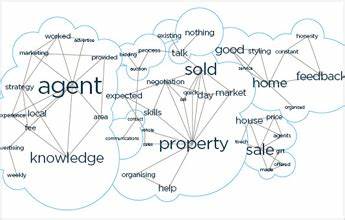

Sie empfehlen, den Fokus weg von monolithischen Zielen zu verlagern und stattdessen konkrete, spezifische Herausforderungen in Wissenschaft und Gesellschaft zu adressieren. So soll KI nicht als abstraktes Fernziel betrachtet werden, sondern als Werkzeug zur Lösung realer Probleme in Bereichen wie Gesundheit, Bildung, Umwelt und sozialer Gerechtigkeit. Eine solche Neuausrichtung erfordert zudem einen pluralistischen Ansatz, der vielfältige wissenschaftlicherichtungen, Disziplinen und gesellschaftliche Gruppen einbindet. Künstliche Intelligenz betrifft Menschen mit unterschiedlichsten Hintergründen, Bedürfnissen und Erfahrungen, weshalb interdisziplinäre Kollaborationen essenziell sind, um sinnvolle und faire Systeme zu entwickeln. Die Einbeziehung von Ethik, Sozialwissenschaften, Politik und den betroffenen Communities kann helfen, bisher ungelöste Herausforderungen und Ungleichheiten besser zu verstehen und anzugehen.

Innovation kann nur dann nachhaltig gedeihen, wenn verschiedene Stimmen gehört werden. Das Starren auf AGI als einzigen Weg führt leicht zu einer sogenannten „Goal Lottery“, bei der wenige populäre Konzepte über alle anderen dominieren, was wiederum zu einer homogenisierten Forschungslandschaft führt. Eine vielfältigere Zielsetzung schafft Raum für Experimente, alternative Herangehensweisen und unkonventionelle Ideen, die wesentlich zum Fortschritt beitragen können. Darüber hinaus sollte ein verantwortungsvoller Umgang mit KI die Auswirkungen technischer Entwicklungen auf Gesellschaft und Einzelne in den Mittelpunkt rücken. Ein ethisch reflektiertes Forschungsverständnis vermeidet es, Risiken zu bagatellisieren oder Chancen zu überhöhen.

Statt das Abwarten einer hypothetischen AGI, die möglicherweise nie realisiert wird, brauchen wir pragmatische und transparente Ziele, die zugängliche Vorteile schaffen und mögliche Schäden minimieren. Die soziale Einbindung und der öffentliche Diskurs über den Einsatz von KI stärken das Vertrauen in neue Technologien und fördern eine demokratische Gestaltung. Letztlich zeigt die intensive Debatte rund um AGI, wie wichtig es ist, die Sprache und Narrative in der KI-Forschung zu hinterfragen. Schlagworte wie „General Intelligence“ können eine mystifizierende und polarisierende Wirkung haben, die sowohl ForscherInnen als auch die Öffentlichkeit irreführt. Die Analyse von Konzepten und Begriffen sollte daher eng mit empirischer Forschung, Daten und gesellschaftlichem Kontext verbunden sein.