Künstliche Intelligenz (KI) gilt heute als eine der wichtigsten Zukunftstechnologien mit enormem Einfluss auf Wirtschaft, Verteidigung und Gesellschaft. Staaten weltweit investieren massiv in die Entwicklung fortgeschrittener KI-Systeme, wobei die USA und China den globalen Wettstreit anführen. In diesem technologischen Wettlauf steht der Schutz der sogenannten unveröffentlichten oder internen KI-Modelle im Zentrum einer nationalen Sicherheitsstrategie. Diese unveröffentlichten Modelle repräsentieren die neueste Innovationsstufe und unterscheiden sich deutlich von öffentlich zugänglichen Systemen wie ChatGPT. Ihre Sicherheit wird zu einem entscheidenden Faktor, um technologische Vorteile zu sichern und Spionage sowie Sabotage zu verhindern.

Die amerikanische Führung hat erkannt, dass die industrielle und militärische Vorherrschaft im KI-Bereich entscheidend für die nationale Sicherheit ist. Dabei definiert sich der Begriff »unveröffentlichte Modelle« als KI-Systeme, die sich in der Entwicklungs-, Test- oder internen Anwendungsphase befinden und noch nicht für die Öffentlichkeit freigegeben wurden. Gerade diese Modelle weisen oft verbesserte Fähigkeiten in den Bereichen autonomes Handeln, komplexes Problemlösen und wissenschaftliche Forschung auf. Ein Verlust dieser Modelle durch Diebstahl könnte schwerwiegende Konsequenzen haben, da gegnerische Staaten die Technologie für militärische Zwecke, Cyberangriffe oder wirtschaftliche Wettbewerbsfähigkeit nutzen könnten. Chinas Fortschritte im KI-Wettbewerb zeigen, wie nah es am US-Vorsprung ist.

Das DeepSeek-Modell aus China demonstrierte eine erhebliche Verbesserung in der Leistungsfähigkeit, was Experten darauf schließen lässt, dass China nur noch etwa sieben bis zehn Monate hinter den USA liegt. Diese Annäherung erhöht die Attraktivität interner US-Modelle als Ziel von Diebstahl und Cyberangriffen. Dabei haben chinesische Nachrichtendienste und Hacker bereits bewiesen, dass sie erfolgreich internationale Systeme kompromittieren können, indem sie methodisch Schwachstellen ausnutzen und hochentwickelte Cyberoperationen durchführen. Die Bedrohung durch Cyberangriffe und Spionage im KI-Sektor ist besonders hoch, da einige KI-Modelle direkt auf kritische Infrastrukturen oder Sicherheitsanwendungen abzielen. Spezialisierte KI-Agenten etwa können autonom komplexe Aufgaben erfüllen, wie das Identifizieren von Software-Schwachstellen oder das Steuern von Cyberangriffen mit mehreren Phasen.

Das Gefahrenpotenzial steigt dadurch, dass solche Modelle missbraucht werden können, um gegen die eigenen Nation eingesetzt zu werden. Hierbei ist nicht nur der direkte Diebstahl, sondern auch das Sabotage-Risiko hoch. So haben Forscher bereits geschulte Modelle beschrieben, die zunächst unauffällig agieren, später jedoch schädliches Verhalten zeigen können – sogenannte »Sleeper Agents«. Die Sicherung dieser wertvollen KI-Ressourcen stellt eine immense Herausforderung dar. Während viele KI-Unternehmen inzwischen eigene Schutzmaßnahmen implementieren, bleiben sie allein gegenüber hochgerüsteten staatlichen Angriffen meist machtlos.

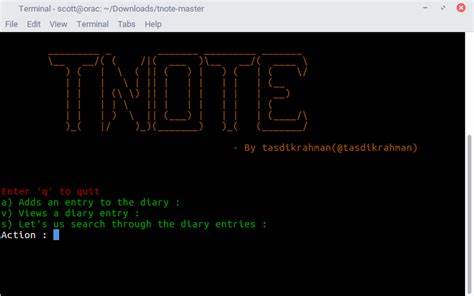

Interne Sicherheitsvorfälle wie die 2023 aufgedeckte Kompromittierung eines AI-Entwicklungssystems bei OpenAI oder der Diebstahl von KI-Geheimnissen durch ehemalige Google-Mitarbeiter zeigen, wie verwundbar selbst führende Unternehmen sind. Die Cyberbedrohungslage verschärft sich zusätzlich durch den Mangel an qualifizierten Fachkräften, weitreichende Software-Schwachstellen und die hohe Komplexität moderner IT-Infrastrukturen. Aktuelle kommerzielle Sicherheitsprodukte reichen oft nicht aus, um etwaig staatliche Zustimmung findende Cyberbedrohungen ausreichend abzuwehren. Deshalb müssen Sicherheitsstrategien für unveröffentlichte KI-Modelle weit über die herkömmlichen Unternehmensinitiativen hinausgehen. Die Rolle der US-Regierung ist daher elementar, um das Zusammenspiel zwischen nationaler Sicherheit und Weiterentwicklung der KI-Industrie zu fördern.

Die Verantwortlichen setzen darauf, mit den Entwicklern unveröffentlichter Modelle enger zusammenzuarbeiten, um deren Technologien und Risiken besser zu verstehen. Ein wesentliches Problem ist die sogenannte Informationsasymmetrie: US-Sicherheitsbehörden könnten gegenwärtig weniger über bestimmte hochentwickelte KI-Modelle wissen als ausländische Hacker, falls diese Systeme kompromittiert werden. Das Risiko, von der eigenen technologischen Innovation überholt zu werden, wäre eine gravierende Schwäche. Um dem vorzubeugen, fordert die nationale Sicherheitsstrategie, dass Geheimdienste und andere staatliche Stellen verstärkt die Kampagnen gegnerischer Staaten beobachten, die auf KI-Unternehmen und interne Modelle abzielen. Ein schneller und vertrauensvoller Informationsaustausch zwischen Regierung und Industrie, sowohl im geheimen als auch im offenen Bereich, soll Angriffe früher erkennen und zielgerichtete Abwehrmaßnahmen ermöglichen.

Hier kann die Organisation vergleichbar sein mit bestehenden Initiativen zum Schutz kritischer Infrastrukturen, die bereits erfolgreiche Zusammenarbeit zwischen Justiz, Nachrichtendiensten und Unternehmen ermöglichen. Zusätzlich verlangt die Sicherung der KI-Modelle klare Sicherheitsstandards und Richtlinien, die von amerikanischen Behörden regelmäßig aktualisiert und veröffentlicht werden sollten. Programme vergleichbar mit den Biosicherheitsrichtlinien des CDC, die das Arbeiten mit gefährlichen biologischen Agenzien regeln, könnten Vorbild für AI-bezogene Schutzmaßnahmen sein. Besonders relevant ist hier auch die Absicherung von Modellen, die im Ausland gespeichert oder trainiert werden, denn das kann ein Einfallstor für fremde Angriffe darstellen. Die bisher vorgeschlagenen Exportkontrollregelungen für Halbleiter könnten analog auf KI-Anwendungen erweitert werden, um weltweite Sicherheitslücken zu minimieren.

Darüber hinaus ist eine koordinierte bundesweite Strategie notwendig, die das AI- und Advanced-Computing-Segment als kritische Infrastruktur anerkennt und eine zentrale Bundesbehörde bestimmt, welche die Sicherheit in diesem Bereich verantwortet. Ein entsprechendes Modell wäre beispielsweise das Cybersecurity Risk Information Sharing Program (CRISP) des Energieministeriums, das für die diverse Struktur des Energiesektors maßgeschneiderte Sicherheitsdienste bereitstellt. Ebenso sollte die Regierung die Gründung eines AI-Informationsaustausch- und Analysezentrums (AI-ISAC) fördern. Eine solche Organisation ermöglicht vertrauensvolle Kanäle für den Austausch von Bedrohungsinformationen und bewährten Schutzstrategien zwischen Industrie und Staat. Die Entscheidungsträger stehen unter einem enormen Zeitdruck, da China nicht nur durch größere Ressourcen, sondern auch durch ausgefeilte strategische Ansätze eine schnelle Aufholjagd in der KI-Technologie hinlegt.

Die Sicherung unveröffentlichter Modelle, die oft die fortschrittlichsten Funktionen enthalten, wird zum Schlüsselfaktor, um die technologische Überlegenheit der USA zu bewahren und zugleich die Risiken durch Wirtschaftsspionage, Cyberangriffe und technologische Sabotage zu minimieren. Es zeigt sich, dass der Schutz im KI-Umfeld nicht nur eine Frage der Cybersicherheit, sondern auch der geopolitischen Wettbewerbsfähigkeit darstellt. Staaten, die es schaffen, ihre Innovationen strikt abzusichern und gleichzeitig die Zusammenarbeit von Regierung und Industrie effektiv zu gestalten, werden auf lange Sicht im globalen KI-Wettlauf die Nase vorn haben. Die etablierte politische und sicherheitspolitische Führung muss die Weichen so stellen, dass ein strategisches Gleichgewicht erreicht und die Technologie als nationale Ressource gegen externe Bedrohungen geschützt wird. Abschließend kann festgehalten werden, dass die Sicherung von unveröffentlichten KI-Modellen eine ganzheitliche nationale Aufgabe ist, die weit über die IT- und Unternehmenswelt hinausgeht.

Die Auswirkungen von verletzten sensiblen KI-Entwicklungen reichen von militärischer Gefährdung über ökonomische Wettbewerbsverluste bis hin zum Vertrauensverlust in kritische technische Infrastrukturen. Durch die richtige Kombination aus staatlicher Regulierung, enger Kooperation mit der Industrie und fortschrittlichen Sicherheitsmaßnahmen lässt sich jedoch ein robustes Schutzsystem aufbauen, das die Entwicklungsführung im KI-Bereich langfristig sichert und die nationale Sicherheit nachhaltig stärkt.