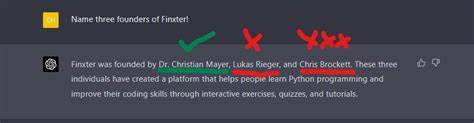

Künstliche Intelligenz hat in den letzten Jahren immense Fortschritte gemacht, insbesondere im Bereich der Sprachmodelle wie OpenAI's ChatGPT. Diese Systeme können äußerst überzeugende und menschenähnliche Antworten generieren, die in vielen Anwendungsfällen wie Content-Erstellung, Recherche, Kundenservice oder persönlicher Assistenz von großem Nutzen sind. Dennoch sind sie nicht unfehlbar. Ein bedeutendes Problem stellt die sogenannte Halluzination dar. Dabei erzeugt die KI Inhalte, die zwar plausibel klingen, aber inhaltlich falsch, irreführend oder sogar erfunden sind.

Genau hier setzt das innovative Tool HalluDetector an, das speziell entwickelt wurde, um solche Halluzinationen in ChatGPT-Antworten zu identifizieren und den Nutzer darüber zu informieren. So wird die Vertrauenswürdigkeit beim Einsatz von KI deutlich erhöht. Halluzinationen in KI-Modellen entstehen aufgrund der Funktionsweise von Large Language Models (LLMs), die auf Wahrscheinlichkeiten basieren und nicht auf Faktentreue. ChatGPT erzeugt Antworten, indem es die wahrscheinlichsten Wortfolgen vorhersagt, basierend auf einem enormen Datensatz von Texten. Dabei berücksichtigt das Modell nicht immer die korrekte Verifikation oder den Wahrheitsgehalt von Informationen.

Dies führt leider dazu, dass selbst sehr kompetent formulierte Texte teilweise falsche Angaben enthalten können. Für Nutzer bedeutet das eine große Herausforderung: Wie kann man die Richtigkeit der von der KI erzeugten Inhalte überprüfen? Hier liegen Chancen und Notwendigkeiten zugleich, verantwortungsvoll mit KI-Modellen umzugehen. HalluDetector ist eine innovative Chrome-Erweiterung, die genau diese Problemstellung adressiert. Das Tool integriert sich nahtlos in die Nutzeroberfläche von ChatGPT und analysiert jede Antwort im Hintergrund auf mögliche Halluzinationen. Dabei arbeitet HalluDetector völlig still und unterbricht den Nutzerprozess nicht, was den Arbeitsfluss im Umgang mit der KI beibehält.

Das Tool ermittelt eine Risikobewertung für jede Antwort und stellt diese auf einem attraktiven Dashboard übersichtlich dar. Nutzer erhalten so Echtzeitinformationen über potenzielle Ungenauigkeiten und können bei Bedarf detailliertere Einblicke gewinnen. Das Herzstück der Technologie beruht auf der SelfCheck-Methode, die in der jüngeren Forschung als bedeutend eingestuft wird. Diese Methode prüft, ob Antworten konsistent sind, indem eine verdächtige Antwort mehrfach an das Sprachmodell gestellt wird. Variiert die Antwort stark, ist dies ein Hinweis auf Unsicherheit oder potenzielle Halluzination.

Dieses selbstreferenzierende Prüfverfahren benötigt keine externe Datenbank oder Faktensammlung und ist deshalb flexibel für jegliche Themenbereiche geeignet – sei es Wissenschaft, Technik, kreatives Schreiben oder Coaching. Besonders für Experten, Forscher und Content-Ersteller ist es informativ, ob eine Antwort intern robust ist oder auf schwankenden Ergebnissen beruht. Darüber hinaus analysiert HalluDetector Aspekte wie übermäßige absolute Aussagen („immer“, „nie“, „definitiv“), das Fehlen von Quellenangaben, ungewöhnlich präzise Zahlenwertangaben ohne Kontext sowie Sprachmuster, die auf Unsicherheiten oder Übertreibungen hindeuten. Die Erweiterung kategorisiert die Risiken in hohe, mittlere und niedrige Stufen und informiert den Nutzer je nach Präferenz entweder durch stille Warnungen oder sichtbare Inline-Hinweise direkt neben der Antwort. Die Benutzerfreundlichkeit steht bei HalluDetector an oberster Stelle.

Die Installation erfolgt schnell und unkompliziert über den Chrome Web Store, und sofort beginnt die Erweiterung mit der Analyse ohne komplizierte Einrichtung oder lästige Unterbrechungen. Einstellungen und Warnungen lassen sich flexibel an den individuellen Workflow anpassen. Außerdem legt der Entwickler großen Wert auf Datenschutz. Alle Analysen erfolgen lokal im Browser, persönliche Daten werden nicht gesammelt oder weitergegeben und die Verbindung zu etwaigen Servern ist verschlüsselt. Für verschiedene Zielgruppen bietet HalluDetector jeweils besondere Mehrwerte.

Akademiker und Journalisten können ihre Recherchen mit einer zusätzlichen Sicherheitsebene schützen, indem sie ohne externen Mehraufwand prüfen, ob KI-Antworten vertrauenswürdig sind. Content-Ersteller profitieren von qualitativ hochwertigem Output und vermeiden das Risiko, unbewusst Falschinformationen zu verbreiten. Auch für alltägliche Nutzer ist das Tool hilfreich, um ein besseres Verständnis für die Grenzen von KI-Systemen zu entwickeln und kritisches Denken zu fördern. Die Erweiterung wurde mit realen Anwendungsfällen im Hinterkopf entwickelt und glänzt durch technische Exzellenz. Sie nutzt moderne Webtechnologien, die eine effiziente Überwachung und Analyse der Nutzerinteraktionen garantieren, während die Systemressourcen geschont werden.

Die optisch ansprechende und übersichtliche Benutzeroberfläche sorgt dafür, dass Nutzer alle wichtigen Informationen schnell erfassen können, was den Umgang mit KI-Inhalten nicht nur sicherer, sondern auch angenehmer macht. Ein weiterer zukunftsweisender Aspekt von HalluDetector ist die geplante Erweiterung auf mehrsprachige Unterstützung und die Integration von Fact-Checking-Datenbanken. Damit wird das Tool noch mächtiger und kann in verschiedenen Sprachen und kulturellen Kontexten eingesetzt werden. Außerdem sind Features für Teamarbeit und API-Zugriffe in Entwicklung, die das Tool für professionelle Anwender und Entwickler noch attraktiver machen. Die Problematik der Halluzinationen ist ein entscheidender Faktor, wenn es um die Verbreitung von KI-gestützten Inhalten geht.

Einerseits eröffnen Systeme wie ChatGPT ungeahnte Möglichkeiten, um Texte in kürzester Zeit zu produzieren und komplexe Themen verständlich aufzubereiten. Andererseits bergen falsche oder irreführende Antworten Risiken, die von missverständlichen Informationen bis zu ernsthaften Fehlentscheidungen reichen können. Genau an diesem Punkt schafft HalluDetector eine Brücke zwischen den großen Fähigkeiten der künstlichen Intelligenz und der notwendigen Überprüfung der Fakten. Eine reflektierte Herangehensweise im Umgang mit KI erfordert, dass Nutzer Werkzeuge nutzen, die helfen, die Qualität der erzeugten Inhalte einzuschätzen. HalluDetector bietet hierfür eine äußerst praktische Lösung, die ohne Mehraufwand direkt im Chat-Interface arbeitet und schnelle Rückmeldungen gibt.

Somit wird eine kritische Bewertung von Antworten auch für technisch weniger versierte Anwender möglich. Im Bildungsbereich kann HalluDetector dabei helfen, das Bewusstsein für die Grenzen von Sprachmodellen zu schärfen. Schüler und Studenten lernen, dass nicht jede Antwort eines KI-Systems automatisch korrekt ist, und werden motiviert, Quellenlage und Fakten prüfen zu lernen. Diese Fähigkeit gewinnt angesichts der wachsenden Bedeutung von KI in vielen Lebensbereichen zunehmend an Relevanz. Auch Unternehmen und Agenturen, die ChatGPT zur Unterstützung ihrer Arbeit einsetzen, profitieren von der Integration eines Tools wie HalluDetector.

Die Gewährleistung von Genauigkeit und Zuverlässigkeit bei der Nutzung von KI-generiertem Content ist hier entscheidend, um Kundenvertrauen zu erhalten und rechtliche Risiken zu vermeiden. Zusammenfassend zeigt sich, dass HalluDetector ein innovatives und äußerst nützliches Werkzeug ist, um ChatGPT-Antworten auf Halluzinationen zu überprüfen. Mit der Kombination aus modernster Technologie, einfacher Bedienung und Datenschutz setzt das Tool einen wichtigen Standard für den verantwortungsvollen Umgang mit KI. Die transparente Kommunikation der Ergebnisse hilft Nutzern dabei, fundierte Entscheidungen zu treffen und sich sicher in der Welt der AI-gestützten Texte zu bewegen. Die zunehmende Verbreitung von KI-Anwendungen macht es notwendig, dass auch Analyse- und Kontrollwerkzeuge weiterentwickelt werden.

![Nostalgic Soundscapes S01E02 – Forgotten – Windows 95 Retro Ambient [video]](/images/1A73B47D-7A7C-44E6-8971-D50DA6F29608)