In den letzten Monaten kursierten weltweit Berichte über das angebliche Versagen von Builder.ai, einem aufstrebenden KI-Startup, das angeblich eine künstliche Intelligenz vortäuschte, indem es 700 Ingenieure beschäftigte, die angeblich als „versteckte KI“ fungierten. Solche Schlagzeilen erregten viel Aufmerksamkeit in Medien und sozialen Netzwerken, was das Bild eines krassen Täuschungsmanövers vermittelte. Doch die Realität ist deutlich komplexer und viel differenzierter. Es ist eine Geschichte von Innovation, Missverständnissen und der Herausforderung, die Wahrheit in der schnelllebigen Tech-Welt zu erkennen.

Builder.ai war keineswegs ein KI-Fake-Projekt, sondern ein Unternehmen, das ernsthaft an der Entwicklung fortschrittlicher automatisierter Softwarelösungen arbeitete – unterstützt von modernen großen Sprachmodellen (LLMs) wie GPT und Claude. Die falsche Behauptung entpuppte sich vielmehr als eine Fehlinterpretation der Unternehmensstruktur und der Art seiner Arbeitsweise. Die Idee hinter Builder.ai war von Beginn an ambitioniert: Eine Plattform zu schaffen, die Softwareentwicklung mithilfe künstlicher Intelligenz vereinfachen und beschleunigen kann.

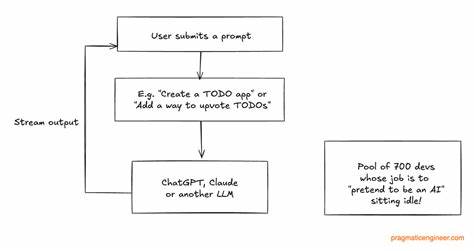

Das Produkt Natasha, auf das sich viele der Diskussionen beziehen, war als „persönlicher App-Builder“ gedacht. Nutzer konnten ihre Ideen eingeben, und Natasha unterstützte den Entwicklungsprozess durch Automatisierungsschritte – unter anderem durch Nutzung fortgeschrittener KI-Modelle, um beispielsweise Code zu generieren und zu testen. Dabei kam keine Illusion menschlicher Entwickler als KI zum Einsatz. Stattdessen koordinierte eine technische Orchestrierung die Arbeit verschiedener KI-Komponenten und Tools, was die Arbeit der meist 15 bis 30 Entwickler an der Plattform ergänzte. Ein weit verbreitetes Missverständnis basiert auf der Größe des Entwicklernetzwerks bei Builder.

ai. Die Zahl von 700 Entwicklern, die angeblich „versteckt“ hinter der KI arbeiteten, stammt aus der Anzahl von ausgelagerten Softwareingenieuren, die für das Unternehmen über Partnerfirmen weltweit tätig waren. Diese Entwickler befanden sich nicht in einem betrügerischen System, sondern trugen im Rahmen einer externen Entwicklungsstruktur zum Softwareerstellungsprozess bei. Darüber hinaus beschäftigte Builder.ai mehrere hundert interne Ingenieure, die insbesondere an eigenen Tools wie Builder Home, Builder Chat oder Builder Tracker arbeiteten, um den Entwicklungsprozess zu optimieren.

Ein zentraler Punkt für das Scheitern von Builder.ai war weniger die Technologie oder das KI-System an sich, sondern mehr eine strategische Fehlentscheidung. Das Unternehmen investierte massiv in den Aufbau zahlreicher interner Tools, deren Funktionen bereits durch etablierte Produkte wie Slack, Zoom oder JIRA abgedeckt waren. Diese parallelen Entwicklungen banden Ressourcen und führten zu einer Verzettelung, anstatt den Fokus klar auf die KI-Lösungen und die Verbesserung von Natasha zu legen. Zudem liefen nachträgliche Untersuchungen bezüglich finanzieller Praktiken, die in einem ehrlichen Arbeitsumfeld der Entwickler nichts zu suchen hatten, was letztlich das endgültige Scheitern des Unternehmens besiegelte.

Die Technik hinter Natasha zeigt, wie das Startup künstliche Intelligenz anwandte. Die Software nutzte Python, Ruby on Rails und React als technologische Basis, um orchestrierte Prozesse zu steuern, bei denen große Sprachmodelle in die Softwareentwicklung integriert wurden. Indem die KI zunächst Testfälle generierte, dann Code unter Einhaltung dieser Tests erzeugte und nur Änderungen vorschlug, wenn alle Tests bestanden wurden, orientierte sich Natasha an bewährten Entwicklungsprinzipien wie der testgetriebenen Entwicklung (Test Driven Development, TDD). Dies verbesserte nicht nur die Qualität des Codes, sondern erhöhte auch die Zuverlässigkeit der automatisierten Abläufe. Ein weiterer technologischer Aspekt war eine interne Überwachungs- und Betrugserkennungseinheit, die ungewöhnliche Abweichungen bei der Nutzung der Builder IDE dokumentierte.

Gerade bei der Zusammenarbeit mit Hunderten von ausgelagerten Entwicklern traten Herausforderungen hinsichtlich der Verlässlichkeit von Arbeitszeitangaben auf. Diese Probleme führten zu einem längeren „Katz-und-Maus“-Spiel, das Ressourcen band und den Fokus zusätzlich belastete. Die Ursprünge des Gerüchts über die „700 Ingenieure, die eine KI vortäuschen“, lassen sich auf eine einzelne falsche Social-Media-Quelle zurückführen, die ohne valide Beweise publiziert wurde. Dieses Narrativ wurde dann von weiteren Medien und Influencern aufgegriffen und verbreitet, was die eigentliche Komplexität der Situation und die tatsächlichen technologischen Errungenschaften von Builder.ai übersah.

Es ist ein exemplarisches Beispiel für die Risiken, die entstehen, wenn technische Themen vereinfacht und reißerisch dargestellt werden – oft zum Nachteil der tatsächlichen Beteiligten. Builder.ai zeigt damit auch auf, wie schwierig es für junge Technologieunternehmen ist, in einem überhitzten Markt mit enormen Erwartungen zu bestehen. Der Druck, schnell zu wachsen, Best Practices zu implementieren und gleichzeitig auch von Investoren kritisch betrachtet zu werden, ist hoch. Selbst mit modernster KI-Technologie und einem motivierten Team können strategische Fehler und operationelle Hürden zum Scheitern führen.

Darüber hinaus spricht die Geschichte von Builder.ai für die Wichtigkeit einer kritischen Informationsprüfung. Gerade im Bereich der künstlichen Intelligenz und Startups kommt es häufig vor, dass Missinformationen viral gehen – zum Teil durch ungenaue Berichterstattung, aber auch durch bewusste Falschmeldungen. Die Berichte rund um Builder.ai mahnen also zur Vorsicht bei der Wahrnehmung von Mediendebatten und heben hervor, wie essenziell es ist, direkt mit Insidern und Experten zu sprechen.

Der Blick auf die damaligen Mitarbeiter zeigt eine engagierte Entwicklergemeinschaft, die mit echten Innovationen an der Zukunft der Softwareentwicklung arbeiteten und wertvolle Erfahrungen mit KI-Anwendungen sammelten. Für viele der ehemaligen Angestellten bedeutete der Niedergang von Builder.ai eine persönliche und berufliche Herausforderung, nicht zuletzt wegen der belastenden Gerüchte um den angeblichen Betrug. Ihre Arbeit war legitim, technologische Erfolge lagen vor, und das Unternehmen verfügte über einen realen Produktansatz mit KI-Technologie. Die Builder.

ai-Geschichte ist ein Lehrstück darüber, wie technische Innovationen zutiefst mit strategischem Management, verlässlicher Unternehmensführung und transparenter Kommunikation verknüpft sind. Sie zeigt auf, dass selbst gut konzipierte KI-Projekte nicht automatisch den Markterfolg garantieren. Und sie unterstreicht, dass Vertrauen und Glaubwürdigkeit in der Tech-Branche genauso wichtig sind wie Innovationen. Abschließend bleibt festzuhalten, dass Builder.ai kein Unternehmen war, das „KI vorgaukelte“ oder eine Schar versteckter Entwickler als vermeintliche künstliche Intelligenz einsetzte.

Vielmehr war es ein ambitioniertes Startup mit echten KI-Anwendungen, das an internen Herausforderungen, externem Druck und dem schwierigen Markt der Softwareentwicklung scheiterte. Dieses Missverständnis sollte als wichtige Erinnerung dienen, wie differenziert und komplex die Welt der künstlichen Intelligenz und ihrer Anwendungen wirklich ist.