In der Welt des maschinellen Lernens spielt die Kalibrierung von Modellen eine zentrale Rolle, um zuverlässige Wahrscheinlichkeitsaussagen sicherzustellen. Besonders bei Klassifikationsaufgaben ist es wichtig, nicht nur korrekte Vorhersagen zu treffen, sondern auch deren Unsicherheiten realistisch abzubilden. Hier setzt das neue Python-Paket Calibre an, das bereits über 3000 Mal heruntergeladen wurde und mit einem innovativen Ansatz traditionelle Kalibrierungsmethoden modernisiert und deutlich erweitert. Die Kalibrierung von Vorhersagemodellen dient dem Zweck, die prognostizierten Wahrscheinlichkeiten mit den tatsächlich beobachteten Häufigkeiten in Einklang zu bringen. Klassisch kommt heutzutage häufig die isotonic regression zum Einsatz, die monotone Kalibrierungsfunktionen erzeugt.

Diese Vorgehensweise besitzt allerdings erhebliche Einschränkungen, die in der Praxis die Aussagekraft und Nutzbarkeit der kalibrierten Ergebnisse beeinträchtigen können. Ein wesentliches Problem der klassischen isotonic regression ist der Verlust von Granularität. Viele verschiedene Ausgangswahrscheinlichkeiten werden durch die monotone Anpassung auf wenige Diskrete Werte zusammengeführt. Dadurch verlieren Modelle wichtige Differenzierungen, die vor allem für fein abgestufte Entscheidungen notwendig sind. Außerdem erzwingt die klassische Methode eine strikte Monotonie der Kalibrierungsfunktion, was in manchen Fällen zu einer Überanpassung führt und kleine, aber wichtige Abweichungen nicht erlaubt.

Hier wäre ein gewisses Maß an Flexibilität wünschenswert, um die Informationsdichte der Vorhersagen besser zu bewahren. Calibre adressiert genau diese Schwächen durch innovative Algorithmen, die sowohl die Granularität als auch die nötige Flexibilität der Kalibrierungsfunktion bewahren. Mit seinen fortschrittlichen Modellen ermöglicht das Paket eine deutlich nuanciertere Anpassung von Modellergebnissen und stellt damit ideale Werkzeuge für Entwickler und Datenwissenschaftler im Bereich Machine Learning bereit. Das Paket implementiert eine Reihe unterschiedlicher Methoden, wobei der Ansatz der nearly-isotonic regression eine zentrale Rolle spielt. Diese erlaubt gezielte und kontrollierte Abweichungen von der Monotonie, sodass kleinere Verletzungen toleriert werden, wenn dadurch eine bessere Detailtreue in den kalibrierten Wahrscheinlichkeiten erzielt wird.

Die resultierenden Kalibrierungsfunktionen sind somit weniger starr und erfassen die zugrundeliegenden Datenverteilungen differenzierter, was die Aussagekraft der Vorhersagen erhöht. Darüber hinaus bietet Calibre modernste Spline-basierte Kalibrierungsmethoden an, beispielsweise mittels I-Splines. Dabei werden monotone Splines verwendet, die eine glatte und gleichzeitig monoton steigende Kalibrierungsfunktion erzeugen. Diese glatten Anpassungen sind besonders vorteilhaft, wenn die Kalibrierung visualisiert oder interpretiert werden soll, da diese nicht wie herkömmliche Stufenfunktionen abrupt wechseln, sondern kontinuierliche Verläufe zeigen. Eine weitere bemerkenswerte Innovation stellt das Konzept des relaxed PAVA dar.

Dabei wird die klassische Pool-Adjacent-Violators-Algorithmus-Methode so erweitert, dass kleine Verletzungen der Monotonie ignoriert werden können, gemessen anhand von Perzentil-Schwellenwerten. Diese pragmatische Lösung erlaubt eine effizientere Kalibrierung, die pragmatisch zwischen Strenge und Flexibilität ausbalanciert und dadurch feinere Unterschiede in den Vorhersagen bewahrt. Zur weiteren Verbesserung der Glätte und Praxisnähe der Kalibrierung implementiert Calibre regulierte Varianten der isotonic regression. Durch das Hinzufügen von L2-Regularisierung wird die Kalibrierungsfunktion sanfter und weniger anfällig für Überanpassungen, gleichzeitig bleibt die Monotonie erhalten. Dies führt zu verlässlicheren und besser generalisierenden Kalibrierungsergebnissen.

Zusätzlich bietet das Paket Methoden an, die lokale Glättungsverfahren wie den Savitzky-Golay-Filter auf die kalibrierten Funktionen anwenden. Diese reduzieren das sogenannte Treppen-Stufen-Effekt, das typischerweise bei isotonic regression auftritt. Auch adaptive Glättungsmethoden, die Fenstergrößen je nach Datendichte variieren, sind enthalten. Diese passen die Glätte vor allem in dichteren Datenbereichen feinfühliger an, während sie in sparsamen Regionen eine bessere Stabilität der Kalibrierung gewährleisten. Die Benutzerfreundlichkeit des Pakets wird durch eine umfassende Dokumentation und Beispiele illustriert.

So können Anwender mit wenigen Zeilen Code verschiedene Kalibrierungsverfahren ausprobieren und an ihre Anforderungen anpassen. Besonders hervorzuheben sind die bereitgestellten Funktionen zur Evaluierung der Kalibrierungsqualität. So können beispielsweise mittlere Kalibrierungsfehler oder kalibrierte Fehler in Bins berechnet werden, um objektive quantitative Aussagen über die Güte der Kalibrierung zu treffen. Darüber hinaus erlaubt Calibre die Analyse von Korrelationen zwischen kalibrierten und Originalvorhersagen sowie den tatsächlich beobachteten Zielwerten. Dies ist besonders wichtig, um die Bewahrung der Modell-Informationen trotz Kalibrierung zu überprüfen.

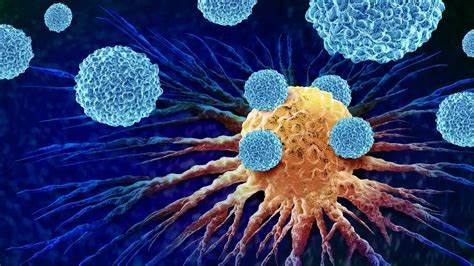

Mittels spezieller Metriken kann auch die Erhaltung der Granularität der Vorhersagen geprüft werden, also wie viele unterschiedliche Werte trotz Kalibrierung erhalten bleiben. Insbesondere die Beibehaltung der Granularität ist ein Alleinstellungsmerkmal, das Calibre von klassischen Kalibrierungsansätzen unterscheidet. Die Anwendungsmöglichkeiten des Pakets erstrecken sich von Klassifikationsproblemen im Gesundheitswesen, über Prognosen im Finanzsektor, bis hin zu komplexen Risikomodellen in Industrieanwendungen. In all diesen Bereichen ist eine exakte Kalibrierung der Vorhersagewahrscheinlichkeiten essenziell, um fundierte Entscheidungen zu treffen. Mit mehreren innovativen Ansätzen und einer durchdachten API bietet Calibre somit eine moderne und vielseitige Lösung für das Kalibrierungsproblem – ein Baustein, der zu einer qualitativ hochwertigeren Praxis maschinellen Lernens beiträgt.

Wer tiefer in die Thematik einsteigen möchte, findet im Paket umfangreiche Referenzen zu wissenschaftlichen Arbeiten, die die Methoden anleiten und theoretisch untermauern. Das Paket steht unter der MIT-Lizenz und ist somit frei verfügbar, um in unterschiedlichsten Projekten eingesetzt und erweitert zu werden. Die aktive Entwickler-Community freut sich über Beiträge und Rückmeldungen, sodass Calibre künftig weiter wachsen und sich den Bedürfnissen der Nutzer anpassen kann. Abschließend lässt sich sagen, dass Calibre als neues Werkzeug im Python-Ökosystem die Kalibrierung von Modellen auf ein neues Niveau hebt. Durch die gezielte Berücksichtigung von Granularität, Flexibilität und Glätte beseitigt es viele der bisherigen Schwachstellen klassischer Ansätze.