Die digitale Welt entwickelt sich stetig weiter, und mit ihr auch die Art und Weise, wie Menschen mit komplexen Daten und Visualisierungen interagieren. Die Steuerung von 3D-Grafiken durch Sprach- und Handgesten markiert einen bedeutenden Meilenstein in der menschlichen Computerinteraktion. Diese innovative Methode ermöglicht es Nutzern, komplexe Graphen intuitiv und effizient zu manipulieren, ohne auf traditionelle Eingabegeräte wie Maus oder Tastatur angewiesen zu sein. Im Zentrum dieser Entwicklung stehen fortschrittliche Technologien, die zusammen eine nahtlose und natürliche Bedienung sicherstellen. Zu den Schlüsselkomponenten gehören die Nutzung von Speech Recognition zur Erkennung von Sprachbefehlen und Handgestenerkennungssysteme, die Bewegungen präzise erfassen und interpretieren.

Mit großer Wahrscheinlichkeit wird die Kombination dieser Systeme in den kommenden Jahren die Art und Weise verändern, wie professionelle Anwender, Forschende und auch Hobbyisten 3D-Daten analysieren und entdecken. Eine der bemerkenswertesten Anwendungen dieser Technologie ist die Steuerung von 3D-Graphen, wie beispielsweise Netzwerkdiagrammen oder komplexen Datenvisualisierungen. Anstatt traditionelle Eingabemethoden zu verwenden, können Nutzer per Sprachsteuerung zwischen verschiedenen Interaktionsmodi wie Draggen, Rotieren und Zoomen wechseln. Dies wird durch handgeführte Gesten ergänzt, mit denen einzelne Knoten in den Graphen bewegt und neu angeordnet werden können. Diese Kombination führt zu einer erheblichen Effizienzsteigerung und eröffnet neue Möglichkeiten der Zusammenarbeit in Echtzeit, da mehrere Nutzer simultan Befehle geben und Graphen flexibel gestalten können.

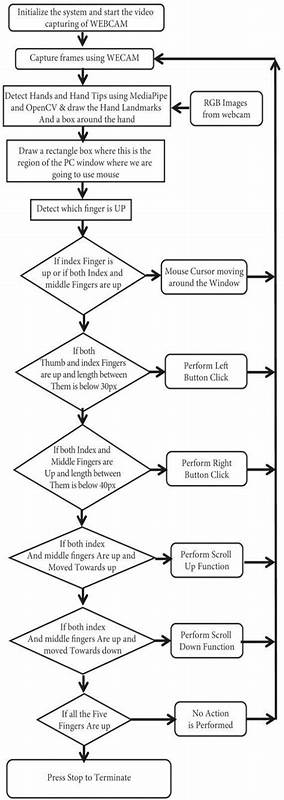

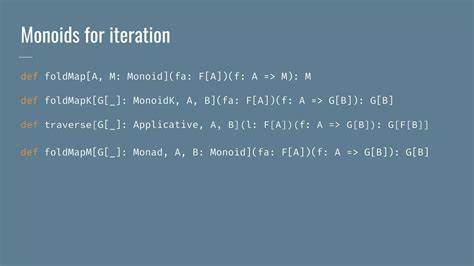

Die zugrundeliegenden Technologien basieren auf leistungsstarken Javascript-Bibliotheken und modernen Frameworks, insbesondere Three.js, das für die 3D-Visualisierung im Web unverzichtbar ist. Ebenfalls wichtig sind Computer-Vision-Tools wie Mediapipe, die von Google entwickelt wurden und Gestenerkennung mit hoher Genauigkeit erlauben. Die Spracherkennung wird über die Web Speech API realisiert, mit der Webanwendungen natürliche Sprachkommandos in Echtzeit verarbeiten können. Ergänzt wird das System durch Vasco Asturianos 3D-Force-Graph-Bibliothek, die die Darstellung und Dynamik komplexer Netzwerkstrukturen ermöglicht.

Die technische Umsetzung dieser Steuerungslösung ist ein gelungenes Beispiel für interdisziplinäre Zusammenarbeit zwischen den Bereichen künstliche Intelligenz, Computer Vision und Webentwicklung. Besonders faszinierend ist die Art und Weise, wie Sprach- und Gestensteuerung harmonisch integriert werden, um jeden Aspekt der 3D-Grafikinteraktion abzudecken. Die Möglichkeit, frei zwischen verschiedenen Bedienmodi zu wechseln, erleichtert die Navigation in großen und komplexen Datenstrukturen enorm und macht die Handhabung für den Anwender deutlich intuitiver. Neben den technischen Vorteilen bringt diese Form der Interaktion auch bedeutende ergonomische Verbesserungen mit sich. Die Abkehr von konventionellen Eingabegeräten kann Belastungen für Hände und Arme reduzieren und die Nutzererfahrung insgesamt angenehmer gestalten.

Insbesondere in professionellen Umgebungen, in denen lange Arbeitszeiten mit intensiver Datenanalyse verbunden sind, stellt dies einen nicht zu unterschätzenden Vorteil dar. Darüber hinaus ist die Integration von Sprach- und Gestensteuerung auch aus barrierefreien Gesichtspunkten interessant. Personen mit Bewegungseinschränkungen oder anderen körperlichen Beeinträchtigungen können so einfacher und selbstbestimmter mit komplexen 3D-Daten arbeiten. Die Technologie öffnet somit neue Türen für eine inklusive Gestaltung digitaler Werkzeuge. Die Anwendungsmöglichkeiten von 3D-Graphensteuerungen via Sprache und Handgesten sind vielfältig.

In der Forschung etwa erleichtert die intuitive Bedienung die Exploration wissenschaftlicher Netzwerke und Zusammenhänge. In der Datenanalyse können komplexe Beziehungen leichter dargestellt und interpretiert werden. Auch im Bildungsbereich lassen sich durch diese innovative Steuerungsmethode interaktive Lernumgebungen schaffen, die Schülerinnen und Schülern ein tieferes Verständnis ermöglichen. Unternehmen profitieren ebenfalls vom Einsatz dieser Technologie, indem sie Entscheidungsprozesse durch ansprechende Visualisierungen und einfache Bedienung beschleunigen können. Die Entwicklung solcher Schnittstellen steht noch am Anfang, doch der Trend zeigt deutlich in Richtung natürlicher, multimodaler Interaktionen.

Mit steigender Rechenleistung, besseren Sensoren und fortschrittlicherer Künstlicher Intelligenz wird die Präzision und Zuverlässigkeit von Sprach- und Gestenerkennung weiter zunehmen. Dies ermöglicht künftig noch komplexere und immersivere 3D-Umgebungen, die per Hand und Stimme kontrolliert werden können. Für Entwickler ergibt sich daraus eine spannende Herausforderung: Intuitive Benutzeroberflächen zu schaffen, die eine mühelose Interaktion ermöglichen und gleichzeitig robust gegenüber Fehlern und Störungen sind. Die Auswahl der richtigen Erkennungsmethoden, die Optimierung der Reaktionszeiten und die Berücksichtigung der Nutzerfreundlichkeit sind entscheidende Faktoren für den Erfolg solcher Systeme. Ebenso spielt der Datenschutz eine zentrale Rolle, da Sprachdaten und Bewegungsinformationen sensibel sind und eine vertrauenswürdige Verarbeitung erfordern.

Zusammenfassend lässt sich sagen, dass die Steuerung von 3D-Grafiken mittels Hand- und Sprachbefehlen eine vielversprechende Zukunft hat. Sie bietet neue Wege, komplexe Daten dynamisch und interaktiv zu gestalten sowie intuitiv zu erleben. Die Fortschritte in der Technologie eröffnen Anwendern nicht nur mehr Flexibilität und Komfort, sondern fördern auch die Kreativität und Zusammenarbeit in verschiedensten Anwendungsbereichen. Wer sich mit der Zukunft digitaler Interaktion beschäftigt, sollte die Entwicklung dieser Steuerungsmethoden genau im Auge behalten, denn sie stehen exemplarisch für den Wandel hin zu natürlicheren, menschlicheren Schnittstellen in der digitalen Welt.