Die menschliche Sprache ist eines der faszinierendsten und komplexesten Kommunikationssysteme der Welt. Seit Jahrhunderten versuchen Wissenschaftler, das Phänomen Sprache nicht nur zu verstehen, sondern auch künstlich nachzubilden. Dabei spielt die Sprachsynthese eine zentrale Rolle – die Möglichkeit, mittels Computern künstliche Sprache zu erzeugen. Eine besonders vielversprechende Methode stellt die artikulatorische Sprachsynthese dar, bei der die tatsächlichen Bewegungen und Mechanismen des menschlichen Vokaltraktes simuliert werden. Hier setzt VocalTractLab an, ein innovatives Forschungswerkzeug, das die Tür zu einer qualitativ hochwertigen und naturgetreuen Sprachsynthese öffnet.

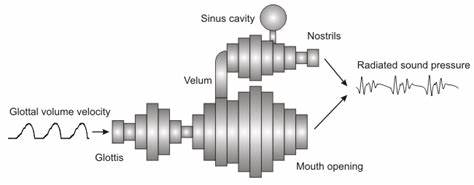

VocalTractLab wurde von Peter Birkholz entwickelt und hat sich seither als eines der führenden Programme im Bereich der artikulatorischen Sprachsynthese etabliert. Anders als klassische Text-to-Speech-Systeme, die vor allem akustische Modelle verwenden, basiert VocalTractLab auf einer realistischen Modellierung der anatomischen Gegebenheiten des menschlichen Vokaltraktes. Resultierend daraus ermöglicht die Software eine deutlich präzisere Nachbildung der Artikulation und somit eine authentischere Sprachausgabe. Die Synthese berücksichtigt Bewegungen von Lippen, Zunge, Kiefer, Gaumen und Kehlkopf – und bildet den Sprachprozess von der Artikulation bis zur Schallerzeugung ab. Ein großer Vorteil von VocalTractLab liegt in der Möglichkeit, die komplexen Vorgänge der Sprachproduktion visuell darzustellen.

Nutzer können die dynamischen Bewegungen des Vokaltraktes in 3D ansehen, die Formveränderungen nachvollziehen und verstehen, wie spezifische Laute entstehen. Dies macht VocalTractLab nicht nur zu einem hoch leistungsfähigen Synthesewerkzeug, sondern auch zu einem unverzichtbaren Hilfsmittel für die Forschung und Lehre an Universitäten und in der Sprachtherapie. Neben der Articulatory Speech Synthesis umfasst das VocalTractLab-Ökosystem weitere nützliche Tools wie Image3D, einen Scanner für volumetrische Magnetresonanztomographie (MRT)-Daten, womit präzise 3D-Modelle des Vokaltraktes generiert werden können. Die Einbindung solcher realer anatomischer Daten erlaubt es, individuelle Vokaltraktsimulationen zu erzeugen und die Synthese noch realistischer zu gestalten. Zur Erforschung der Stimmfunktion und insbesondere der Glottis steht GlottalImageExplorer zur Verfügung, ein Open-Source-Werkzeug, mit dem hochauflösende Endoskopiefilme analysiert und die Stimmritze segmentiert werden können.

Diese detaillierten Einsichten in die Kehlkopfmechanik sind essentiell, um die physiologischen Grundlagen der Sprachproduktion noch besser zu erfassen und in Synthesesysteme einzubinden. Ein weiteres Softwaremodul, TargetOptimizer, unterstützt die Analyse von Tonhöhenverläufen, indem es Tonhöhenschwankungen aus Sprachaufnahmen extrahiert und optimiert. Dies ist besonders relevant für die Synthese von natürlicher Prosodie und Intonation – zwei der wichtigsten Faktoren, um künstliche Sprache lebendig und verständlich klingen zu lassen. Mit MeasureTransferFunction steht zudem eine Anwendung zur Verfügung, die akustische Übertragungsfunktionen misst. Durch die Nutzung von Sine-Sweeps können hierbei genaue akustische Eigenschaften von Kanälen (z.

B. Vokaltrakt oder Aufnahmeräume) erfasst und in der Synthese verwendet werden. Diese exakten Messungen tragen maßgeblich zur Verbesserung der Klangqualität bei. Ein weiterer bedeutender Bestandteil ist das Dresden Vocal Tract Dataset, ein umfassender Datensatz, der detaillierte geometrische und aeroakustische Messungen des Vokaltraktes für 22 deutsche Sprachlaute enthält, jeweils von einem männlichen und einem weiblichen Sprecher. Diese Daten sind eine wertvolle Ressource für Grundlagenforschung und Entwicklungsprojekte im Bereich der Sprachsynthese.

Die Bedeutung von VocalTractLab für die Zukunft der Sprachsynthese ist kaum zu überschätzen. Während klassische Synthesemethoden oft unter unnatürlichen Klangqualitäten oder fehlender Flexibilität litten, eröffnet die artikulatorische Synthese die Möglichkeit, Sprachlaute auf einer fundamentalen Ebene zu verstehen und nachzubilden. Dies führt zu einer Spracherzeugung, die nicht nur natürlich klingt, sondern auch in der Lage ist, die Vielfalt und Nuancen menschlicher Sprache flexibel abzubilden. Darüber hinaus unterstützt VocalTractLab die Erforschung sprachlicher Phänomene wie Akzentuierung, Dialektunterschiede oder Sprechstörungen. Psycholinguisten, Phonetiker und Sprachtherapeuten profitieren von den perfekt visualisierbaren Ergebnissen und können auf dieser Basis neue Therapieansätze oder Unterrichtsmaterialien entwickeln.

Die Anwenderfreundlichkeit des Programms ist dabei bemerkenswert. Trotz der komplexen Natur der Artikulation ist die Bedienung intuitiv gestaltet, so dass auch Personen ohne umfassende Vorkenntnisse in der Computermodellierung oder Phonetik schnell zu guten Ergebnissen kommen können. Dies fördert die Verbreitung des Wissens und die Nutzung der Technologien über die Grenzen der Forschung hinaus. In der technischen Weiterentwicklung bleibt VocalTractLab ständig am Puls der Zeit. Regelmäßige Updates sorgen für Erweiterungen der Modellparameter, Integration neuer Datensätze und Verfeinerung der Simulationen.