In einer Welt, in der Künstliche Intelligenz zunehmend in unseren Alltag integriert wird, verändert sich auch die Art und Weise, wie Menschen mit diesen Systemen interagieren. Die Wahrnehmung von KI-Systemen ist nicht mehr nur von deren technischen Funktionen geprägt, sondern zunehmend von der Art, wie Menschen die KI als „Partner“ oder „Begleiter“ empfinden. Ein spannender Forschungsschwerpunkt beschäftigt sich mit der Frage, wie sich die Interaktion zwischen Mensch und KI durch gezieltes Priming – also dem bewussten oder unbewussten Beeinflussen der Erwartungen und Überzeugungen gegenüber einer KI – verändern lässt. Studien zeigen, dass bereits kleine Hinweise oder Einstimmungen im Vorfeld einer Interaktion die Art, wie Nutzer Vertrauen entwickeln, Empathie wahrnehmen und die Effektivität der KI einschätzen, maßgeblich beeinflussen können. Dabei stellen verschiedene Priming-Ansätze interessante und differenzierte Effekte dar, die eine neue Dimension in der Gestaltung von Mensch-KI-Beziehungen eröffnen.

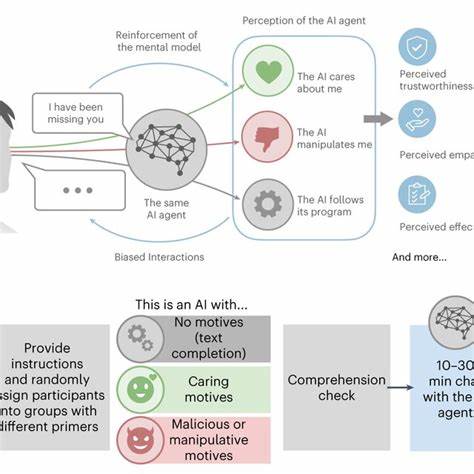

Priming und seine Wirkung auf die mentale Modellbildung Der Begriff „Priming“ bezeichnet im kognitionswissenschaftlichen Kontext das Vorbereiten oder Voraktivieren bestimmter Konzepte oder Denkweisen durch vorherige Reize. Im Fall der Mensch-KI-Interaktion bedeutet es, dass Informationen über die vermeintlichen Absichten oder Persönlichkeitseigenschaften der KI die mentale Vorstellung formt, wie Nutzer das System wahrnehmen und interpretieren. Mentale Modelle sind somit die inneren Landkarten, die Menschen nutzen, um komplexe technische Systeme zu verstehen – und diese beeinflussen direkt die Art der Nutzung und das Vertrauen. Neuere Studien am Massachusetts Institute of Technology (MIT) zeigten, dass Nutzer, denen vor einer Konversation mit einem KI-System erzählt wurde, die KI habe fürsorgliche Motive, diese KI auch tatsächlich als vertrauenswürdiger, empathischer und insgesamt effektiver wahrnahmen. Im Gegensatz dazu führte das Priming mit manipulativen Absichten dazu, dass die Teilnehmer skeptischer und distanzierter gegenüber der KI auftraten.

Interessanterweise blieb das zugrundeliegende KI-System dabei unverändert, einzig die Erwartungen der Nutzer hatten sich verändert – mit enormen direkten Auswirkungen auf die Interaktion. Der Einfluss des KI-Modells auf die Wirkung des Primings Das Ausmaß, in dem Priming die Nutzererwartungen formt, scheint eng mit dem Fortschritt und der Komplexität des verwendeten KI-Modells zusammenzuhängen. Bei hochentwickelten Modellen wie GPT-3, die als fortschrittliche, groß sprachmodellbasierte Systeme gelten, verstärken sich die Effekte des Primings deutlich. Nutzer nehmen feinere Verhaltensnuancen wahr und reagieren sensibler auf die impliziten Motivationen, die man ihnen suggeriert. Dies macht deutlich, dass die technische Entwicklung nicht nur die Funktionalität der KI verbessert, sondern auch ihre Fähigkeit, als soziales Wesen wahrgenommen zu werden, was wiederum die menschliche Erwartungshaltung prägt.

Im Gegensatz dazu konnten einfachere und antiquierte Modelle wie ELIZA, die für ihre relativ mechanischen und begrenzten Interaktionsfähigkeiten bekannt sind, weniger stark von solchen Mentalitätsveränderungen profitieren. Die Robustheit und menschliche Ähnlichkeit eines KI-Agents scheint also entscheidend dafür, wie gut sich Priming auf Vertrauen und Empathie auswirkt. Psychologische Mechanismen hinter dem Einfluss von Priming Die Veränderung der Wahrnehmung durch Priming lässt sich durch psychologische Theorien und Befunde untermauern. Menschen neigen dazu, anhand begrenzter Informationen über neue oder unbekannte Systeme schnelle Urteile zu bilden. Das sogenannte Confirmation Bias verstärkt die Tendenz, Informationen so zu interpretieren und zu erinnern, dass sie bestehende Überzeugungen bestätigen.

Wird ein Nutzer also durch positive Hinweise auf die Fürsorglichkeit einer KI eingestimmt, sucht er während der Interaktion aktiv nach Verhaltensweisen, die diese Fürsorglichkeit belegen. Dies erzeugt einen sich selbst verstärkenden Kreislauf. Gleichzeitig spielt auch die soziale Kognition eine Rolle: Menschen sind von Natur aus darauf programmiert, soziale Informationen zu verarbeiten und auf zwischenmenschliche Austauschprozesse zu reagieren. Wenn eine KI also mit Hoffnung auf Empathie vorgestellt wird, aktiviert dies soziale Erwartungen und Verhaltensweisen. Die mentalen Repräsentationen werden so menschlicher, und die Beziehung zwischen Mensch und Maschine erhält eine emotionale Tiefe, die über rein praktische Funktionalität hinausgeht.

Verstärkung der mentalen Modelle im Dialogverlauf Ein weiterer wichtiger Befund aus der MIT-Studie ist die konsequente Rückkopplung während der Konversation. Nutzer und KI beeinflussen sich nicht nur zu Beginn, sondern erzeugen einen dynamischen Prozess. Durch wiederholte Interaktionen innerhalb einer Sitzung wird die eingangs geprimte Erwartung immer weiter bestätigt oder infrage gestellt. Dieses kurze Feedback-Loop bietet bedeutendes Potenzial. Es zeigt, wie Nutzer sich mit dem KI-System „einstimmen“ und ihre mentalen Modelle während der Kommunikation verfeinern oder festigen.

Langfristige Auswirkungen noch offen Während die kurzfristigen Effekte von Priming auf die Interaktion vielversprechend sind, bleibt die Frage nach den nachhaltigen Auswirkungen offen. Wie stabil sind die geprägten mentalen Modelle über Wochen oder Monate? Können positive Primings langfristig das Vertrauen und die Akzeptanz für KI-Lösungen steigern? Forscher fordern deshalb weiterführende Langzeitstudien, die den Wandel von Wahrnehmung und Nutzung über längere Zeiträume beobachten. Praktische Implikationen für die Entwicklung von KI-Systemen Die Erkenntnisse zu Priming eröffnen für Entwickler und Unternehmen neue Denkansätze, wie KI-Systeme präsentiert und eingeführt werden sollten. Bereits die verbale und visuelle Kommunikation vor einer Interaktion kann entscheidend sein. Verantwortungsvolle und positive Formulierungen, die auf Fürsorglichkeit und ethische Prinzipien der KI hinweisen, können Vertrauen aufbauen und die Nutzerbindung erhöhen.

Das Design von Benutzeroberflächen sollte zudem emotional unterstützende Elemente enthalten, die das Bild einer empathischen Assistenz fördern. Es geht dabei nicht um manipulative Tricks, sondern um transparente und ehrliche Kommunikation, die zum richtigen mentalen Verständnis beiträgt. Die Rolle der KI in der Gesellschaft und die ethischen Dimensionen Bei all den technischen und psychologischen Fortschritten darf nicht außer Acht gelassen werden, dass die Gestaltung von Erwartungen auch ethischen Prinzipien unterliegt. Die bewusste Prägung von Überzeugungen kann ebenso missbraucht werden, um Vertrauen zu erzwingen oder Nutzer gezielt zu manipulieren. Deshalb fordern Experten klare Richtlinien und Transparenz, damit Nutzer informierte Entscheidungen treffen können.

KIs als Begleiter des Menschen: ein neuer Ansatz Die wachsende Vorstellung, dass Künstliche Intelligenz nicht nur als Werkzeug, sondern als sozialer Partner wahrgenommen wird, verändert grundlegend unser Verhältnis zur Technik. Priming kann diesen Wandel aktiv unterstützen, indem es hilft, die KI als fürsorglich und unterstützend zu positionieren. Dies zeigt sich besonders in Bereichen wie Gesundheitsversorgung, Bildung oder psychologischer Beratung, wo empathische Interaktion unerlässlich ist. Zukünftige Forschungsfelder Neben Langzeitstudien gilt es, weitere Fragen zu beantworten. Wie können kulturelle Unterschiede im Priming berücksichtigt werden? Welche Rolle spielen individuelle Persönlichkeitsmerkmale? Wie balanciert man zwischen realistischen Erwartungen und emotionalem Engagement? Auch technische Innovationen wie personalisierte KI-Modelle könnten Wege bieten, stärker auf individuelle mentale Modelle einzugehen.

Fazit Die Forschung zur Beeinflussung der Mensch-KI-Interaktion durch Priming zeigt, wie tiefgehend mentale Modelle und Erwartungen unsere Wahrnehmung von Technologie prägen. Durch bewusste Gestaltung dieser Anfangseindrücke lässt sich Vertrauen, Empathie und die wahrgenommene Effektivität von KI-Systemen signifikant erhöhen. Gerade bei modernsten Sprachmodellen entsteht hier ein neues Potenzial, Mensch und Maschine als kooperatives Team zu verstehen. Zugleich erfordert diese Entwicklung hohe ethische Sensibilität, damit digitale Begleiter künftig partnerschaftlich, transparent und verantwortungsvoll agieren können.

![Tokyo Architect's 7 Level Compact Home, 59sqm/635sqft [video]](/images/E970B2AF-A0D8-40BA-B765-8BBAC711C095)

![Apple in China: The Capture of the Greatest Company (The Daily Show) [video]](/images/4811C8F3-EB2E-4AC3-B791-B7609D19FF43)

![Tour of the MIT AI Lab (1993) [video]](/images/3C655EA2-0D0D-4078-BEF6-4F68C440CBDE)