Künstliche Intelligenz hat in den vergangenen Jahren enorme Fortschritte gemacht und ist in vielen Lebensbereichen mittlerweile unverzichtbar geworden. Ob in der Suche nach Informationen, der Textgenerierung oder der Analyse großer Datenmengen – KI-Systeme unterstützen Menschen und Unternehmen auf vielfache Weise. Doch trotz der beeindruckenden Leistungen dieser Technologien zeigen sich vermehrt Anzeichen dafür, dass KI-Modelle in ihrer Qualität und Genauigkeit nachlassen. Dieses Phänomen wird in Fachkreisen auch als „KI-Modell-Zusammenbruch“ oder „model collapse“ bezeichnet und wirft drängende Fragen über den nachhaltigen Nutzen und die Zuverlässigkeit von KI auf. Ein Kernproblem, das zum Zusammenbruch von KI-Modellen beiträgt, ist die sogenannte Fehlerakkumulation.

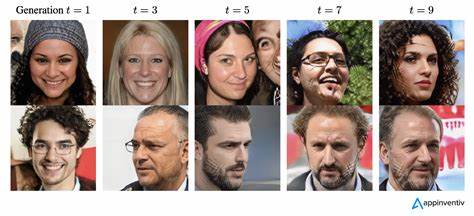

Dabei übernehmen nachfolgende Generationen von KI-Modellen die Fehler ihrer Vorgänger und verstärken sie sogar noch. Wenn Modelle hauptsächlich auf bereits erzeugten KI-Inhalten trainiert werden, entfernen sich die Ergebnisse immer weiter von der zugrundeliegenden realen Datenbasis. Durch dieses Überschreiben ursächlicher Datenmuster entsteht eine schleichende Verzerrung, die sich nach und nach in der gesamten KI-Welt ausbreitet. Ein weiteres zentrales Element des Modell-Zusammenbruchs ist der Verlust sogenannter Randdaten. Seltene Ereignisse oder Nischeninformationen verschwinden im Laufe der Trainingszyklen aus den Datensätzen.

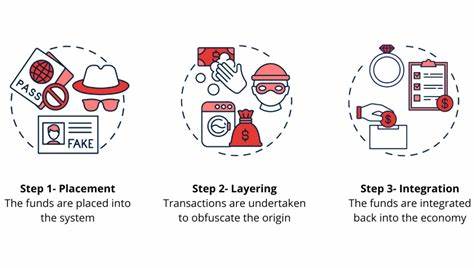

Das bedeutet, dass außergewöhnliche, aber wichtige Konzepte mit der Zeit ausgelöscht werden, wodurch die KI nur noch auf die häufigeren, eher banalen Muster zugreift. Diese Verengung der Datenvielfalt führt zu sich wiederholenden Texten und eingeschränkten Handlungsmöglichkeiten, was die Nutzbarkeit der KI in spezialisierten oder komplizierten Fragestellungen stark reduziert. Hinzu kommen Feedback-Schleifen, die aufgrund der verstärkten Nutzung eigener Modell-Ausgaben entstehen. KI-Systeme, die auf ihre eigenen Erzeugnisse zurückgreifen, können so Verzerrungen und Vorurteile in ihren Ergebnissen verfestigen. Die Gefahr besteht darin, dass diese Systeme in einem eng umrissenen Wahrnehmungsrahmen verharren und dadurch einseitige oder sogar falsche Informationen verstärkt verbreiten.

Das trägt dazu bei, dass die Glaubwürdigkeit und Zuverlässigkeit der Resultate immer stärker in Frage gestellt werden. Besonders deutlich wird dieses Problem bei KI-unterstützten Suchmaschinen. Während klassische Suchmaschinen wie Google versuchen, direkt auf Originalquellen und seriöse Dokumente zurückzugreifen, tendieren viele KI-gestützte Systeme dazu, sekundäre Informationen oder zusammenfassende Seiten zu zitieren. Das führt insbesondere bei der Suche nach harten Fakten wie Marktanteilszahlen oder Unternehmensberichten häufig zu ungenauen oder verfälschten Ergebnissen. Selbst wenn Nutzer gezielt Quellen wie die offiziellen 10-K-Berichte einfordern, gelingt es manchmal nur eingeschränkt, erneut auf Originaldaten zuzugreifen.

Die Technologie des Retrieval-Augmented Generation (RAG) sollte hier eigentlich Abhilfe schaffen. RAG ermöglicht es Sprachmodellen, externe Wissensdatenbanken zu konsultieren und damit mehr verlässliche und aktuelle Daten in ihre Antworten einzubeziehen. Theoretisch werden so halluzinierte oder erfundene Inhalte reduziert. Allerdings zeigen Studien, dass RAG-Systeme mit einer höchsten Anzahl schädlicher oder irreführender Antworten reagieren können. Es kommt vor, dass diese erweiterten Modelle sensible Kundendaten versehentlich preisgeben, verzerrte Marktanalysen erstellen oder unzuverlässige Investitionsempfehlungen generieren.

Diese Entwicklung stellt Unternehmen und Nutzer gleichermaßen vor Herausforderungen. Derzeit ist die Mehrheit der KI-Anwender wenig sensibilisiert für solche Risiken. Die weit verbreitete Erwartung, KI könne immer bessere und zielgerichtetere Ergebnisse liefern, kollidiert mit der Realität, dass Modelle aufgrund von Trainingsdefiziten und Datenverzerrungen weniger präzise und teilweise sogar gefährlich werden können. Auch die gesellschaftlichen Folgen sind nicht zu unterschätzen. Wenn KI-Systeme zunehmend fehlerhafte Inhalte verbreiten, kann das Vertrauen der Bevölkerung in digitale Technologien und Informationsquellen stark erodieren.

Bereits heute finden sich Beispiele für gefälschte Texte oder „Fake Papers“, die teilweise ohne Kontrolle in wissenschaftlichen oder journalistischen Kontexten auftauchen. Mit wachsender Verbreitung solcher Inhalte steigt die Gefahr, dass Entscheidungen auf unsicherer Basis getroffen werden – sei es in Bildung, Wirtschaft oder Forschung. Datenqualität wird damit mehr denn je zum kritischen Engpass bei der Entwicklung neuer KI-Modelle. Einige Forscher schlagen vor, der KI vermehrt menschlich erzeugte Inhalte zuzuführen, um so die Fehler und Verzerrungen auszugleichen. Während das theoretisch Sinn macht, bleiben praktische Fragen offen: Woher soll die nötige Menge an hochwertigen, menschlich erarbeiteten Daten kommen? Immerhin ist die Erstellung von qualitativ erstklassigem Content zeitaufwendig, kostspielig und in vielen Bereichen eine knappe Ressource.

In der Praxis stehen Unternehmen häufig vor einem Dilemma. Auf der einen Seite brauchen sie effiziente und automatisierte Lösungen, um Wettbewerbsfähigkeit und Produktivität zu steigern. Auf der anderen Seite besteht das Risiko, dass die eingesetzten KI-Systeme aufgrund des beschriebenen Modellkollapses mehr Schaden als Nutzen anrichten. Es schwingt auch ein ethisches Moment mit: Der Wunsch, mit KI Kosten zu sparen oder Personal zu reduzieren, darf nicht auf Kosten von Qualität und Zuverlässigkeit gehen. Beobachter sehen bereits jetzt erste Phasen, in denen die Kluft zwischen den Erwartungen an KI und deren tatsächlicher Leistungsfähigkeit immer größer wird.

„OpenAI generiert inzwischen etwa 100 Milliarden Wörter pro Tag“, berichtete der CEO von OpenAI im Februar 2024. Wenn man bedenkt, dass viele dieser Texte online veröffentlicht und wieder als Trainingsmaterial verwendet werden, verstärkt das den Kreislauf von fehlerhaften Daten und die Gefahr des Modell-Zusammenbruchs nachhaltig. Die Herausforderung liegt damit nicht nur in der Technik, sondern auch in der Art und Weise, wie wir als Gesellschaft mit KI umgehen. Es bedarf neuer Strategien, verantwortungsvoll mit automatisiert erzeugten Inhalten umzugehen und sicherzustellen, dass Datengrundlagen stets authentisch und valide bleiben. Die KI-Forschung steht vor der wichtigen Aufgabe, nicht nur immer komplexere Modelle zu entwickeln, sondern auch nachhaltige Mechanismen zu implementieren, die die Qualität der Daten garantieren und Feedback-Schleifen vermeiden.

Im Kern ist klar: Der Moment, an dem KI-Modelle durch den eigenen Output „vergiftet“ werden, ist kein fernes Zukunftsszenario mehr. Erste Symptome zeigen sich bereits deutlich, und es liegt an Entwicklern, Anbietern und Nutzern, rechtzeitig Gegenmaßnahmen zu ergreifen. Nur so können die Potenziale der künstlichen Intelligenz weiterhin verantwortungsvoll genutzt werden, ohne die Gefahr eines umfassenden Vertrauensverlustes in diese Schlüsseltechnologie.