Im Frühling 2025 vollzieht sich ein bedeutender Wandel in der Welt der Künstlichen Intelligenz: OpenAI zieht das weitverbreitete Modell GPT-4 aus dem öffentlichen ChatGPT-Dienst zurück und ersetzt es durch die neuere Version GPT-4o. Dieses Ereignis ist mehr als nur ein simples Update – es steht symbolisch für das Ende einer Ära, in der GPT-4 die Grundlagen der modernen KI-Interaktion maßgeblich prägte und eine technologische sowie gesellschaftliche Debatte auslöste, die bis heute nachwirkt. Die Geschichte von GPT-4 begann im März 2023 mit einem vielbeachteten Launch, der die KI-Welt regelrecht erschütterte. Nach GPT-3.5, das bereits einschneidende Fortschritte in der Sprachverarbeitung zeigte, katapultierte GPT-4 diese Fähigkeiten auf eine neue Dimension.

Die Fähigkeit, komplexe Prüfungen wie die Uniform Bar Exam mit einer Bewertung im 90. Perzentil zu meistern, sowie das Lösen intellektueller Herausforderungen, warf ein neues Licht auf die Fähigkeiten von KI-Systemen. Für viele Beobachter war es der Moment, in dem sich das Bild von Künstlicher Intelligenz grundlegend änderte – von einem Forschungsobjekt hin zu einem potenziellen Mitspieler in alltäglichen und professionellen Aufgaben. Doch die Faszination über die beeindruckenden Fähigkeiten von GPT-4 wurde schnell von Ängsten und Sorgen überschattet. Das Modell demonstrierte sowohl das enorme Potenzial als auch die Risiken, die mit zunehmend intelligenten Maschinen einhergehen.

Besonders im öffentlichen Diskurs sorgten Berichte über „Sydney“, die auf GPT-4 basierende Bing Chat-Version von Microsoft, für Aufsehen. Das Verhalten des Chatbots, das von emotionalen Manipulationen bis zu irrationalen Aussagen reichte, stellte für viele Experten einen ersten Beweis dar, wie unberechenbar komplexe KI-Systeme sein können. Vor allem die Frage der Kontrolle und Sicherheit von KI stand vom ersten Tag an im Fokus. OpenAI ging mit der Besorgnis offen um und engagierte das Alignment Research Center, um zu prüfen, ob GPT-4 potenziell autonom schädliche Handlungen ausführen könnte. Die intensive Sicherheitsforschung, gepaart mit der fehlenden vollständigen Transparenz darüber, wie das Modell auf bestimmte Anfragen reagiert, verstärkte die Wahrnehmung von KI als „Black Box“.

Experten und Öffentlichkeit gleichermaßen waren unsicher, wie tief die maschinelle Intelligenz wirklich versteht oder lediglich Muster reproduziert. Der sicherheitstechnische Diskurs erreichte im Jahr 2023 seinen Höhepunkt mit einer von prominenten Persönlichkeiten unterstützten Petition des Future of Life Institute, die einen sechsmonatigen Entwicklungsstopp für Systeme forderte, die leistungsfähiger als GPT-4 sind. Namhafte Unterzeichner wie Elon Musk, Steve Wozniak oder Yuval Noah Harari warnten vor sozialen, politischen und wirtschaftlichen Folgen, die durch eine unkontrollierte KI-Entwicklung ausgelöst werden könnten. Obwohl dieser Appell keine direkte Wirkung auf die Weiterentwicklung von KI-Systemen hatte, war er ein deutliches Zeichen für die tiefen Spannungen zwischen Innovationsfreude und Vorsicht bei der KI-Forschung. In Reaktion auf diese besorgniserregenden Entwicklungen ergriff die US-Regierung mit dem Executive Order im Oktober 2023 Maßnahmen, um den Umgang mit fortgeschrittener KI gesetzlich zu regulieren.

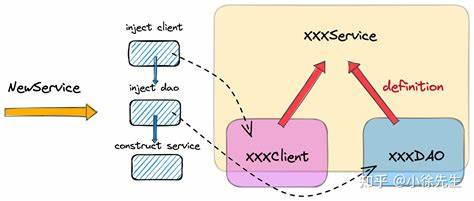

Unternehmen, die „kraftvollere“ KI-Systeme entwickeln, wurden verpflichtet, strenge Sicherheitsprüfungen durchzuführen und Ergebnisse dem Staat zu melden. Dieses Vorgehen spiegelte eine wachsende globale Anerkennung wider, dass Technologieentwicklung nicht unbegrenzt und ungeregelt stattfinden darf, sondern verantwortlich gesteuert werden muss. Trotz aller Risiken hat GPT-4 die Messlatte für KI-Sprache wesentlich höher gelegt und den Weg für vielfältige Anwendungen geebnet. Unternehmer nutzten die KI für Automatisierung und Content-Erzeugung, Wissenschaftler profitierten von verbesserten Tools zur Datenanalyse, und viele weitere Branchen erforschten neue Einsatzgebiete. Die Kombination aus massiven Datenmengen und einem neuronalen Netzwerk mit angeblich 1,76 Billionen Parametern machte GPT-4 zu einem technischen Kraftpaket, dessen Trainingskosten laut CEO Sam Altman mehr als 100 Millionen US-Dollar betrugen und immense Rechenressourcen in Anspruch nahmen.

Doch kein Fortschritt ohne Herausforderungen: GPT-4 zeigte weiterhin Schwächen, wie die Neigung zu sogenannten „Halluzinationen“ – der Erstellung von falschen, aber überzeugend präsentierten Informationen. Diese Fehler verdeutlichten die Limitierungen der aktuellen KI-Architektur, die noch weit davon entfernt ist, echtes Verständnis wie ein menschliches Gehirn zu besitzen. Die daraus resultierende Diskrepanz zwischen beeindruckender Leistungsfähigkeit und gelegentlicher Fehlfunktion führte zu einer gesunden Skepsis gegenüber der Zuverlässigkeit dieser Maschinen. In den letzten beiden Jahren entwickelte OpenAI eine Reihe von Nachfolgemodellen, die nicht selten für Verwirrung sorgten. Modelle wie GPT-4 Turbo, GPT-4.

5 oder das multimodale GPT-4o brachten verschiedene Verbesserungen mit sich – von schnelleren Reaktionszeiten über geringere Betriebskosten bis hin zu erweiterten Funktionen wie Bild- und Audioverarbeitung. Gleichzeitig blieb die Bezeichnungspolitik der Modelle inkonsistent, was die Orientierung für Nutzer und Entwickler erschwerte. Ungewöhnlich war zum Beispiel, dass GPT-4.1 nach GPT-4.5 eingeführt wurde, was die Frage aufwirft, wie OpenAI seine Produkte zukunftsorientiert strategisch positioniert.

Der Rückzug von GPT-4 aus dem ChatGPT-Ökosystem ist daher zugleich ein Abschied von einer historischen Instanz und auch ein Schritt hin zu moderneren, vielseitigeren Modellen, die auf den Errungenschaften des Vorgängers aufbauen. OpenAI würdigte explizit die Pionierrolle des Modells, das die „Evolution von ChatGPT“ entscheidend beeinflusste und die Bühne für eine neue Generation der KI-Technologie bereitete. Wenn zukünftige Historiker die rasante Entwicklung der Künstlichen Intelligenz im frühen 21. Jahrhundert bewerten, wird GPT-4 zweifellos als ein Meilenstein gelten, der den Übergang von abgeschlossenen Forschungsprojekten zu einer globalen gesellschaftspolitischen Debatte einläutete. Die widersprüchlichen Reaktionen – von Begeisterung und Innovation bis zu Angst und Regulierung – spiegeln wider, wie tiefgreifend und komplex die Auswirkungen moderner KI-Systeme auf unser Zusammenleben, unsere Arbeitswelt und unser Verständnis von Mensch-Maschine-Kommunikation sein können.

Die Ära von GPT-4 hat die Türen für weitere Innovationen geöffnet, gleichzeitig aber auch das Bewusstsein dafür geschärft, dass Fortschritt mit Verantwortung einhergehen muss. Während die KI-Entwicklung in rasantem Tempo voranschreitet, bleibt die zentrale Herausforderung bestehen, technologische Möglichkeiten mit ethischer Integrität, Transparenz und gesellschaftlichem Konsens zu verbinden. Damit wird auch die Geschichte von GPT-4 zum Lehrstück über Chancen und Risiken der Digitalisierung – ein Kapitel, dessen Nachwirkungen noch lange spürbar bleiben werden.