Die wachsende Komplexität von Daten hat die Art und Weise, wie Informationen präsentiert und analysiert werden, grundlegend verändert. 3D-Datenvisualisierungen bieten eine Möglichkeit, umfangreiche und vielschichtige Datensets auf eine anschauliche Weise darzustellen. Doch mit der Entwicklung solcher anspruchsvoller Visualisierungen stellt sich auch die Frage, wie Benutzer diese effektiv und intuitiv steuern können. Traditionelle Steuerungsarten per Maus und Tastatur stoßen hier schnell an ihre Grenzen. Ein vielversprechender Lösungsweg wird durch die Integration von Handgesten und Sprachbefehlen als Steuerelemente angeboten.

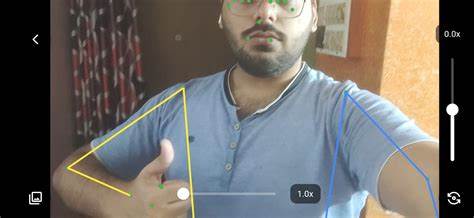

Diese Technologien verändern den Umgang mit 3D-Daten entscheidend und ermöglichen eine natürliche und direkte Interaktion. Handgesten basierte Steuerungssysteme nutzen oft Sensoren, Kameras oder spezielle Controller, um Bewegungen der Hände in Echtzeit zu erkennen und in Befehle umzusetzen. Dies erlaubt es Nutzern, durch einfache Gesten wie Wischen, Greifen, Drehen oder Ziehen Datenobjekte zu manipulieren. Die dreidimensionale Natur solcher Visualisierungen erfordert häufig komplexe Interaktionen, die mit physischer Bewegung verständlicher und präziser erfolgen können, als mit Maus und Tastatur. Zudem führt die freie Bewegung meist zu einer schnelleren und flüssigeren Navigation durch die Datenwelt.

Sprachbefehle ergänzen diese Steuerungsmöglichkeit ideal, indem sie die Aufmerksamkeit des Benutzers auf die Analyse konzentrieren können. Einfach formulierte Anweisungen wie „Zoom rein“, „Objekt drehen“ oder „Hintergrund ausblenden“ werden dank fortschrittlicher Spracherkennungssysteme zuverlässig umgesetzt. Spracherkennungstechnologien haben sich in den letzten Jahren drastisch verbessert und bieten inzwischen eine hohe Erkennungsrate selbst in lauten oder unruhigen Umgebungen. Durch die Kombination von Sprache und Gesten entsteht ein multimodales Interface, das flexibel auf unterschiedliche Situationen und Präferenzen zugeschnitten werden kann. Ein wesentlicher Vorteil der Nutzung von Handgesten und Sprachbefehlen liegt in der Immersion.

Nutzer fühlen sich stärker in die Datenwelt eingebunden, indem sie diese nicht nur visuell, sondern auch haptisch und auditiv erleben. Dies steigert das Verständnis komplexer Datenzusammenhänge und fördert kreative Denkprozesse. Gerade in Bereichen wie wissenschaftlicher Forschung, Ingenieurwesen oder Finanzanalyse können so detaillierte Muster und Trends schneller erkannt werden. Die Implementierung solcher Systeme erfordert den Einsatz moderner Hard- und Softwarelösungen. Auf der Hardwareseite kommen oft Tiefenkameras wie die Microsoft Kinect, Leap Motion Controller oder spezielle VR/AR-Brillen zum Einsatz.

Diese Geräte erfassen präzise Bewegungen im dreidimensionalen Raum und ermöglichen eine flüssige Steuerung. Die Softwareseite umfasst Algorithmen zur Gestenerkennung, Sprachverarbeitung und Datenvisualisierung selbst. Fortschritte im Bereich Künstliche Intelligenz und Machine Learning spielen dabei eine Schlüsselrolle, um Nutzerintentionen zuverlässig zu interpretieren und passende Rückmeldungen zu geben. Darüber hinaus ist die Benutzerfreundlichkeit ein zentraler Fokus bei der Entwicklung. Gesten sollten einfach, intuitiv und möglichst universell sein, um eine kurze Einarbeitungszeit zu garantieren.

Sprachbefehle müssen klar strukturiert und individuell anpassbar sein, damit unterschiedliche Nutzergruppen optimal profitieren können. Viele Hersteller arbeiten deshalb auch an adaptive Systemen, die sich automatisiert an das Verhalten und die Vorlieben der Benutzer anpassen. Ein weiterer spannender Aspekt ist die Integration in Virtual- und Augmented-Reality-Anwendungen. Hier erleben Anwender eine vollständig immersive Umgebung, in der Daten nicht nur angezeigt, sondern erlebbar werden. Handgesten und Sprache bilden in solchen Szenarien die Brücke zwischen realer Bewegung und digitaler Welt.

Das ermöglicht es, Daten aus verschiedensten Perspektiven zu betrachten, zu verändern und zu analysieren – ganz ohne physische Eingabegeräte. Die Zukunft dieser Technologien verspricht eine vollständige Neugestaltung der Datenanalyseprozesse. Unternehmen, Forschungseinrichtungen und Bildungseinrichtungen können von der verbesserten Zugänglichkeit und Interaktivität profitieren. Besonders für komplexe Visualisierungen, wie etwa in der Molekularbiologie, Stadtplanung oder im Maschinenbau, werden durch natürliche Steuerungsmethoden neue Erkenntnismöglichkeiten geschaffen. Die Akzeptanz und Verbreitung dieser Technologien wächst stetig, nicht zuletzt wegen sinkender Kosten der Sensorik und flächendeckender Verfügbarkeit von KI-gestützten Systemen.

Zudem ergeben sich durch sprach- und gestenbasierte Steuerungen neue Chancen im Bereich der Barrierefreiheit. Menschen mit motorischen Einschränkungen oder Sehbehinderungen können von alternativen Eingabemöglichkeiten profitieren, die traditionelle Steuergeräte ersetzen oder ergänzen. Die selbstbestimmte Interaktion mit datenintensiven Anwendungen wird dadurch erheblich erleichtert. Natürlich gibt es auch Herausforderungen. Datenschutz und Sicherheit stellen wichtige Aspekte dar, denn die Erfassung von Bewegungsdaten und Sprachaufnahmen erfordert verantwortungsvollen Umgang mit Nutzerdaten.

![New brain-spine interface tech in Shanghai helps paralyzed patients walk again [video]](/images/0A7F8529-2F17-403D-9C97-04BEBBA0E25B)