Die digitale Landschaft Großbritanniens steht vor einer fundamentalen Transformation, die viele Bürger, Aktivisten und Experten alarmiert. Im Zentrum dieser Entwicklung steht der Online Safety Act (OSA), ein Gesetzespaket, das der Regulierungsbehörde Ofcom umfassende Befugnisse zur Kontrolle und Regulierung digitaler Plattformen einräumt. Mit der kürzlich veröffentlichten „Draft Statement of Strategic Priorities for Online Safety“ hat die britische Regierung die Ausrichtung für die nächsten Jahre festgelegt und übt damit erheblichen Druck auf Ofcom aus, verstärkt Zensurmaßnahmen, Überwachung und Altersverifikation durchzusetzen. Diese Entwicklung berührt nicht nur den Kinderschutz im Internet, sondern auch weitreichende Fragen rund um Meinungsfreiheit, Datenschutz und gesellschaftliche Diskurse. Das Kernanliegen des Online Safety Act besteht offiziell im besseren Schutz vor schädlichen Inhalten, insbesondere für Kinder.

Doch die vorgeschlagenen Maßnahmen gehen darüber hinaus, indem sie nahezu alle Nutzergruppen betreffen. So werden zum Beispiel auch „einige erwachsene Nutzer“ genannt, die von zusätzlichen Schutzmaßnahmen profitieren sollen, wenn Inhalte nicht illegal, aber potenziell schädlich eingeschätzt werden. Diese schwammige Formulierung öffnet Tür und Tor für eine weitreichende Ausweitung der Zensur durch Algorithmen und menschliche Moderation. Es entsteht ein Problem, das sich zwischen legitimen kindlichen Schutzinteressen und einer staatlichen Kontrolle des öffentlichen Diskurses bewegt. Die „Safety by Design“-Priorität, die im strategischen Leitfaden der Regierung hervorgehoben wird, verpflichtet Plattformen dazu, von Beginn an robuste Schutzmechanismen einzubauen.

Doch zugleich beinhaltet sie Forderungen, die weit über den Schutz von Minderjährigen hinausgehen. So sollen Plattformen nicht nur altersgerechte Inhalte sicherstellen, sondern auch die Verbreitung von „Fehlinformationen“ und „Desinformation“ als Bedrohung für die nationale Sicherheit minimieren. Hier verschwimmen die Grenzen zwischen Sicherheitspolitik, Medienaufsicht und moralischer Kontrolle. Besonders die Betonung auf eine vermeintliche Rolle sozialer Medien bei den Southport-Unruhen dient als Argumentationsgrundlage, um staatliche Überwachung zu legitimieren – ungeachtet der tatsächlichen Ursachen der Ereignisse. Die Auswirkungen auf die Meinungsfreiheit sind enorm.

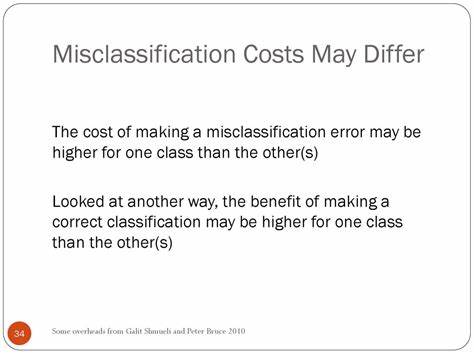

Die regulatorische Agenda begünstigt eine Form der „rollierenden Zensur“, bei der Inhalte permanent überprüft und an sich wandelnde Gefahrenlagen angepasst werden. Dies führt zu einem dynamischen Überwachungs- und Anpassungsprozess, der sich der öffentlichen Kontrolle zunehmend entzieht. Offiziell soll Ofcom in der Lage sein, transparent zu agieren, doch die Praxis zeigt häufig, dass Kriterien für die Sperrung oder Priorisierung von Inhalten unklar bleiben und kaum nachvollziehbar sind. Die Folge ist eine eingeschränkte öffentliche Debatte und eine Selbstzensur vieler Nutzer aus Angst vor Sanktionen. Zudem fordert die Regierung den verstärkten Einsatz von Algorithmen und künstlicher Intelligenz (KI) bei der Inhaltserkennung und Moderation.

KI soll dabei helfen, sogenannte „AI-koordiniertes inauthentisches Verhalten in großem Maßstab“ zu erkennen und zu verhindern. Doch Algorithmen sind nicht nur fehlbar, sondern auch anfällig für Verzerrungen und Manipulation. Ohne unabhängige Kontrolle und klare ethische Leitlinien besteht die Gefahr, dass automatisierte Systeme legitime Inhalte und Meinungen fälschlicherweise filtern oder unterdrücken. Die technologische Umsetzung könnte somit unbeabsichtigt zu einer automatischen Einschränkung der digitalen Meinungsvielfalt führen. Ein weiterer umstrittener Punkt ist die geplante Einführung von Online-Altersverifikation und digitalen Identitätsnachweisen.

Die Regierung setzt verstärkt auf technische Lösungen, um Nutzerdaten zu erfassen und Nutzer online eindeutig zu identifizieren. Diese Digital ID baut auf der Vorstellung auf, dass ein Nutzer erst dann Zugang zu bestimmten Inhalten erhält, wenn er seine Altersangabe überprüft hat. Während das Ziel, Kinder vor ungeeigneten Inhalten zu schützen, nachvollziehbar ist, sehen Kritiker hier die Gefahr einer umfassenden Überwachung und eines Kontrollstaats im digitalen Raum. Datenschutzrechtliche Bedenken klingen laut, da sensible personenbezogene Daten gesammelt, gespeichert und potenziell missbraucht werden könnten. Die Rolle von Ofcom als zentrale Regulierungsbehörde wird dadurch gleichzeitig gestärkt und herausgefordert.

Die Behörde soll nicht nur bestehende Regeln durchsetzen, sondern auch kontinuierlich auf neue Risiken reagieren – von Desinformation über Hassrede bis hin zu KI-generierten Inhalten. Zudem wird die internationale Zusammenarbeit gefordert, um globale Standards und Regulierungsmechanismen zu koordinieren. Diese Internationalisierung bringt jedoch zusätzliche Komplexität mit sich, da nationale Interessen, unterschiedliche Rechtsgrundlagen und breite gesellschaftliche Erwartungen unter einen Hut gebracht werden müssen. In diesem Kontext wächst die Kritik an der politischen und gesellschaftlichen Entwicklung. Vor allem zivilgesellschaftliche Organisationen warnen davor, dass der Schutz vor Online-Gefahren zu einem Vorwand für eine umfassende Überwachung und Einschränkung der Grundrechte wird.

Freie Meinungsäußerung, Datenschutz und eine offene Internetkultur könnten dadurch nachhaltig beschädigt werden. Ebenso befürchten manche Experten, dass die technischen Mittel, etwa die Ausweitung von Algorithmen und KI-Überwachung, nicht ausgereift genug sind und eher Unsicherheit als Sicherheit schaffen. Auch die Praxis, kleinere Online-Dienste gezielt ins Visier zu nehmen, weil sie angeblich „illegalen“ oder „risikoreichen“ Content verbreiten, stellt eine Gefahr für die digitale Vielfalt dar. Oftmals verfügen gerade kleine Anbieter über weniger Ressourcen, um den komplexen regulatorischen Anforderungen gerecht zu werden. Ihre mögliche Abschaltung oder starke Einschränkung könnte dazu führen, dass die Online-Landschaft von wenigen großen Konzernen dominiert wird – ein Szenario, das Kritiker als entstehende digitale Monopolbildung bezeichnen.

In der Debatte um den Online Safety Act zeigt sich ein tiefgehender Interessenkonflikt zwischen Sicherheit, Freiheit und Innovation. Während der Schutz von Kindern und die Bekämpfung von Hassrede und Desinformation wichtige Anliegen sind, müssen diese Ziele in einer Weise erreicht werden, die nicht zu einer Einschränkung grundlegender Bürgerrechte führt. Die breite Öffentlichkeit ist gefordert, sich aktiv mit den gesetzlichen Entwicklungen auseinanderzusetzen und auf eine ausgewogene Umsetzung zu drängen. Am Ende steht die Frage, wie ein modernes Regelwerk für digitale Räume aussehen kann, das Sicherheit und Freiheit gleichermaßen schützt. Große Teile der Gesellschaft fordern mehr Transparenz, Rechenschaftspflicht und demokratische Kontrolle der Regulierungsvorhaben.

Für Ofcom wird es eine herausfordernde Aufgabe sein, den Spagat zwischen den Anforderungen der Regierung, den technischen Möglichkeiten und dem Schutz der digitalen Grundrechte zu meistern. Die kommenden Monate und Jahre werden zeigen, wie sich Großbritanniens digitale Zukunft unter dem Druck von Zensur und Überwachung entwickelt – und welchen Preis die Gesellschaft dafür zu zahlen bereit ist.

![Google's Jeff Dean on the Coming Era of Virtual Engineers [video]](/images/2BBCFE9B-3D95-47AE-9C2A-F601BB6DD1B5)

![The Design of Everyday Things (1987) [video]](/images/56E4860E-2E7A-4446-85D1-076B5BACEF5E)