In der Welt der Künstlichen Intelligenz und der Cloud-Computing-Technologien gilt Sicherheit als eines der wichtigsten Merkmale, vor allem wenn es um sensible Daten wie persönliche Nachrichten geht, die an große Sprachmodelle (LLMs) gesendet werden. Das Projekt Minions Secure, entwickelt von der Stanford HazyResearch Gruppe, versprach genau das: eine sichere End-to-End-Verschlüsselung, bei der Nachrichten nur innerhalb des sogenannten Trusted Execution Environment (TEE) der NVIDIA Hopper H100 GPU entschlüsselt werden – quasi „sicher“ und abgeschirmt sogar vor dem Cloud-Anbieter selbst. Dieses Versprechen wurde mit viel Begeisterung aufgenommen, sogar von anderen Open-Source-Projekten wie Ollama, und galt als wegweisend für die Zukunft privater, lizenzierter KI-Anwendungen. Doch ist das wirklich der Fall? Die Realität hinter Minions Secure entpuppt sich als deutlich weniger sicher und zeigt vielerlei Schwachstellen auf, die einige Experten erschrecken lassen. Das Grundkonzept von Minions Secure baut auf der Idee auf, den oft vorkommenden Vertrauensbruch im Umgang mit Cloud-Diensten zu vermeiden.

Normalerweise werden Nachrichten im Klartext irgendwo in der Cloud verarbeitet, was bedeutet, dass sie durch Administratoren, unbefugte Dritte oder durch Behörden mit geeigneten Rechtshandhaben gelesen werden könnten. Die Lösung sollte sein, diese Daten nur in einem geschützten Hardwarebereich, einem sogenannten GPU-Enklave, zu verarbeiten, der durch die NVIDIA Hopper H100 GPU in Verbindung mit vertraulichen Compute-Umgebungen (Confidential Computing) bereitgestellt wird. Das ambitionierte Projekt beinhalte mehrere sicherheitsrelevante Mechanismen wie eine kurze, temporäre Schlüsselübergabe (ephemeral key exchange) zwischen Client und GPU-Enklave, eine Verifizierung der Echtheit der GPU durch ein Attestationsverfahren, verschlüsselte und signierte Kommunikation mit Nonce-Schutz und eine direkte Inferenzberechnung in der sicheren Zone – so die Behauptungen. Zudem wurde angegeben, dass trotz der verschlüsselten Verarbeitung die Latenz nur minimal beeinträchtigt wird, was für viele praktische Anwendungen überzeugend klang. Allerdings zeigen tiefgehende Untersuchungen, unter anderem geäußert in einer ausführlichen GitHub-Issue-Diskussion, dass diese Behauptungen nicht der Wahrheit entsprechen.

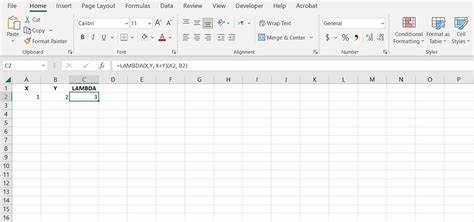

Ein erster Anhaltspunkt ist bereits der empfohlene Aufbau: Um Minions Secure überhaupt betreiben zu können, benötigt man eine vertrauliche VM (Virtual Machine) auf Microsoft Azure mit einer NVIDIA H100 GPU und der Unterstützung von Confidential Computing. Sofern dies gleichzeitig eine vertrauliche CPU benötigt, widerspricht dies der Behauptung, dass Nachrichten ausschließlich im GPU-Treiberbereich entschlüsselt würden. Ein echter geschlossener Verschlüsselungsweg bis zur GPU-Enklave ohne Beteiligung des Host-Betriebssystems ist technisch schlichtweg nicht möglich. Tatsächlich müssen die Daten auf der Host-Ebene entschlüsselt werden, konkret innerhalb eines Python Flask Servers, der auf der vertraulichen VM läuft, bevor sie dann an die GPU für die eigentliche Modellberechnung weitergegeben werden. Die nachgewiesene Schlüsselübergabe findet nicht zwischen Client und GPU, sondern zwischen Client und dem Server statt.

Die GPU übernimmt lediglich die Berechnungen, nicht aber die vertrauliche Verarbeitung der Nachrichten selbst. Ein weiterer, gravierender Schwachpunkt ist das Fehlen einer sicheren Authentifizierung des Servers im Kommunikationsprozess. Die ursprüngliche Implementierung arbeitet über HTTP, nicht HTTPS, und basiert stattdessen allein auf einer Diffie-Hellman Schlüsselübergabe. Diese Methode schützt lediglich gegen passive Mithörer, aber nicht gegen aktive sogenannte Man-in-the-Middle (MITM)-Angriffe. Solange die öffentliche Schlüsselübergabe vom Server nicht verifiziert wird, kann ein Angreifer sich problemlos dazwischenschalten, eigene Schlüssel präsentieren und damit den kompletten verschlüsselten Verkehr auslesen und manipulieren.

Dies ist beim Einsatz von HTTPS mittels eines vertrauenswürdigen Zertifikats in modernen Webanwendungen gut gelöst, bei Minions Secure aber schlichtweg ignoriert worden. Auch die Überprüfung (Attestation) der GPU-Echtheit ist mangelhaft. Das System erzeugt zwar einen Bericht über die GPU, allerdings wird dieser Bericht nicht zuverlässig verifiziert. Beispielsweise werden Signaturen bewusst nicht geprüft, sodass ein selbst erzeugtes falsches Attest als legitim akzeptiert werden kann, wenn nur gewisse Felder simuliert werden. Zusätzlich deckt die Attestation nur die GPU ab, nicht jedoch die CPU oder das Betriebssystem, wodurch unerkannte Manipulationen auf der Hostseite möglich sind.

Die Kombination aus ungesicherter Schlüsselübergabe, mangelnder Verifikation der Attestationsberichte und der benötigten Entschlüsselung auf dem Host macht die gesamte Sicherheitsarchitektur von Minions Secure wesentlich weniger vertrauenswürdig, als die ersten Berichte vermuten ließen. In der Praxis ist das Sicherheitssystem weniger robust als die Nutzung einer regulären HTTPS-Verbindung zu einem herkömmlichen inferierenden Server. Die Kritik an Minions Secure führte für die Entwickler zu einer gewissen Umorientierung und zur Verbesserung der Implementierung. Heute ist der Datenverkehr zwingend über HTTPS abgesichert, wodurch Man-in-the-Middle-Angriffe erheblich erschwert werden. Zudem wurden CPU-Attestationsverfahren ergänzt und die GPU-Attestation von einem Verifizierungsdienst von NVIDIA unterstützt.

Auch wird eine stärkere Bindung zwischen dem Attest und der Schlüsselübergabe aufgebaut, um eine bessere Authentizität des Servers zu gewährleisten. Doch trotz der Verbesserungen bleiben fundamentale Herausforderungen bestehen. Das Prinzip des Confidential Computing, gerade mit VMs, setzt eine Vertrauensbasis in die Virtualisierungs-Schicht und das zugrundeliegende Betriebssystem voraus. Selbst wenn deren Status „attestiert“ werden kann, sind solche Vertrauensnachweise nicht immer vollständig vor Manipulationen geschützt. Schwachstellen im Betriebssystem-Stack, Bootloader oder Firmware können die Sicherheitsgarantien brechen und sensible Daten kompromittieren.

Vor diesem Hintergrund ist das Konzept von „blindem Vertrauen“ in Cloudanbieter oder deren Technologie kritisch zu betrachten. Das Minions Secure Projekt verdeutlicht exemplarisch die Gefahr sogenannter „Vibe Coding“-Entwicklungen. Dabei entstehen Systeme, deren Code zwar syntaktisch korrekt und thematisch stimmig ist, jedoch auf falschen Annahmen beruht und komplexe Sicherheitsmechanismen nur oberflächlich nachahmt. Die Kombination aus automatisierten Code-Generatoren oder Large Language Models kann in wissenschaftlichen oder produktiven Projekten zu fehlerhaften Systemen führen, die selbst erfahrene Fachleute täuschen. Somit zeigt sich, dass die Auseinandersetzung mit Sicherheitsversprechen im Cloud-Bereich nicht nur technisches Fachwissen erfordert, sondern auch ein kritisches Verständnis von Systemarchitekturen und deren möglichen Angriffspunkten.

Der Fall Minions Secure ist keine Frage von böswilligem Verhalten oder absichtlichen Täuschungen, vielmehr handelt es sich um einen pädagogischen Moment, der verdeutlicht, wie wichtig fundierte Expertise und umfassende Audits vor dem produktiven Einsatz sind. Diese Erkenntnisse sind insbesondere für Entwickler, Unternehmen und Nutzer relevant, die vermehrt auf lokale Cloud-inspirierte KI-Lösungen und vertrauliche Datenverarbeitung setzen möchten. Sicherheit lässt sich nicht alleine mit cleveren Schlagwörtern oder beeindruckenden Hardwarefeatures gewährleisten, sondern erfordert eine ganzheitliche, nachvollziehbare und geprüfte Implementierung aller Komponenten. Zusammengefasst zeigt Minions Secure, wie schwer es ist, hohe Sicherheitsversprechen in komplexen Cloud- und KI-Umgebungen umzusetzen. Die technischen Grenzen von Trusted Execution Environments, die Rolle des Host-Betriebssystems, die Notwendigkeit rigoroser kryptografischer Verfahren und potenzielle Angriffsflächen durch menschliche und infrastrukturelle Faktoren machen den Weg zu wirklich sicheren KI-Cloud-Infrastrukturen steinig.

Nach dem Aufzeigen dieser Schwachstellen und der anschließenden Reaktion der Entwicklergruppe wurde deutlich, dass Transparenz und Offenheit für Kritik Schlüsselfaktoren sind, um Vertrauen zurückzugewinnen. Noch wichtiger als Marketingversprechen sind solide Codeprüfungen, ein klarer Nachweis von Sicherheitsmechanismen und ein ehrlicher Umgang mit den Grenzen der Technik. Wer sich tiefer für das Thema interessiert, sollte neben der Analyse des Minions Secure Quellcodes auch die Grundlagen von Confidential Computing mit GPUs und VMs verstehen. Nur so können echte Fortschritte erzielt und Fehlentwicklungen vermieden werden. Ebenso empfiehlt es sich, auf etablierte Sicherheitspraktiken wie TLS/HTTPS, starke Authentifizierung und geprüfte Attestationsverfahren zu setzen, die sich in der Praxis bewährt haben.

In einer Welt, in der KI immer stärker in sensiblen Bereichen eingesetzt wird, bleibt die Sicherheit von Daten ein entscheidendes Thema. Minions Secure ist ein lehrreiches Beispiel, wie vermeintlich innovative Projekte an kritischer Stelle ins Wanken geraten können – und wie wichtig die stetige Prüfung und Weiterentwicklung von Sicherheitskonzepten ist.