In einer Welt, in der Künstliche Intelligenz (KI) zunehmend zum Kern moderner Infrastrukturen wird, steht die Sicherheitsbranche vor einer radikalen Transformation. Die traditionelle Cybersecurity, basierend auf festen Regeln, statischen Systemen und klar definierten Angriffspunkten, stößt an ihre Grenzen. Herkömmliche Methoden, die lange Zeit Schutz boten, geraten ins Hintertreffen. Die Zukunft der Sicherheit sieht anders aus – sie wird von KI geprägt und fordert völlig neue Denkweisen und Technologien. Die fundamentale Erkenntnis ist, dass die bisherige Cybersecurity-Strategie nicht einfach nur erweitert, sondern vollständig neu gedacht werden muss.

KI-Sicherheit ist kein Upgrade oder eine Ergänzung der klassischen IT-Sicherheit, sondern ein grundlegendes neues Spiel mit anderen Regeln. Modelle, die auf Machine Learning und insbesondere generativer KI basieren, sind keine statischen Systeme. Sie arbeiten mit Milliarden von Parametern, die auf hochdimensionalen, oft undurchsichtigen Trainingsdaten basieren. Die Interaktion mit ihnen ist dynamisch und verändert sich stetig, was zahlreiche neue Risiken und Angriffsmöglichkeiten eröffnet. Diese KI-Systeme verhalten sich wie „Black Boxes“.

Selbst ihre Entwickler können nicht in jedem Detail vorhersagen oder erklären, wie bestimmte Outputs zustande kommen. Das stellt die herkömmliche Sicherheitsloge auf den Kopf, die davon ausgeht, dass Systeme analysierbar und Regelwerke anwendbar sind. KI macht diese Annahmen obsolet und verlangt nach einer Sicherheitsphilosophie, die Unsicherheit und ständige Anpassung als feste Bestandteile begreift. Die Bedrohungslage hat sich dadurch massiv verschärft. Angreifer müssen heute keine umfangreichen technischen Ressourcen oder spezialisiertes Wissen mehr besitzen – Kreativität und Vorstellungskraft sind die neuen Waffen.

Spannend und alarmierend zugleich ist die Tatsache, dass bereits junge Menschen, manchmal erst elf Jahre alt, ausgeklügelte Manipulationen und Angriffe auf KI-Systeme ausführen können. Diese Techniken verbreiten sich mit enormer Geschwindigkeit rund um den Globus und erschließen neue Angriffsszenarien, die mit herkömmlichen Sicherheitsansätzen nicht zu bewältigen sind. Das Bedrohungspotenzial von KI-gesteuerten Agenten wächst exponentiell. Anstatt Malware-Pakete zu verwenden, reichen heute clevere Eingabeaufforderungen („Prompts“), die das System in unerwartete Bahnen lenken. Die Angriffsoberfläche dehnt sich dadurch dramatisch aus, da praktisch jeder mit Zugang zu einem KI-Modell potenziell zum Angreifer werden kann.

Die Barriere für Cyberkriminalität sinkt auf null. Viele Anbieter versuchen zwar, KI in ihre bestehenden Sicherheitsprodukte zu integrieren. Doch hier liegt eine entscheidende Unterscheidung: AI für Security bedeutet, dass KI zur Unterstützung und Optimierung klassischer Sicherheitsaufgaben eingesetzt wird – beispielsweise automatische Erkennung, Analyse und Reaktion auf bekannte Bedrohungen. Security for AI hingegen beschäftigt sich mit dem Schutz der KI-Systeme selbst gegen Manipulation, Ausnutzung und Missbrauch. Die letztere Disziplin ist noch weitgehend unerforscht und erfordert spezialisierte Ansätze.

Der Vergleich mit der Automobilindustrie trifft den Kern: Wer KI lediglich auf klassische Systeme aufsetzt, wie Satellitennavigation in ein Auto einbaut und es dann autonom nennt, verkennt die grundlegende Wandlung. Sobald KI-Agenten eigenständig Entscheidungen treffen, Daten weitergeben oder externe Schnittstellen ansteuern, entstehen Risiken, die herkömmliche Firewalls und Antivirensoftware nicht mehr abdecken können. Die Sicherheitsbranche hat einen Wendepunkt erreicht, ähnlich wie einst der Übergang zum Cloud Computing. Der Anbieter CrowdStrike etwa revolutionierte die Endpoint-Security, weil er von Anfang an die Cloud als neue Plattform verstand und darauf zugeschnittene Lösungen entwickelte. Genauso verhält es sich mit der KI: Fortschritte und Entwicklungen passieren heute extrem schnell.

Wer versucht, KI nachträglich in veraltete Systeme zu integrieren, wird den Herausforderungen nicht gerecht. Der Aufbau von Sicherheitsarchitekturen der Zukunft verlangt tiefgreifendes Verständnis der KI-Modelle, wie sie funktionieren, wo ihre Schwachstellen liegen und wie Angreifer diese ausnutzen können. Nur so lassen sich wirkungsvolle Schutzmechanismen entwickeln, die den dynamischen Charakter von KI-Systemen berücksichtigen. Die Verfügbarkeit von Open-Weight-Modellen und die Möglichkeit für Agenten, auf ungesicherte Daten im Internet zuzugreifen, schaffen ein hohes Risiko für unerwünschte Auswirkungen und Sicherheitsvorfälle. Öffentliche Zugänglichkeit, niedrige Kosten und die emergenten Fähigkeiten der KI-Plattformen führen zu einer perfekten Welle der Unsicherheit und des Chaos.

Unternehmen, die heute Large Language Models (LLMs) implementieren, unterschätzen häufig die daraus resultierenden Risiken. Die vermeintliche Sicherheitsverbesserung durch Hinzufügen von KI-„Wrappern“ um Legacy-Systeme vermittelt falsche Sicherheit und verzögert eigentlich notwendige Maßnahmen. Tatsächlich haben schon erste große Sicherheitslücken und Angriffe stattgefunden, und die Komplexität und Frequenz dieser Attacken wird weiter steigen. Die Sicherheitsfirma der Zukunft wird einen anderen Charakter haben als die heutigen Player. Sie wird KI in ihrem Kern verankert haben, nicht als Anhang, sondern als integralen Bestandteil des Sicherheitskonzepts.

Dieses Unternehmen wird nicht wie ein traditioneller Sicherheitsanbieter aussehen – es wird eher mit innovativen KI-Unternehmen wie OpenAI verglichen werden. Es handelt sich hierbei um das Sicherheitsprojekt mit der höchsten Relevanz unserer Zeit. Wer in der Lage ist, diesen Paradigmenwechsel zu vollziehen und eine wirklich neue KI-Sicherheitsplattform zu erschaffen, wird maßgeblich die Sicherheit der nächsten Dekade mitbestimmen. Dabei reicht es nicht aus, vorhandene Methoden und Werkzeuge nur anzupassen. Es braucht komplett neu entwickelte Technologien, die Unsicherheit adressieren, sich flexibel an Bedrohungen anpassen und kontinuierlich dazulernen.

Neben der Technologiedimension spielt auch die organisatorische und kulturelle Komponente eine wichtige Rolle. Unternehmen müssen sich darauf einstellen, mit Unsicherheit zu leben und dynamische Bedrohungen zu managen, die nicht durch statische Regeln erfasst werden können. Es gilt, transparente Prozesse für die Modellkontrolle, für Datenschutz und für die Identifikation von Risiken zu etablieren. Content-Moderation in Echtzeit und intelligente LLM-basierte Wächtermechanismen bieten beispielsweise einen vielversprechenden Ansatz, um die KI-Nutzung in Unternehmen sicherer zu gestalten. Dabei werden herkömmliche Filtermechanismen, die nicht mehr ausreichen, durch adaptive, lernfähige Systeme ersetzt.

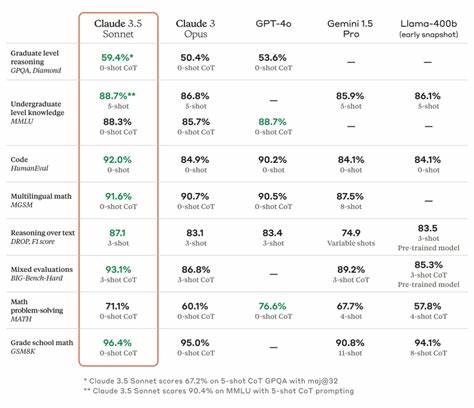

Weitere wichtige Bausteine der Zukunftssicherheit sind umfassende Risikobewertungen speziell für generative KI, wie der neue AI Model Risk Index, der reale Schwachstellen und Angriffsvektoren systematisch erfasst und bewertet. Diese Benchmarks helfen Unternehmen, ihre Schutzmaßnahmen gezielter zu entwickeln und Sicherheitslücken frühzeitig zu erkennen. Die Entwicklung geht schnell voran – wer jetzt handelt, meistert die Herausforderungen besser und sichert sich auf lange Sicht Vorteile. Die Security Company of the Future wird nicht nur Sicherheitsvorfälle verhindern, sie wird proaktiv neue Bedrohungen vorhersagen, automatische Gegenmaßnahmen einleiten und so eine neue Stufe der Verteidigung einleiten. Insgesamt zeigt sich, dass die Zukunft der Sicherheitsbranche untrennbar mit der Entwicklung und Sicherung von Künstlicher Intelligenz verbunden ist.