Die Welt der 3D-Rekonstruktion und Echtzeit-Rendering erlebt durch die kontinuierliche Forschung im Bereich volumetrischer Darstellungen und neuronaler Rendering-Technologien eine tiefgreifende Transformation. Eine der vielversprechendsten Methoden stellt dabei das 3D Gaussian Splatting (3DGS) dar, welches eine effiziente und qualitativ hochwertige Echtzeitdarstellung komplexer Szenen auf handelsüblicher Hardware ermöglicht. Dennoch weist das klassische 3DGS gewisse Einschränkungen auf, vor allem in Bezug auf die Unterstützung verzerrter Kameramodelle und sekundärer Lichtphänomene wie Reflexionen oder Brechungen. Genau hier setzt das neue Verfahren 3DGUT an und liefert eine innovative Lösung, die den aktuellen Stand der Technologie entscheidend erweitert und neue Anwendungsfelder eröffnet. 3DGUT steht für 3D Gaussian Unscented Transform und wurde von Forscherteams bei NVIDIA und der Universität Toronto entwickelt.

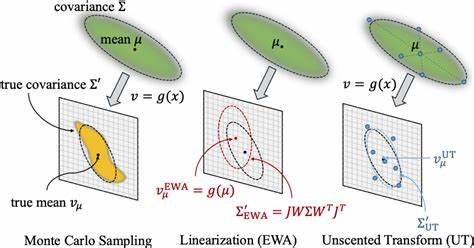

Die Methode basiert auf der grundlegenden Idee, die traditionelle EWA-Splatting-Rasterisierung, die im ursprünglichen 3DGS verwendet wird, durch die Unscented-Transform (UT) zu ersetzen. Dieses mathematische Verfahren nutzt sogenannte Sigma-Punkte, um die Projektion komplexer 3D-Gaussian-Partikel unter beliebigen nichtlinearen Kameraabbildungen präzise zu approximieren. Damit hebt 3DGUT die Unterstützung von Kameramodellen wie Fischaugenobjektiven, Rollingshutter-Effekten oder anderen zeitabhängigen Verzerrungen auf ein neues Niveau – und das bei Beibehaltung der Effizienz einer Rasterisierungsmethode. Während klassische Methoden, die auf linearisierten Projektionen und herkömmlicher gewichteter splatting-Technik basieren, Schwierigkeiten bei nichtlinearen Verzerrungen haben und oft aufwändige Ableitungen (Jacobians) pro Kameramodell benötigen, nutzt 3DGUT die Adaptive Fähigkeit der Unscented-Transform. Statt sich auf lokale Approximationen zu verlassen, erzeugt UT einen Satz von Sigma-Punkten, die exakt durch das nichtlineare Projektionierungsmodell geführt werden können.

Die Folge ist eine herausragend genaue Darstellung der Gaussian-Partikel auf Bildebene, was sich deutlich in der Bildqualität widerspiegelt – insbesondere bei stark verzerrten Objektivmodellen. Ein weiterer entscheidender Vorteil von 3DGUT ist die Integration sekundärer Lichtstrahlen, die für die realistische Simulation von Reflexionen und Brechungen maßgeblich sind. Während herkömmliche 3DGS-Ansätze primär auf eine direkte Projektion der Partikel ins Bild setzen und dadurch Effekte jenseits einfacher Sichtlinien nicht ohne weiteres darstellen können, harmoniert 3DGUT mit einer hybriden Rendering-Strategie. Diese verbindet die effiziente Gaussiansplatting-Erfassung der primären Strahlen mit gezieltem sekundärem Ray-Tracing. So können Reflexionen und Lichtbrechungen genau modelliert werden, was die visuelle Glaubwürdigkeit stark erhöht – und das bei gegenüber rein raytracing-basierten Ansätzen deutlich schnellerer Darstellung.

Der praktische Nutzen dieser Innovationen ist besonders in Bereichen wie autonomes Fahren und Robotik zu erkennen. Immer öfter stehen dort Kameras mit speziellen Verzerrungen durch Fischaugenlinse oder Rolling-Shutter vor der Aufgabe, Szenen in Echtzeit zu rekonstruieren und zu interpretieren. 3DGUT kann diese Herausforderungen durch seine robuste und generalisierbare Formulierung perfekt meistern. So lassen sich z.B.

Kamerabewegungen und zeitabhängige Verzerrungen direkt in das Projektionsmodell integrieren, was die Rekonstruktionsqualität und Stabilität auch bei bewegten Systemen maßgeblich verbessert. Das Team hinter 3DGUT hat zudem umfangreiche Vergleiche mit bestehenden Verfahren wie FisheyeGS oder dem ursprünglichen 3DGS durchgeführt und konnte eindrucksvoll nachweisen, dass die neue Methode bei vergleichbarer oder sogar besserer wahrnehmbarer Qualität deutlich weniger Partikel benötigt. Dies führt zu Einsparungen im Speicherverbrauch und ermöglicht flüssigere Echtzeitdarstellungen. Besonders bei Fischaugenmodellen zeigt sich ein großer Vorsprung durch die einfach adaptierbare Unscented-Transform-Methode, die keine aufwändigen Anpassungen für individuelle Objektivparameter benötigt. Eine technische Besonderheit der Arbeit ist der genaue Fokus auf die Projektion von 3D-Gaussian-Partikeln ins Bild.

Dort wo bisher Monte-Carlo-Sampling als das präziseste, aber auch rechenintensivste Verfahren galt, zeigt 3DGUT, dass mit der Unscented-Transform eine effiziente und zugleich sehr genaue Approximation möglich ist. Diese Genauigkeit wurde im Rahmen der Arbeit anhand der Kullback-Leibler-Divergenz quantifiziert und bestätigte die Überlegenheit gegenüber der EWA-Ansatzweise, gerade bei stark nichtlinearen Kameraabbildungen oder zeitabhängigen Verzerrungen. Darüber hinaus konnten mit 3DGUT komplexe virtuelle Szenen erstellt werden, in denen spiegelnde und brechende Objekte zuverlässig integriert sind. Diese Beispiele verdeutlichen eindrücklich die Fortsetzung des Weges vom reinen Rekonstruktionsverfahren hin zu vielseitigen, physikalisch realistischen Darstellungen, die in Echtzeit berechnet werden können – ein Meilenstein für interaktive Anwendungen, VR/AR-Systeme oder Filmproduktionen. Die Zukunft der 3D-Rekonstruktion und -Darstellung wird stark von der Integration solcher flexiblen und effizienten Methoden wie 3DGUT profitieren.

Die Fähigkeit, beliebige Kameramodelle einzubeziehen, zeitabhängige Effekte zu berücksichtigen und gleichzeitig physikalisch korrekte Lichtphänomene durch sekundäre Strahlen zu simulieren, bringt die Branche einen großen Schritt näher an eine vollständige Immersivität und Detailtreue. Gleichzeitig wird die Hardwarefreundlichkeit gewahrt, sodass auch mobile und eingebettete Systeme künftig von diesen technologischen Fortschritten profitieren können. Zusammenfassend lässt sich feststellen, dass 3DGUT nicht nur die Grenzen des Gaussian Splatting erheblich erweitert, sondern auch neue Maßstäbe in der flexiblen Handhabung komplexer Kameramodelle und realistischer Lichtszenarien setzt. Für Entwickler und Forscher im Bereich computergestützter Visualisierung, Robotik, autonomer Systeme und Echtzeitgrafik stellt dieses Verfahren eine wegweisende Technologie dar, die vielfältige neue Anwendungsfelder eröffnet und die Nutzung volumetrischer 3D-Darstellungen auf ein neues Level hebt.