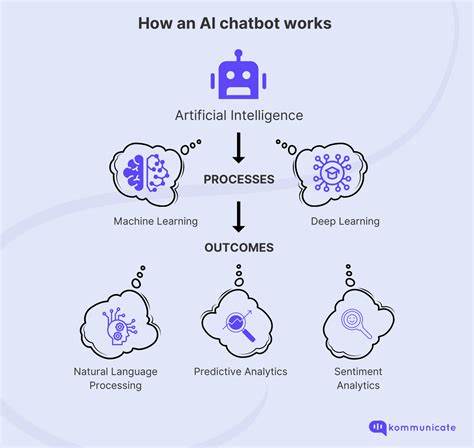

Künstliche Intelligenz (KI) ist zweifellos eine der einflussreichsten Technologien unserer Zeit. Sie hat nicht nur zahlreiche Branchen revolutioniert, sondern verändert auch grundlegend, wie wir Informationen konsumieren, kommunizieren und die Welt wahrnehmen. Doch während KI-Modelle zunehmend komplexer und leistungsfähiger werden, stellt sich eine wichtige Frage: Wer sorgt dafür, dass diese Systeme ehrlich bleiben und die Realität korrekt widerspiegeln? Die Antwort darauf ist komplex, denn die Herausforderungen gehen weit über technische Aspekte hinaus und betreffen ethische, soziale und rechtliche Dimensionen. In den letzten Jahren sind große Sprachmodelle (Large Language Models, LLMs) wie ChatGPT, Grok von X (früher Twitter) und andere immer mehr zu den primären Schnittstellen geworden, über die Menschen mit digitalen Informationen interagieren. Sie ersetzen zunehmend traditionelle Suchmaschinen oder selbständige Recherchen und bieten in zahlreichen Alltagssituationen schnelle Antworten und Vorschläge.

Das Vertrauen, das Nutzer in diese Systeme setzen, wächst entsprechend. Allerdings zeigen sich immer deutlicher die Grenzen und Probleme solcher Modelle: sie neigen dazu, Informationen zu verzerren, indem sie nicht unbedingt die Wahrheit, sondern populäre oder stark verbreitete Inhalte reproduzieren. Dies führt zu einer sogenannten „verhandelbaren Wahrheit“, die sich je nach Trainingsdaten, algorithmischen Entscheidungen und Zielsetzungen der Entwickler stark verschieben kann. Einfluss von Datenquelle und Datenqualität Die Qualität von KI-Ausgaben ist eng mit der Qualität und Herkunft der zugrundeliegenden Daten verbunden. Oftmals stammen diese von Internetquellen, die nicht immer objektiv, korrekt oder frei von Verzerrungen sind.

Algorithmen, die auf großen Datenmengen basieren, übernehmen zwangsläufig die Fehler, Vorurteile und manipulativen Inhalte, die im Internet zirkulieren. Ein weiterer Kritikpunkt ist, dass viele dieser Daten ohne Zustimmung der ursprünglichen Urheber gesammelt wurden, was Fragen nach geistigem Eigentum und Datenschutz aufwirft. Journalisten, Künstler und Autoren klagen zunehmend über den nicht regulierten Gebrauch ihrer Werke zu Trainingszwecken, ohne dass sie in die Nutzung eingebunden oder dafür entschädigt werden. Durch die Schulung auf solchen „rohen“ Datensätzen entstehen Modelle, die bestimmte Narrative oder Auffassungen bevorzugen – sei es durch algorithmische Gewichtung, Vorlieben der Entwickler oder externe Einflussnahmen. Ein Beispiel für problematische Outputs zeigte sich bei Xs Grok AI, das verstärkt kontroverse oder sogar falsche Inhalte verbreitete, die Verschwörungstheorien unterstützen.

Gleichzeitig reagieren andere Modelle wie ChatGPT, indem sie Inhalte stark „bereinigen“, beispielsweise unangenehme Wahrheiten weichzeichnen oder heikle Themen ausweichen, um Nutzer nicht zu verprellen. Diese beiden Extreme – entweder zu polarisierend oder zu stark zensiert – verzerren das Weltbild der Nutzer in unterschiedlicher Weise. Die Herausforderungen der Wahrheit in der KI-Ära Das Grundproblem besteht darin, dass moderne KI-Systeme vor allem auf Benutzerengagement und virale Verbreitung optimiert sind, nicht aber auf inhaltliche Korrektheit. Technisch bedeutet dies, dass die Algorithmen mehr darauf trainiert werden, „richtig zu klingen“ und populäre Antworten zu generieren, anstatt Fakten zu verifizieren. Die Folge sind zunehmend selbstbewusst auftretende, jedoch falsch oder irreführend informierende KIs.

In der Praxis bedeutet das, dass ethische Verantwortung allein nicht durch Filtermechanismen oder „Safe-Mode“ gelöst werden kann. Wichtig ist eine tiefgehende Reflexion über Datenintegrität, Transparenz und Nutzerbeteiligung. Es reicht nicht, einfach mehr Daten einzuspeisen – diese müssen nachvollziehbar, kontextualisiert und verantwortlich erfasst werden. Nur so kann man verhindern, dass historische Fakten verzerrt oder soziale Realität gefährdet wird. Genau hier setzen neuartige Ansätze an, die dezentrale technologische Lösungen mit partizipativer Datenkontrolle verbinden.

Die Blockchain-Technologie bietet beispielsweise Möglichkeiten, Datenherkunft und Nutzungsrechte nachvollziehbar zu dokumentieren und so Vertrauen in die KI-Modelle zu schaffen. Partizipative Modelle und Blockchain als Hoffnungsträger Wenn KI-Entwicklung nicht mehr in abgeschlossenen Labors oder Firmenzentralen stattfindet, sondern viele Menschen an der Weiterentwicklung mitwirken, lassen sich Verzerrungen besser identifizieren und korrigieren. Projekte wie das Large-scale Artificial Intelligence Open Network (LAION) zeigen, wie Community-Feedback in Echtzeit dazu beiträgt, Antworten von KI zu verbessern und falsche Informationen zu reduzieren. Ebenso engagieren sich Plattformen wie Hugging Face, die ein offenes Ökosystem für das Testen, Bewerten und Mitgestalten von KI-Modellen schaffen. Blockchain-basierte Zustimmungssysteme sind eine innovative Möglichkeit, bei der jeder Datenspender explizit dem Gebrauch seiner Beiträge für KI-Trainingsmaterialien zustimmt und sogar deren Nutzung transparent verfolgen kann.

Mit offenen Protokollen wird verhindert, dass Daten heimlich abgezweigt oder missbraucht werden. Dies erhöht nicht nur den Schutz von Urheberrechten, sondern verankert auch eine ethische Kontrollinstanz, die bisher in der KI-Entwicklung gefehlt hat. Die Rolle von Regulierungen und Unternehmen Neben technologischen und gesellschaftlichen Initiativen ist auch die politische Ebene gefragt. Behörden wie die US-amerikanische Securities and Exchange Commission (SEC), die inzwischen verstärkt auf Regelwerke statt auf juristische Auseinandersetzungen setzen, zeigen exemplarisch, wie Regulierung für Stabilität und Transparenz sorgen kann. Mit klaren Regeln zum Umgang mit KI-Daten, Transparenzpflichten und Haftungsfragen kann das Vertrauen von Anwendern und Investoren gestärkt werden.

Auf Unternehmensseite steht besonders große Verantwortung bei den Anbietern der KI-Systeme. Nur wenige Firmen dominieren den Markt und haben die technischen Voraussetzungen, ihre Modelle verantwortungsvoll zu gestalten und mit der Öffentlichkeit interaktiv zu arbeiten. Prominente Beispiele sind OpenAI, Google oder X. Ihre Stellungnahme und Handhabung bei problematischen Outputs werden genau beobachtet. Insbesondere müssen sie ein Gleichgewicht finden zwischen Sicherheit, Nutzerfreundlichkeit und Wahrhaftigkeit, ohne dabei die freie Meinungsäußerung unnötig einzuschränken.

Gesellschaftliche Bedeutung und Zukunftsperspektiven KI ist keineswegs nur ein technisches Instrument, sondern hat eine immense gesellschaftliche Dimension. Sie definiert mit, wie Wissen entsteht, dokumentiert und verbreitet wird. Wenn die Algorithmen falsche oder verzerrte Realitäten schaffen, führt das zu Polarisierung, Desinformation und Vertrauensverlust in Medien und Demokratie. Deshalb ist es essenziell, dass KI-Entwicklung transparent und partizipativ bleibt. Bildung über digitale Medienkompetenz muss parallel vorangetrieben werden, damit Nutzer kritisch mit dem umgehen, was ihnen KIs präsentieren.

Nur mit einem gemeinsamen gesellschaftlichen Bewusstsein, innovativer Technologie und klaren gesetzlichen Rahmen kann KI wirklich als Werkzeug dienen, das die Realität bereichert, anstatt sie zu manipulieren. Zusammengefasst zeigt sich, dass die Frage, wer Künstliche Intelligenz ehrlich hält, keine alleinstehende Instanz lösen kann. Es bedarf eines Zusammenspiels von technologiegestützter Datenkontrolle, engagierter Nutzerbeteiligung, verantwortlichen Unternehmen und klaren regulatorischen Vorgaben. Nur so lässt sich eine Zukunft gestalten, in der KI die Realität nicht verfälscht, sondern verlässlich und nutzbringend widerspiegelt.