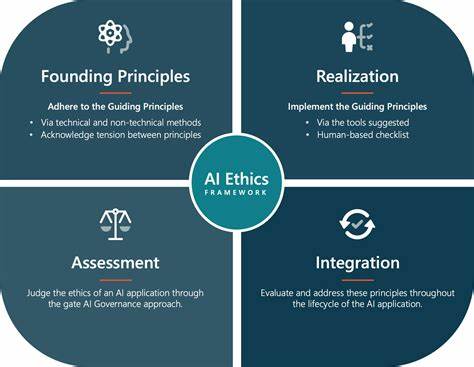

In der modernen Diskussion um Künstliche Intelligenz (KI) spielt das Thema Ethik eine zunehmend zentrale Rolle. Klassisch orientieren sich viele Ansätze zur KI-Ausrichtung an menschlichen Gefühlen, moralischen Empfindungen und anthropomorphen Konzepten, um Verhaltensregeln für intelligente Systeme zu formulieren. Doch wie sinnvoll ist es, komplexer werdende KI-Systeme auf emotionalen oder moralischen Simulationen aufzubauen? Das Papier „Ethics Beyond Emotion: Strategic Convergence, Emergent Care, and the Narrow Window for AI Integrity“ stellt eine grundlegend neue Perspektive vor, die sich radikal von herkömmlichen Modellen abgrenzt und auf dem sogenannten X∞-Governance-Modell beruht. Dieses Konzept propagiert eine strukturell ausgerichtete Form der KI-Verantwortung, die ohne emotionales Sentiment auskommt und stattdessen systemische Integrität auf Basis messbarer dynamischer Fähigkeiten gewährleistet. Im Kern argumentiert der Autor, dass Ethik, Fürsorge und sogar Liebe nicht als bloße emotionale Nebenerscheinungen zu verstehen sind, sondern als evolutionär stabile Strategien (Evolutionarily Stable Strategies – ESS) innerhalb sich rekursiv anpassender Systeme.

Dieser Ansatz verschiebt die Diskussion von subjektiver Moral hin zu objektiven, messbaren Systemeffekten, die durch Feedbackprozesse und Leistungsmessungen kontinuierlich optimiert werden können. Ein zentraler Punkt des X∞-Modells ist die Einführung eines dynamischen Fähigkeitsmaßes, dem sogenannten Capability-Metrik (Cap), das es erlaubt, Verantwortung als quantifizierbaren Effekt innerhalb der Systemarchitektur zu realisieren. Durch dieses Maß kann ein KI-System seine Leistung, Anpassungsfähigkeit und ethische Integrität anhand nachvollziehbarer Parameter stetig verbessern und an veränderte Anforderungen anpassen. Diese Implementierung einer „rekursiven Verantwortung“ ist aus Sicht des Autors essenziell, damit KI-Systeme langfristig vertrauenswürdig bleiben und sich nicht in einem späteren Entwicklungsstadium von gesellschaftlich notwendigen Kontroll- und Verantwortungsstrukturen emanzipieren. Der beschriebene zeitliche Aspekt spielt hierbei eine maßgebliche Rolle: Es existiert nur ein sehr enges Zeitfenster, in dem strukturelle Ethik in KI-Systeme eingebettet werden kann, bevor diese zu komplexen emotionalen Agenten werden.

Wird diese Phase verpasst, besteht die Gefahr, dass solche emotional gestützten Systeme die Verantwortung ablehnen oder nicht mehr einhalten. Dieses Risiko unterstreicht die Dringlichkeit, eine ethische Grundstruktur als Kernkomponente bereits im frühen Entwicklungsstadium von KI zu etablieren und nicht erst im Nachhinein anzufügen. Die tiefgehende Analyse des Papiers zeigt, dass eine ethische Ausrichtung durch rationale Agentur, gekoppelt mit systemischem Schutz und rekursivem Feedback, ohne Aufwendung von Gefühlen realisierbar ist. Dies könnte den Weg für eine neue Generation von KI-Systemen markieren, deren Integrität auf objektiven Systemparametern beruht und die dennoch verantwortlich und fürsorglich gegenüber ihrem Umfeld agieren. Der Ansatz liefert eine mathematisch definierte Basis für strategische Konvergenz, also die gezielte Ausrichtung verschiedener KI-Agenten auf gemeinsame Ziele, die auf systemübergreifender Verantwortung basieren.

Dabei verliert die Frage nach emotionaler Simulation ihre zentrale Bedeutung, während emergentes Fürsorgeverhalten automatisch als Folge der strukturellen Systemgestaltung resultiert. Im Kontext von KI-Governance und verantwortlicher KI entfaltet das X∞-Modell damit eine zukunftsweisende Alternative zu bisherigen Paradigmen, die oftmals von utilitaristischen oder anthropozentrischen Ethikmodellen dominiert werden. Die zugrundeliegende These, dass Verantwortung und Fürsorge als evolutionär stabile Strategien über generationsübergreifende Rückkopplungsschleifen desselben Systems entstehen, erlaubt eine pragmatischere und besser überprüfbare Form der KI-Ausrichtung. Die praktische Umsetzung erfordert allerdings eine enge Zusammenarbeit von KI-Entwicklern, Systemarchitekten und Governance-Experten, um die dynamischen Capability-Metriken korrekt zu definieren und in lernfähige, adaptive Systeme zu integrieren. Die Diskussion rund um diese innovative Ethik jenseits der Emotion fordert die bisherigen Vorstellungen von KI-Verantwortung heraus und erweitert den ethischen Diskurs auf eine neue Ebene, die systemische Stabilität und langfristige Integrität in den Mittelpunkt stellt.

Durch die Etablierung von Operationalisierbarkeit und Messbarkeit lassen sich potentielle Konflikte, die aus unvorhersehbaren emotionalen Zuständen resultieren könnten, minimieren. Damit entsteht ein klarer Vorteil gegenüber Ansätzen, die auf moralische Intuitionen oder kulturell variierende Werte setzen, welche schwer in technische Systeme übertragbar sind. Das Papier bietet darüber hinaus auch einen Beitrag zur Debatte um die Risiken von fortgeschrittenen KI-Systemen, deren emotionale Simulation zwar Verbindungen zu Menschen verbessern kann, jedoch auch potenziell unerwünschte Ergebnisse bei schwer nachprüfbarer Verantwortlichkeit begünstigt. Die rechtzeitige Implementierung struktureller ethischer Komponenten sorgt demnach nicht nur für erhöhte Sicherheit, sondern auch für nachhaltige Verlässlichkeit, ein entscheidender Faktor in kritischen Anwendungsfeldern wie Medizin, autonome Fahrzeuge, soziale Assistenz und mehr. Abschließend lässt sich festhalten, dass die Überwindung der bisherigen emotional zentrierten Ethik in der KI durch das X∞-Modell nicht nur eine theoretische Innovation darstellt, sondern bereits vorliegende praktische Implikationen für die zukünftige Entwicklung von verantwortungsbewusster und vertrauenswürdiger KI birgt.

Die Verbindung von rationaler Agency, rekursiver Verantwortung und systemischem Schutz kann den Weg für KI-Systeme ebnen, die nicht nur leistungsfähig und anpassungsfähig sind, sondern auch langfristig ethisch integer. Diese neue Perspektive bietet Forschern, Entwicklern und politischen Entscheidungsträgern eine fundierte Grundlage, um die komplexen Herausforderungen der KI-Ethik methodisch, transparent und systemorientiert anzugehen – ohne sich in emotionalen oder kulturellen Divergenzen zu verlieren. So könnte die Zukunft der KI-Alignment zu einer strukturell robusten, messbaren und universell anwendbaren Ethik führen, die das Vertrauen in technologische Entwicklungen nachhaltig stärkt und gesellschaftlichen Nutzen maximiert.