Die rasante Entwicklung von Künstlicher Intelligenz (KI) und deren Anwendung auf visuelle Medien hat eine neue Ära eingeläutet, in der digitale Avatare von Schauspielern zunehmend in Werbekampagnen, Online-Videos oder sogar dubiosen Inhalten Verwendung finden. Während diese Technologie potenziell enorme Chancen für die Unterhaltungsbranche bietet, existiert eine Schattenseite: Viele Schauspieler, die ihre Bild- und Stimmrechte für KI-Avatare verkauft haben, bereuen diesen Schritt tief. Ihre Gesichter werden häufig ohne ihr Wissen oder gegen ihren Willen in Videos verwendet, die an dystopische Szenarien aus der beliebten Serie "Black Mirror" erinnern. Daraus ergeben sich gravierende Fragen zum Schutz der Persönlichkeitsrechte sowie zur ethischen Verantwortung von KI-Unternehmen und Nutzern. Die Verlockung des schnellen Geldes Für viele Nachwuchsschauspieler ist es nicht ungewöhnlich, sich in finanzielle Engpässe hineinzustürzen.

Die Film- und Theaterbranche ist bekanntlich hart und geprägt von finanzieller Unsicherheit. In diesem Kontext erscheint das Angebot, für eine vergleichsweise geringe Summe von etwa 1.000 US-Dollar digitale Scans von Gesicht und Stimme anzufertigen, als schnelle Lösung, um dringend benötigtes Geld zu verdienen. Ein Beispiel ist der 29-jährige New Yorker Schauspieler Adam Coy, der seine Rechte an eine Firma namens MCM für ein Jahr lizenzierte, ohne die weitreichenden Implikationen zu bedenken. Die Folge: Sein Gesicht erschien in Videos, die ihn als Untergangspropheten darstellen.

Die Problematik der limitierten Vertragsbedingungen Ein zentrales Problem vieler Verträge zwischen Schauspielern und KI-Unternehmen sind deren weit gefasste, oft als "irrevocable" bezeichnete Klauseln, die den Unternehmern umfassende Rechte an Bild, Stimme und Ähnlichkeit einräumen. So vergeht oft nur wenig Zeit, bis die Schauspieler feststellen, dass ihr digitales Ebenbild missbräuchlich oder in Kontexten verwendet wird, die sie niemals zugestimmt hätten – sei es zur Verbreitung falscher Gesundheitsversprechen oder gar zur Förderung politischer Propaganda. Diese Verträge enthalten häufig keinerlei Möglichkeiten zur nachträglichen Kontrolle oder Rücknahme des Einverständnisses. Der Fall Simon Lee aus Südkorea illustriert die möglichen negativen Folgen eindrücklich. Er war schockiert, als sein KI-Avatar für Werbevideos genutzt wurde, die zweifelhafte Heilmittel auf TikTok und Instagram promoteten.

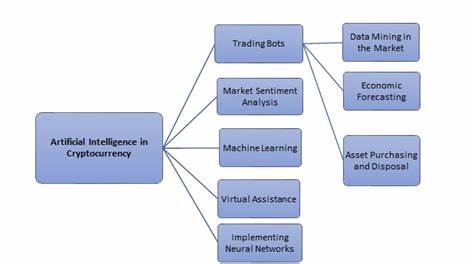

Solche Verwendungen können nicht nur den Ruf der Schauspieler schädigen, sondern auch ihre persönliche Integrität untergraben. Synthesias Rolle in der KI-Avatar-Industrie Eines der marktführenden Unternehmen im Bereich der KI-Gesichtsavatare ist die britische Firma Synthesia, die sich mit Investitionen und Partnerschaften, wie der 2-Milliarden-Dollar-Kooperation mit Shutterstock, stark vergrößert hat. Synthesia bietet sogar ein Beteiligungsmodell an, bei dem populäre Schauspieler Aktienoptionen im Wert von bis zu einer Million Dollar erhalten können. Dies zeigt, dass das Unternehmen bemüht ist, Talente nicht nur als einfache Lieferanten von Digitalbildern zu sehen, sondern ihnen auch eine wirtschaftliche Perspektive zu eröffnen. Dennoch gibt selbst Synthesia zu, dass nicht alle problematischen Inhalte vollständig kontrollierbar sind.

Trotz umfangreicher Moderationssysteme setzten sich Inhalte durch, die zum Beispiel politisch umstrittene Figuren in ein positives Licht rückten – eine Entwicklung, die außerhalb des Einflussbereichs der Avatare liegt, aber dennoch ihre digitale Identität betroffen macht. Die ethischen Herausforderungen und das Spannungsfeld zwischen Technologie und Persönlichkeit Der Verkauf von Gesichtsdaten an KI-Firmen wirft eine fundamentale ethische Frage auf: Wie viel Kontrolle soll eine Person über ihr digitales Ebenbild behalten, wenn es erst einmal reproduziert wurde? Schutzrechte wie das Recht am eigenen Bild und die Privatsphäre geraten in Konflikt mit der wirtschaftlichen Nutzung und den technologischen Möglichkeiten. Die meisten Schauspieler unterschätzen, wie weitreichend und irreversibel die Verwendung ihrer Avatare sein kann. Die Praxis, Verträge mit großzügigen Nutzungs- und Verwertungsrechten abzuschließen, gleicht häufig einem Risiko ohne Rücktrittsoption. Die Sorge vor einem Verlust von Authentizität und Identität ist für viele Künstler existenziell.

Ihr digitales Doppelgänger kann in Werbekampagnen eingesetzt werden, die der persönliche Überzeugung widersprechen oder gar illegalen Aktivitäten Vorschub leisten. Dass diese Avatare nicht als eigene Entität wahrgenommen werden können, verstärkt die emotionale Belastung, da der Schauspieler faktisch eine Version seiner selbst mitentscheidungsfrei „verleiht“. Chancen und Risiken der KI-Avatare am Arbeitsmarkt Aus ökonomischer Sicht sind KI-Avatare einerseits ein neues Geschäftsmodell, das zusätzliche Einkommensquellen für Schauspieler eröffnen kann – vor allem in einer Branche, die von Prekarität geprägt ist. Sie können eine Möglichkeit darstellen, mehr Aufträge zu generieren oder passives Einkommen zu erzielen, wenn ihr digitales Ebenbild für diverse Produktionen genutzt wird. Auf der anderen Seite steigt die Angst vor der eigenen Ersetzbarkeit.

KI kann leicht und kostengünstig virtuelle Darsteller produzieren, was langfristig das tatsächliche Schauspielengagement gefährdet. Das Gleichgewicht zwischen technologischem Fortschritt und Schutz individueller Rechte steht somit unter erheblichem Druck. Synthesias Ansatz, mittels Talentprogrammen die Mitbestimmung von Schauspielern zu fördern und Opt-out-Mechanismen einzuführen, ist ein Schritt in die richtige Richtung. Doch viele Videos und Inhalte, die bereits digital veröffentlicht sind, können nicht mehr zurückgerufen werden, was den Schutz der Betroffenen erschwert. Zukunftsperspektiven und rechtliche Rahmenbedingungen Die Gesetzgebung versucht auf diesem neuen Terrain Schritt zu halten.

In Deutschland und der EU gelten starke Datenschutzbestimmungen und Persönlichkeitsrechte, die grundsätzlich auch digitale Duplikate abdecken sollten. In der Praxis sind die Regularien jedoch oft hinter der rasanten Entwicklung der KI-Technologie zurück. Es besteht dringender Bedarf an verbindlichen Standards, die sowohl den Schutz der Betroffenen als auch die wirtschaftliche Nutzung der Technologie ermöglichen. Vertragsgestaltung mit klaren Limitierungen sowie transparente Informationspflichten für Schauspieler können dazu beitragen, Fehlentscheidungen zu vermeiden. Gleichzeitig fordert die öffentliche Debatte eine ethische Nutzung von KI-Avataren, damit die Technologie nicht zum Werkzeug von Betrug, Desinformation oder Propaganda wird.