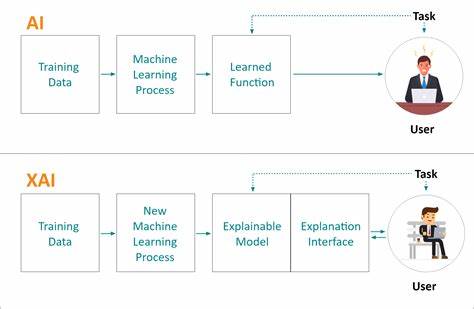

In der heutigen digitalen Welt spielt Künstliche Intelligenz (KI) eine bedeutende Rolle in unterschiedlichen Lebensbereichen, von der Medizin über Finanzwesen bis hin zu sozialen Netzwerken. Die Transparenz und Nachvollziehbarkeit von KI-Entscheidungen sind dabei essenziell, damit Nutzer das Vertrauen in die Technologien behalten. Genau hier setzt die Disziplin der erklärbaren Künstlichen Intelligenz (Explainable AI, XAI) an, die darauf abzielt, die internen Entscheidungsprozesse von KI-Systemen verständlich und nachvollziehbar zu machen. Traditionell wurden Erklärungen vor allem auf rationale Anwender ausgerichtet, die Informationen analytisch aufnehmen und bewerten. Doch menschliche Wahrnehmung ist komplexer, insbesondere wenn Emotionen ins Spiel kommen.

Das emotionale Erleben beeinflusst maßgeblich, wie Erklärungen wahrgenommen, verarbeitet und letztlich akzeptiert werden. Das emotion-sensitive Erklärungsmodell bringt daher einen neuen, zukunftsweisenden Ansatz in der Human-Computer-Interaktion, indem es emotionale Zustände der Nutzer berücksichtigt und so die Effektivität von Erklärungen signifikant erhöht. Emotionen als zentrale Einflussgröße Emotionen sind grundlegend für menschliches Verhalten und Denken. Sie beeinflussen die Aufnahme von Informationen, die Gedächtnisbildung und selbst Entscheidungsprozesse. Während frühere Ansätze in der erklärbaren KI oft Emotionen ignoriert haben, zeigen neuere Studien, dass emotionale Zustände wie Frustration, Angst oder Begeisterung das Verständnis von KI-Erklärungen stark verändern können.

Nutzer, die emotional erregt oder gestresst sind, können Schwierigkeiten haben, rationale Argumente nachzuvollziehen oder komplexe Inhalte zu verarbeiten. Das führt zu vermindertem Vertrauen und Akzeptanz gegenüber KI-Systemen und erhöht das Risiko von Fehleinschätzungen. Das emotion-sensitive Erklärungsmodell adressiert diese Herausforderungen durch einen dreistufigen Prozess, der emotionale Erregung, Verstehen und Übereinstimmung miteinander verknüpft. Diese Struktur ermöglicht eine adaptive Interaktion, bei der Erklärungen auf den emotionalen Zustand der Nutzer dynamisch angepasst werden, um maximale Verständlichkeit und Akzeptanz zu gewährleisten. Die drei Phasen des Modells Die erste Phase ist die emotionale oder epistemische Erregung.

Hierbei werden die emotionalen Zustände der Nutzer erfasst, zum Beispiel durch Sensorik oder Verhaltensindikatoren. Diese Informationen sind essenziell, um die Reaktion des Nutzers auf die bevorstehende oder bereits gelieferte Erklärung einschätzen zu können. Emotionale Erregung kann sowohl positiv (Neugier, Freude) als auch negativ (Ärger, Angst) sein und beeinflusst maßgeblich die kognitive Verarbeitung. Die zweite Phase umfasst das Verstehen. Nachdem das emotionale Eingangsbild erstellt ist, gilt es, die Erklärung so zu gestalten, dass sie trotz emotionaler Zustände möglichst gut aufgenommen werden kann.

Das bedeutet, Erklärungen müssen klar, prägnant und auf die individuellen Bedürfnisse des Nutzers abgestimmt sein. Adaptive Erklärungsstrategien könnten hier variieren: Bei hoher emotionaler Erregung könnten vereinfachte, empathische und beruhigende Erklärungen hilfreich sein, während bei neutralem emotionalem Zustand detailliertere und fachlich anspruchsvollere Erläuterungen möglich sind. Die dritte Phase ist die Übereinstimmung oder das Agreement. Das Ziel der Erklärung ist nicht nur Verständnis, sondern auch die Zustimmung und das Vertrauen der Nutzer. In dieser Phase wird überprüft, ob die Erklärung zu einer akzeptierten Sichtweise geführt hat.

Die Reaktion kann wiederum emotional gesteuert sein, und Feedback der Nutzer unterstützt die kontinuierliche Anpassung des Systems. Nur wenn Erklärungen von Nutzern angenommen werden, kann die KI nachhaltig und sinnvoll in Entscheidungsprozesse eingebunden werden. Bedeutung und Einsatzmöglichkeiten Das emotion-sensitive Erklärungsmodell eröffnet vielfältige Anwendungsmöglichkeiten in Bereichen, in denen Mensch und Maschine eng zusammenarbeiten. Besonders in sicherheitskritischen Feldern wie Medizin, Automobilindustrie oder Finanzsektor kann es helfen, Fehlentscheidungen zu reduzieren und das Vertrauen der Nutzer in automatisierte Systeme zu stärken. Beispielsweise kann ein Arzt, der von generierten Therapieempfehlungen emotional überwältigt ist, durch eine adaptiv formulierte Erklärung besser unterstützt werden, um rationale Entscheidungen zu treffen.

Darüber hinaus lässt sich das Modell auch in Kundenservice-Systemen oder Bildungstechnologien einsetzen. Emotionen beeinflussen hier maßgeblich die Nutzerzufriedenheit und Lernleistung. Ein System, das erkennen kann, wann ein Nutzer beispielsweise frustriert oder überfordert ist, kann Erklärungen daraufhin anpassen und so die Interaktion angenehmer und effektiver gestalten. Technologische Herausforderungen Die Umsetzung eines emotionssensitiven Erklärungsmodells verlangt den Einsatz moderner Techniken zur Emotionserkennung, sei es durch Gesichtsausdrucksanalyse, Stimmerkennung oder Verhaltensanalyse. Dazu kommen Herausforderungen bei der Entwicklung von Erklärungsstrategien, die in Echtzeit an Emotionen angepasst werden können, ohne die kognitiven Ressourcen der Nutzer zu überfordern.

Auch Datenschutz und ethische Fragen spielen eine Rolle, da die Erfassung emotionaler Daten sehr sensibel ist. Zukunftsperspektiven Die Kombination von emotionaler Wahrnehmung und erklärbarer KI ist ein vielversprechendes Forschungsfeld, das noch intensiv erforscht wird. Künftige Systeme könnten nicht nur auf derzeitige emotionale Zustände reagieren, sondern auch proaktiv auf die psychologische Verfassung von Anwendern eingehen, um kontinuierlich unterstützend zu wirken. Eine enge Verzahnung mit psychologischen Modellen und Human Factors wird dafür ebenso wichtig sein wie technologische Innovationen. Zusammenfassung Das emotion-sensitive Erklärungsmodell markiert einen Paradigmenwechsel in der Entwicklung erklärbarer KI-Systeme hin zu stärker nutzerzentrierten Ansätzen.

Durch die Berücksichtigung emotionaler Faktoren wird nicht nur das Verstehen verbessert, sondern auch die Akzeptanz und das Vertrauen in KI-Anwendungen gesteigert. Dies ist essenziell, um die breite Akzeptanz und erfolgreiche Implementierung intelligenter Systeme in vielen Lebensbereichen zu gewährleisten. Die Forschung hat hier einen wichtigen Schritt gemacht, der die Brücke zwischen technischer Innovation und menschlicher Bedürfnisorientierung schlägt und somit die Interaktion mit KI menschlicher, empathischer und effektiver gestaltet.