Die Erforschung der Mechanismen, mit denen das menschliche Gehirn lernt, zählt zu den faszinierendsten und komplexesten Gebieten der Wissenschaft. In den letzten Jahrzehnten hat die Schnittstelle zwischen künstlicher Intelligenz (KI) und Neurowissenschaften immer mehr an Bedeutung gewonnen. Insbesondere KI-Forscher entwickeln neue Theorien, die tiefere Einblicke in das Lernverhalten des Gehirns geben und gleichzeitig das Potenzial besitzen, die Technologie der künstlichen neuronalen Netzwerke entscheidend voranzutreiben. Diese Forschungsansätze verändern nicht nur das Verständnis unseres eigenen Denkorgans, sondern eröffnen zugleich neue Wege in der Entwicklung intelligenter Maschinen. Die Herausforderung besteht für Wissenschaftler darin, geeignete Methoden zu finden, um diese Theorien experimentell im biologischen Gehirn zu testen und so die Brücke zwischen künstlichem und natürlichem Lernen zu schlagen.

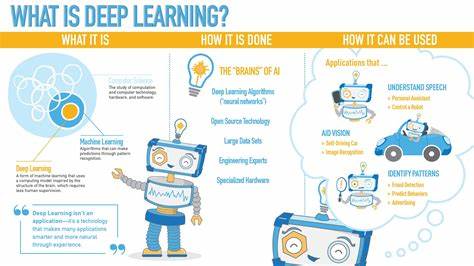

Ein prominenter Vorreiter auf dem Gebiet ist Geoffrey Hinton, oft als der „Godfather“ der KI bezeichnet. Hinton und sein Team von der University of Toronto legten mit ihrer Arbeit die theoretische Grundlage für heutige neuronale Netzwerke, die viele Anwendungen beherrschen – von Chatbots wie ChatGPT über die medizinische Bildanalyse bis hin zu selbstfahrenden Autos. Für Hinton war die Entwicklung besserer KI-Modelle nie nur ein technologisches Ziel. Vielmehr motivierte ihn die Hoffnung, durch künstliche Lernmodelle mehr über das Gehirn selbst zu erfahren. Die neuronalen Netzwerke in Computern stellen nämlich vereinfachte Versionen der biologischen Netzwerke im Gehirn dar.

Doch trotz aller Gemeinsamkeiten bleibt nach wie vor vieles unbekannt darüber, wie das Gehirn tatsächlich Informationen verarbeitet und Wissen erwirbt. Ein wesentlicher Fortschritt in der KI-Forschung war die Methode des sogenannten Backpropagation-Verfahrens. Dieses Verfahren ermöglicht es künstlichen Netzwerken, Fehler rückwärts durch das Netzwerk zu übertragen und so schrittweise die Verbindungen zu optimieren. Obwohl Backpropagation in der KI extrem erfolgreich ist, ist es in der Biologie des Gehirns nur schwer vorstellbar, dass dieselbe Methode auf dieselbe Weise stattfindet. Deshalb suchen Forscher nach neuen Theorien und biologisch plausiblen Modellen, die erklären könnten, wie Lernprozesse auf neuronaler Ebene ablaufen.

Die derzeitige Forschung zielt darauf ab, die Lücke zwischen künstlichen Lernverfahren und biologischen Lernmechanismen zu schließen. Einige neuere Konzepte beschäftigen sich mit lokaleren Lernregeln im Gehirn, die ohne globales Fehler-Signaling funktionieren, wie es das Backpropagation-Verfahren erfordert. Das bedeutet, dass Neuronen auf Grundlage ihrer unmittelbaren Umgebung und Interaktionen lernen, ohne dass ein zentraler Fehlerwert an alle beteiligt Neuronen weitergeleitet wird. Dafür könnten zum Beispiel Mechanismen wie synaptische Plastizität und spike-timing-dependent plasticity (STDP) verantwortlich sein. Diese Prozesse ermöglichen es einzelnen Synapsen, ihre Stärke anzupassen abhängig von der zeitlichen Abfolge von neuronalen Signalen.

Solche Ansätze versprechen, tatsächliche biologische Lernprozesse besser widerzuspiegeln und erklären, warum das Gehirn so flexibel und effizient lernt, trotz der komplexen und dezentralen Natur seiner Architektur. Die neue Generation von Theorien betrachtet auch den Einfluss von Feedbackschleifen und rekurrenten Verbindungen, die im Gehirn allgegenwärtig sind. Anders als in typischen Vorwärtsnetzwerken der KI, in denen Informationen nur nach vorne fließen, ermöglichen rekurrente Netzwerke, dass Signale an vorherige Schichten zurückgesendet werden und so Kontext und Erinnerung einbezogen werden. Dadurch wird das Lernen kontextabhängiger und dynamischer, was besonders bei komplexen Aufgaben, die zeitliche Abhängigkeiten beinhalten, entscheidend ist. Diese Erkenntnis trägt dazu bei, Modelle zu entwickeln, welche die Gedächtnisbildung, Problemlösung und Sprachverarbeitung im Gehirn besser abbilden.

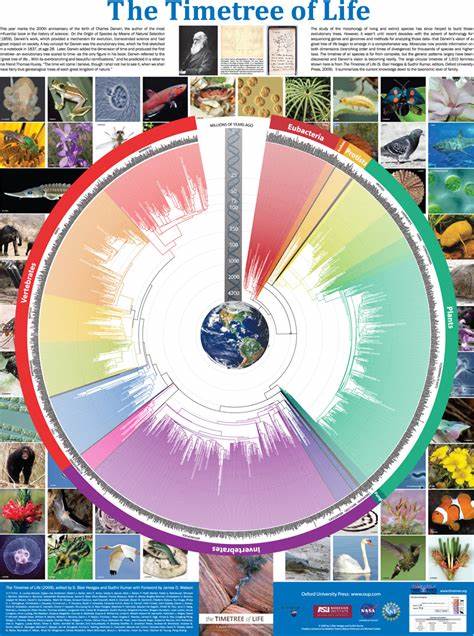

Ein weiterer spannender Aspekt betrifft die Rolle von genetischen und umweltbedingten Faktoren beim Lernen. Moderne KI-Modelle versuchen zwar, das Lernen rein durch Erfahrungen zu erklären, doch das Gehirn wird auch stark durch biologische Anlagen geprägt. Forschungen kombinieren zunehmend neuronale Simulationen mit genetischen Studien, um zu verstehen, welchen Einfluss diese Faktoren auf die Lernfähigkeit, die Plastizität und die neuronale Vernetzung haben. Dieses integrative Verständnis könnte nicht nur neue Wege im Bereich der personalisierten Medizin eröffnen, sondern auch helfen, intelligente Systeme zu schaffen, die besser auf individuelle Anforderungen anpassbar sind. Die experimentelle Verifizierung der neuen Theorien ist für Neurowissenschaftler eine enorme Herausforderung.

Die Komplexität und Feinheit neuronaler Netzwerke im lebenden Gehirn machen es schwierig, Lernprozesse in Echtzeit und mit der nötigen Auflösung zu beobachten. Fortschritte in bildgebenden Verfahren wie der funktionellen Magnetresonanztomographie (fMRT), Zwei-Photonen-Mikroskopie und optogenetischen Methoden ermöglichen zunehmend detaillierte Einblicke in neuronale Aktivität und Plastizität. Doch trotz dieser technologischen Errungenschaften bleibt das umfassende Verständnis neuronaler Lernprozesse ein ambitioniertes Ziel, das Jahrhunderte der Forschung beanspruchen könnte. Die Verbindung von KI-Forschung und Neurowissenschaft birgt auch ethische und gesellschaftliche Implikationen. Wenn immer genauere Modelle des Gehirns entwickelt werden, stellt sich die Frage, wie diese Erkenntnisse verantwortungsvoll eingesetzt werden.

Dies gilt sowohl für medizinische Anwendungen, die neurologische Erkrankungen heilen oder ihren Verlauf abbremsen könnten, als auch für die Entwicklung autonomer Systeme, die immer menschenähnlichere Fähigkeiten besitzen. Eine transparente und ethisch reflektierte Forschung ist deshalb unverzichtbar, um den Nutzen für die Gesellschaft zu maximieren und Risiken zu minimieren. Zusammenfassend lässt sich feststellen, dass die Forschung an neuen Theorien darüber, wie das Gehirn lernt, sowohl die Grundlagenforschung als auch die angewandte KI vorantreibt. Die Wechselwirkung zwischen künstlichen neuronalen Netzwerken und biologischen Modellen verspricht, das Verständnis von Intelligenz und Lernen grundlegend zu erweitern. Noch sind viele Fragen offen, doch die Fortschritte der letzten Jahre machen deutlich, dass wir uns in einer spannenden Phase befinden, in der Wissenschaft und Technologie gemeinsam neue Horizonte erschließen.

Die kommenden Jahre werden zeigen, wie diese innovativen Ansätze das Bild des menschlichen Gehirns und die Welt der KI weiter transformieren werden.