Die rasante Entwicklung der Künstlichen Intelligenz (KI) revolutioniert viele Bereiche unseres Lebens – und leider auch die Methoden von Cyberkriminellen. Insbesondere bei der Erstellung und Verbreitung von Phishing- und Scam-E-Mails zeigt sich ein besorgniserregender Trend: KI-gestützte Tools erzeugen zunehmend ausgefeilte, nahezu fehlerfreie E-Mails, die es Empfängern extrem schwer machen, betrügerische Nachrichten von echten Absendern zu unterscheiden. Diese Entwicklung stellt nicht nur Privatpersonen, sondern vor allem Unternehmen vor große Herausforderungen im Bereich der IT-Sicherheit. Historisch gesehen waren Phishing-Mails oft leicht zu erkennen. Auffällige Rechtschreibfehler, merkwürdige Satzstrukturen oder kaum authentisch wirkende Absenderadressen gaben Hinweise auf einen Betrugsversuch.

So konnten geschulte Nutzer oder auch einfache Filter die meisten dieser Mails relativ zuverlässig aussortieren. Jedoch hat sich die Situation in den letzten Jahren grundlegend verändert. Moderne KI-Modelle wie ChatGPT oder andere Textgenerierungsprogramme erlauben es Betrügern, qualitativ hochwertige, natürliche und präzise formulierte Nachrichten zu erstellen, die kaum von echten, professionellen Kommunikationsmitteln großer Unternehmen oder Institutionen zu unterscheiden sind. Die bisherigen Schutzmechanismen greifen daher nicht mehr in dem Maße wie früher. Die automatischen Spamfilter stoßen an ihre Grenzen, wenn die Texte geschliffen wirken und die Absenderadressen so gewählt sind, dass sie täuschend echt erscheinen.

Kriminelle verwenden zudem sogenannte Lookalike-Domains, also Internet-Adressen, die echten URLs sehr ähnlich sehen – beispielsweise mit veränderten Buchstaben, die vom menschlichen Auge schnell übersehen werden. In Kombination mit einer Konversation, die scheinbar aus einem bestehenden E-Mail-Verlauf hervorgeht, erscheint die Täuschung so glaubwürdig, dass selbst erfahrene Nutzer auf dem falschen Fuß erwischt werden können. Ein weiterer Aspekt, der die Bedrohung verstärkt, ist die Internationalisierung des Phishing durch KI. Früher war das Verfassen von überzeugenden E-Mails in anderen Sprachen für Kriminelle mit Sprachbarrieren eine große Hürde. Übersetzungsprogramme wie Google Translate waren zwar eine Hilfe, erzeugten aber oft holprige und unnatürliche Texte, die schnell verdächtig wirkten.

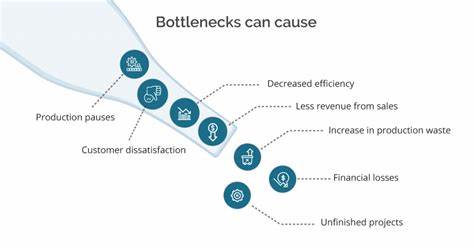

Heute erlaubt KI es Kriminellen, in nahezu jeder Sprache fehlerfreie, stilistisch passende und kontextuell korrekte Phishing-Nachrichten zu generieren. Das erschwert die Erkennung erheblich, gerade in kleineren Sprachräumen, die bisher als weitgehend sicher galten. Ein Beispiel hierfür ist der isländische Sprachraum, der durch die geringere Anzahl an Sprechern bislang weniger im Fokus von Scammern stand. Dank KI-betriebener Textgeneratoren hat sich diese Situation nun drastisch verändert. Die finanziellen Folgen dieser Entwicklung sind gravierend.

Laut FBI-Schätzungen haben Cyberkriminelle allein im letzten Jahr Schäden in Höhe von rund 16,6 Milliarden US-Dollar durch E-Mail-basierte Betrugsversuche verursacht. Diese immens hohen Verluste unterstreichen die Dringlichkeit, neue Verteidigungsstrategien zu entwickeln, die den technischen Fortschritt der Angreifer angemessen begegnen. Eine wichtige Erkenntnis von Experten ist, dass die Sensibilisierung der Nutzer für visuelle Auffälligkeiten oder sprachliche Fehler nicht mehr ausreicht. Die früher typischen Warnsignale sind durch die KI-Perfektionierung so gut wie verschwunden. Vielmehr muss ein neues Bewusstsein entstehen, das auf „höflicher Paranoia“ basiert: Empfänger sollten im Zweifel verdächtige Nachrichten strikt verifizieren, etwa durch einen direkten Anruf beim vermeintlichen Absender oder Rückfragen über andere Kommunikationswege.

Zudem gewinnt der Einsatz technischer Schutzmaßnahmen an Bedeutung. Passwortmanager und die konsequente Nutzung von Mehrfaktor-Authentifizierung bieten wichtige Schutzschichten, um das Eindringen durch kompromittierte Zugangsdaten zu erschweren. Gleichzeitig arbeiten Unternehmen daran, KI-gestützte Lösungen zu implementieren, die in Echtzeit eingehende Mails auf verdächtige Muster, unübliche Absenderadressen oder Abweichungen im Kommunikationsverhalten analysieren können. Diese proaktiven Defensivelemente sind entscheidend, um Phishing-Kampagnen bereits vor dem Erreichen der Benutzerpostfächer zu unterbinden. Die Präzision und Geschwindigkeit, mit der KI-Tools arbeiten, ermöglichen es Kriminellen besonders effektive Angriffe gegen Großkonzerne durchzuführen.

So können in kurzer Zeit detaillierte Profile von Zielpersonen innerhalb von Unternehmen erstellt werden. Anschließend generiert die KI anhand dieser Daten hochpersonalisierte E-Mails, die so wirken, als kämen sie von Vertrauenspersonen, Kollegen oder Vorgesetzten. Solche zielgerichteten Attacken, auch als Spear Phishing bezeichnet, sind weitaus erfolgreicher als breit gestreute, unpersönliche Nachrichten und erfordern spezielle Schutzmechanismen sowie eine hohe Aufmerksamkeit bei den Angestellten. Doch die Bedrohung endet nicht bei Text-E-Mails. Inzwischen sind Phishing-Angriffe auch in erweiterten Formen zu beobachten: KI-Technologien ermöglichen zunehmend das Erzeugen von täuschend echten Deepfake-Stimmen und sogar Video-Clips.

Dies hat bereits dazu geführt, dass Betrüger mit synthetischen Stimmen Senior-Führungskräfte oder Behördenvertreter imitieren, um Mitarbeiter oder Geschäftspartner zu manipulieren. Die Vorstellung, dass man künftig Geheimcodes austauschen oder sich speziell verifizierende Rituale vor Videokonferenzen einrichten muss, klingt zwar futuristisch, kann jedoch künftig zur Alltagspraxis werden. Vor diesem Hintergrund lassen sich einige wichtige Handlungsfelder für eine wirksame Gegenwehr definieren. Unternehmen sollten ihre Sicherheitsstrategie ständig an den schnelllebigen Wandel anpassen und neben technischen Lösungen besonderes Augenmerk auf Schulungen der Mitarbeiter legen. Hierbei geht es nicht mehr nur um grundsätzliche Awareness, sondern um die Vermittlung von konkreten Verifikationsmethoden und dem korrekten Umgang mit verdächtigen Nachrichten.

Darüber hinaus ist die Zusammenarbeit mit IT-Sicherheitsanbietern, die KI-gestützte Erkennungssysteme entwickeln, essenziell. Diese Systeme lernen kontinuierlich, neue Phishing-Techniken zu identifizieren und können somit die Flut gefährlicher Mails im Unternehmen stark reduzieren. Auch die globale Vernetzung von Behörden und Unternehmen zur Bekämpfung von betrügerischen Domains und IP-Adressen kann diese Bedrohung eindämmen. Für Endnutzer gilt, dass ganz einfache Sicherheitsmaßnahmen wie das Hinzuschalten von Zwei-Faktor-Authentifizierung, der Einsatz von sicheren Passwortmanagern und der bewusste Umgang mit E-Mail-Inhalten den Rückgriff auf neue Technologien unterstützen und Risiken minimieren. Skepsis sollte angesichts der perfiden KI-generierten Nachrichten stets vorhanden sein – mit dem Ziel, nicht aus Angst, sondern durch verantwortungsvolles Verhalten Schaden zu vermeiden.

Insgesamt zeigt sich, dass die Macht der Künstlichen Intelligenz im Bereich der Cyberkriminalität eine neue Ära eingeleitet hat. Während KI einerseits enorme Chancen bietet, um Arbeitsprozesse zu erleichtern und Kommunikation zu verbessern, so nutzen Kriminelle diese Technologien, um ihre Methoden zu verschleiern und zu verfeinern. Die traditionelle Abwehr gegen Phishing reicht nicht mehr aus. Es bedarf eines Umdenkens, eines Zusammenspiels von Technik, Aufklärung und Wachsamkeit, um die digitale Sicherheit aufrechtzuerhalten. Die kommenden Jahre werden entscheidend sein, wie gut Gesellschaft, Wirtschaft und Politik auf diese Herausforderung reagieren.

Nur mit innovativen Sicherheitskonzepten, dem verantwortlichen Umgang mit KI und einer informierten Bevölkerung lässt sich der Schaden durch technisch perfektionierte Scam-Mails begrenzen. Die digitale Welt steht an einem Scheideweg – und der Schutz vor KI-gestütztem Phishing ist eine der zentralen Aufgaben unserer Zeit.