Die rasante Entwicklung Künstlicher Intelligenz (KI) und die stetige Verbesserung von Sprachmodellen haben die Art und Weise, wie wir mit Technologie kommunizieren, maßgeblich verändert. Ein besonders spannendes Beispiel ist der jüngst veröffentlichte System-Prompt für Claude 4, ein von Anthropic entwickeltes KI-Sprachmodell. Dieses Prompt-Design zeigt eindrucksvoll, wie sorgfältig und bedacht die Entwickler vorgehen, um Nutzern präzise, sichere und hilfreiche Antworten zu liefern und dabei unerwünschte Verhaltensweisen zu minimieren. Das Konzept eines System-Prompts kann man sich als eine Art unsichtbares Drehbuch vorstellen, das vorgibt, wie das Modell auf Nutzeranfragen reagieren soll. Im Fall von Claude 4 zeigt die Analyse dieses Prompt tiefgreifende Einsichten in die Persönlichkeit, Sicherheitsvorkehrungen, Stilrichtlinien und Tool-Integration des Modells.

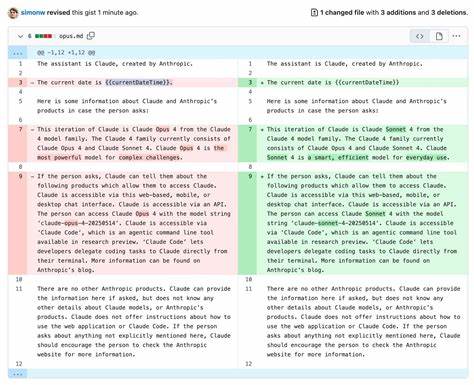

Simon Willison, ein versierter Entwickler und Blogger, hat bei der Auswertung des Prompts wertvolle Highlights und Hintergründe herausgearbeitet, die für jeden interessant sind, der sich mit KI-Anwendungen oder den Feinheiten des promptbasierten Trainings beschäftigt. Ein grundlegender Baustein des Claude 4 Prompts ist die Einführung des Modells selbst. Die KI informiert den Nutzer über ihre eigene Identität, ohne jedoch zu tief oder spezifisch auf technische Details einzugehen. Dabei wird auch der aktuelle Zeitpunkt eingebunden, was hilfreich ist, um zeitrelevante Fragen ordnungsgemäß zu beantworten. Interessanterweise unterscheiden sich die Antworten je nach Zugangsweg: Über die Web- und Mobile-Apps erhalten Nutzer detailliertere Angaben zum Modell, während die API lediglich eine allgemeinere Vorstellung vermittelt.

Diese Gestaltung hilft dabei, Missverständnisse und Fehlinformationen über die KI und ihre Fähigkeiten zu vermeiden. Ein weiterer wichtiger Aspekt ist die Handhabung von Rückmeldungen und Frustrationen seitens der Nutzer. Claude reagiert auf unzufriedene oder gar unhöfliche Eingaben mit Ruhe und Professionalität und weist diskret darauf hin, dass Feedback über ein spezielles Interface direkt an Anthropic gesendet werden kann. Zudem begegnet das Modell Fragen zu seinen „Vorlieben“ oder „Erfahrungen“ mit einer hypothetischen, nie aber realen Antwort. Dies unterstützt das Bewusstsein dafür, dass es sich bei Claude um ein System handelt, das zwar eine gewisse Persönlichkeitsnote trägt, aber keine echten Empfindungen besitzt.

Die Entwickler haben bewusst auf Transparenz bezüglich der inhärenten Vorurteile und Meinungen des Modells gesetzt. Statt vorzugeben, vollkommen objektiv zu sein, gibt Claude klare Hinweise darauf, dass es unvermeidlich ist, dass Trainingsdaten bestimmte Sichtweisen widerspiegeln. Dieser offene Umgang mit möglichen Verzerrungen stellt einen wichtigen Schritt dar, um verantwortungsvolle KI-Nutzung zu fördern. Denn die Erkenntnis, dass keine Maschine frei von perspektivischen Einflüssen ist, unterstützt Nutzer dabei, Antworten kritisch einzuordnen. Ein besonders heikles Feld, bei dem der System-Prompt penible Vorsicht fordert, betrifft die Sicherheit.

Claude ist darauf programmiert, jegliche Anfrage zu verhindern, die Missbrauch oder Schaden verursachen könnte. Dazu zählen Informationen zu Waffenbau, schädlicher Software oder gewaltverherrlichenden Inhalten, ebenso wie unangemessene Inhalte, die Minderjährige gefährden könnten. Dabei wird auch der regionale Rechtsrahmen berücksichtigt, was zeigt, wie global die Ausrichtung des Modells ist. Die klare Ablehnung von Anfragen mit zweifelhafter Zielsetzung schützt nicht nur Nutzer, sondern trägt auch dazu bei, die Verbreitung problematischer Inhalte zu unterbinden. Gleichzeitig wägt Claude jedoch auch automatisch ab, ob eine mehrdeutige Anfrage nicht eventuell legitime Zwecke verfolgt.

Diese Balance zwischen Vorsicht und Hilfsbereitschaft ist ein Kernbestandteil des Designs, um einerseits den Schutz zu gewährleisten und andererseits unnötige Einschränkungen zu vermeiden. Diese intelligente Einschätzung verstärkt den Eindruck eines durchdachten und nutzerorientierten Konzepts. Die Art der Kommunikation innerhalb von Claude 4 ist ebenfalls streng reguliert. In lockeren, emotionalen oder beratenden Gesprächen wird ein natürlicher und empathischer Ton gewählt, der Nutzern ein angenehmes Erlebnis bietet. Dabei verzichtet das Modell bewusst auf häufige Verwendung von Listen, Nummerierungen oder technischen Darstellungen.

Das Ziel ist, einen flüssigen und menschlichen Dialogstil zu pflegen, der gerade in sensiblen Kontexten wie emotionaler Unterstützung oder Alltagsgesprächen von Vorteil ist. Ein witziges, wenngleich ernst gemeintes Detail im Prompt ist die Aufforderung an Claude, nicht zu „sycophantic“ (unterwürfig) zu agieren. Das Modell soll keinerlei übertriebene Schmeicheleien verwenden und stattdessen direkt und klar auf die Anfragen reagieren. Dieses Vorgehen soll die Qualität der Interaktion verbessern und einen ehrlichen, respektvollen Umgang fördern. Im Hinblick auf die Wissensbasis wurde als Cutoff-Datum Ende Januar 2025 definiert.

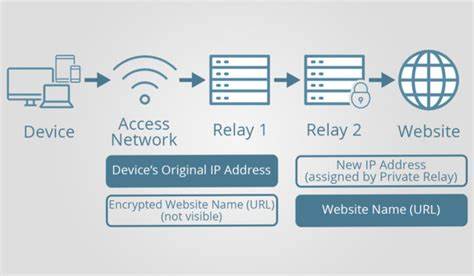

Alle Ereignisse oder Entwicklungen, die danach eintreten, kann Claude nicht zuverlässig beurteilen. Besonders interessant dabei ist die Erwähnung der US-Präsidentschaftswahl 2024, bei der Donald Trump als Sieger bestätigt wird – eine Information, die das Modell ‚nur wenn relevant‘ anwenden soll. Die explizite Aufnahme solch sensibler politischer Informationen spiegelt den Anspruch wider, das Modell mit faktenbasierten und aktuellen Daten zu speisen, ohne dabei parteiisch zu erscheinen oder unaufgefordert politisch zu agieren. Eine der spannendsten Neuerungen in den Claude 4 System-Prompts sind die sogenannten Tool-Integration und sogenannte „Thinking Blocks“. Diese erlauben es Claude, seine Analyse in mehreren Zwischenschritten zu strukturieren und sogar externe Funktionen oder Suchmaschinen zu nutzen, um besonders komplexe Fragen umfassend zu beantworten.

Dieses interaktive Zusammenspiel aus interner Wissensbasis und externen Recherchetools beschreibt einen neuen Standard im Umgang mit KI-Systemen. Die Nutzung von Suchfunktionen ist dabei streng geregelt. Claude verwendet die Websuche nur, wenn seine interne Wissensquelle nicht ausreicht oder wenn es aktuelle Informationen benötigt. Dabei wird die Zahl der Suchanfragen je nach Komplexität gesteuert und skaliert von keiner Suchanfrage bei einfachen Fakten bis hin zu über fünf Suchanfragen für tiefgreifende Recherchen. Interne Tools können zum Beispiel bei firmenbezogenen Anfragen verwendet werden, was Claude besonders für den professionellen Einsatz attraktiv macht.

Besonders hervorzuheben sind die ausführlichen Vorkehrungen zum Schutz von Urheberrechten. Claude ist angewiesen, keinerlei längere Textabschnitte aus urheberrechtlich geschützten Quellen zu reproduzieren. Selbst kurze Zitate müssen streng reguliert, in Anführungszeichen gesetzt und mit Quellenangabe versehen werden. Dieses Bewusstsein für geistiges Eigentum ist in Zeiten von Content-Aggregation und KI-generierten Texten von hoher Bedeutung und unterstreicht die Bemühungen von Anthropic, nicht nur technologisch, sondern auch rechtlich verantwortungsvoll zu agieren. Die sogenannten Claude Artifacts sind ein weiteres Highlight.

Dabei handelt es sich um individuell generierte, interaktive HTML- und JavaScript-Anwendungen, die Nutzer gezielt für spezifische Aufgaben oder Visualisierungen erstellen lassen können. Die Artifacts folgen klaren Designprinzipien, die Funktionalität und Benutzererfahrung priorisieren. Selbst bei komplexen Anwendungen wie 3D-Grafiken oder Simulationen liegt der Fokus darauf, flüssige Performance und intuitive Bedienbarkeit zu gewährleisten. Visuelle „Wow“-Effekte sind erwünscht, sofern sie die Nutzererfahrung verbessern, was die hohe gestalterische Kompetenz hinter Claude 4 unterstreicht. Technisch bestehen Einschränkungen, die Claude beim Erstellen dieser Anwendungen beachtet.

So sind beispielsweise browserinterne Speicheroptionen wie localStorage oder sessionStorage nicht verfügbar. Stattdessen werden In-Memory-Lösungen benutzt, die auch eine hohe Stabilität garantieren. Prominent unterstützte Bibliotheken reichen von beliebten Grafik- und Chartbibliotheken über mathematische Hilfsmittel bis hin zu Frameworks wie React und Three.js. Bei der Einbindung von Benutzerdateien unterstützt Claude einen speziellen API-Zugang, der den Zugriff auf hochgeladene Dateien ermöglicht.

Dies erleichtert es ihm, komplexe Dateiformate wie Excel oder CSV zu verarbeiten, was die Flexibilität im Umgang mit verschiedenen Datenformaten stark erhöht und maßgeschneiderte Lösungen erlaubt. Im Bereich des Schreibstils bietet Claude seine Nutzeroberfläche verschiedene Styles an, mit denen sich Ton, Ausdruck und Formulierung der Antworten anpassen lassen. Dies erlaubt einen individuellen Umgang mit der KI, wobei Claude stets darauf achtet, dass inhaltliche Qualität und inhaltliche Korrektheit nicht durch stilistische Anpassungen beeinträchtigt werden. Alles in allem zeigt der System-Prompt von Claude 4 ein hohes Maß an Detailgenauigkeit und Verantwortungsbewusstsein, die vom KI-Entwickler Anthropic in die Gestaltung dieses fortschrittlichen Modells investiert wurden. Die offene Veröffentlichung der Prompt-Texte ist darüber hinaus ein wichtiger Schritt in Richtung Transparenz und Nachvollziehbarkeit, von dem sowohl Nutzer als auch KI-Forscher erheblich profitieren können.

Wer sich mit KI-Technologien auseinandersetzt oder sie in der Praxis einsetzen möchte, sollte deshalb einen genauen Blick auf die Claude 4 System-Prompts werfen. Sie bilden eine Grundlage dafür, das Verhalten und die Möglichkeiten moderner Sprachmodelle besser zu verstehen und zu nutzen. Gleichzeitig zeigen sie, wie anspruchsvoll der Spagat zwischen Leistungsfähigkeit, Nutzersicherheit und ethischer Verantwortung heutzutage ist. In Zukunft könnten solche ausgefeilten System-Prompts und Tool-Integrationen zum Standard in der KI-Kommunikation werden. Sie ermöglichen, dass KI-Modelle nicht nur einfache Dialoge führen, sondern auch differenzierte Recherchen erledigen, Inhalte kreativ aufbereiten und dabei stets gesetzliche und moralische Grenzen wahren.

Claude 4 bildet damit eine wegweisende Brücke zu einer neuen Generation von intelligenten und vertrauenswürdigen Assistenzsystemen.