Die Nutzung von Künstlicher Intelligenz (KI) im Alltag nimmt immer weiter zu, und ChatGPT gehört zweifellos zu den prominentesten Vertretern dieser Technologie. Ein besonders diskussionswürdiger Aspekt ist dabei der Umgang von ChatGPT mit zuvor geführten Unterhaltungen und gesammelten Erinnerungen. Die Frage, inwiefern ChatGPT die Fähigkeit besitzt, persönliche Daten und Chatverläufe zu speichern oder zu „dumpen“, wird von vielen Nutzern kritisch betrachtet. In diesem Zusammenhang gilt es, die technischen, datenschutzrechtlichen und praktischen Implikationen zu untersuchen, die an das Speichern und Abrufen von Chatverläufen geknüpft sind. Wie funktioniert die Datenspeicherung bei ChatGPT? Grundsätzlich arbeitet ChatGPT auf Basis eines großen neuronalen Sprachmodells, das während des Trainings umfangreiche Texte verarbeitet hat.

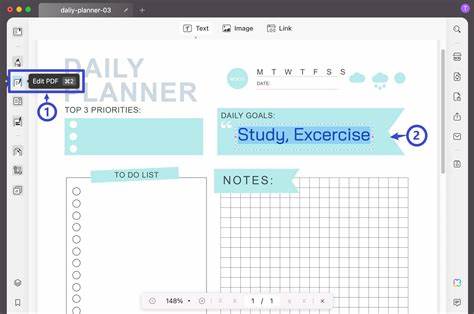

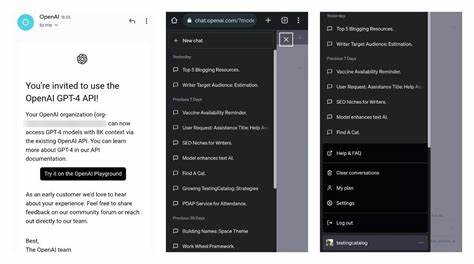

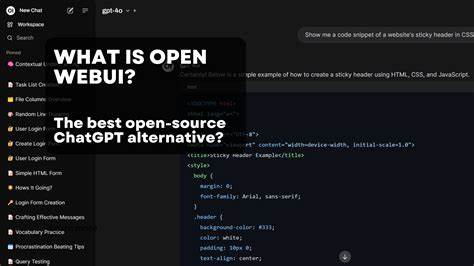

Die Plattform speichert jedoch nicht dauerhaft individuelle Nutzerinteraktionen, es sei denn, diese werden explizit für Datenanalysezwecke oder die Verbesserung des Modells genutzt. Einige Anbieter von Chatbots bieten es an, Chatverläufe zu speichern, um sie später abrufen zu können. Dabei haben Nutzer mitunter die Möglichkeit, ihre Gespräche zu exportieren oder einen sogenannten Dump ihrer Daten anzufordern. Diese Vorgehensweise kann hilfreich sein, wenn ein Nutzer seine vergangenen Unterhaltungen überprüfen oder kontrollieren möchte, welche Informationen der Chatbot über ihn gespeichert hat. Die Herausforderung liegt darin, dass nicht jedes KI-System dieselben Funktionen hinsichtlich Datenspeicherung und -zugriff bietet.

Datenschutz und Sicherheit Anwender sollten sich bewusst sein, dass persönliche Daten in Chatverläufen sehr sensibel sind. Das Speichern und Verarbeiten solcher Daten unterliegt daher strengen gesetzlichen Regelungen, insbesondere der Datenschutz-Grundverordnung (DSGVO) in Europa. Transparenz und informierte Einwilligung spielen eine zentrale Rolle. Nutzer müssen darauf hingewiesen werden, welche Daten gespeichert werden, zu welchem Zweck dies geschieht und wie sie ihre Daten einsehen, herunterladen oder löschen können. Ein weiteres Risiko besteht in der Möglichkeit von Datenlecks oder Missbrauch durch unbefugten Zugriff.

Deshalb ist die Sicherheit der Nutzerinformationen essenziell. Viele Unternehmen, die KI-Anwendungen betreiben, implementieren umfangreiche Schutzmaßnahmen, um das Risiko eines Datenverlustes möglichst gering zu halten. Außerdem werden häufig automatische Anonymisierungsverfahren eingesetzt, um personenbezogene Daten in Chatprotokollen zu entkoppeln. Warum ist der Zugriff auf Chatverläufe für Nutzer wichtig? Der Anspruch auf Transparenz und Kontrolle über die eigenen Daten wächst verständlicherweise bei immer mehr Anwendern. Der sogenannte „Dump“ aller eigenen Erinnerungen oder Chatverläufe ermöglicht eine detaillierte Einsicht darüber, wie der Chatbot mit den übermittelten Informationen umgegangen ist.

Auf diese Weise können Nutzer besser einschätzen, ob und in welchem Umfang Daten verwendet oder weiterverarbeitet wurden. Darüber hinaus unterstützt dieser Zugriff eine kritischere Haltung gegenüber der eigenen Datenspuren. Gerade im Bereich der Künstlichen Intelligenz, in dem Algorithmen oft als Blackbox angesehen werden, trägt die Einsicht in gespeicherte Daten zur Vertrauensbildung bei. Gleichzeitig erlaubt es Nutzern, Fehler zu korrigieren oder ungewollt preisgegebene Informationen gegebenenfalls zu entfernen. Die Rolle der KI-Erinnerungen bei der Personalisierung Der Zweck der Speicherung von Chatverläufen geht oft über die reine Dokumentation hinaus.

Chatbots wie ChatGPT nutzen vergangene Interaktionen, um zukünftige Antworten besser zu personalisieren. Wenn ein System beispielsweise schon über vorherige Vorlieben oder thematische Schwerpunkte informiert ist, kann es passgenauere und relevantere Antworten liefern. Diese Form der personalisierten KI-Kommunikation führt allerdings zu einer intensiveren Erfassung von Benutzerprofilen und Kommunikationsdaten. Diese profilenbasierte Anpassung kann den Komfort steigern, birgt aber gleichzeitig das Risiko von unerwarteten Datenverwendungen. Einige Anwender empfinden es als angenehm, vom System „wiedererkannt“ zu werden, andere lehnen ein solches Tracking strikt ab.

Zukünftige Entwicklungen und ethische Überlegungen Mit dem rapide voranschreitenden Fortschritt in der KI-Technologie wird auch die Diskussion um den verantwortungsvollen Umgang mit gespeicherten Kommunikationsdaten an Bedeutung gewinnen. Technische Innovationen könnten künftig noch komplexere Erinnerungen und Verlaufsanalysen erlauben, etwa durch die Kombination von Sprach- und Verhaltensdaten. Hier muss eine Balance zwischen Nutzen und Privatsphäre gefunden werden. Experten raten dazu, strikte Regularien zu etablieren und den Nutzern maximale Kontrolle über ihre Daten einzuräumen. Transparenzberichte, klare Datenschutzerklärungen und einfache Möglichkeiten zur Datenlöschung können dabei vertrauensbildende Maßnahmen darstellen.

Zudem wird die Frage, wie der gewünschte Datenschutz mit der Verbesserung von KI-Systemen über Datensammlung in Einklang gebracht werden kann, weiterhin eine zentrale Rolle spielen. Fazit Die Möglichkeit, Chatverlaufsdaten auszulesen oder einen Dump aller gespeicherten Erinnerungen anzufordern, ist für viele Nutzer ein essenzielles Werkzeug, um mehr Kontrolle und Transparenz im Umgang mit KI-gesteuerten Systemen wie ChatGPT zu gewinnen. Gleichzeitig stellen sich Herausforderungen hinsichtlich Datenschutz, technischer Umsetzung und ethischen Fragestellungen. Der verantwortungsvolle Umgang mit gespeicherten Daten wird die Akzeptanz und Zukunftsfähigkeit von KI-Anwendungen maßgeblich beeinflussen. Nutzer sollten sich daher stets über die jeweiligen Datenschutzrichtlinien informieren und gegebenenfalls vorhandene Exportfunktionen nutzen, um die Kontrolle über ihre Daten zu behalten.

Der Dialog zwischen Entwicklern, Nutzern und Regulierungsbehörden ist entscheidend, um eine vertrauensvolle KI-Kommunikationsumgebung zu schaffen, die sowohl Nutzen als auch Datenschutz in Einklang bringt.

![AWS introduces key committing variant of XAES-256-GCM [pdf]](/images/895A3C63-E750-428C-8A02-6CBF643B52D4)