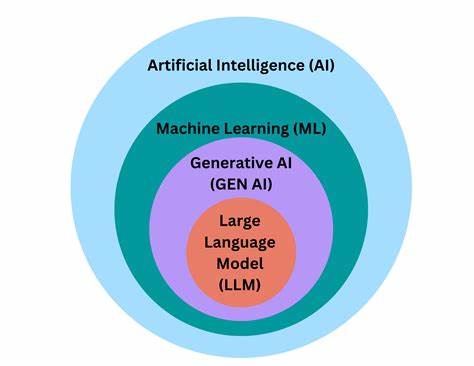

Die rasante Entwicklung im Bereich der Künstlichen Intelligenz führte zu bedeutenden Fortschritten bei großen Sprachmodellen, auch als Large Language Models (LLMs) bekannt, die heute vielfach für Aufgaben der Text- und Code-Generierung eingesetzt werden. Trotz dieser beeindruckenden Fortschritte kämpfen viele dieser Modelle weiterhin mit Problemen wie Halluzinationen – also der Generierung von falschen oder erfundenen Informationen – toxischen Inhalten oder schlichtweg fehlerhaften Ergebnissen. Genau hier setzt IterGen an, eine innovative Lösung, die speziell darauf ausgelegt wurde, die Qualität und Zuverlässigkeit der generierten Inhalte signifikant zu steigern. IterGen stellt dabei eine Weiterentwicklung traditioneller Methoden dar, indem es eine iterative, semantisch gesteuerte und strukturierte Generierung von Modellantworten samt effizientem Backtracking ermöglicht. Das bedeutet für Nutzer vor allem eine neue Art der Kontrolle und Fehlerkorrektur während des Entstehungsprozesses der Texte oder Codes, was bisherige, strikt lineare Ansätze erheblich erweitert.

Die Grundidee von IterGen besteht darin, die Generierung von Texten nicht nur als eine einfache fortlaufende Handlung von links nach rechts zu betrachten, sondern diesen Vorgang in eine strukturierte Interaktion einzubetten, die sich an formalen Grammatiken orientiert. Diese grammatikbasierte Steuerung erleichtert eine verständliche und nachvollziehbare Modellführung, was bei komplexeren Aufgaben wie der Programmcode-Erzeugung, SQL-Abfragen oder auch der Semantik-basierten Textgenerierung von immensem Wert ist. Eine zentrale technische Innovation von IterGen ist die Fähigkeit zum Backtracking, was in vielen traditionellen Modellen meist gar nicht oder nur sehr eingeschränkt möglich ist. Backtracking erlaubt es, Fehler oder unerwünschte Resultate frühzeitig zu erkennen und ohne vollständigen Neuanfang oder enorme Rechenaufwände gezielt zurückzugehen und an vorherigen Abschnitten Änderungen vorzunehmen. Ein weiterer technischer Baustein von IterGen ist die Nutzung eines sogenannten symbol-to-position Mappings.

Hiermit werden grammatikalische Symbole mit spezifischen Positionen innerhalb eines Programmcodes oder Textes verknüpft, was zusammen mit der Verwaltung des Key-Value (KV) Cache Zustands eine äußerst effiziente Handhabung der Modellkontexte sicherstellt. So können bereits generierte Teile gezielt neu adressiert werden, ohne dass bestehende Kontextinformationen verloren gehen oder komplett neu aufgebaut werden müssen. Besonders bei der Erstellung komplexer Abfragen, wie etwa in SQL oder bei der Visualisierungssprache Vega-Lite, ermöglicht dies, dass die Modelle weit präziser und fehlerresistenter arbeiten. In der praktischen Anwendung zeigt IterGen beeindruckende Resultate. Zum Beispiel konnte nachgewiesen werden, dass die Methode effektiv dazu beiträgt, die sogenannte Privacy Leakage zu reduzieren – das heißt, die ungewollte Offenlegung persönlicher oder sensibler Daten in den generierten Ergebnissen wird minimiert.

Durch die iterative Vorgehensweise und die Möglichkeit zum Backtracking lassen sich potenzielle Datenschutzprobleme frühzeitig erkennen und beheben, wodurch die Sicherheit und Vertrauenswürdigkeit der KI-Systeme erhöht wird. Auch die Genauigkeit der von LLMs erzeugten SQL- und Vega-Lite-Abfragen profitiert erheblich von IterGen. Diese Programmiersprachen zeichnen sich durch eine strenge Syntax und komplexe semantische Anforderungen aus, die für viele Modelle eine Herausforderung darstellen. IterGen unterstützt Entwickler nicht nur beim Erkennen und Korrigieren von Syntaxfehlern während der Generierung, sondern ermöglicht es auch, die semantische Logik durch gezielte grammatikalische Kontrollpunkte zu validieren und zu verfeinern. Dies führt zu stabileren, fehlerfreien und besser performenden Ergebnissen, was besonders in professionellen Datenbank- und Visualisierungsanwendungen einen großen Vorteil darstellt.

Der Nutzen von IterGen geht jedoch weit über technische Optimierungen hinaus. Die Benutzerfreundlichkeit der Bibliothek trägt dazu bei, dass auch Anwender ohne tiefe KI- oder Programmierkenntnisse von den Verbesserungen profitieren können. IterGen bietet eine intuitive Schnittstelle, die es ermöglicht, den Generierungsprozess aktiv zu steuern, Fehler schnell zu identifizieren und direkt zu korrigieren. Gerade im industriellen Kontext, wo Effizienz, Zuverlässigkeit und Sicherheit höchste Priorität haben, können solche Werkzeuge maßgeblich zur Produktivitätssteigerung und Fehlerreduktion beitragen. Die Erkenntnisse aus der Entwicklung und Anwendung von IterGen spiegeln zudem die zunehmende Bedeutung von kontrollierten und vertrauenswürdigen KI-Modellen wider.

Während die grundlegenden LLMs enorm leistungsfähig sind, zeigt sich immer stärker, dass reine Leistungssteigerungen allein nicht genügen, um praxistaugliche und sichere Anwendungen zu gewährleisten. Die Erweiterung um strukturierte, semantisch bewusste sowie überprüfbare Generationsprozesse mit Korrekturmöglichkeiten ist ein entscheidender Schritt in Richtung verantwortungsvolle KI-Nutzung. Aus wissenschaftlicher Perspektive stellt IterGen damit einen wichtigen Beitrag zum Feld der Software-Engineering-Methoden im Zusammenspiel mit maschinellem Lernen dar. Die Akzeptanz und Weiterentwicklung solcher hybriden Ansätze, die symbolische und neurale Methoden kombinieren, dürfte zukünftig eine entscheidende Rolle spielen. Die Veröffentlichung der Forschungsergebnisse und die Bereitstellung des Quellcodes fördern die Transparenz und ermöglichen eine breite Anwendung und Weiterentwicklung in der KI-Community.

Zusammenfassend lässt sich sagen, dass IterGen den aktuellen Stand der LLM-Generierung grundlegend erweitert. Es adressiert zentrale Schwächen bestehender Verfahren, insbesondere bei der Fehleranfälligkeit und mangelnden Kontrollierbarkeit der Outputs. Durch die Kombination aus semantischer Steuerung, grammatikbasierter Strukturierung und Backtracking liefert die Methode nicht nur technologische Verbesserungen, sondern auch einen praktischen Mehrwert für Anwender verschiedenster Fachrichtungen. Die flexible, iterative Herangehensweise eröffnet neue Möglichkeiten bei der Entwicklung robuster, sicherer und verlässlicher KI-Anwendungen, die den Anforderungen moderner Anwendungsfelder optimal gerecht werden.

![Cognitronics and the Longest Running Voice in Telephony [video]](/images/AF5BAAFE-9F38-41B5-B66C-8C4517670A40)