In der heutigen Zeit, in der Künstliche Intelligenz (KI) und insbesondere Large Language Models (LLMs) wie ChatGPT oder andere Generative AI-Produkte immer mehr an Bedeutung gewinnen, beobachten wir eine faszinierende, jedoch auch bedenkliche Entwicklung. Gerade bei der jüngeren Generation, insbesondere Gen Z, ist ein Trend erkennbar, der das Verhältnis zwischen Lernen und Abrufen von Wissen grundlegend verändert. Dabei verschwimmt die Grenze zwischen reiner Informationsabfrage via KI und echtem Lernen, das auf Erfahrung und tiefgreifendem Verständnis basiert. Doch warum ist Prompting, also das geschickte Abfragen von KI-Modellen, nicht gleichzusetzen mit Lernen? Warum ist das gefährlich, und wie können wir trotz dieser mächtigen Technologien echtes Lernen bewahren und fördern? Diese Fragen gilt es differenziert zu betrachten. Traditionelle Lernwege und ihre Bedeutung In vielen Berufszweigen hat sich über Jahrzehnte, teils Jahrhunderte, bewährt, dass gründliches Lernen viel Zeit und erlebte Erfahrung erfordert.

Im Medizinbereich etwa verbringen Studierende etwa acht Jahre in intensiver Ausbildung, begleitet von praktischen Erfahrungen an Kliniken, Schatten bekannter Experten und Abschlüssen, die erst nach langjähriger Spezialisierung vergeben werden. Diese Phase entspricht dem sogenannten „Lehrlingsmodus“ – die Zeit des Experimentierens, Fehlermachens unter Aufsicht, Neues Ausprobierens und stetigen Reflektierens. Erst danach wandert ein angehender Arzt oder eine Ärztin in die Phase des eigenständigen Handelns. Softwareentwicklung funktioniert zwar häufig etwas flexibler, dennoch bleibt Praxis ein zentraler Bestandteil. Viele Entwickler lernen durch Ausprobieren, Fehler machen und Projekte realisieren, oft ergänzend zur formalen oder informellen Ausbildung.

Hier ist die Gefahr geringer, da Fehler in Code zwar teuer sein können, meist aber keine Gefahr für Menschenleben darstellen. Doch auch hier gilt: Wer die Grundlagen nicht wirklich versteht, hat langfristig keinen Vorteil, wenn er sich nur auf KI-gestützte Codehilfe verlässt. Die Rolle der KI-Tools im Wandel der Wissensvermittlung Mit dem Aufkommen von LLMs und ähnlichen Technologien hat sich das Verhältnis zu Wissen radikal verändert. Früher dominierten Hochschulen und etablierte Institutionen stark die Verfügbarkeit qualitativer Bildungsinhalte. Notizen, Auswendiglernen und Prüfungen zu Bestehen waren der Standard, um Wissen zu validieren.

Heute steht nahezu unbegrenztes Wissen kostenlos zur Verfügung, Communities und offene Bildungsressourcen (Open Educational Resources) boomen. Über Plattformen wie YouTube, Blogs oder MOOCs besteht ungebremster Zugang zu Lernmaterialien jeglicher Form. Dies zwingt etablierte Bildungsinstitutionen dazu, sich neu zu definieren. Anstatt das reine Faktenwissen abzufragen, rückt die Fähigkeit in den Mittelpunkt, Wissen anzuwenden, kritisch zu hinterfragen und kreative Lösungen zu entwickeln. KI kann dabei als Werkzeug hochwirksam unterstützen, aber nicht die Fähigkeit ersetzen, selbständig und kritisch zu lernen.

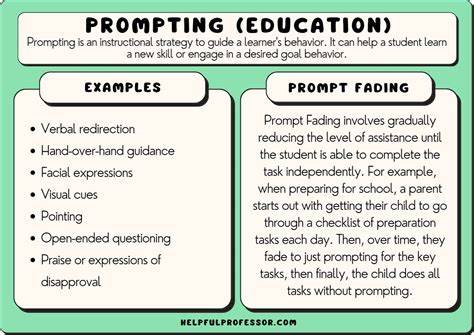

Die Illusion der Kompetenz durch KI-Antworten Large Language Models liefern beeindruckend schnell Antworten auf komplexe Fragen, können Texte generieren, Zusammenfassungen schreiben oder sogar Codes erstellen. Diese Instant-Kompetenz verführt viele Nutzer dazu, einen direkten Zusammenhang zwischen „Prompten“ und tatsächlichem Lernen anzunehmen. Doch aktuell sind LLMs weit davon entfernt, echtes Verständnis zu besitzen. Noch immer produzieren sie Halluzinationen, also falsche oder irreführende Inhalte, wenn sie auf Wissenslücken stoßen oder die Datenlage dünn ist. Wichtiger noch: KI gibt zwar eine Antwort, doch diese ersetzt nicht das nachhaltige Aneignen von Wissen, das durch eigenes Nachdenken, Experimentieren und Wiederholen entsteht.

Prompting liefert eine Art oberflächliche Information oder einen Ankerpunkt, der ohne tiefergehende Beschäftigung schnell wieder vergessen wird. Wer sich darauf verlässt, besitzt keine robusten neuronalen Verbindungen, die echtes Lernen ausmachen. Neurobiologische Grundlagen des Lernens versus KI-Modellierung Der menschliche Verstand arbeitet auf einer Ebene, die mit aktuellen KI-Architekturen kaum vergleichbar ist. Unser Gehirn bildet täglich neue neuronale Verbindungen, die Wissen und Erfahrung als dynamische Netzwerke organisieren. Dieses Zusammenspiel von analoger und digitaler Informationsverarbeitung, verbunden mit serendipitären Momenten in sozialen und physischen Interaktionen, erzeugt nachhaltiges Lernen und schließt kreatives Problemlösen ein.

Im Gegensatz dazu sind LLMs algorithmisch darauf ausgelegt, Wahrscheinlichkeiten von Wortfolgen auf Basis riesiger Datensätze zu berechnen. Sie besitzen kein echtes Bewusstsein oder Verständnis, und ihr „Lernen“ beschränkt sich auf Mustererkennung und statistische Vorhersagen. Dies macht sie zwar aufgabenorientiert effizient, aber in puncto echter Erkenntnisentwicklung nicht vergleichbar mit menschlichem Denken. Der Wert der Erfahrung und der Fehlerkultur Wahre Kompetenz entsteht häufig durch aktives Ausprobieren und Fehler machen. In der „Apprentice Mode“-Phase werden Grundlagen erlernt, praktisch angewandt und reflektiert, bis das Wissen tief verankert ist.

Malcolm Gladwell popularisierte dies mit der sogenannten 10.000-Stunden-Regel – die Idee, dass Meisterschaft in einem Feld viel Übung und Engagement erfordert. Obwohl diese Theorie umstritten ist, kann sie als Hinweis darauf gesehen werden, dass Expertise nicht über Nacht entsteht, auch nicht mit Hilfe von KI. Wenn Menschen sich zu früh auf KI-Lösungen verlassen, riskieren sie, diese zentrale Erfahrung zu verpassen. Das führt zu oberflächlichem Wissen, das in realen Situationen schnell an Grenzen stößt – vor allem, wenn die KI falsche Informationen liefert oder komplexe Vernetzungen von Wissen und Erfahrung notwendig sind.

Die richtige Balance im Zeitalter der künstlichen Intelligenz Trotz aller berechtigten Kritik an der Überbetonung von KI-Antworten ist es wichtig, die Vorteile nicht zu ignorieren. KI kann Lernprozesse unterstützen, indem sie als Co-Pilot fungiert: Sie kann den Lernenden zu ergänzenden Quellen führen, Texte verbessern, Zusammenfassungen schreiben oder kreative Denkanstöße geben. Der Schlüssel liegt darin, eine gesunde Balance zwischen menschlichem Lernen und KI-Unterstützung zu finden. Der Autor Gustavo Veloso beschreibt seine eigene Herangehensweise als das „AI-later“-Modell: Dies bedeutet, zuerst selbstständig zu lernen, zu lesen, zu reflektieren, Notizen zu machen und sich Denken zu erarbeiten, bevor man KI-Tools einsetzt, um das Verständnis zu vertiefen oder unterschiedliche Perspektiven aufzuzeigen. Dadurch werden KI-Modelle nicht zu einem Ersatz, sondern zu einem Katalysator für echten Lernfortschritt.

Bildungsinstitutionen und Unternehmen sind nun herausgefordert, didaktische Konzepte zu entwickeln, die eine solche hybride Lernkultur fördern. Zukunftsfähige Curricula binden KI nicht als einfachen Antwortgeber ein, sondern als Werkzeug, das aufgeweckten und neugierigen Menschen bei der Entwicklung von Problemlösungskompetenzen hilft. Fazit: Lernen bleibt menschlich – KI ist der Begleiter Die faszination für KI und das Potenzial von Prompting sind berechtigt und zukunftsweisend. Doch echtes Lernen wird weiterhin durch menschliche Erfahrung, Wiederholung, Fehler und soziale Interaktion geprägt. Lernen ist ein biologisch eingebetteter Prozess, der sich durch aktives Tun und Denken entfaltet – ein Prozess, der sich nicht allein durch das Stellen richtiger Fragen an eine Maschine ersetzen lässt.

Prompting ist somit ein nützliches Werkzeug, das gut eingesetzt werden will. Wer jedoch glaubt, dass das ständige Abrufen von KI-Antworten ohne eigenes Erleben zu tiefgründiger Expertise führt, verkennt die Komplexität von Wissensaneignung. Die Herausforderung der nächsten Jahre liegt darin, eine lernfördernde Symbiose zwischen menschlicher Neugier, Erfahrung und KI-Unterstützung zu gestalten. Wer dies meistert, wird nicht nur Wissen anhäufen, sondern Weisheit und Kompetenz entwickeln – und bleibt damit dem Menschen und seiner einzigartigen Fähigkeit zum Lernen trotz Technologie überlegen.