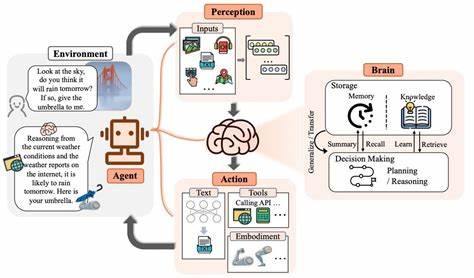

Die rasante Entwicklung von Künstlicher Intelligenz und besonders großer Sprachmodelle (Large Language Models, LLMs) hat das Feld der Agentenautomatisierung tiefgreifend verändert. Doch trotz aller Fortschritte besteht weiterhin ein gravierendes Problem: die hohen Kosten, die Latenzzeiten und die Variabilität bei wiederholten Aufgaben. Vor diesem Hintergrund kommt Muscle-Mem ins Spiel, ein bahnbrechender JIT (Just-in-Time) Caching-Engine für Agentenverhalten, die einen innovativen Ansatz verfolgt, um diese Herausforderungen zu meistern. Muscle-Mem ermöglicht es, das Verhalten von KI-Agenten effizient zu speichern und bei wiederholten Aufgaben ohne erneuten Aufruf eines LLMs deterministisch zu reproduzieren. Damit stellt Muscle-Mem eine wegweisende Technologie zur Optimierung von KI-Agenten dar.

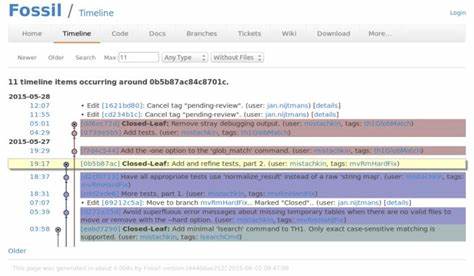

Muscle-Mem ist nicht einfach ein weiteres Agenten-Framework, sondern vielmehr ein ergänzendes Werkzeug, das sich nahtlos in bestehende Agenten-Implementierungen einfügt. Entwickler schreiben ihre Agenten wie gewohnt und verbinden sie anschließend mit der Muscle-Mem-Engine, die sämtliche Aufrufe der Agentenwerkzeuge überwacht, aufzeichnet und bei einer erneuten Bearbeitung desselben oder ähnlicher Aufgaben als gespeicherte Verhaltensfolgen (Trajectories) wiederverwendet. Für jeden neuen Auftrag führt Muscle-Mem zunächst eine Abfrage durch, ob die aktuelle Umgebung oder Aufgabe bereits in der Vergangenheit aufgetreten ist. Dieses sogenannte Cache-Checking ist essenziell, um sicherzustellen, dass frühere Verhaltensmuster noch gültig sind und problemlos angewandt werden können. Findet Muscle-Mem einen „Cache-Hit“, wird die gespeicherte Handlungskette abgespielt.

Bei einem „Cache-Miss“ hingegen wird die Aufgabe wie gewohnt vom eigentlichen Agenten erledigt, während das neue Verhalten parallel aufgezeichnet wird. Ein wichtiges Element bei der Implementierung von Muscle-Mem ist das Konzept der Checks, welches Cache-Validierung sicherstellt. Checks sind Funktionen, die Merkmale der jeweiligen Umgebung aufnehmen (Capture) und anschließend mit zuvor gespeicherten Daten vergleichen (Compare). Nur wenn diese Validierung positiv ausfällt, werden gespeicherte Verhaltensweisen wiederverwendet. Dadurch wird sichergestellt, dass der Agent keine veralteten oder unpassenden Aktionen ausführt und somit zuverlässig agiert.

Die Bedienung von Muscle-Mem gestaltet sich relativ unkompliziert, da die Bibliothek als Python SDK konzipiert ist und einfach per pip install installierbar ist. Die zentrale Komponente ist die Engine, die dem Agenten vorgesetzt wird und diesen bei Ausführung von Aufgaben steuert. Interessanterweise instrumentiert die Engine die Werkzeuge des Agenten mit Dekoratoren. Dies erlaubt Muscle-Mem, jede Funktion oder Methode, die Werkzeuge darstellt, automatisch zu überwachen, Argumente zu speichern und bei Bedarf jene Aufrufe wiederzugeben. Dieses automatische Tracking erspart Entwicklern manuelles Logging und erlaubt ein feingliedriges Caching von Werkzeugnutzung.

Muscle-Mem geht sogar einen Schritt weiter und bietet ein Feature zur dynamischen Parametrisierung. Dabei können Teile der Werkzeugeingaben als sogenannte Top-Level-Parameter markiert werden. Solche Parameter sind bei jedem Aufruf variabel, wie zum Beispiel Nutzer-Inputs oder dynamisch generierte Daten. Dies verhindert, dass das Caching zu starr und unflexibel wird und ermöglicht wiederverwendbare Werkzeuge, die dennoch auf variable Eingaben reagieren können. Die Vorteile von Muscle-Mem liegen auf der Hand: KI-Agenten rufen LLMs seltener auf, was tokenbasierte Kosten drastisch senkt.

Zusätzlich verbessert sich die Geschwindigkeit, weil nicht bei jeder Aufgabe eine neue Anfrage an die Modelle gesendet werden muss. Schließlich steigt die Vorhersagbarkeit von Agenten, da deterministische Verhaltenswiederholungen statt stochastischer Modellantworten ablaufen. Die Technologie eröffnet insbesondere in Szenarien mit vielen sich oftmals wiederholenden Aufgaben großes Potenzial. Die Anwendungsmöglichkeiten von Muscle-Mem sind vielfältig. Hersteller von Chatbots und Assistenzsystemen können wiederkehrende Nutzeranfragen schneller und kosteneffizienter bedienen.

Ebenso profitieren Anwendungen im Bereich Automatisierung und Prozessoptimierung, bei denen komplexe Aktionen sequentiell abgearbeitet werden, von deterministischen Abläufen. Die verbesserte Kontrolle der Agentenverhalten minimiert zudem Fehler und unerwartete Aktionen. Dabei ist wichtig zu betonen, dass Muscle-Mem nicht auf einen bestimmten Agententyp oder auf eine spezielle LLM-Architektur festgelegt ist. Entwickler behalten ihre Freiheit in der Agentengestaltung und nutzen Muscle-Mem als intelligentes Cache-Layer, das sich flexibel und modular integrieren lässt. Das offen zugängliche Repository auf GitHub mit bereits zahlreichen Sternen und Forks zeugt von starkem Interesse der Community und aktiver Weiterentwicklung.

Das Projekt wächst rasch, mit aktuellen Neuerungen wie Parameterisierung und Tagging zur feingranularen Steuerung von Caches. Die Entwickler laden ausdrücklich zur Mitarbeit, zum Feedback und zur Diskussion in ihrem Discord-Kanal ein. Dies unterstreicht den experimentellen und innovativen Charakter des Projekts im Bereich KI-Agentenforschung. Insgesamt markiert Muscle-Mem einen wichtigen Schritt in Richtung effizienterer und nachhaltigerer KI-Anwendungen. Zahlreiche Routineaufgaben können erheblich schneller und kostengünstiger erledigt werden, ohne Abstriche bei Qualität oder Zuverlässigkeit.

Für Unternehmen eröffnet sich dadurch ein Wettbewerbsvorteil, denn der Betrieb von KI-Systemen wird skalierbarer und planbarer. Die Verbindung von JIT-Caching, präziser Cache-Validierung und einfacher Integration macht Muscle-Mem zu einem Zukunftswerkzeug für eine breite Palette an KI-gestützten Automatisierungsaufgaben. Vor dem Hintergrund der fortschreitenden Verbreitung von KI-Agenten in unterschiedlichsten Branchen ist Muscle-Mem ein wegweisendes Framework, das die Lücke zwischen leistungsstarken LLMs und effizienter realweltlicher Anwendung schließt. Es beweist, dass durch gezielte Intelligenz beim State-Management enorme Ressourcen eingespart werden können, was letztlich ökologisch und ökonomisch relevant ist. Insgesamt sind Entwickler und Forscher gut beraten, Muscle-Mem genau zu beobachten und frühzeitig in eigene Projekte zu integrieren.

Das detaillierte API-Design, die durchdachten Validierungsmechanismen und die dynamischen Parameteroptionen machen das Tool nicht nur leistungsstark, sondern auch äußerst flexibel für diverse Use Cases. Mit Muscle-Mem gelingt der Spagat zwischen Innovationskraft und Pragmatismus – die beste Voraussetzung für nachhaltigen Fortschritt im Zeitalter der Künstlichen Intelligenz.