Die fortschreitende Entwicklung künstlicher Intelligenz (KI) hat unser Leben in vielerlei Hinsicht bereichert. Von Sprachassistenten über automatisierte Kundenbetreuung bis hin zu personalisierten Empfehlungen – KI ist allgegenwärtig. Doch mit dieser technischen Entwicklung gehen auch neue Methoden des Betrugs einher, die besonders Familien und ältere Menschen ins Visier nehmen. Ein besonders perfider Trend sind KI-gestützte Sprachbetrügereien, bei denen die Stimmen von Angehörigen täuschend echt imitiert werden, um finanzielle Vorteile zu erlangen. Diese Betrugsmasche ist nicht nur hochgradig effektiv, sondern auch emotional belastend, da sie unmittelbare Angst um geliebte Personen hervorruft.

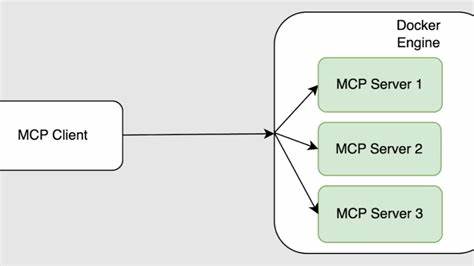

In diesem Kontext ist es wichtig, wachsam zu sein und die Mechanismen dieser kriminellen Vorgehensweise zu verstehen, um sich und seine Familie zu schützen. KI-Sprachbetrug basiert auf der fortschrittlichen Technologie der Sprachsynthese oder Deepfake-Audio. Dabei werden Sprachnachrichten oder Telefongespräche analysiert und dann synthetisch imitiert. Betrüger nutzen diese Technik, um eine Stimme so realistisch wie möglich nachzuahmen – oft die eines nahestehenden Familienmitglieds, etwa eines Kindes, Geschwisters oder Elternteils. Ein typisches Szenario sieht so aus, dass ein vermeintlicher Angehöriger am Telefon in Panik berichtet, sich in einer Notsituation zu befinden, beispielsweise wegen eines angeblichen Unfalls, einer Festnahme oder finanziellen Schwierigkeiten.

Der Betrüger fordert daraufhin sofortige finanzielle Hilfe, etwa durch die Zahlung von Kautionen oder das Überweisen von Geldern über kaum zurückverfolgbare Kanäle wie Kryptowährungen oder Gutscheinkarten. Die Opfer dieser Masche sind häufig Eltern oder Großeltern, die auf die Stimme und den vermeintlich dringenden Tonfall vertrauen. Da das Telefonat sehr kurzfristig erfolgt und keine Zeit für Nachfragen oder Überprüfungen bleibt, gelingt es den Betrügern oft, innerhalb weniger Minuten Geld zu fordern und zu erhalten, bevor das Opfer Verdacht schöpfen kann. Die Gefahren liegen nicht nur im finanziellen Schaden, sondern auch in der emotionalen Belastung, die solche betrügerischen Anrufe hinterlassen. Eines der beunruhigendsten Aspekte dieser Betrugsform ist die Kombination aus technologischem Fortschritt und psychologischer Manipulation.

Die Nutzung von KI ermöglicht es, selbst für Experten schwer zu erkennen, ob eine Stimme echt ist oder gefälscht. Die emotionale Manipulation durch scheinbar vertraute Stimmen verstärkt die Dringlichkeit und den Stress für die Betroffenen, wodurch kritisches Denken und Zweifel häufig unterdrückt werden. Für Angehörige und Familien ist es daher besonders wichtig, präventive Maßnahmen zu ergreifen und im Falle eines solchen Anrufs besonnen zu reagieren. Um sich gegen KI-basierte Sprachbetrügereien zu schützen, ist vor allem Aufklärung unverzichtbar. Familien und insbesondere ältere Menschen sollten informiert werden, dass Stimmen am Telefon manipuliert sein können – selbst wenn sie vertraut klingen.

Eine bewährte Methode besteht darin, bei unerwarteten Anrufen von angeblichen Angehörigen immer zusätzliche Sicherheitsabfragen zu stellen. Hierzu zählen beispielsweise individuelle Sicherheitsfragen, die nur Familienmitglieder beantworten können, oder das Verifizieren der Situation über einen Rückruf an eine bekannte Nummer, die unabhängig von der Nummer des Anrufers ist. Darüber hinaus sollten finanzielle Hilfen niemals spontan und ohne Absicherung geleistet werden. Wenn jemand vor einer dringenden Zahlung steht, gilt es, Ruhe zu bewahren und mögliche Gesprächspartner direkt zu kontaktieren – vielleicht per Videoanruf oder persönlichem Treffen – um die Echtheit der Notsituation zu überprüfen. Geschäfte, die schnelle, unvermeidbare Zahlungen fordern, vor allem wenn diese über ungewöhnliche oder schwer rückverfolgbare Kanäle abgewickelt werden sollen, sind ein Warnsignal.

Neben dem individuellen Schutz sind auch technische Lösungen hilfreich. Unternehmen und Dienstleister können spezielle Erkennungstechnologien einsetzen, die verdächtige Anrufe oder die Nutzung von Deepfake-Audio erkennen und neutralisieren können. Auch Mobilfunkanbieter bieten teilweise Schutzmechanismen an, die zweifelhafte Anrufe filtern oder blockieren. Für den Privatnutzer ist es ratsam, entsprechende Apps zu verwenden und Anrufe von unbekannten Nummern kritisch zu prüfen. Die rechtliche Seite wird ebenfalls zunehmend relevant.

Gesetzgeber arbeiten daran, Methoden zur Bekämpfung von KI-basierten Stimmenbetrugsfällen zu entwickeln und entsprechende Strafverfolgung zu gewährleisten. Dennoch ist die Polizei oft mit technischen Herausforderungen konfrontiert, da die Täter anonym und räumlich verteilt agieren. Dies unterstreicht die Bedeutung von Bildung und Prävention in der Bevölkerung, um solchen Betrugsversuchen vorzubeugen. Schulungen und Informationskampagnen sind ein wichtiger Bestandteil, um gesellschaftlich gegen KI-Sprachbetrug vorzugehen. Familien können in Workshops oder Informationsveranstaltungen lernen, wie man betrügerische Anrufe erkennt und die richtigen Gegenmaßnahmen ergreift.

Auch soziale Einrichtungen, Seniorenzentren und Verbraucherschutzorganisationen bieten oft Materialien und Austauschmöglichkeiten an, um das Bewusstsein für die Risiken zu stärken. Langfristig ist es entscheidend, dass technologische Innovationen nicht nur die Möglichkeiten von Betrügern erweitern, sondern auch die Sicherheit und den Schutz der Nutzer verbessern. Unternehmen aus dem Bereich der künstlichen Intelligenz arbeiten derzeit an Authentifizierungsverfahren, die schwer zu fälschen sind – etwa durch biometrische Merkmale oder mehrstufige Identifikationsprozesse. Solche Fortschritte könnten in Zukunft den Betrugsversuchen einen Riegel vorschieben. Für jede Familie ist es ratsam, ein gemeinsames Sicherheitskonzept zu entwickeln.

Regelmäßige Gespräche über die Gefahren der neuen Technologien, das Austauschen von Notfallnummern und Vereinbarungen zu Kommunikationswegen können helfen, im Ernstfall schnell und sicher zu reagieren. Die Stimmlage allein darf nie als einziges Kriterium für Echtheit gelten. Misstrauen gegenüber ungewöhnlichen Forderungen und das Einholen von Zweitmeinungen kann Milliardenverluste vermeiden und die emotionale Belastung deutlich reduzieren. KI-gestützter Sprachbetrug bleibt eine der größten Herausforderungen der digitalen Ära, weil er technische Raffinesse mit menschlicher Emotion verbindet. Nur durch erhöhte Aufmerksamkeit, Weiterbildung und den Einsatz kluger Schutzmechanismen können Familien sich davor schützen, Opfer dieser perfiden Masche zu werden.

Jede Stimme, auch wenn sie vertraut klingt, sollte kritisch hinterfragt werden – insbesondere wenn sie nach Geld oder anderen wertvollen Informationen verlangt. Wachsamkeit, gepaart mit fundiertem Wissen und entschlossener Prävention, sind die besten Mittel gegen diesen digitalen Betrug, der immer mehr Menschen weltweit betrifft.