Die Art und Weise, wie wir heute Bilder durchsuchen und mit ihnen interagieren, hat sich dank fortschrittlicher KI-Modelle grundlegend verändert. Insbesondere das multimodale Vision-Sprachmodell CLIP von OpenAI spielt eine zentrale Rolle darin, eine völlig neue Dimension der Bildersuche zu eröffnen. Statt sich auf traditionelle manuelle Verschlagwortung oder einfache Metadaten zu verlassen, ermöglicht CLIP die semantische Suche in großen Bildersammlungen anhand natürlicher Sprachabfragen. Dies bedeutet, dass Nutzer Bilder einfach beschreiben können, etwa mit Begriffen wie „ein niedliches Tier“ oder „ein rotes Auto“, und die Software findet genau visuell passende Ergebnisse. Eine solche Fähigkeit ist immens wertvoll für Anwendungen in E-Commerce, digitalen Archiven, Content-Management-Systemen oder auch in kreativen Branchen.

Die Grundlage hierfür bildet eine komplexe Pipeline, die Bilder in Vektorraum-Embedding umwandelt, diese effizient speichert und Abfragen ebenfalls in diesen Raum projiziert, um die semantische Ähnlichkeit zu bewerten. Der Aufbau eines solchen Systems wird durch modernste Open-Source-Technologien und Datenbanken heute spürbar vereinfacht und demokratisiert. Im Folgenden soll ein tieferer Einblick in den Prozess, die zugrundeliegenden Technologien und praktische Implementierungsaspekte gegeben werden. Zunächst steht das Modell CLIP (Contrastive Language-Image Pretraining) im Vordergrund. Entwickelt von OpenAI, trainiert dieses Modell darauf, Bild- und Textinformationen in einen gemeinsamen hochdimensionalen Vektorraum einzubetten.

So können Bildinhalte und ihre beschreibenden Texte vergleichbar gemacht werden und Ähnlichkeiten ermittelt werden, ohne auf klassische Schlagwortlisten angewiesen zu sein. Insbesondere die Variante CLIP ViT-L/14 spielt dabei eine zentrale Rolle, da sie einen guten Kompromiss zwischen Genauigkeit und Rechenressourcen darstellt. Für Anwendungsfälle, bei denen Geschwindigkeit im Vordergrund steht, ist CLIP ViT-B/32 eine Alternative mit geringerer Rechenlast aber ebenfalls zufriedenstellender Präzision. Ein wichtiger Schritt in der Pipeline besteht darin, lokale Bilddaten kontinuierlich einzulesen und in Embeddings zu transformieren. Hierfür eigenen sich Frameworks wie CocoIndex, ein leistungsstarkes Open-Source-System zur Datenindizierung und -transformation.

CocoIndex unterstützt inkrementelle Verarbeitung, sodass neue Bilder oder Änderungen automatisch erkannt und verarbeitet werden, ohne die gesamte Sammlung neu zu indexieren. Dies garantiert, dass der Bildindex stets aktuell bleibt und die Suchergebnisse frisch sind. Die eigentliche Embedding-Generierung bei Bildern erfolgt durch die auf CLIP basierende Funktion, die Bilddaten zunächst in Byte-Form entgegen nimmt, das Bild öffnet, verarbeitet und schließlich in den Vektorraum projiziert. Diese Operation wird effizient gestaltet, indem das CLIP-Modell einmal geladen und über Cache-Mechanismen mehrfach genutzt wird. Jede Bilddatei bekommt dann aus dem ursprünglichen Rohdatenstrom eine eindeutige ID, Dateinamen und ihren Vektor zugeordnet und in einem geeigneten Speicher abgelegt.

Der nächste essentielle Baustein ist die Speicherung und schnelle Abfrage dieser Vektoren. Hier kommen spezialisierte Vektordatenbanken wie Qdrant zum Einsatz. Qdrant ist optimiert für Ähnlichkeitssuche mit großen Mengen hochdimensionaler Vektoren. Die Datenbank erlaubt schnelle nearest neighbor searches mit verschiedenen Distanzmetriken – Cosine Distance ist für CLIP-Embeddings ein häufig verwendeter Maßstab. Qdrant speichert die Embeddings in sogenannten Sammlungen, die figürlich gesagt als digitale Verzeichnisse oder Tabellen fungieren.

Durch eine gezielte Schnittstelle wie GRPC wird die Kommunikation mit der Vektordatenbank performant garantiert. Um den gesamten Prozess als Webservice bereitzustellen, empfiehlt sich FastAPI, ein modernes Python-Framework, das hohe Performance mit einfacher Entwicklungsstruktur kombiniert. FastAPI ermöglicht es, REST-API-Endpunkte einzurichten, sodass Nutzer über das Internet Bilder suchen können. Ein wesentlicher Endpunkt ist hierbei /search, welcher eine natürliche Spracheingabe erwartet, diese über CLIP in den Vektorraum projiziert und anschließend die ähnlichen Bilder aus Qdrant ausliest. Der Nutzer erhält dann geordnet eine Liste mit Dateinamen und Relevanzwerten zurück.

Ergänzend kann der Webservice statische Bilder direkt aus einem festgelegten Verzeichnis bereitstellen, sodass Suchtreffer einfach visualisiert werden können. Ein Highlight der Implementierung ist der durch CocoIndex bereitgestellte LiveUpdater. Er ermöglicht es, neu hinzugefügte Bilder automatisch innerhalb kurzer Zeit zu erfassen, zu verarbeiten und im Index zu speichern. Damit wird die Bildersuche nicht statisch, sondern passt sich dynamisch an neue Inhalte an – ein Merkmal, das besonders in sich stetig ändernden Umgebungen wie Onlineshops oder Medienbibliotheken essenziell ist. Praktisch gesehen bedarf es vor der Inbetriebnahme der Installation und Konfiguration der notwendigen Komponenten.

PostgreSQL wird dabei genutzt, um die Datenherkunft und die Indexierungsprozesse zu überwachen. Qdrant stellt die Vektor-Datenbank dar und muss für die gewünschte Bildersammlung angelegt werden. Die genaue Vektorgröße – in CLIP meist 768 – und verwendete Distanzmetrik sind vorab zu definieren. Anschließend gestaltet das Skript im Kern die Erfassung der Bilder aus einem lokalen Verzeichnis, wandelt diese in Vektoren um und exportiert diese an Qdrant. Über den FastAPI-Server wird die Suchanfrage dann abgewickelt und das Ergebnis für Nutzer zugänglich gemacht.

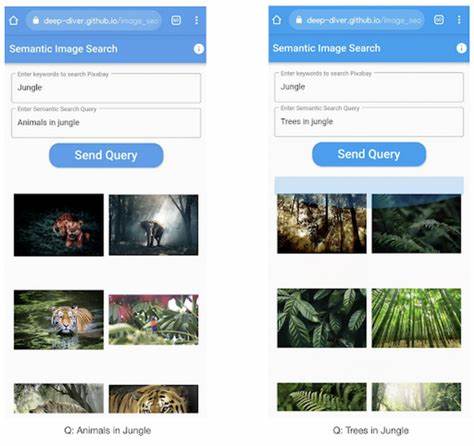

Das Frontend wird bewusst minimalistisch gehalten, um Fokus und Performanz auf die Suchfunktionalität zu legen. Es erlaubt Nutzern, simpel Texteingaben zu machen und Suchergebnisse direkt angezeigt zu bekommen. Das System demonstriert eindrucksvoll, wie die Kombination aus modernen KI-Modellen, datenorientierter Infrastruktur und einfach zu nutzenden Frameworks die Entwicklung leistungsfähiger, semantischer Bildsuchlösungen radikal vereinfacht. Wo früher aufwändige, händische Verschlagwortung und komplexe Architekturen erforderlich waren, genügen heute wenige Schlüsselkomponenten, mit denen Entwickler schnell produktionsreife Anwendungen erstellen können. Die Synergien zwischen CLIP als multimodalem Modell, CocoIndex als hochperformanter Pipeline-Manager, Qdrant als skalierbare Vektordatenbank und FastAPI als schlankem Webframework setzen neue Maßstäbe in Effizienz, Flexibilität und Benutzererfahrung.

Unternehmen aller Größenordnungen und Entwicklerteams können so einfach als auch kostengünstig zeitgemäße Bildsuchsysteme realisieren, von produktbezogener Bildsuche über Digitale Asset Management Lösungen bis hin zu innovativen Content-Plattformen. Dabei sind kontinuierliche Verbesserungen durch Community-Engagement und Open-Source-Trends gewährleistet. Die strategische Bedeutung solcher Technologien erstreckt sich auch auf weitere Bereiche der KI-gestützten Inhaltsanalyse, etwa bei Videoindizierung, visueller Erkennung oder automatisierter Katalogisierung. Parallel erlaubt der modulare Aufbau der Workflow-Pipeline weitere Anpassungen, etwa Integration weiterer Modelle, größere Bilddatensätze oder erweiterte Suchlogiken. Gerade die inkrementelle Verarbeitungskomponente bringt nachhaltigen Nutzen, wenn Daten dynamisch wachsen oder sich verändern.

Abschließend zeigt sich klar, dass der Aufbau einer semantischen, natürlichen Bildersuche mit CLIP und den beschriebenen Technologien heute in greifbarer Nähe für Entwickler und Unternehmen steht. Die Kombination aus hochmoderner Forschung und praxisnahem Engineering eröffnet neue Dimensionen der medialen Interaktion und ermöglicht Anwendungen, die intuitiv, leistungsfähig und skalierbar sind. Das fördert nicht nur die Effizienz bei der Datenverwaltung, sondern hebt die Nutzererfahrung auf ein völlig neues Niveau – indem Bildersuche endlich so natürlich und flexibel wird wie unsere Sprache selbst.