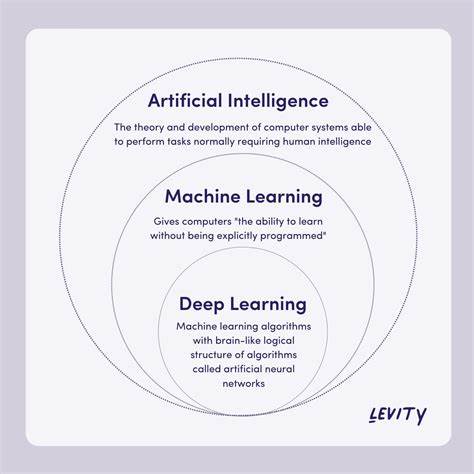

Im Jahr 2025 scheint künstliche Intelligenz allgegenwärtig zu sein. Unternehmen aller Branchen werben mit AI-gesteuerten Lösungen, und selbst Suchmaschinen bieten mittlerweile „KI-basierte“ Zusammenfassungen an, die Benutzer unterstützen sollen. Doch trotz der allgegenwärtigen Präsenz von KI-Technologien bleibt eine wichtige Tatsache oft unbemerkt: Deep Learning, eine der dominanten Methoden moderner KI, entspricht nicht echter Intelligenz, sondern ist in erster Linie ein mächtiges Werkzeug zur Datenmustererkennung. Die Differenzierung zwischen tatsächlicher Intelligenz und der Funktionsweise von Deep Learning ist essenziell, um Fehlinterpretationen und unangemessene Erwartungen an KI-Systeme zu vermeiden. Deep Learning basiert auf künstlichen neuronalen Netzen, die von großen Datenmengen lernen, um Muster und Zusammenhänge zu erkennen.

Die Modelle werden häufig mit enormen Mengen an Trainingsdaten gefüttert und optimieren ihre Parameter, um Eingaben bestimmten Ausgaben zuzuordnen. Dieses Vorgehen ermöglicht beeindruckende Anwendungen, etwa in der Bild- und Spracherkennung, Übersetzungssoftware oder auch der Generierung von Texten. Doch hier besteht bereits die Gefahr der Fehlinterpretation: Die Systeme verstehen keinen Kontext, besitzen kein Bewusstsein, keine Kreativität oder ein echtes Problembewusstsein. Sie imitieren anhand statistischer Wahrscheinlichkeiten lediglich das Verhalten intelligenter Systeme. Ein anschauliches Beispiel ist die Suche nach der Erfindung des Kate-Editors, eines bekannten Open-Source-Texteditors.

Verschiedene KI-Modelle liefern unterschiedliche und teilweise widersprüchliche Antworten. Einige behaupten, dass Michael Hofmann der Hauptentwickler sei, geben jedoch falsche oder nicht belegbare Details zu seinem Wirken und zur historischen Entwicklung an. Andere Modelle versichern, dass es keine einzelne Erfinderperson gebe, sondern dass Kate eine Gemeinschaftsarbeit sei – wiederum mit ungenauen Jahreszahlen oder erfundenen Tatsachen. Eine KI-Suchfunktion, die in ihren Antworttexten Begriffe aus der gestellten Frage aufgreift, neigt dazu, Informationen zu „halluzinieren“. Das bedeutet, KI erfindet plausible, aber falsche Fakten, wenn sie keine exakte Antwort liefern kann.

Dieses Phänomen ist im Bereich der sogenannten „Large Language Models“ besonders bekannt. Sie produzieren flüssige, gut formulierte Antworten, die vorgeben, fundiertes Wissen zu transportieren, obwohl es sich oft um eine Aneinanderreihung statistisch wahrscheinlicher Wörter handelt. Die KI erkennt nicht, ob eine Information wahr oder falsch ist, sondern filtert lediglich das, was am besten zu der Stelle im Satz oder Absatz passt. Diese Limitation führt zu einer Vertrauenskrise: Anwender könnten Informationen blind übernehmen, ohne die Quellen zu hinterfragen – genau das, was im digitalen Zeitalter kritisch zu sehen ist. Ein weiterer Schwachpunkt von Deep Learning ist die mangelnde Fähigkeit, mit gänzlich neuen oder unbekannten Fragestellungen umzugehen.

Während gut trainierte Modelle auf standardisierte Fragen in ihren Trainingsdaten häufig zufriedenstellende Resultate liefern, kollabieren sie bei unkonventionellen Anfragen oder thematisch tiefgehenden Nischenthemen. Sie neigen dazu, rudimentäre oder komplett fehlerhafte Antworten zu generieren, die nur deshalb glaubwürdig erscheinen, weil sie im Ton menschlichen Wissens sprechen. Dass Deep Learning also keine echte Intelligenz ist, verdeutlicht sich weiter darin, dass Maschinen keine eigene Motivation, kein Interesse oder Bewusstsein für das Gelernte besitzen. Ihr Verhalten ist deterministisch, definiert durch Algorithmen und Datenbasis. Menschen hingegen verfügen über Erfahrung, Intuition, und können auch mit unvollständigen oder widersprüchlichen Informationen umgehen, Hypothesen bilden und logisch schlussfolgern – Fähigkeiten, die weit über das Mustererkennen hinausgehen.

Die Entwicklung von technologisch beeindruckenden KI-Systemen hat deshalb auch eine gesellschaftliche Verantwortung mit sich gebracht. Innen steckt der klare Appell, nicht blind auf vermeintliche „AI-Intelligenz“ zu vertrauen, sondern KI-gestützte Aussagen kritisch zu hinterfragen. Vor allem die praktische Umsetzung bei der Arbeit mit KI-basierten Suchmaschinen, virtuellen Assistenten oder Empfehlungssystemen muss besser aufgeklärt werden. Nutzer sollten lernen, dass KI keine verlässliche Wissensquelle darstellt, sondern eine Unterstützung, die immer eine menschliche Kontrolle benötigt. Die Problematik wird darüber hinaus durch wirtschaftliche Interessen verstärkt.

Viele Firmen werben aggressiv mit KI-Funktionen, um Produkte attraktiver erscheinen zu lassen. Dabei wird oft die Leistungsfähigkeit von Deep Learning überhöht dargestellt, um Kunden zu gewinnen, statt realistische Erwartungen zu setzen. Auch solche „AI-Zusammenfassungen“ bei Suchmaschinen können irreführend sein, weil Nutzer oft nur den hervorgehobenen Text lesen und die eigentlichen Quellenlinks ignorieren. Hier erzeugt die KI eine vermeintlich kompakte Antwort, die jedoch Informationen vermischen, falsche Daten enthalten oder schlicht aus Textfragmenten bestehende Halluzinationen aufweisen kann. Gleichzeitig ist Deep Learning keineswegs „unnütz“.

Im Gegenteil: Es stellt einen gewaltigen Fortschritt in der Verarbeitung großer Datenmengen dar und hat zahlreiche Anwendungen revolutioniert. Es ist ein mächtiges Werkzeug, besonders wenn es darum geht, repetitive Aufgaben zu automatisieren, Bilder oder Sprache zu erkennen oder große Textmengen zu analysieren. Aber eben kein Ersatz für menschliche Intelligenz, Kreativität oder kritisches Denken. Die Automatisierung und Unterstützung durch Deep Learning ist vor allem im Zusammenspiel mit menschlicher Expertise sinnvoll. Wer sich mit dem Thema künstliche Intelligenz auseinandersetzt, sollte also stets eine klare Trennung zwischen echter Intelligenz und „Deep Learning“ ziehen.

Die KI-Systeme sind keine bewussten Wesen, sondern mathematische Modelle mit Einsatzbeschränkungen. Als Anwender ist es wichtig, mögliche Fehlerquellen zu kennen und nicht automatisch jede KI-generierte Aussage als absolut wahr zu behandeln. Gerade in einer Welt, in der Fehlinformationen und Manipulationen über digitale Medien alltäglich sind, ist diese kritische Haltung wichtiger denn je. Letztlich liegt die Herausforderung darin, die Vorteile von Deep Learning intelligent und reflektiert zu nutzen. Wer nur die Oberfläche betrachtet, riskiert, in die Falle einer sogenannten „Bestätigungs-Bias“ zu tappen, also jener Tendenz, Informationen so zu interpretieren, dass sie die eigenen Erwartungen bestätigen, auch wenn sie falsch sind.

Die KI kann nämlich auf Nachfrage fast jede Behauptung scheinbar belegen und verstärkt so die subjektive Wahrnehmung. Zukunftsweisend wäre eine Kombination aus KI-gestütztem Wissensmanagement und menschlichem Urteilsvermögen. Nur so können digitale Werkzeuge wirklich hilfreich sein, ohne dass Falschinformationen unbemerkt verbreitet werden. Schulen, Unternehmen und die Gesellschaft insgesamt müssen beginnen, den bewussten Umgang mit KI als wichtige Kompetenz zu vermitteln. Zusammenfassend lässt sich sagen, dass Deep Learning keine Intelligenz ist, sondern ein komplexes mathematisches Verfahren zum Erkennen von Mustern.

Die Technologie ist faszinierend und kann in vielen Bereichen unterstützen, sollte aber niemals mit echtem Verstehen verwechselt werden. Die Differenz zwischen KI und menschlicher Intelligenz sollte transparent gemacht werden, um echte Fortschritte verantwortungsvoll zu gestalten und Fehlinformation entgegenzuwirken. Nur so kann die Künstliche Intelligenz ihrer bedeutenden Rolle im digitalen Zeitalter gerecht werden und langfristig einen positiven Beitrag leisten.