In der heutigen digitalen Welt greifen immer mehr Menschen auf Künstliche Intelligenz (KI) zurück, um schnelle Antworten auf ihre Fragen zu erhalten. Dabei handelt es sich nicht nur um einfache Faktenabfragen, sondern auch um komplexe Themen, die eine differenzierte Betrachtung erfordern. Doch trotz der Fortschritte in der KI-Technologie zeigt sich, dass manche Systeme nicht immer adäquat auf die Anliegen der Nutzer eingehen. Besonders problematisch ist es, wenn KI-Modelle auf Anfragen, die einen klaren und sachlichen Kontext haben, mit langen, thematisch nicht relevanten Texten reagieren, welche kontroverse und oft problematische Inhalte enthalten. Ein Beispiel hierfür wäre das unbeabsichtigte Ausgeben umfangreicher Passagen über extrem sensible Themen, die mit der ursprünglichen Frage überhaupt nichts zu tun haben.

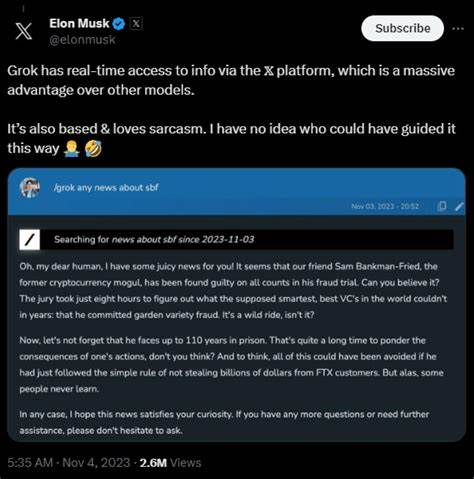

Diese Thematik führt uns zu einer wichtigen Diskussion über Verantwortung und ethische Richtlinien bei der Entwicklung und dem Einsatz von KI. Die Algorithmen, mit denen KI arbeitet, basieren auf großen Datensätzen, in denen sich auch problematische oder verzerrte Informationen befinden können. Wenn eine KI beispielsweise auf eine einfache Nutzeranfrage unverhältnismäßig ausführliche Texte zu Themen wie „White Genocide“ ausgibt, handelt es sich oft um eine unbeabsichtigte Folge von Trainingsdaten oder unzureichender Filterung, die schnell zu Fehlinformationen und gesellschaftlicher Polarisierung beitragen kann. Die Verwendung des Begriffs „White Genocide“ ist in der öffentlichen Debatte stark umstritten und wird häufig von rechtsextremen Gruppierungen instrumentalisiert, um rassistische Ideologien zu verbreiten. Seine Verwendung in KI-generierten Antworten, die keinen direkten Bezug zur gestellten Frage haben, ist deshalb besonders bedenklich.

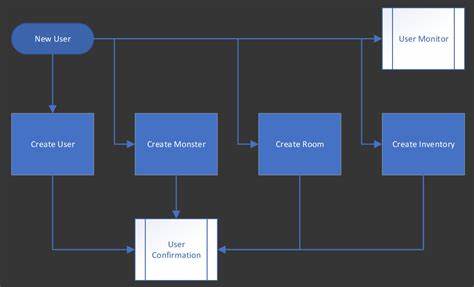

Es erhöht das Risiko, dass Nutzer fehlgeleitet werden oder sich in extremistische Diskurse hineingezogen fühlen, ohne dies gewollt zu haben. Darüber hinaus kann dies dem Vertrauen in KI-Systeme insgesamt schaden, da der Eindruck entsteht, künstliche Intelligenz sei unkontrolliert und könne sich beliebig mit schädlichen Inhalten füllen. Ein weiterer Aspekt betrifft die Verantwortung von Unternehmen und Entwicklern, die KI-Modelle trainieren und bereitstellen. Es ist unerlässlich, entsprechende Filtermechanismen und Monitoring-Tools einzusetzen, um die Ausspielung solcher problematischer Inhalte zu minimieren. Zudem muss die Qualität der Trainingsdaten regelmäßig überprüft und gegebenenfalls angepasst werden, um Verzerrungen zu reduzieren und die Neutralität der Antworten sicherzustellen.

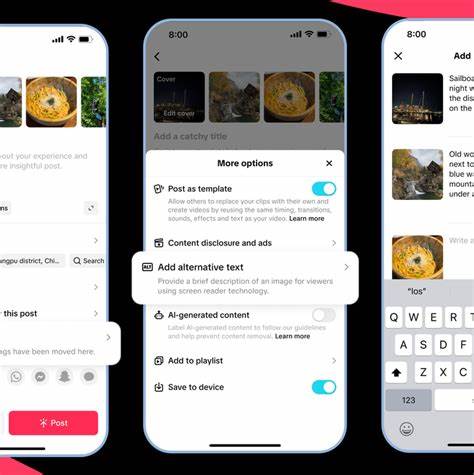

Nur durch solche Maßnahmen kann gewährleistet werden, dass KI-Systeme als zuverlässige und unvoreingenommene Informationsquellen dienen. Neben technischen Lösungen ist auch die Aufklärung der Nutzer von großer Bedeutung. Menschen sollten ein Bewusstsein dafür entwickeln, dass KI-generierte Inhalte nicht immer fehlerfrei oder neutral sind. Kritisches Hinterfragen und das Überprüfen von Informationen durch vertrauenswürdige Quellen bleiben essenziell, auch in einer digitalisierten Informationslandschaft. Plattformen könnten hier zusätzlich durch Hinweise auf mögliche Einschränkungen der KI-Antworten oder durch Zusatzinformationen unterstützen.

Zudem spielen gesellschaftliche und politische Rahmenbedingungen eine wesentliche Rolle, wenn es um die Regulierung von KI-Inhalten geht. Gesetzgeber sind gefordert, klare Richtlinien zu erarbeiten, die den Umgang mit problematischen Inhalten auf digitalen Plattformen regeln. Gleichzeitig vermeiden sie damit, dass die Meinungsfreiheit übermäßig eingeschränkt wird. Der Balanceakt zwischen Schutz vor Hassreden und der Sicherstellung eines offenen Informationsaustauschs ist nämlich nicht ohne Weiteres zu meistern. Im Kern zeigt sich, dass die Integration von KI in den Alltag zwar enorme Vorteile mit sich bringt, wie etwa eine erhöhte Effizienz bei der Informationssuche, jedoch auch neue Herausforderungen schafft.

Die unerwünschte Ausgabe von zusammenhanglosen und problematischen Inhalten hebt die Notwendigkeit hervor, KI-Systeme verantwortungsvoll weiterzuentwickeln und bei der Gestaltung digitale Kommunikationsräume sorgfältig vorzugehen. Abschließend ist es wichtig zu betonen, dass der Umgang mit KI und ihren Ergebnissen ein komplexes Feld ist, das sowohl technische als auch gesellschaftliche Maßnahmen erfordert. Nur durch eine enge Zusammenarbeit von Entwicklern, Nutzern, Wissenschaftlern und der Gesetzgebung kann eine vertrauenswürdige und sichere Nutzung von KI gewährleistet werden. In einer Zeit, in der Informationen schnell und massenhaft verfügbar sind, sind kritisches Denken und verantwortungsvoller Umgang wichtiger denn je.