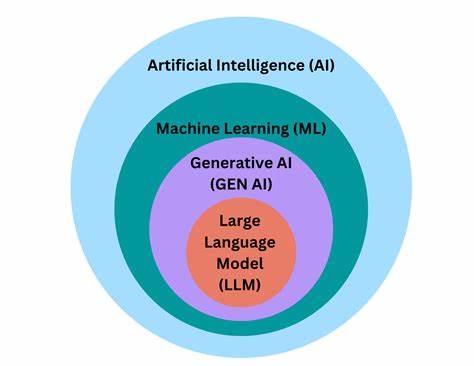

In der heutigen technologischen Landschaft gewinnen Künstliche Intelligenz (KI) und andere komplexe Systeme zunehmend an Bedeutung. Sie beeinflussen nahezu jeden Bereich unseres Lebens, von der medizinischen Diagnostik über autonomes Fahren bis hin zu Finanzsystemen. Dabei stellen diese Systeme Entwickler und Anwender vor große Herausforderungen, da ihr Verhalten oft nicht vollständig vorhersehbar ist. Unvorhersehbare Reaktionen und potenzielle Fehlfunktionen können schwerwiegende Folgen haben, weshalb die Entwicklung von zuverlässigen Schutzmechanismen essenziell ist. Das Konzept „Reliable by Design“ – zu Deutsch etwa „Zuverlässigkeit durch Design“ – bietet hier einen vielversprechenden Ansatz, um von Anfang an Sicherheitsgarantien zu etablieren.

Dieses Konzept zielt darauf ab, Systeme bereits während ihrer Entwicklung mit robusten und vorausschauenden Kontrollmechanismen auszustatten, um unerwünschte Verhaltensweisen effektiv einzudämmen und die Systemintegrität zu bewahren. Die Herausforderungen beim Aufbau solcher Guardrails sind vielfältig. KI-Modelle etwa lernen ständig aus Daten und passen ihr Verhalten dynamisch an, wodurch klassische statische Sicherheitsmaßnahmen oft nicht ausreichen. Zudem können komplexe Algorithmen in Ausnahmesituationen unerwartete Reaktionen zeigen, die schwer vorhersehbar sind. Um diesen Herausforderungen zu begegnen, bedarf es nicht nur technischer Innovationen, sondern auch eines grundlegenden Paradigmenwechsels in der Entwicklungspraxis.

Ein zentraler Bestandteil von „Reliable by Design“ ist die Integration von Kontrollmechanismen in jedem Schritt des Entwicklungsprozesses. Von der Datenbeschaffung und -vorverarbeitung über die Modellarchitektur bis hin zur Echtzeitüberwachung im Betrieb müssen Sicherheitsaspekte berücksichtigt und kontinuierlich überwacht werden. Dabei spielen moderne Methoden wie formale Verifikation, Simulationen und Belastungstests eine wichtige Rolle. Formale Verifikationen ermöglichen es, mathematisch nachzuweisen, dass Systeme gewisse unerwünschte Verhaltensweisen nicht an den Tag legen können. Dies schafft eine wichtige Vertrauensbasis, gerade in sicherheitskritischen Anwendungen wie der Luftfahrt oder Medizintechnik.

Ergänzend zu formalen Methoden kommen Simulationstechniken zum Einsatz, die es erlauben, das Verhalten von KI-Systemen in verschiedenen Szenarien und unter ungewöhnlichen Bedingungen zu testen. So können Entwickler noch vor dem Einsatz potenzielle Schwachstellen identifizieren und entsprechende Gegenmaßnahmen implementieren. Neben technischen Lösungen ist ein umsichtiger Umgang mit den eingesetzten Trainingsdaten ein weiterer Schlüsselfaktor. Datenqualität, Bias-Vermeidung und Transparenz sind wichtige Stellschrauben, um Fehlentwicklungen vorzubeugen. In vielen Fällen führen fehlerhafte oder unausgewogene Datensätze dazu, dass KI-Systeme unerwünschte Verhaltensmuster erlernen oder diskriminierende Entscheidungen treffen.

Der Aufbau von Guardrails umfasst daher auch organisatorische und ethische Aspekte, angefangen bei der sorgfältigen Auswahl und Aufbereitung der Trainingsdaten bis hin zu verantwortungsvoller Überwachung und Nachbesserung im Echtzeitbetrieb. Ein weiterer Bereich, der im Zusammenhang mit „Reliable by Design“ zunehmend an Bedeutung gewinnt, ist die Interaktion zwischen Mensch und Maschine. Gerade bei Systemen mit autonomen Komponenten sollten Benutzer jederzeit die Kontrolle behalten können. Hier kommen Konzepte wie Explainable AI (erklärbare KI) und Human-in-the-Loop-Design zum Tragen. Diese Ansätze ermöglichen es, Entscheidungen von KI nachvollziehbar zu machen und kontrollierte Eingriffe zu erlauben, falls das System in problematische Situationen gerät.

Neben den technischen und methodischen Aspekten darf auch die rechtliche Dimension nicht außer Acht gelassen werden. Regulierungsbehörden weltweit arbeiten derzeit an Richtlinien und Vorschriften, die den sicheren Betrieb intelligenter Systeme gewährleisten sollen. Unternehmen sind daher gut beraten, ihre Entwicklungsprozesse gemäß diesen Vorgaben zu gestalten und dokumentierte Nachweise für die Zuverlässigkeit ihrer Lösungen zu erbringen. Dies hilft nicht nur, rechtliche Risiken zu minimieren, sondern stärkt auch das Vertrauen von Kundschaft und Öffentlichkeit. Abschließend lässt sich festhalten, dass der Weg zu zuverlässigen, sicheren und vor allem vertrauenswürdigen KI-Systemen ein komplexes Zusammenspiel aus Technologie, Methodik und Ethik erfordert.

Der Ansatz „Reliable by Design“ stellt dabei ein wertvolles Leitprinzip dar, um vielfältige Risiken bereits bei der Entwicklung zu adressieren und langfristig tragfähige Lösungen zu schaffen. Nur durch eine systematische Integration von Sicherheitsmaßnahmen auf allen Ebenen können KI und andere unvorhersehbare Systeme ihr volles Potenzial entfalten und gleichzeitig die nötige Verlässlichkeit bieten, die in sensiblen Anwendungsbereichen unabdingbar ist. Die Zukunft intelligenter Systeme wird maßgeblich davon abhängen, wie gut es gelingt, diese Schutzmechanismen zu implementieren und so eine Balance zwischen Innovation und Sicherheit zu gewährleisten.

![Reliable by Design: Building Guardrails for AI and Other Unpredictable Systems [video]](/images/BD219C34-4544-470D-B041-6326E1C2CE48)