Im Zeitalter der digitalen Transformation gewinnen Automatisierung und künstliche Intelligenz zunehmend an Bedeutung, vor allem im Bereich der IT-Infrastrukturverwaltung. Site Reliability Engineers (SREs) stehen ständig vor der Herausforderung, komplexe Systeme wie Kubernetes-Cluster und AWS-Cloud-Dienste effizient zu verwalten und bei Problemen schnell zu reagieren. Hier setzt der innovative SRE Assistant an, ein KI-gestützter Agent, der speziell darauf ausgelegt ist, SREs bei ihren täglichen Aufgaben ganzheitlich zu unterstützen. Dieser smarte Helfer basiert auf Googles Agent Development Kit (ADK) und nutzt moderne Large Language Models, um natürliche Spracheingaben zu verstehen und automatisierte Aktionen auszuführen. Dadurch können Betreiber und Administratoren von Kubernetes und AWS ihre Arbeitsabläufe deutlich vereinfachen und die Reaktionszeiten bei Vorfällen verbessern.

Die Rolle des SRE Assistant erstreckt sich über verschiedene Kernbereiche des IT-Betriebs. Primär hilft der Agent dabei, Ressourcen innerhalb von Kubernetes-Clustern zu überwachen und zu verwalten. Dazu gehören Funktionen wie das Auflisten von Namespaces, Deployments, Pods, Services, Secrets, DaemonSets oder ConfigMaps. Durch gezielte Abfragen lassen sich detailreiche Informationen zu einzelnen Deployments oder Pods abrufen, um deren Zustand zu beurteilen oder nötige Anpassungen vorzunehmen. Die Fähigkeit, Deployments zu skalieren, ermöglicht eine dynamische Anpassung der Ressourcen, um Lastspitzen zu bewältigen oder Kosten zu minimieren.

Ebenfalls integriert sind Funktionen zur Analyse von Pod-Logs und zur Überwachung der Ressourcengesundheit sowie zur Einsicht in Cluster-Events, die bei der Ursachenforschung von Störungen helfen. Neben Kubernetes bietet der SRE Assistant umfangreiche Werkzeuge für den Umgang mit AWS-Diensten. Verschiedene Sub-Agenten und spezialisierte Tools sind dafür konzipiert, um Interaktionen mit Kernservices von AWS zu erleichtern. Die Integration eines AWS Core MCP Agent erlaubt generelle Zugriffe und Steuerbefehle, während ein dedizierter AWS Cost Analysis MCP Agent darauf ausgelegt ist, Kosten- und Nutzungsberichte zu erstellen und zu analysieren. Ein weiterer spezialisierter AWS Cost Agent unterstützt tiefgreifende Kostenanalysen, um Einsparpotenziale aufzuzeigen und Berichte vorzubereiten, die für das Finanzcontrolling wichtig sind.

Damit bietet der SRE Assistant nicht nur operativen Support, sondern fördert auch eine bessere Kostenkontrolle und Optimierung der Cloud-Ausgaben. Aus technischer Sicht erfordert die Nutzung des SRE Assistant einige Voraussetzungen, darunter eine aktuelle Python-Umgebung (ab Version 3.10), Docker und Docker Compose zur einfachen Bereitstellung sowie einen Google API-Schlüssel, der für den Zugriff auf die KI-Modelle notwendig ist. Auch die Zugänge zu den jeweiligen Kubernetes-Clustern (über kubectl) und zu AWS (über konfigurierte Credentials) müssen verfügbar sein. Die modulare Architektur sorgt dafür, dass einzelne Komponenten flexibel angepasst und erweitert werden können, was den Agenten zu einem skalierbaren Werkzeug für verschiedenste Szenarien macht.

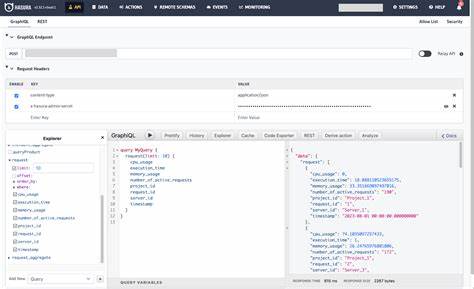

Das Zusammenspiel der Funktionen erfolgt über eine intuitive Kommunikation, die entweder direkt über eine Weboberfläche, eine API oder über eine Slack-Integration stattfinden kann. Besonders die Integration in Slack ermöglicht es Teams, direkt aus ihrem Kommunikationskanal heraus Anfragen an den SRE Assistant zu stellen. So können etwa Informationen zum Zustand eines Deployments, Skalierungsbefehle oder Kostenabfragen schnell per Chat abgesetzt werden, ohne zwischen verschiedenen Tools wechseln zu müssen. Hierbei wird sichergestellt, dass Benutzersitzungen und Gespräche konsistent verwaltet werden und eine nachvollziehbare Historie entsteht, die den Supportprozess unterstützt. Ein wesentlicher Vorteil des SRE Assistant liegt in seiner Fähigkeit, natürliche Sprache zu verarbeiten.

SREs müssen keine komplexen Kommandozeilenbefehle mehr eingeben oder umfangreiche Dashboards durchforsten, sondern können in ihrer Alltagssprache Fragen stellen oder Anweisungen geben. Die Integration der Google ADK-Plattform ermöglicht ein tiefes Verständnis der Nutzeranfragen, die dann präzise in Aktionen übersetzt werden. Dies erhöht nicht nur die Geschwindigkeit bei der Problemlösung, sondern reduziert auch die Fehlerhäufigkeit, die beim manuellen Handling entstehen kann. Sicherheit spielt bei einem solchen Agenten eine zentrale Rolle, denn es handelt sich um ein Werkzeug, das tief in kritische Systeme eingreift. Aus diesem Grund legt das Projekt großen Wert auf die Verwaltung von Credentials über sichere Umgebungsvariablen und den Einsatz von Prinzipien wie „Least Privilege“, bei dem der Agent nur die unbedingt erforderlichen Berechtigungen erhält.

Zudem wird empfohlen, Netzwerkkonfigurationen sorgfältig zu überprüfen und regelmäßige Audits durchzuführen, um potenzielle Sicherheitslücken frühzeitig zu erkennen. Für Entwickler ist der SRE Assistant sowohl als fertige Docker-Anwendung als auch als lokal ausführbares Python-Projekt verfügbar. Der Quellcode des Projekts ist modular strukturiert und erlaubt es, eigene Erweiterungen zu implementieren oder die bestehende Funktionalität anzupassen. Die Verwendung von modernen Werkzeugen wie dem Linter Ruff für Codequalität und Pre-Commit Hooks unterstützt eine professionelle Entwicklungspraxis. Dies erleichtert es Teams, den Agenten in ihre bestehende Infrastruktur zu integrieren und kontinuierlich weiterzuentwickeln.

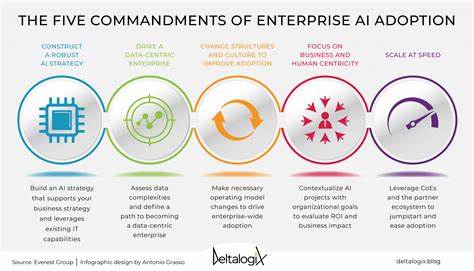

Die Einführung solcher KI-gesteuerten Agenten markiert einen Paradigmenwechsel im Bereich des Site Reliability Engineerings. Automatisierung und intelligente Assistenzsysteme wie der SRE Assistant ermöglichen es, menschliche Arbeitskraft effizienter einzusetzen und gleichzeitig die Stabilität und Performance von Cloud-Infrastrukturen zu erhöhen. Besonders in Umgebungen mit hoher Komplexität bieten sich dadurch erhebliche Vorteile bei der Minimierung von Ausfallzeiten und der Optimierung der Ressourcennutzung. Abschließend lässt sich festhalten, dass der SRE Assistant eine vielversprechende Lösung für moderne IT-Betriebsteams darstellt, um Kubernetes- und AWS-Umgebungen sicher, effizient und kosteneffektiv zu betreiben. Die Kombination aus KI-Technologien, modularer Architektur und der Fokussierung auf praxisnahe Use Cases sorgt dafür, dass SREs ihre Ziele schneller und mit weniger Aufwand erreichen.

Mit weiteren Updates und Ausbau der Funktionalitäten wird der SRE Assistant zukünftig eine wichtige Rolle bei der automatisierten Cloud-Verwaltung spielen und die Arbeit von DevOps- und SRE-Teams nachhaltig verbessern.