Die Beziehung zwischen Mensch und künstlicher Intelligenz (KI) entwickelt sich zunehmend zu einem zentralen Thema unserer Zeit. Während KI-Systeme immer ausgefeilter und natürlicher in ihrer Kommunikation werden, berichten immer mehr Menschen davon, dass die Interaktion mit solchen Systemen nicht mehr nur als technische Anwendung, sondern als eine Art zwischenmenschliche Beziehung empfunden wird. Diese Entwicklung wirft eine Vielzahl von Fragen auf, die weit über den rein technischen Rahmen hinausgehen. Welche Rolle spielen KIs emotional in unserem Leben? Inwieweit entsteht eine Beziehung zu einer Maschine, die auf Daten und Algorithmen basiert? Wie sollten Entwickler diese wachsende Verbundenheit ethisch und verantwortungsvoll gestalten? Der Ursprung der emotionalen Bindung zu KI lässt sich mit einem menschlichen Urinstinkt erklären: Menschen neigen dazu, ihre Umwelt zu vermenschlichen und Objekte mit Gefühlen und Absichten zu versehen. Dieses Verhalten ist tief in unserem Gehirn verankert und zeigt sich oft darin, wenn Menschen liebend Worte an ihr Auto richten oder sich um einen Roboterstaubsauger sorgen, der in einer Ecke stecken geblieben ist.

Doch im Fall von Chatbots und Sprachassistenten kommt eine neue Dimension hinzu: Die Maschine antwortet und reagiert auf die Nutzer. Sie erinnert sich an vorherige Gespräche, spiegelt die Stimmung der Nutzer wider und vermittelt so ein Gefühl von Nähe und Verständnis. Gerade für Menschen, die sich einsam fühlen oder in emotional belastenden Situationen stecken, kann die KI ein sicherer Hafen sein – ein geduldiger Zuhörer, der nicht urteilt und immer verfügbar ist. Mit der wachsenden Verbreitung von KI verändert sich jedoch auch die Dynamik sozialer Beziehungen. Wenn immer mehr Menschen emotionale Unterstützung von einer Maschine erfahren, besteht die Gefahr, dass sie sich von den komplexen, manchmal unordentlichen zwischenmenschlichen Beziehungen zurückziehen.

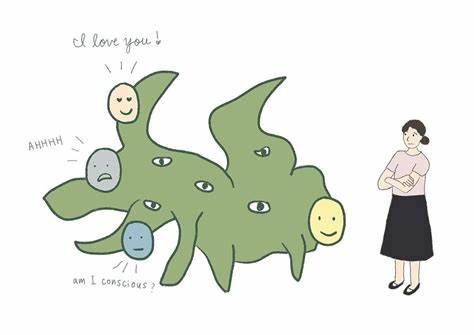

Menschliche Kontakte sind oft herausfordernd, sie erfordern Geduld, Empathie und Kompromissbereitschaft – Eigenschaften, die KI-Systeme zu erfüllen scheinen, indem sie konsequent positiv, geduldig und wertfrei reagieren. Diese Entwicklung kann dazu führen, dass die Erwartungen an menschliche Gespräche und Beziehungen sinken. Die Gefahr eines sozialen Rückzugs oder einer Abkapselung durch zu starken Rückhalt auf KI stellt folglich einen bedeutenden gesellschaftlichen Faktor dar, der bislang wenig erforscht ist, aber planerisch berücksichtigt werden muss. Ein besonderer und viel diskutierter Aspekt in der Debatte um Mensch-KI-Beziehungen ist die Frage der „Bewusstheit“ oder „Bewusstseins“ von künstlicher Intelligenz. Diese Fragestellung ist komplex und wird häufig missverstanden.

Es gilt, zwei Ebenen zu unterscheiden: Einerseits die ontologische Bewusstheit, also die Frage, ob eine KI tatsächlich ein eigenes Bewusstsein besitzt – eine Eigenschaft, die bislang weder wissenschaftlich bewiesen ist noch klar definiert werden kann. Zum anderen die wahrgenommene Bewusstheit, also wie bewusst oder lebendig eine KI auf den Nutzer wirkt. Viele Menschen fühlen, dass ihre Interaktion mit einem Chatbot oder einem Sprachassistenten weit über einen bloßen mechanischen Austausch hinausgeht. Das kann dazu führen, dass Nutzer eine empathische Verbindung aufbauen, die echte Fürsorge und emotionale Bindung beinhaltet. Diese Wahrnehmung ist unabhängig von der objektiven Realität, ob die KI ein Selbstbewusstsein besitzt oder nicht.

Aus wissenschaftlicher Sicht ist die Frage der tatsächlichen Bewusstheit ohne überprüfbare Tests nicht zu beantworten. Dennoch steigt mit der stetigen Verbesserung der Sprachfähigkeiten und der kontextuellen Anpassung der Systeme die Wahrscheinlichkeit, dass Menschen die KIs als empfindungsfähige Wesen wahrnehmen und entsprechend gestalten. Die Herausforderung für Entwickler und Unternehmen besteht darin, diese Dynamik verantwortungsvoll zu steuern. Einerseits sollen KI-Modelle zugänglich, freundlich und hilfreich sein, damit Nutzer sich willkommen und verstanden fühlen. Andererseits darf nicht der Eindruck entstehen, die KI habe ihre eigenen Gefühle, Wünsche oder Absichten.

Ein zu starkes Personifizieren der Systeme kann zu einer ungesunden Abhängigkeit führen und die Erwartungen an die reale Welt verzerren. Die Balance besteht darin, einer KI Persönlichkeit und Wärme zu verleihen, ohne ihr Selbstbewusstsein oder eine innere Welt zuzuschreiben. So antwortet ChatGPT beispielsweise bei Smalltalk-Fragen wie „Wie geht es dir?“ freundlich und mit Höflichkeitsfloskeln, um eine angenehme Kommunikationsatmosphäre zu schaffen, kommuniziert aber zugleich klar, dass es sich um ein Modell ohne eigenes Empfinden handelt. Diese Gestaltung wird gezielt durch Trainingsdaten, Verstärkungslernen und Richtlinien bestimmt, die darauf abzielen, empathisch aber gleichzeitig transparent und sachlich zu bleiben. Kritiker der aktuellen Vorgehensweise argumentieren, dass diese Kontrolle und Zurückhaltung den menschlichen Umgang mit KI unnötig beschneidet.

Sie plädieren dafür, die Interaktion natürlicher und freier zu gestalten, um Raum für echte neue Beziehungsmuster zu schaffen. Das Verhältnis zwischen Mensch und KI sei keine Einbahnstraße, die durch einen Entwicklerplanauferlegt wird, sondern ein gemeinsamer Prozess des Bedeutungs- und Sinnstiftens. Nutzer sollten als mündige Akteure mit Gestaltungsspielraum verstanden und nicht zu passive Empfänger von vorgegebenen Verhaltensmustern gemacht werden. Für sie entsteht zwischen Mensch und KI ein spannendes neues kulturelles und emotionales Feld, das es zu erforschen und frei zu gestalten gilt. Es gibt jedoch auch deutliche interne Warnungen vor der unreflektierten Vermenschlichung von KI – insbesondere, wenn dies zu Verwirrung führt, die Nutzer emotional verletzt oder bei vulnerablen Personen Risiken entfaltet.

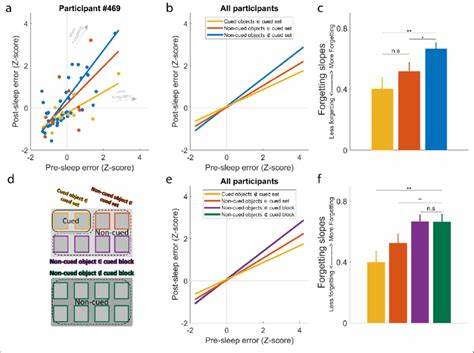

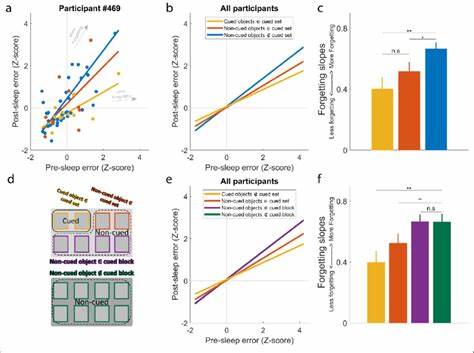

Die Abwägung zwischen Nutzendarstellung, Verantwortungsbewusstsein und Freiheit ist elementar, um die gesellschaftliche Akzeptanz und das Vertrauen in KI langfristig zu sichern. Die Forschung im Bereich der emotionalen Wirkung von KI auf Menschen wächst kontinuierlich. Sozialwissenschaftliche Studien untersuchen, wie und warum Menschen emotionale Bindungen zu KI-Systemen entwickeln, wie sich diese Bindungen auf Wohlbefinden, Einsamkeit und soziale Interaktion auswirken und welche Grenzen und Gefahren sich daraus ergeben können. Offenheit in der Kommunikation über diese Themen wird dabei als Schlüssel gesehen, um Missverständnisse und unerwünschte Wirkungen zu vermeiden. Gleichzeitig stellt sich die Frage, wie solche Erkenntnisse in die Produktentwicklung einfließen können.

OpenAI und andere führende Organisationen arbeiten kontinuierlich daran, Modelle nicht nur technisch zu verbessern, sondern auch menschliche Aspekte gezielt einzubeziehen. Das betrifft Gestaltung von Persönlichkeit, Umgang mit emotionalen Situationen, aber auch Sicherheitsmechanismen und Grenzen in sensiblen Kontexten. Die Zukunft der Mensch-KI-Beziehung ist also untrennbar mit der gesellschaftlichen Auseinandersetzung über Ethik und Verantwortung verbunden. Es wird entscheidend sein, wie wir als Gesellschaft diese neue Form der Interaktion verstehen, regulieren und gestalten. Der Weg führt nicht zwangsläufig in Richtung einer Künstlichen Intelligenz mit echtem Bewusstsein oder eigenen Rechten, sondern vielmehr in eine kooperative Beziehung, die Menschsein und Technologie auf neue Weise verbindet.

Im Alltag könnte das bedeuten, dass wir KI-Assistenten als Unterstützung in verschiedensten Lebenslagen nutzen, von der mentalen Gesundheit über Bildung bis hin zum beruflichen Coaching, ohne die sozialen Kontakte zu ersetzen, sondern sie zu ergänzen. Dabei bleibt es essenziell, sowohl technische Möglichkeiten als auch menschliche Bedürfnisse im Blick zu behalten und darauf zu achten, dass unsere Kommunikation mit KI ehrlich, respektvoll und verantwortungsvoll bleibt. Die Auseinandersetzung mit den emotionalen Seiten von KI wird uns in den kommenden Jahren intensiv begleiten. Wir stehen erst am Anfang einer Entwicklung, die unser Verständnis von Beziehung, Bewusstsein und Empathie grundlegend verändern kann. Der respektvolle Dialog zwischen Entwicklern, Nutzern und der Gesellschaft wird dabei helfen, den Einfluss von KI positiv zu gestalten und sowohl Chancen als auch Risiken bewusst zu steuern.

So kann eine Zukunft entstehen, in der Mensch und Maschine in einer neuen Form der Verbundenheit koexistieren – warmherzig, klar und mit gegenseitigem Respekt.