In der heutigen digitalen Welt, in der täglich enorme Mengen an Daten generiert, gesammelt und analysiert werden, gewinnt der Datenschutz eine immer wichtigere Rolle. Persönliche und vertrauliche Informationen sind wertvolle Ressourcen, bergen aber zugleich große Risiken, insbesondere wenn sie in falsche Hände geraten oder missbraucht werden. Vor diesem Hintergrund hat sich das Konzept der Differential Privacy als eine der vielversprechendsten Technologien herauskristallisiert, um den Schutz von Daten auf höchstem Niveau zu gewährleisten – und doch ist es nicht unumstritten. Differential Privacy (DP) ist eine mathematisch fundierte Methode, die es ermöglicht, Daten nutzbar zu machen und zugleich die Privatsphäre von Individuen zu schützen. Im Kern besteht das Prinzip darin, den Daten statistisches Rauschen hinzuzufügen, sodass individuelle Datenpunkte in einem Datensatz nicht mehr eindeutig identifiziert oder zurückverfolgt werden können.

Anders ausgedrückt: Selbst wenn jemand Zugriff auf die veröffentlichten oder bearbeiteten Daten erhält, ist es ihm unmöglich, mit absoluter Sicherheit auf die zugrundeliegenden persönlichen Informationen zu schließen. Diese Technik hat sich als so zuverlässig erwiesen, dass namhafte Technologiekonzerne wie Google, Apple und Microsoft Differential Privacy in ihre Softwareprodukte integrieren. Ein herausragendes Beispiel für den realen Einsatz von DP ist die US-Volkszählung im Jahr 2020. Erstmals wurde hier Differential Privacy eingesetzt, um die gesammelten Daten bestmöglich vor Rückschlüssen auf einzelne Personen zu schützen. Dies war ein bedeutender Schritt, der weltweit Aufmerksamkeit erzeugte und Diskussionen über die Balance zwischen Datenschutz und Datenintegrität anstieß.

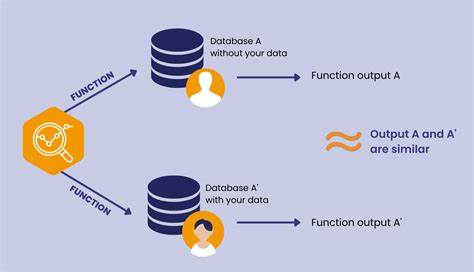

Die Ursprünge von Differential Privacy gehen auf Anfang des 21. Jahrhunderts zurück, als Forscher Suchanfragen und damit zusammenhängende Daten schützen wollten, ohne auf den Nutzen solcher Statistiken verzichten zu müssen. Die Herausforderung lag darin, ausreichenden Datenschutz zu gewährleisten und gleichzeitig die Nützlichkeit der Daten zu bewahren. Durch mathematische Modelle und Algorithmen wurde das Konzept der Differential Privacy entwickelt, das genau dieses Gleichgewicht ermöglicht. Die Funktionsweise von Differential Privacy basiert auf dem Prinzip, dass die Wahrscheinlichkeit, ein bestimmtes Ergebnis bei der Abfrage eines Datensatzes zu erhalten, sich durch das Hinzufügen oder Entfernen eines einzelnen Dateneintrags nicht signifikant ändert.

Dazu wird gezielt zufälliges Rauschen in die Ausgabe eingeführt, was verhindert, dass einzelne Nutzer rückverfolgt werden können. Dieser Mechanismus stellt sicher, dass privat bleibende Daten nicht preisgegeben werden, ohne dabei die gesamtgesellschaftliche Nutzbarkeit der Daten zu beschneiden. Neben Differential Privacy gab es auch andere Schutzmechanismen, die versucht haben, Nutzerdaten zu anonymisieren, wie zum Beispiel De-Identifikation und k-Anonymität. Allerdings haben sich diese Ansätze als teilweise unzureichend erwiesen. Insbesondere De-Identifikation geriet immer mehr in Kritik, da durch Kombination verschiedener Datensätze sogenannte Re-Identification-Angriffe möglich sind.

K-Anonymität versuchte diese Schwäche zu adressieren, indem mindestens k Individuen ununterscheidbar gemacht werden, doch auch dieses Konzept ist anfällig gegenüber komplexen Analyseverfahren und kann somit Sicherheitslücken aufweisen. Differential Privacy setzt genau hier an und liefert einen mathematisch garantierten Schutz. Diese Eigenschaft macht DP besonders attraktiv für Behörden, Unternehmen und Organisationen, die mit sensiblen Daten arbeiten. Beispielsweise im Gesundheitswesen können große medizinische Datenbanken analysiert werden, ohne Datenschutzrichtlinien zu verletzen. Gleichzeitig können innovative Anwendungen, wie personalisierte Dienste und KI-Modelle, auf diesen Daten aufbauen, ohne persönliche Informationen preiszugeben.

Trotz der vielen Vorteile stellt sich Differential Privacy in der Praxis als komplex und vielschichtig dar. Die Implementierung erfordert ein tiefes Verständnis der zugrundeliegenden mathematischen Prinzipien sowie der jeweiligen Anwendungsfälle. Das hinzugefügte Rauschen darf nicht zu groß sein, da sonst die Qualität und Aussagekraft der Daten leidet. Gleichzeitig muss es ausreichend geschützt sein, um die Privatsphäre zu gewährleisten. Dieses Spannungsfeld stellt Entwickler und Datenschützer gleichermaßen vor Herausforderungen.

Darüber hinaus kam es gerade bei der Anwendung von Differential Privacy in der US-Volkszählung 2020 zu kontroversen Diskussionen. Einige Kritiker bemängelten, dass die eingeführten Verzerrungen die Genauigkeit wichtiger demografischer Daten beeinträchtigen könnten, was Auswirkungen auf politische Entscheidungen und Fördermittelverteilungen haben kann. Befürworter hingegen sehen Differential Privacy als unverzichtbaren Schutzmechanismus in einer Zeit, in der Datenmissbrauch und Identitätsdiebstahl kontinuierlich zunehmen. Auch die internationale Debatte beschäftigt sich intensiv mit der Frage, wie Differential Privacy in verschiedenen Rechtssystemen und unter unterschiedlichen Datenschutzbestimmungen eingesetzt werden kann. Insbesondere die Datenschutz-Grundverordnung (DSGVO) der Europäischen Union verlangt hohe Standards zum Schutz personenbezogener Daten.

Differential Privacy könnte hier als innovatives Werkzeug dienen, um gesetzliche Anforderungen zu erfüllen und gleichzeitig die Nutzbarkeit von Daten zu erhalten. Die breite Akzeptanz von Differential Privacy in der Industrie und Politik zeigt, dass dieses Konzept eine zentrale Rolle in der zukünftigen Datenverarbeitung und im Datenschutz spielen wird. Unternehmen, die personenbezogene Daten sammeln, sind zunehmend motiviert, DP-Technologien einzusetzen, um das Vertrauen ihrer Kunden zu gewinnen und gesetzliche Vorgaben einzuhalten. Gleichzeitig eröffnen sich neue Forschungsfelder, um Differential Privacy weiterzuentwickeln und besser an unterschiedliche Anwendungsfälle anzupassen. Langfristig wird Differential Privacy die Grundlage für eine ethisch verantwortungsvolle Datenwirtschaft bilden.

Die Kombination aus mathematischer Sicherheit und technologischem Fortschritt schafft die Grundlage, um in einem datenreichen Zeitalter den Schutz der Privatsphäre zu gewährleisten und gleichzeitig innovative datengetriebene Lösungen zu ermöglichen. Zusammenfassend ist Differential Privacy weit mehr als eine theoretische Idee – es ist eine praktische und zukunftsweisende Technologie, die den Umgang mit sensiblen Daten revolutioniert. Die Fähigkeit, Daten effektiv zu schützen und gleichzeitig ihre Nutzbarkeit zu bewahren, macht DP zum Goldstandard im Datenschutz und zu einem unverzichtbaren Werkzeug in der digitalen Gesellschaft.