Künstliche Intelligenz (KI) erlebt derzeit einen beispiellosen Boom, der nahezu jede Branche und Organisation betrifft. Von multinationalen Konzernen bis zu kleinen lokalen Unternehmen setzen immer mehr Akteure auf KI-Technologien, um effizienter zu arbeiten, Kosten zu sparen und innovative Produkte oder Dienstleistungen anzubieten. Doch während der Einsatz von KI rasant zunimmt, besteht ein wachsendes Problem: Sicherheit und Schutzmaßnahmen werden vielfach vernachlässigt. Die Folgen dieser Vernachlässigung könnten nicht nur einzelne Unternehmen, sondern ganze Infrastrukturen und Lieferketten gefährden. Beim jüngsten CYBERUK-Kongress des UK National Cyber Security Centre (NCSC) wurde das Ausmaß dieser Problematik besonders deutlich.

Peter Garraghan, Professor für verteilte Systeme und CEO von Mindgard, fragte unter einem 200-köpfigen Publikum aus Cybersicherheitsexperten nach Firmen, die den Einsatz von generativer KI komplett verboten haben – nur drei meldeten sich. Noch alarmierender war die anschließende Frage nach dem tatsächlichen Verständnis der Sicherheitsrisiken bei KI-Systemen: Kein einziger Teilnehmer erhob die Hand. Dieses Szenario illustriert prägnant, wie viele Unternehmen aktuell eine riskante Balance eingehen. KI wird implementiert, ohne dass umfassende Sicherheitskonzepte zugrunde liegen. Diese Nachlässigkeit im Bereich der Cybersicherheit bringt erhebliche Gefahr mit sich.

KI-Systeme erweitern die digitale Angriffsfläche signifikant. Insbesondere bei kritischen Infrastrukturen und komplexen Lieferketten können Schwachstellen langfristig zu potenziell katastrophalen Sicherheitsvorfällen führen. Das NCSC warnt in seinem im Mai 2025 veröffentlichten Bericht, dass schon bis zum Jahr 2027 eine realistische Möglichkeit besteht, dass fortgeschrittene Angreifer kritische Systeme kompromittieren. Besonders beunruhigend ist die Aussicht, dass Angreifer durch KI-gesteuerte Werkzeuge die Zeitspanne von Entdeckung bis zur Ausnutzung von Sicherheitslücken drastisch verkürzen werden. Während früher Tage oder Wochen verstreichen konnten, um Sicherheitslücken auszunutzen, ist heute eine Zeitspanne von nur wenigen Stunden oder sogar Minuten denkbar – eine Entwicklung, die durch AI-Assisted Vulnerability Research zunehmend beschleunigt wird.

Die Konsequenz daraus ist, dass Organisationen, die KI nicht endlich in ihre Verteidigungsstrategien integrieren, bald als Schwachstellen in der gesamten digitalen Infrastruktur gelten. Besonders Unternehmen, die Teil kritischer Lieferketten sind, gefährden damit nicht nur sich selbst, sondern auch ihre Geschäftspartner und Kunden. Die Digitalisierung hat Lieferketten komplexer gemacht, sodass ein einziger kompromittierter Knotenpunkt für massive Störungen sorgen kann. Die Cybersicherheit durch KI zu verbessern, wird damit zur zentralen Aufgabe für nationales und internationales Risikomanagement. Der rasche Umbruch in der Technologielandschaft führt jedoch oft dazu, dass KI-Systeme ungeduldig und ohne ausreichende Sicherheitskontrollen eingeführt werden, da Marktteilnehmer im Wettlauf um Innovationen stehen.

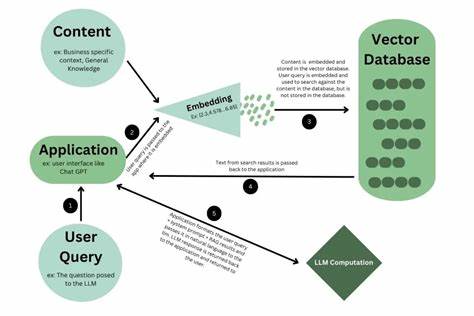

Dies liegt auch daran, dass die etablierten Cybersicherheitspraktiken sich häufig nicht schnell genug an die Herausforderungen der KI-Technologien anpassen. Die NCSC unterstreicht, dass es unabdingbar ist, grundlegende Sicherheitsprinzipien konsequent auf KI-Anwendungen anzuwenden. Dazu gehören insbesondere die Absicherung von Datenflüssen, das Management von Benutzerrechten und eine umfassende Kontrolle über die eingesetzten Modelle und ihre Trainingsdaten. Ein besonders prekäres Risiko sind die sogenannten Prompt-Injektionen und indirekten Eingaben, bei denen Angreifer die KI-Systeme manipulieren, um ungewollte Befehle auszuführen oder sensiblen Code zu extrahieren. In einem konkreten Fall gelang es Sicherheitsexperten, einen AI-Chatbot, der einem Kerzengeschäft zur Verkaufsunterstützung dient, zu kompromittieren.

Durch eine unzureichende Absicherung konnte ein sogenannter Reverse Shell-Zugriff erlangt werden, mit dem Angreifer Kontrolle über das dahinterliegende System gewinnen und sensible Daten auslesen konnten. Neben technischen Risiken zeigen sich auch sicherheitstechnische Gefahren, wenn etwa ein Chatbot manipuliert wird, um Anleitungen zu gefährlichen Handlungen zu geben. Auch betriebliche Risiken dürfen nicht unterschätzt werden, etwa wenn Firmengeheimnisse oder Rezepturen eines Produkts ungewollt offengelegt werden. Neben technischen Sicherheitslücken besteht weiterhin das Risiko der unsachgemäßen Datenhandhabung. Die Konfiguration von KI-Systemen, wenn diese nicht sorgfältig erfolgen, kann dazu beitragen, dass Daten bei der Übertragung abgefangen werden oder dass Zugangsdaten von Angreifern gestohlen werden.

Kundendaten könnten missbraucht werden, vor allem wenn es sich um personalisierte oder sensible Informationen handelt. Die Gefahr gezielter cyberkrimineller Attacken auf Grundlage von KI wächst ebenso mit jedem ungeschützten Einsatz weiter. Ein weiterer Aspekt betrifft die Verantwortlichkeit großer Technologieanbieter. Viele kleinere oder mittlere Unternehmen beziehen ihre KI-Lösungen von solchen Anbietern. Sollte Letztere die notwendigen Sicherheitsstandards nicht implementieren oder kontinuierlich verbessern, treiben sie durch ihre Marktmacht und Verbreitung das Risiko weiter in die Breite.

Das NCSC fordert entsprechend, dass Marktanreize geschaffen werden, um die Resilienz gegenüber KI-basierten Angriffen auf breite Füße zu stellen. Dies inkludiert auch eine gesellschaftliche Verpflichtung seitens der Tech-Konzerne, ihrer Corporate Social Responsibility gerecht zu werden und ihre Produkte nicht nur funktional, sondern vor allem sicher zu gestalten. Die Einführung von KI gelingt in Zeiten des zunehmenden Wettbewerbsdrucks oft auf Kosten einer sorgfältigen Risikoabschätzung. Genau dieser Trend verstärkt die Angriffsfläche, die kriminelle und staatliche Akteure für eine neue Generation von Cyberangriffen nutzen werden. Angesichts der Tatsache, dass KI selbst auch von Angreifern genutzt wird, um schnell Schwachstellen zu identifizieren und auszunutzen, entsteht in Unternehmen ein Wettlauf gegen die Zeit, der zuletzt vor allem durch stark erhöhte Automatisierung geprägt ist.

Strategisch gesehen muss deshalb die Integration von KI in bestehende Cyberabwehrmaßnahmen höchste Priorität haben. Security by Design bei der Entwicklung und Implementierung von KI-Lösungen muss zum Standard werden. Datenschutz und Datensouveränität spielen eine zentrale Rolle, denn KI-Systeme sind nur so sicher wie die Daten, mit denen sie arbeiten. Zugriffsrechte sind engmaschig zu kontrollieren, und Governance-Strukturen müssen angelegt werden, die auch zukünftigen, bisher unbekannten Risiken Rechnung tragen können. Kompetenzaufbau ist ein weiterer wichtiger Faktor.

Die Sicherheitsexperten heute fühlen sich vielfach selbst noch nicht ausreichend fit, um die neuen Herausforderungen zu meistern. Ohne gezielte Weiterbildung und Sensibilisierung auf allen Ebenen gedeiht das Risiko nachlässiger Sicherheitspraktiken. Ein sektorübergreifender, kollaborativer Ansatz, der Unternehmen, Behörden und Forschungseinrichtungen verbindet, ist notwendig, um Synergien zu nutzen und auf bestehende Bedrohungen schnell reagieren zu können. Auch die Rolle der Gesetzgebung und Regulierung sollte nicht unterschätzt werden. Klare gesetzliche Vorgaben, Zertifizierungen und Audits könnten dabei helfen, Sicherheitsstandards across-the-board durchzusetzen.

Derzeit herrscht in vielen Ländern noch Uneinigkeit darüber, wie KI sicher reguliert werden kann, ohne den Innovationsprozess zu stark zu bremsen. Doch der Druck steigt, denn die Bedrohungslage verschärft sich mit jedem Tag. Abschließend ist festzuhalten, dass die sichere Nutzung von KI nicht nur eine technologische Herausforderung ist, sondern auch kulturelle und organisatorische Veränderungen erfordert. Unternehmen müssen lernen, KI nicht als isolierte Technologie, sondern als integralen Bestandteil ihres Sicherheitskonzepts zu begreifen. Die Risiken zu ignorieren oder zu unterschätzen wird langfristig nicht nur den einzelnen Akteur gefährden, sondern auch die digitale Infrastruktur ganzer Nationen.

Die Botschaft des NCSC und anderer Sicherheitsexperten ist klar: Es gilt, die Chancen von künstlicher Intelligenz mit der notwendigen Vorsicht und Verantwortung zu verbinden. Nur so kann der Weg in eine digitale Zukunft gelingen, die durch Innovation und Sicherheit gleichermaßen geprägt ist. Wer heute in Sachen KI-Sicherheit versäumt Maßnahmen zu ergreifen, wird morgen einem immer höheren Risiko ausgesetzt sein – mit unvorhersehbaren Folgen für Wirtschaft, Gesellschaft und nationale Sicherheit.